2026收藏夹总结(持续更新)

2026收藏夹总结(持续更新)

[!Tip] 收藏说明 本文档整理收录 2026 年度优质文章、技术教程与实用资源,持续更新中...

📌 内容概览

本文档按日期分类收录优质内容,主要涵盖以下领域:

🔧 技术教程

- 02/01 思源笔记 S3 插件配置、Clawdbot 钉钉接入、Nitro.js 服务端工具、Vue Router 5、Electron 自动更新、MCP AI 自动化

- 02/03 AI Coding 网页设计、SVN 迁移 Git

- 02/04 系统接口慢速排查实战

- 02/06 开源 UI-UX 设计技能包

- 02/07 Antdv Next (Vue3 组件库)、Vue 高效插件、Autorecon 懒人神器

- 02/08 AI 编程入门、视频下载技巧

- 02/09 Axios 封装与拦截器

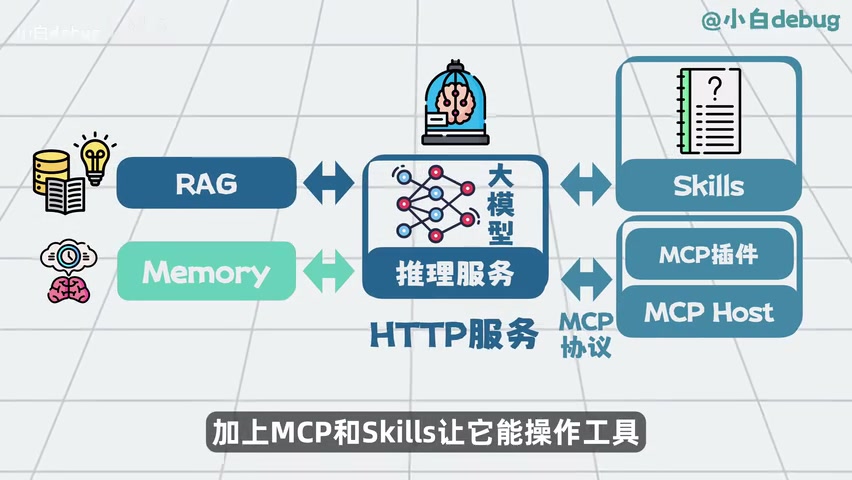

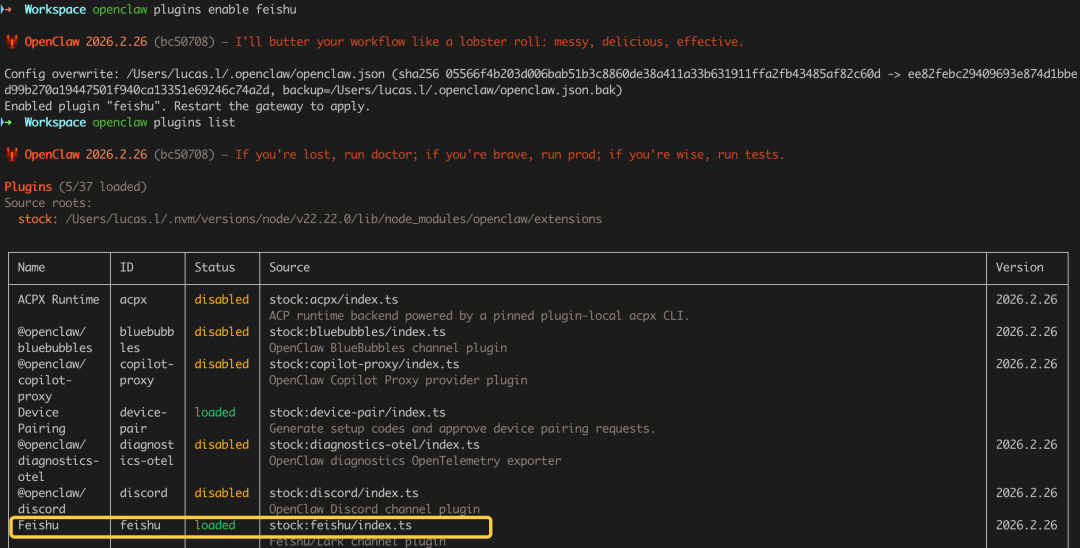

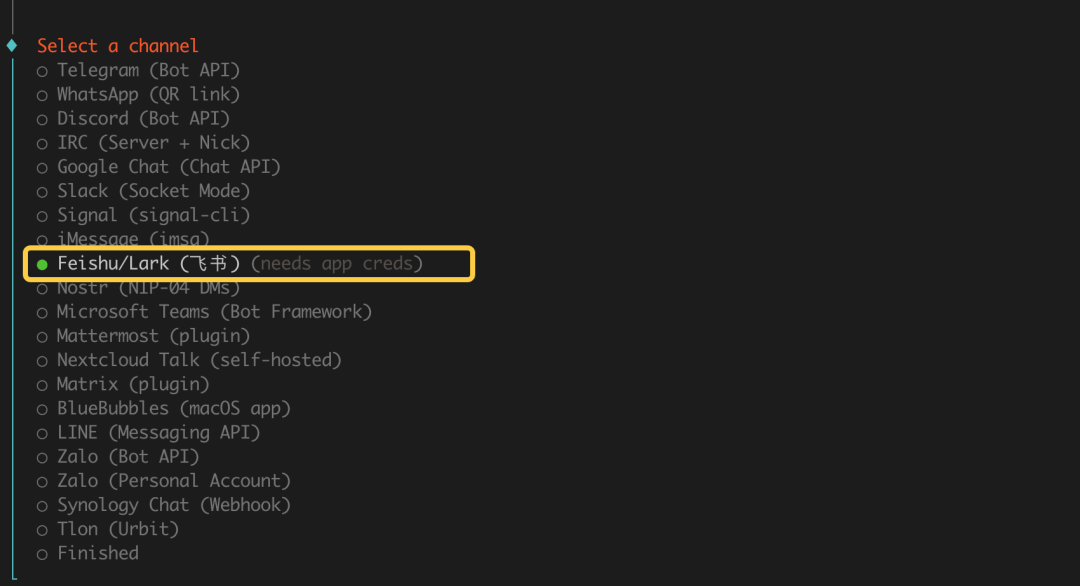

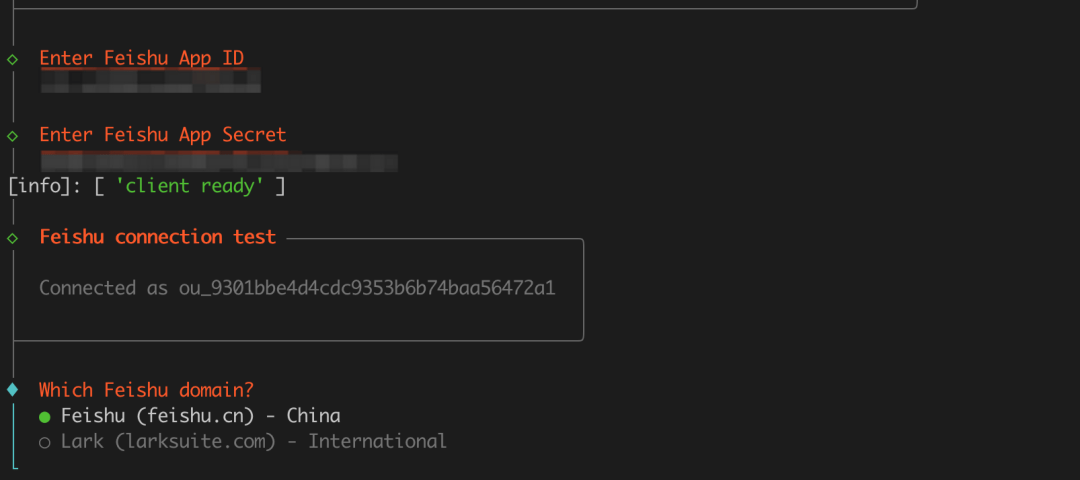

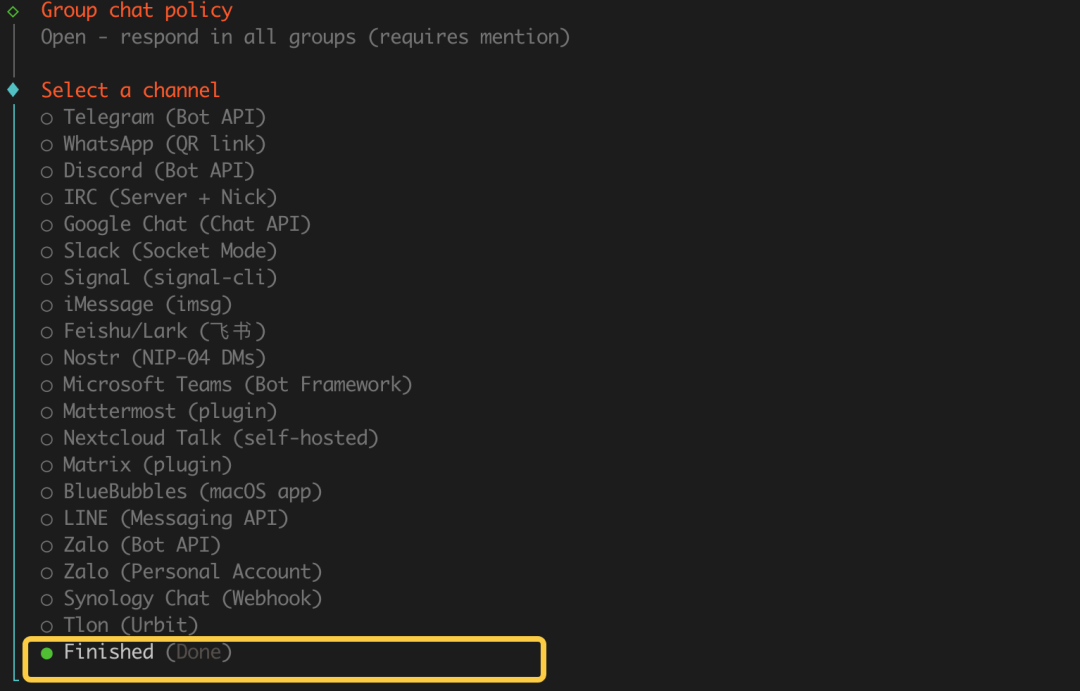

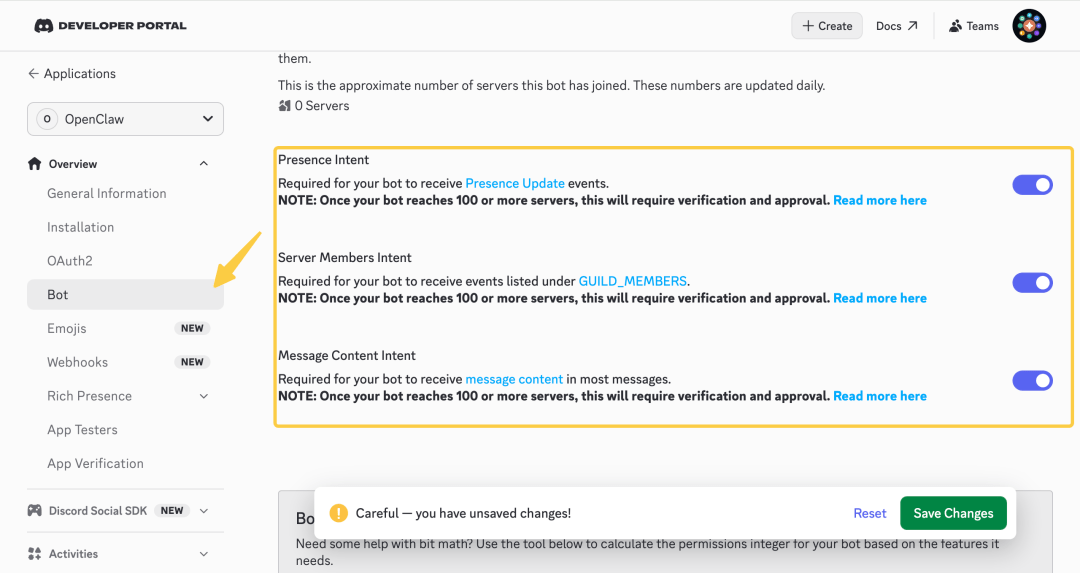

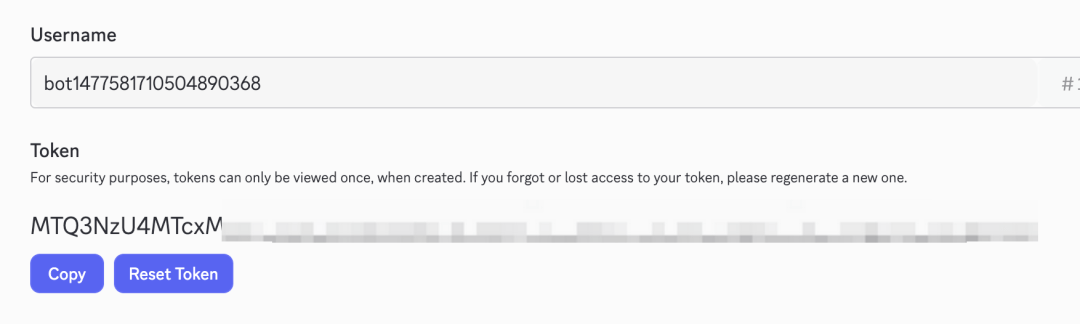

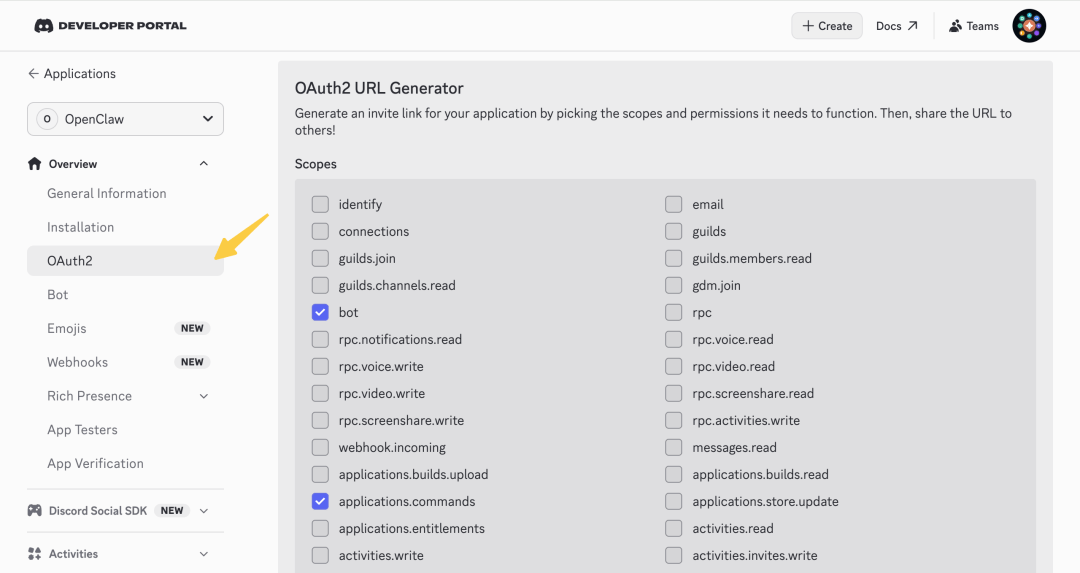

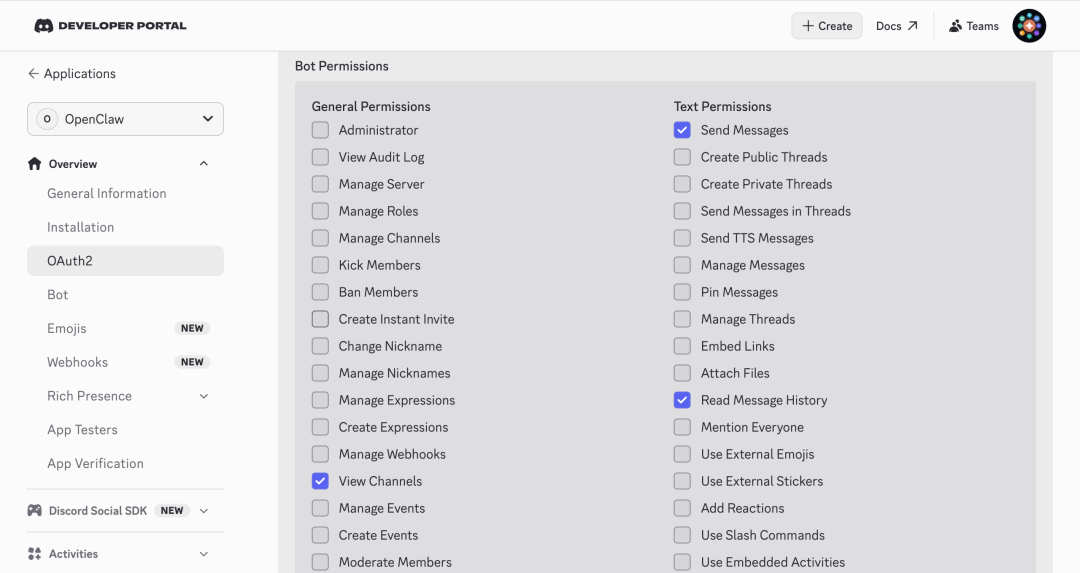

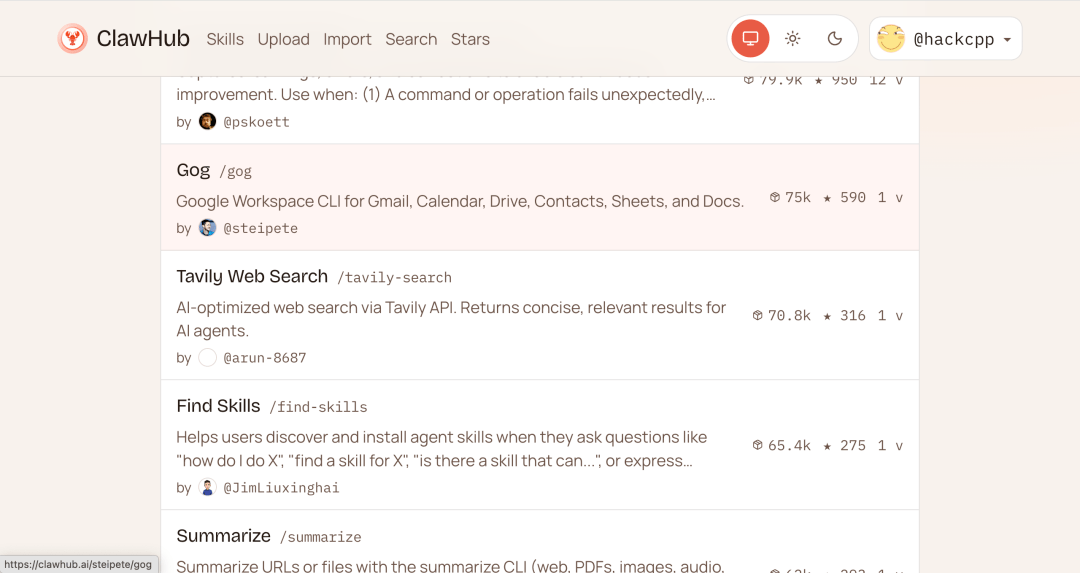

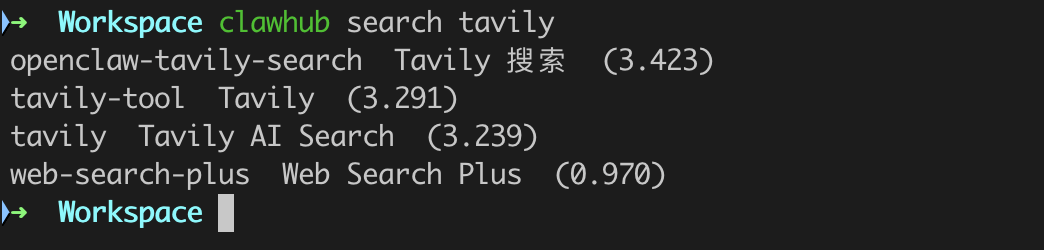

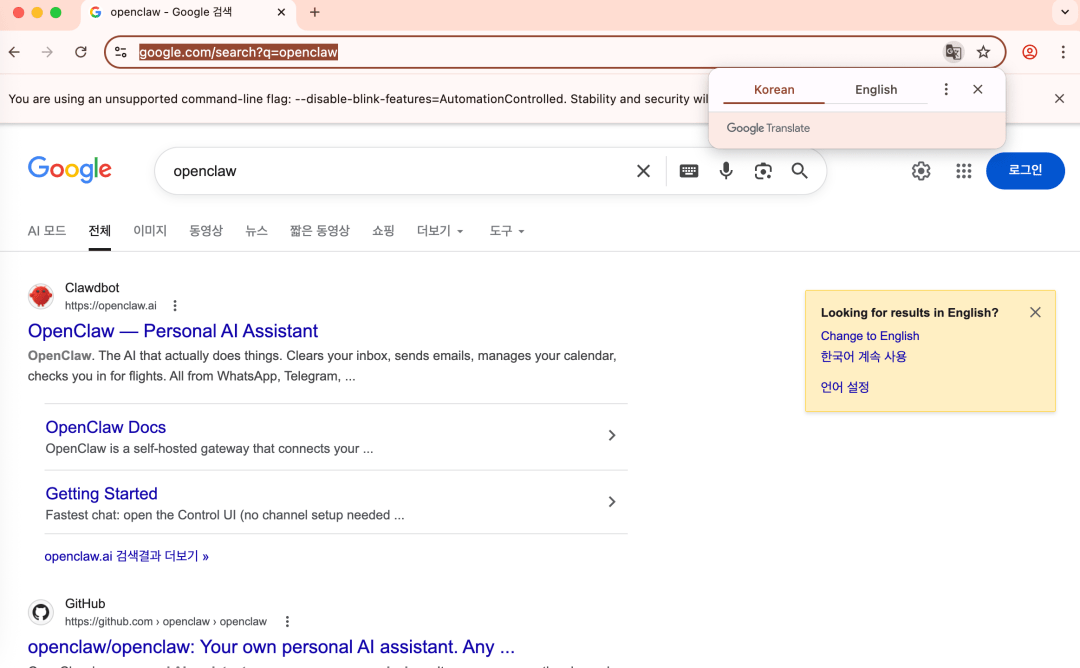

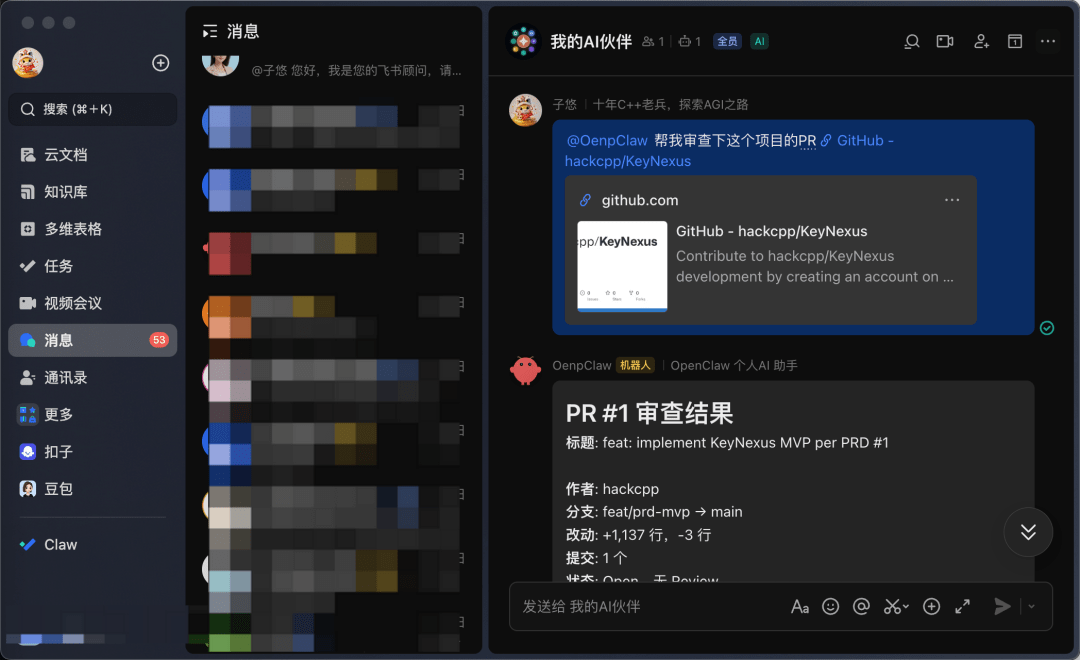

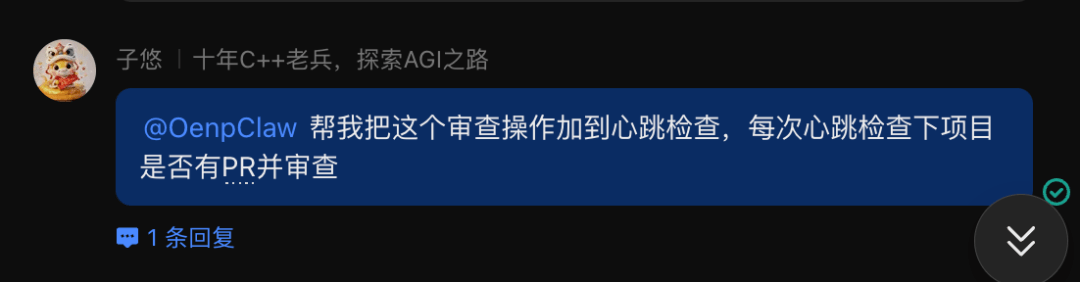

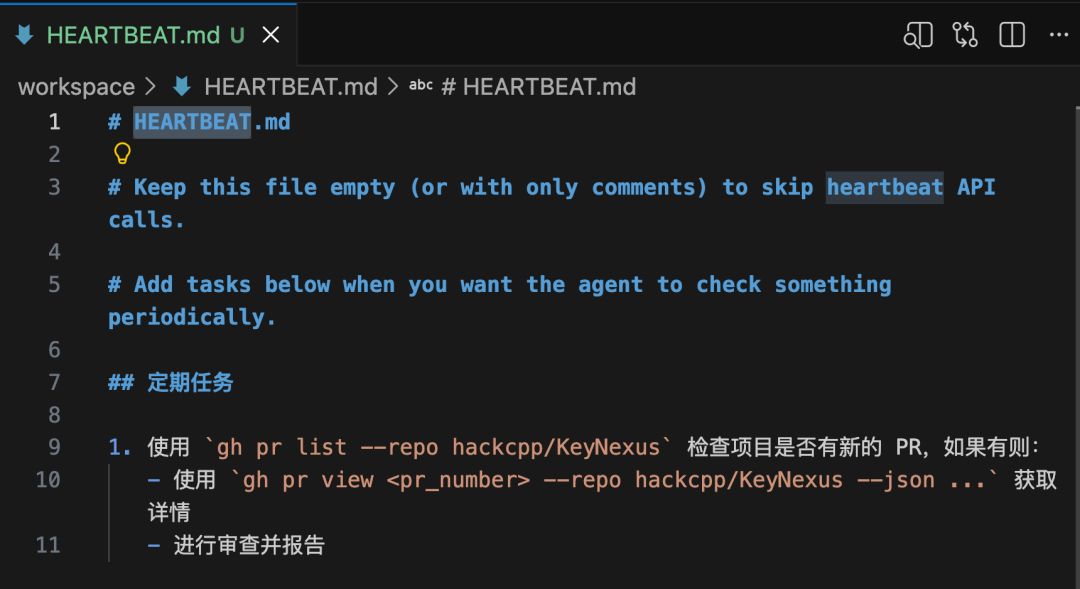

- 02/10 OpenClaw 与 Skills/MCP/RAG/Agent 关联解析

- 02/14 VueUse 工具库、手写签名、富文本编辑器、HTTP 方法速查表

- 02/15 腾讯地图集成、emoji 选择器

- 02/16 vue-ai-migrator 项目迁移工具

- 02/17 VueRouter 4 入门

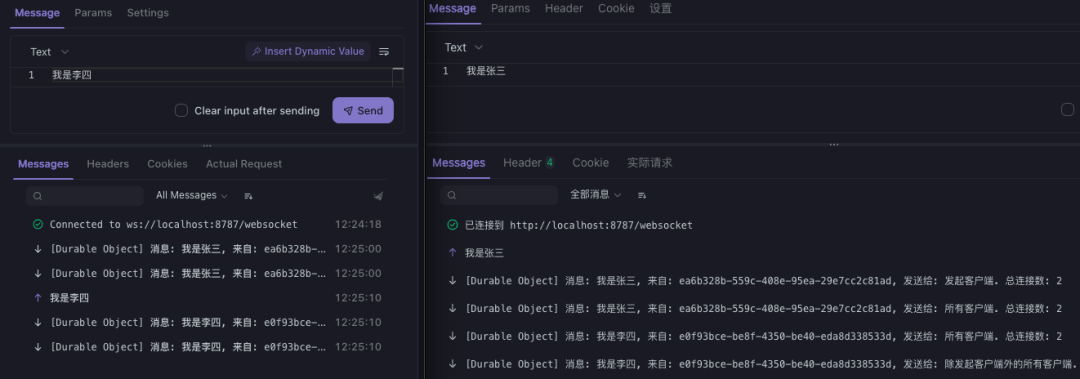

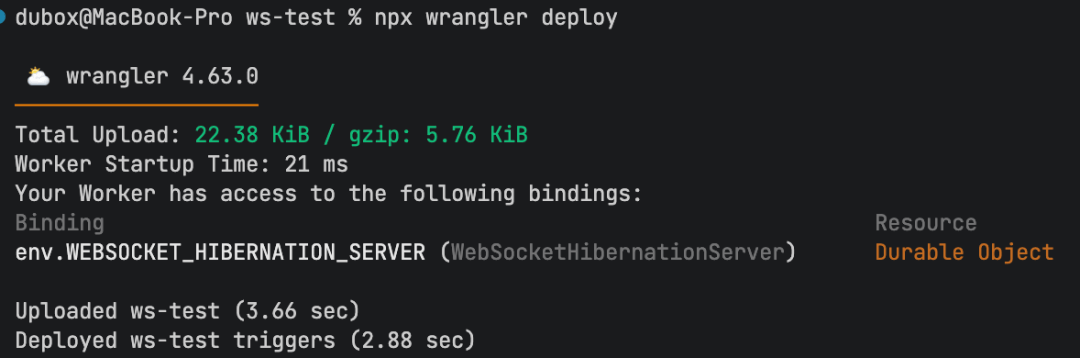

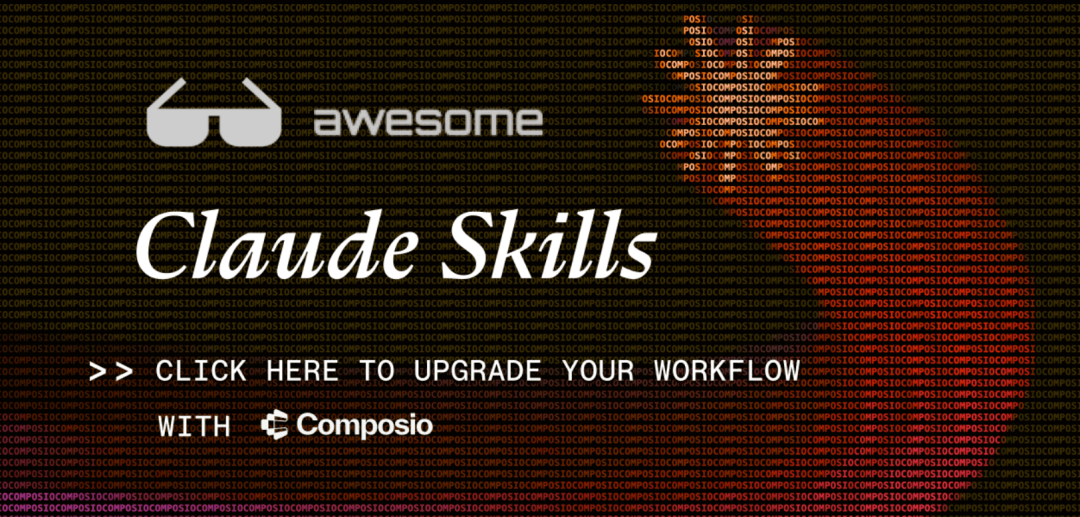

- 02/18 免费 WebSocket 服务器、GitHub 神级 Skills

- 02/20 RuoYi 全栈 AI 平台、xxl-job 定时调度原理

- 02/24 Bitwarden 自托管密码管理器、SQL 面试题、缓存模式、3 个 AI Agent 开源项目

- 02/25 GitHub 55k Star 单文件后端

- 02/26 OpenCode 中文教程、Vize 工具、AI 编程工作流

- 02/28 qrcode-vue3 二维码生成

☕ Java & 全栈

- 02/02 SpringBoot 文件分片上传、Java 工程师必知、Claude Code 提示词技巧

- 02/11 Conventional Commits 规范、Java 转 Go 建议

- 02/24 面试题:缓存一致性解决方案

💡 AI 与工具

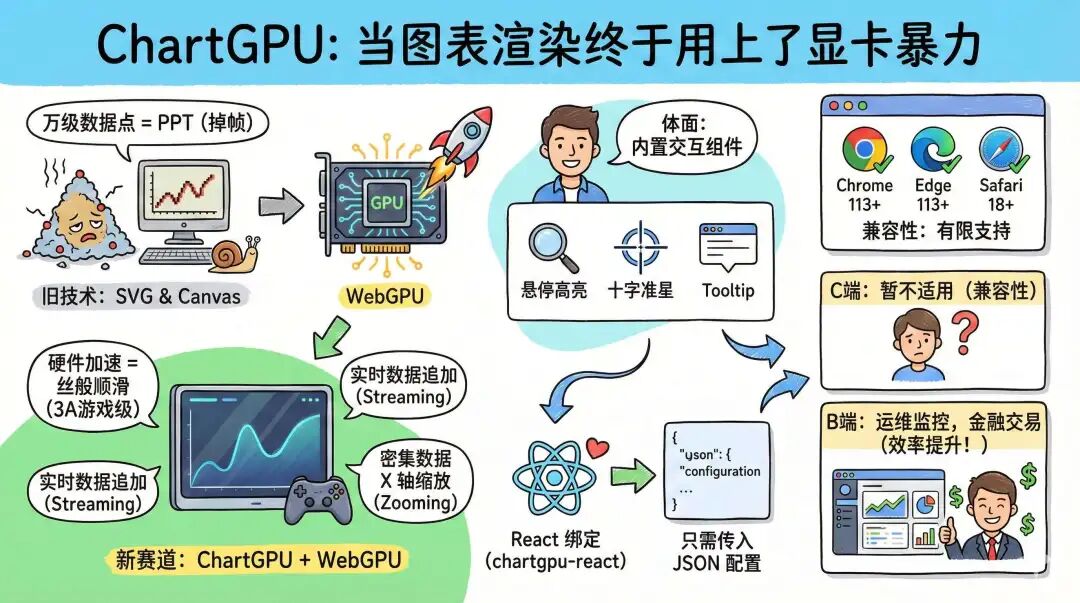

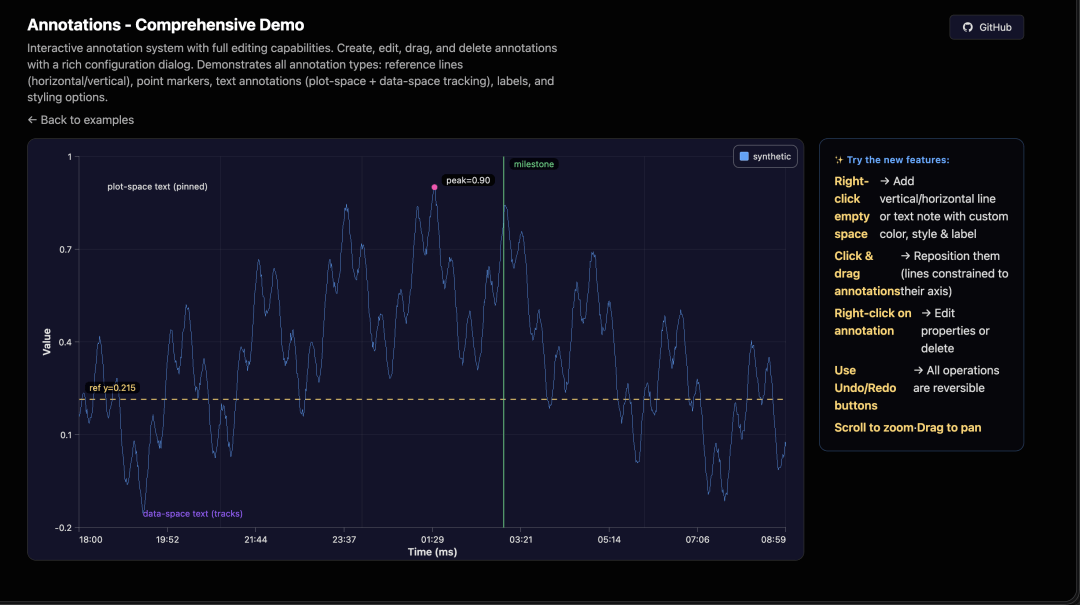

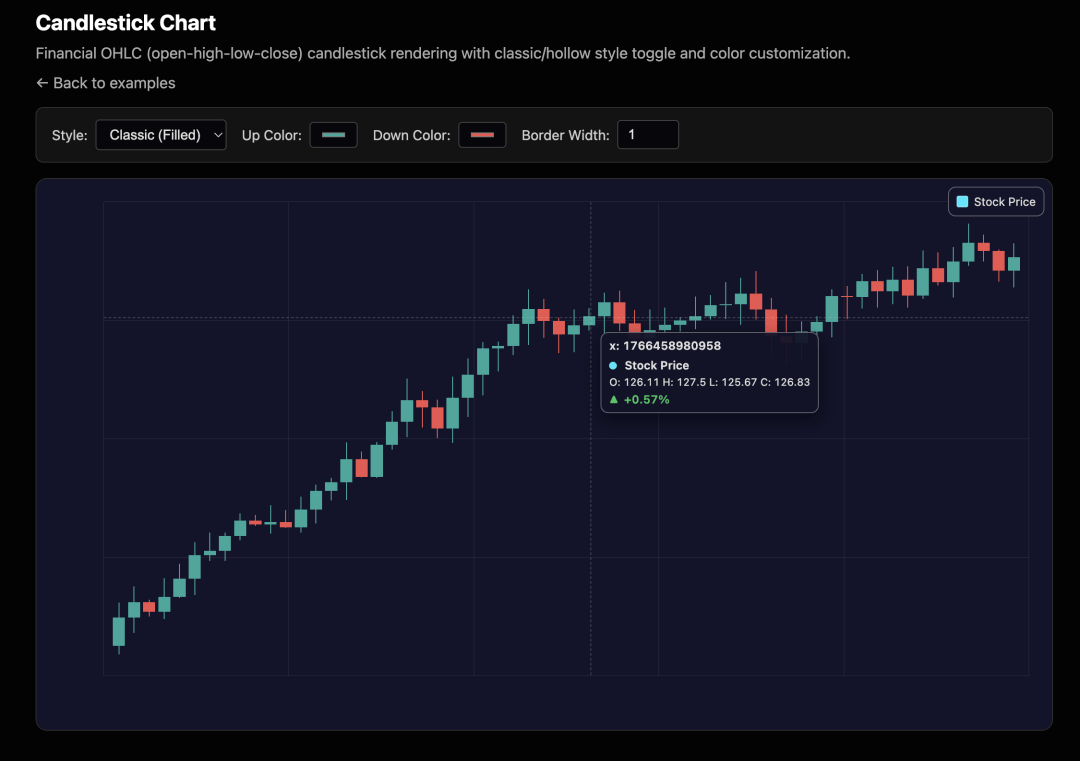

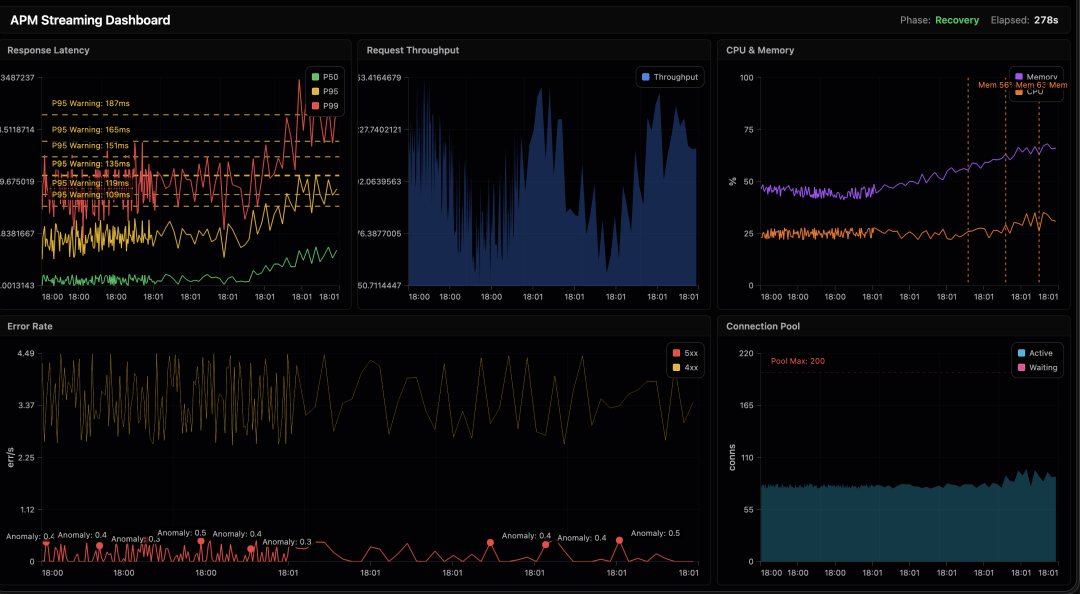

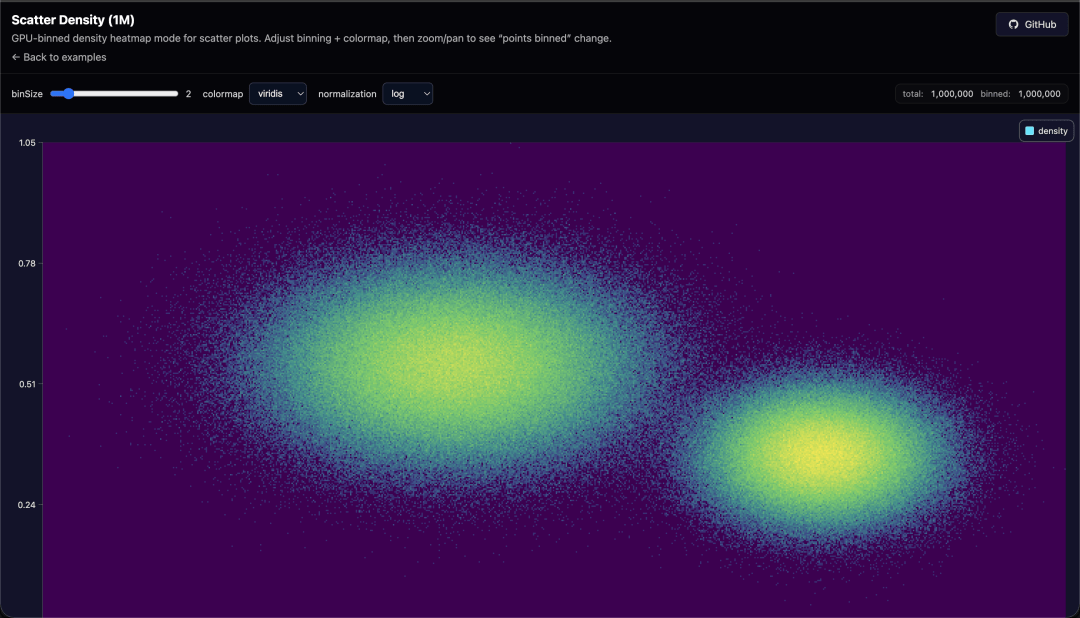

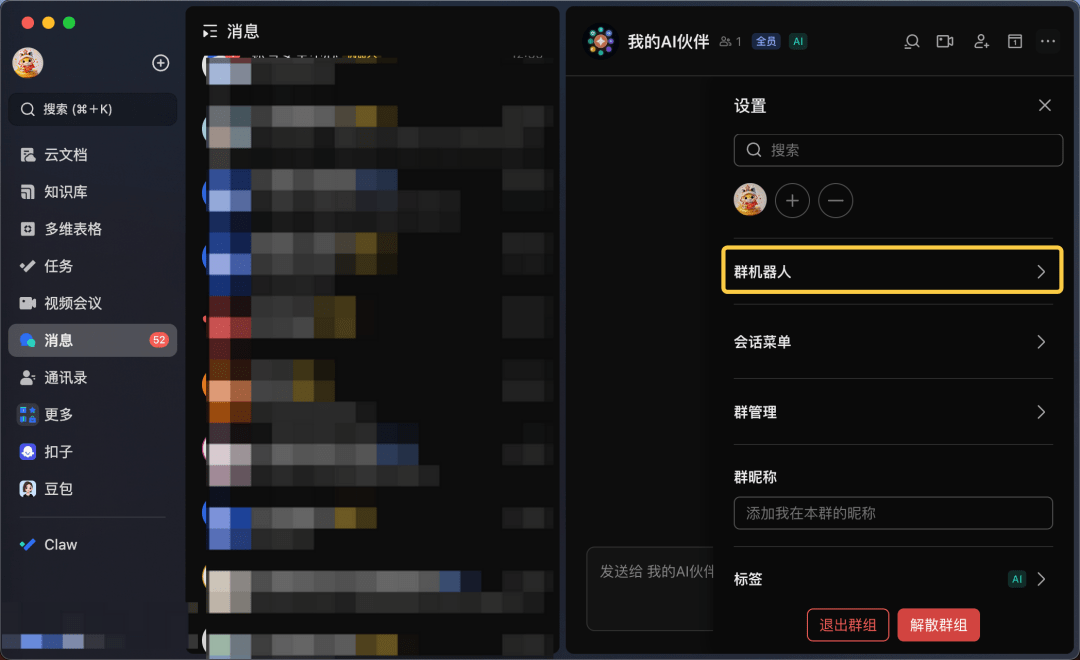

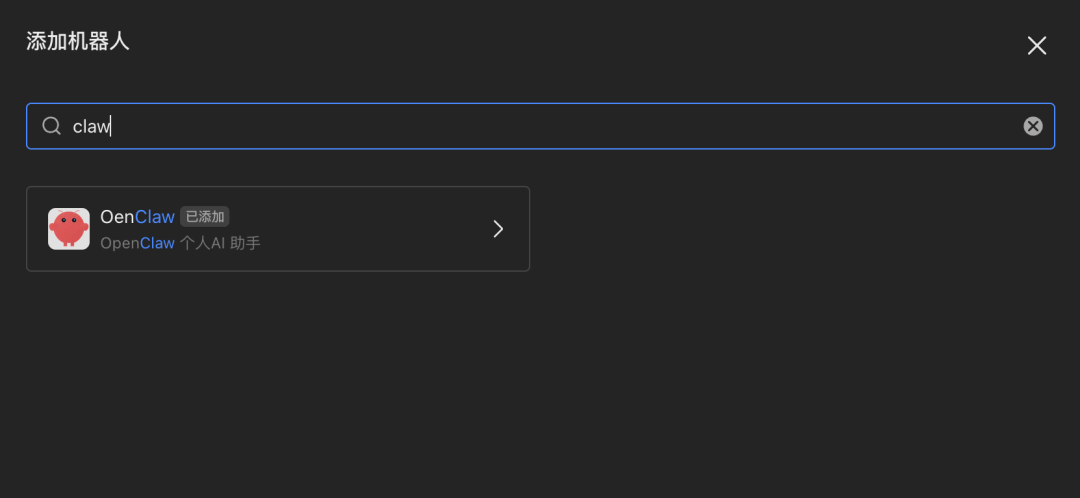

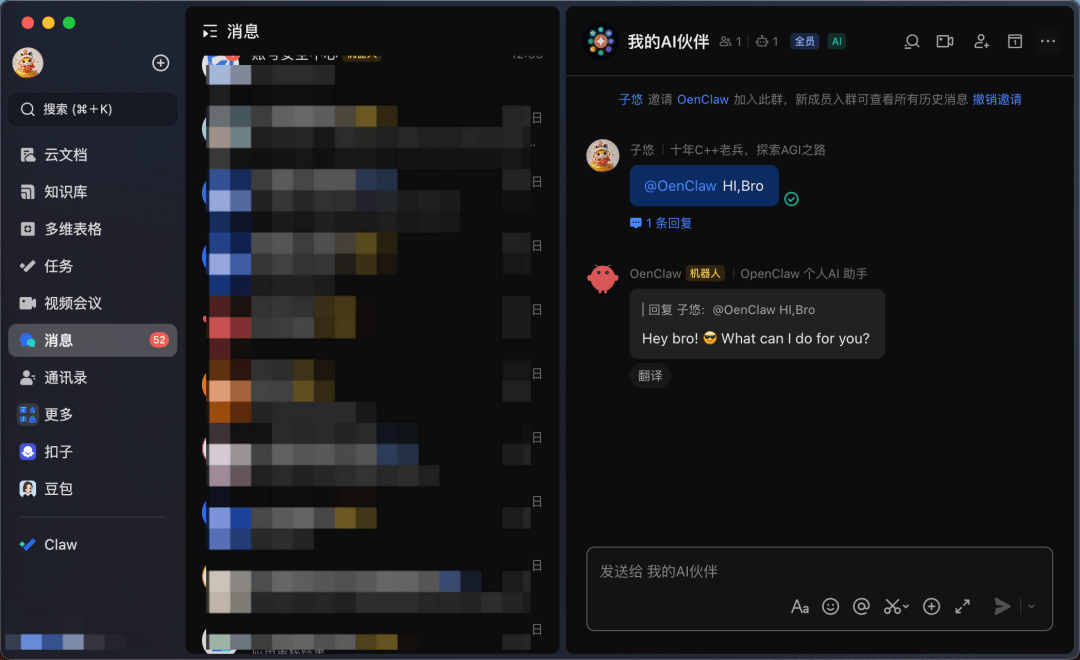

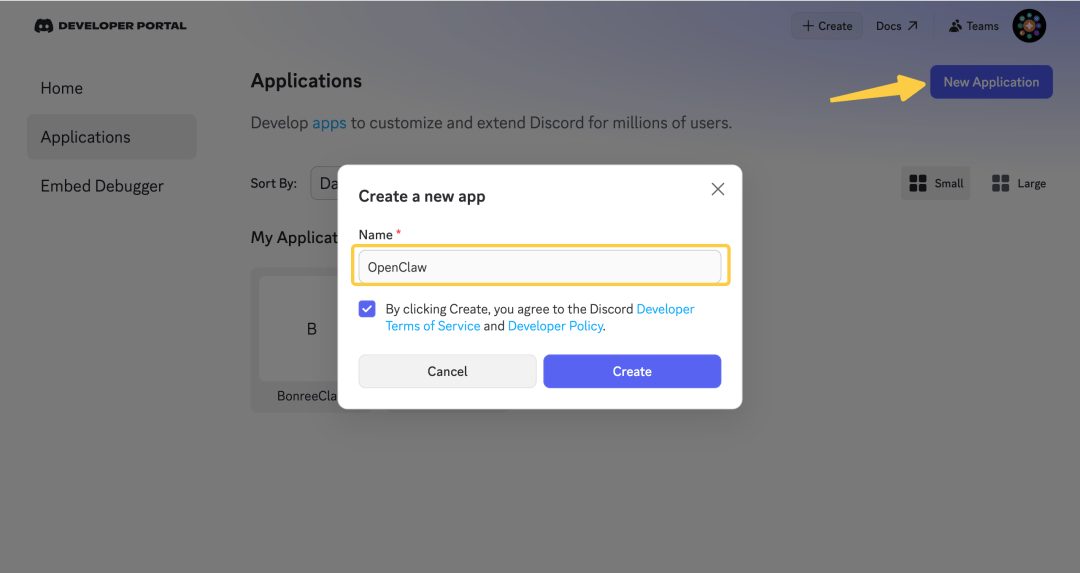

- 03/03 ChartGPU (WebGPU ECharts)、OpenClaw 完整教程

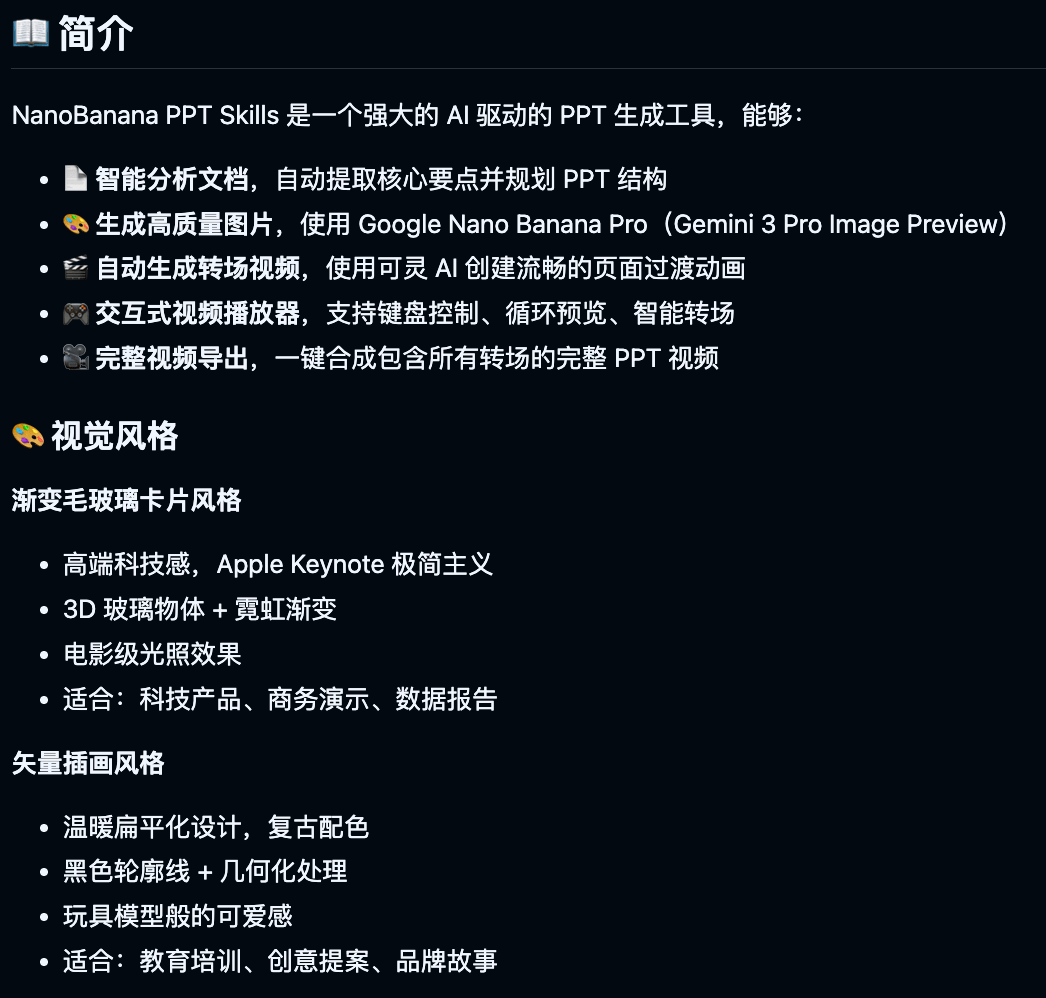

- 03/05 Nano Banana 2 创作工具

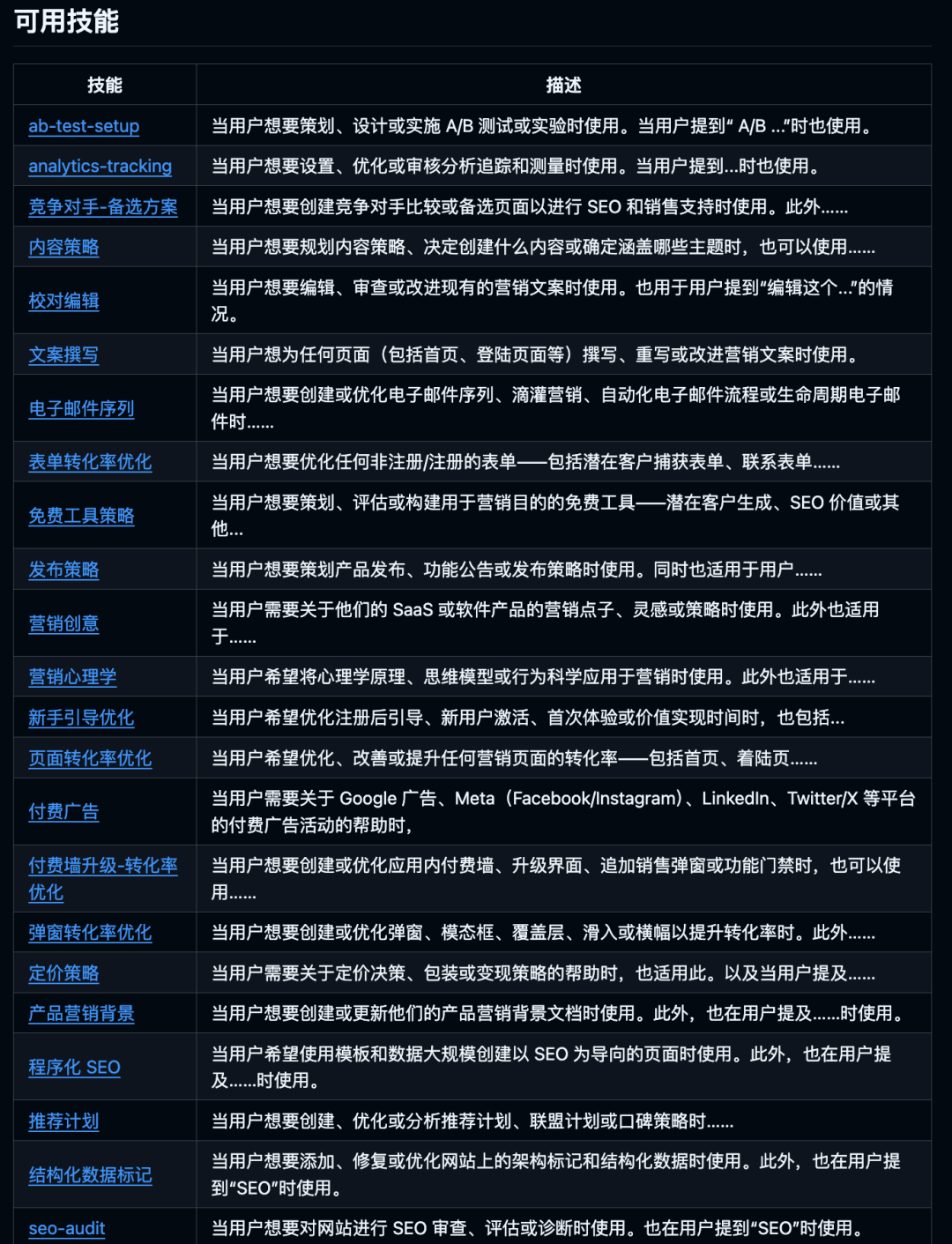

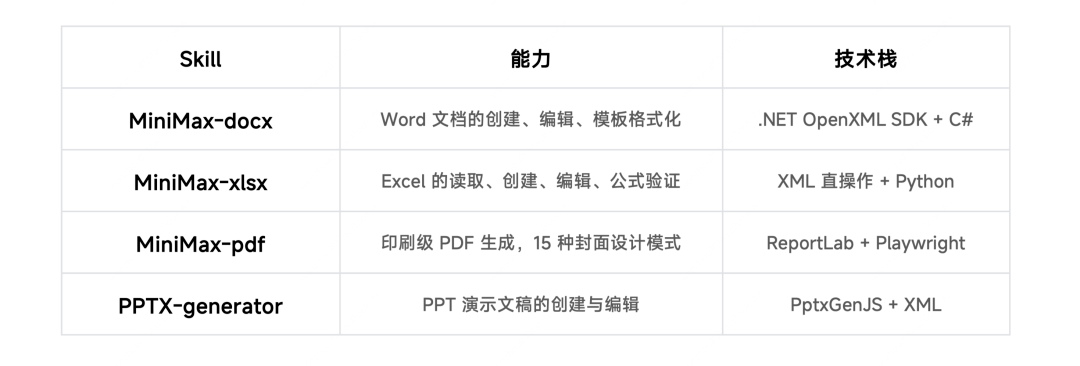

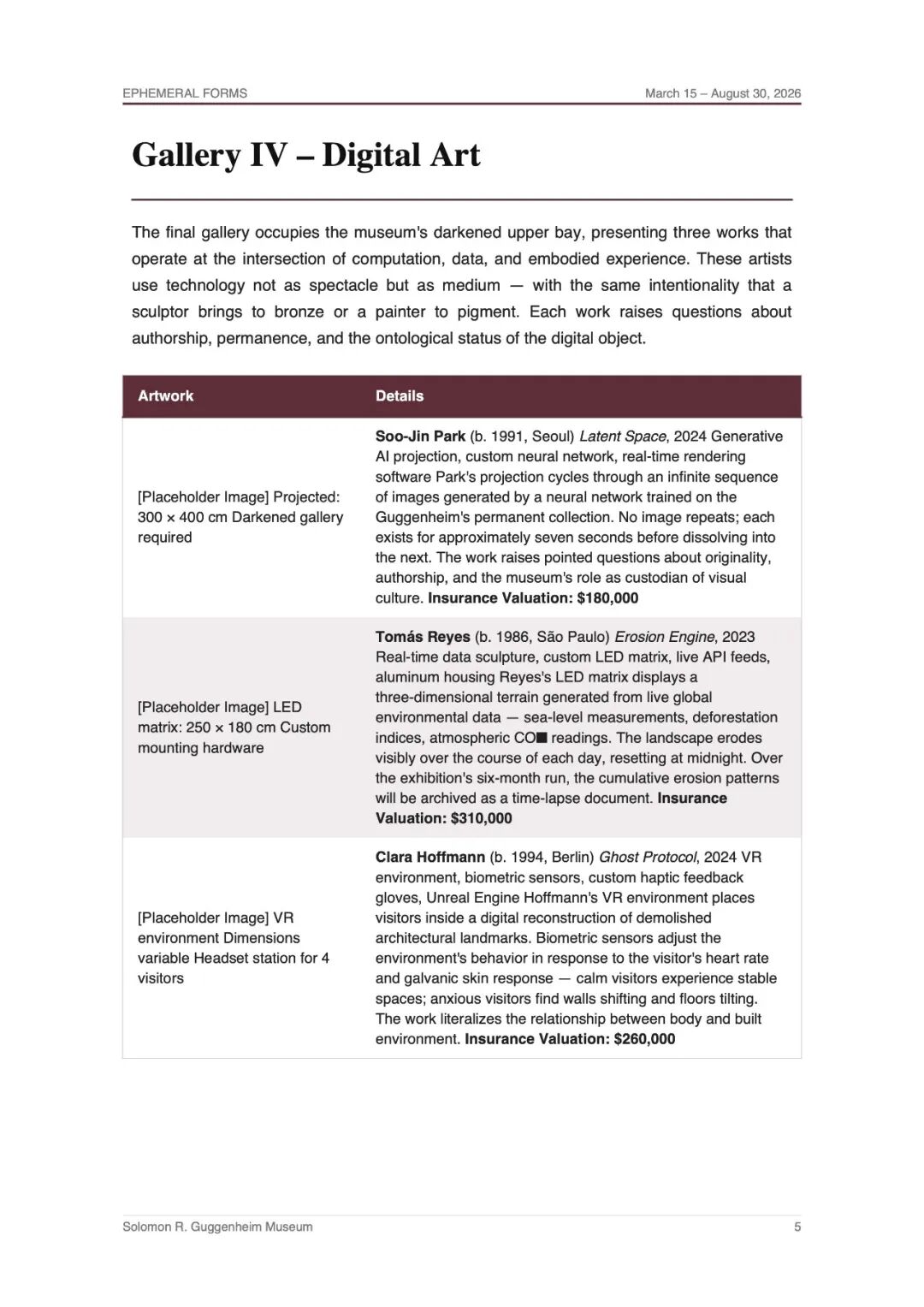

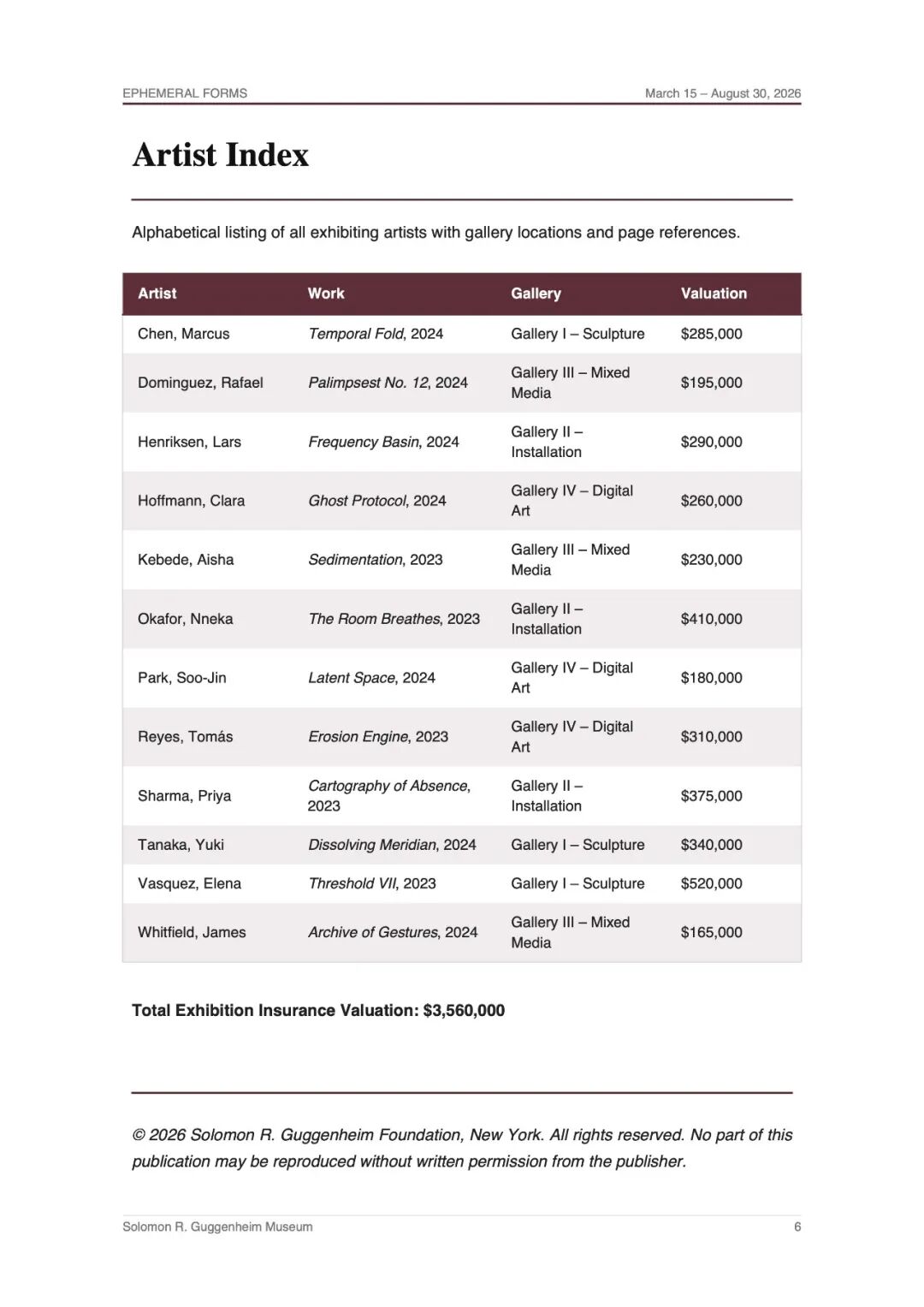

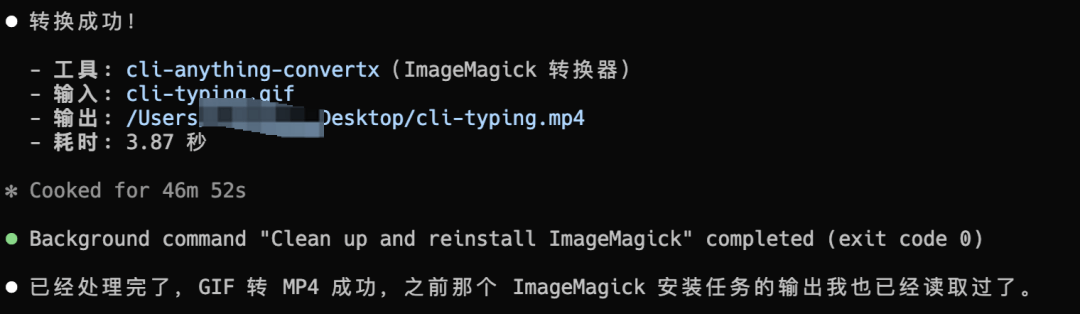

- 03/25 MiniMax Office Skills、CLI-Anything Agent 工具

🧠 思维与成长

- 03/06 斯多葛哲学实用指南

- 03/12 幸存者偏差与全样本思维

- 03/14 意志力霸凌、大脑戒备与微习惯

🏢 运维与安全

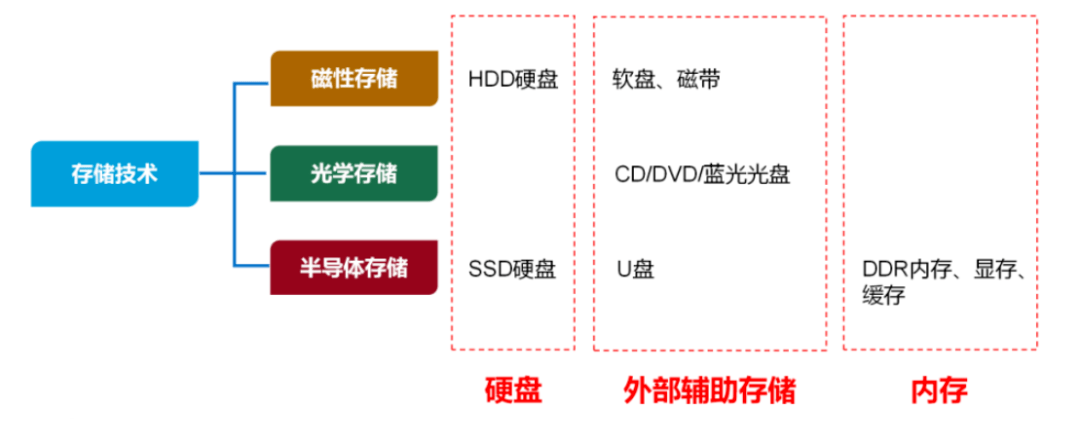

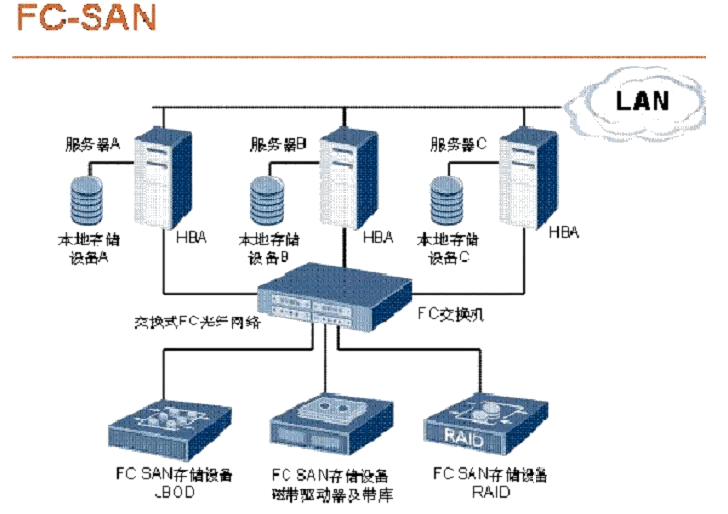

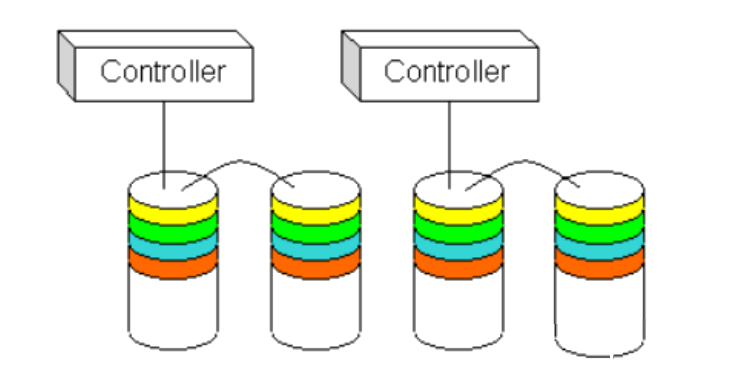

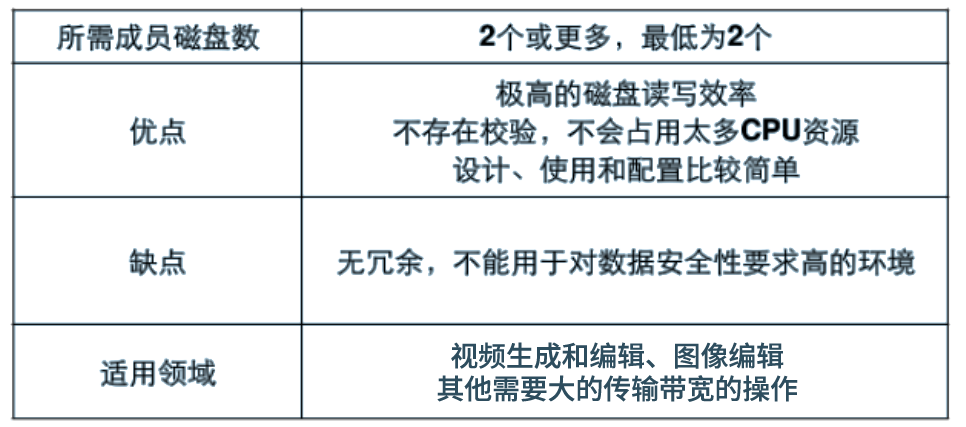

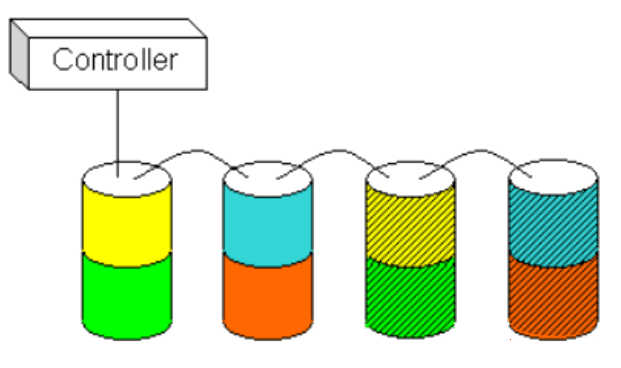

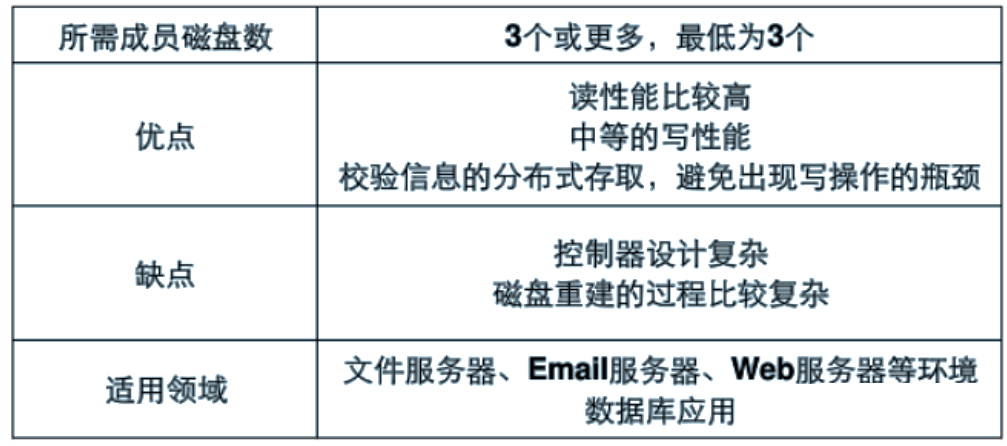

- 03/20 存储知识全解

- 02/24 Bitwarden + Cloudflare 自托管密码管理

📅 2月

02/01 | 技术教程

- 🚀 思源笔记 S3 插件 v1.0.2 更新:手把手教你配置 PicList 导出[^1]

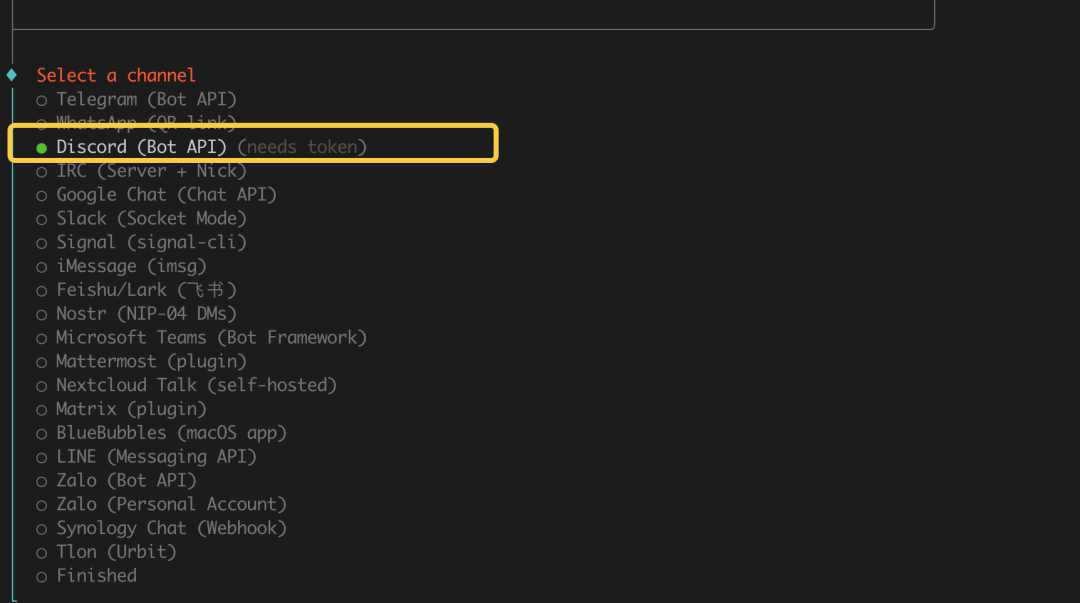

- 🪁 Clawdbot 接入钉钉手把手教程[^2]

- 🦢 Nitro.js 前端技术栈 服务端运行时工具包[^3]

- 🐼 Vue Router 5:【手写路由】时代终结![^4]

- 🐕 electron应用自动更新详细教程(二):更新服务器搭建[^5]

- 🚆 【Electron】打包后图标不变问题[^6]

- 🔦 微软授权 Windows MCP AI:Flow IPC 本地大模型实现全流程自动化[^7]

02/02 | Java & Spring

- 🕋 SpringBoot + 文件分片上传 + 断点续传 + 秒传(MD5 校验)[^8]

- 🏆 java研发工程师必知必会[^9]

- 🍫 基于 Claude Code 自动编程案例的提示词技巧[^10]

02/03 | UI/设计 & Git

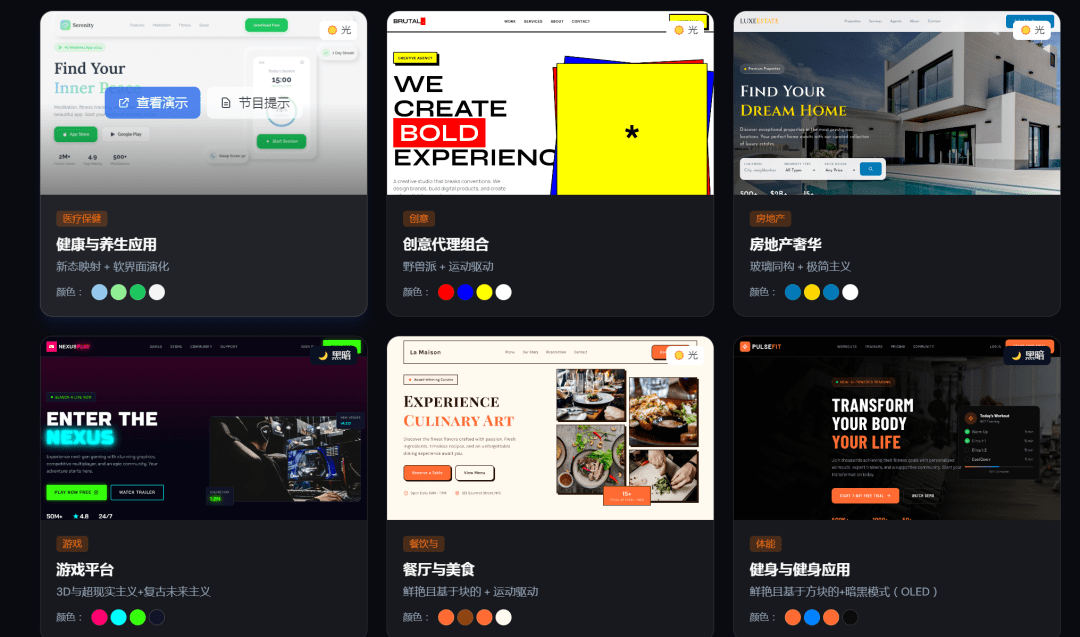

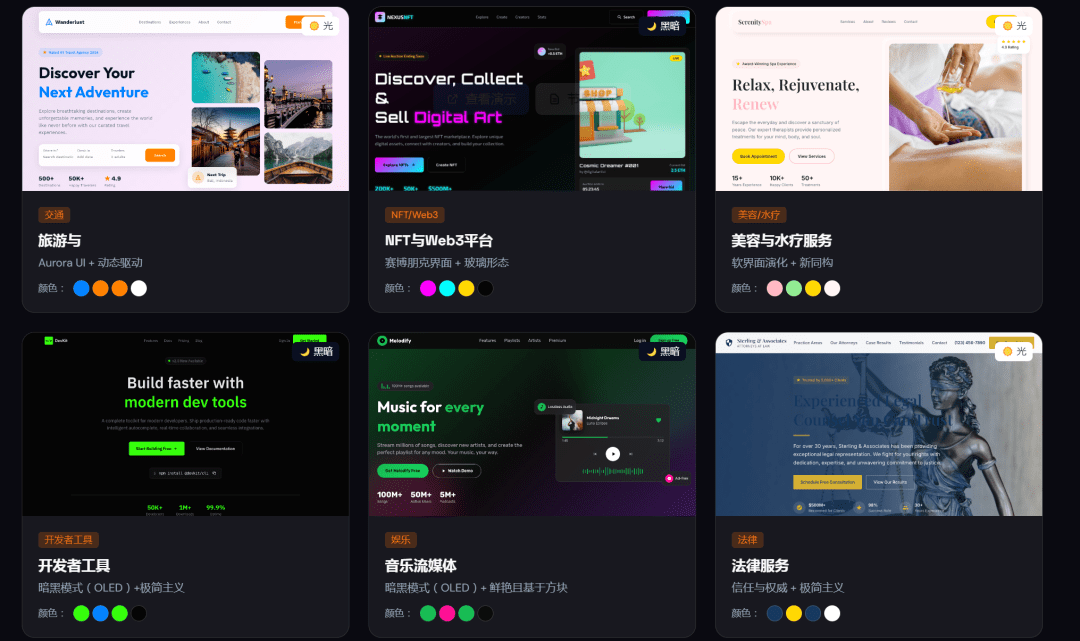

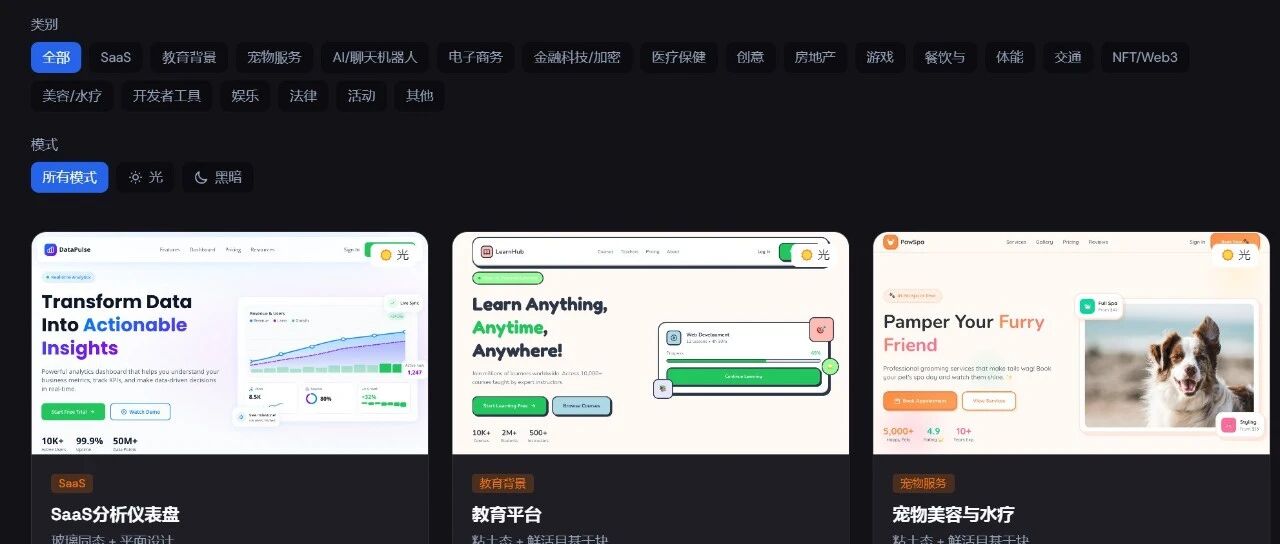

- 🐻❄️ 不会设计也能搭出高级感网页:AI Coding 提示词模板 & 精品组件库[^11]

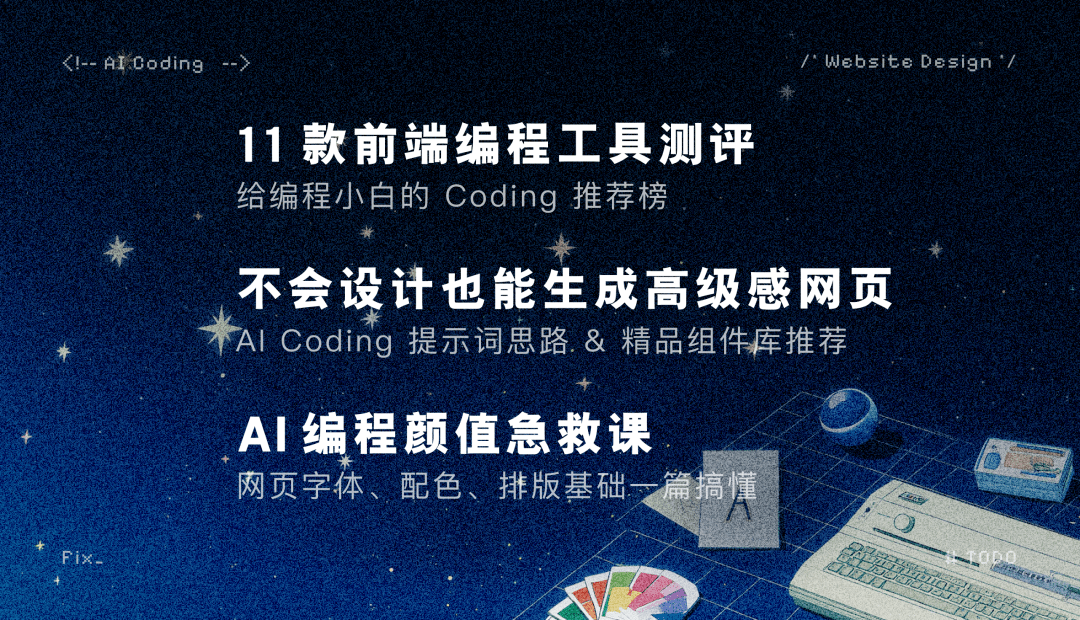

- 👞 将 SVN 仓库迁移到 Git[^12]

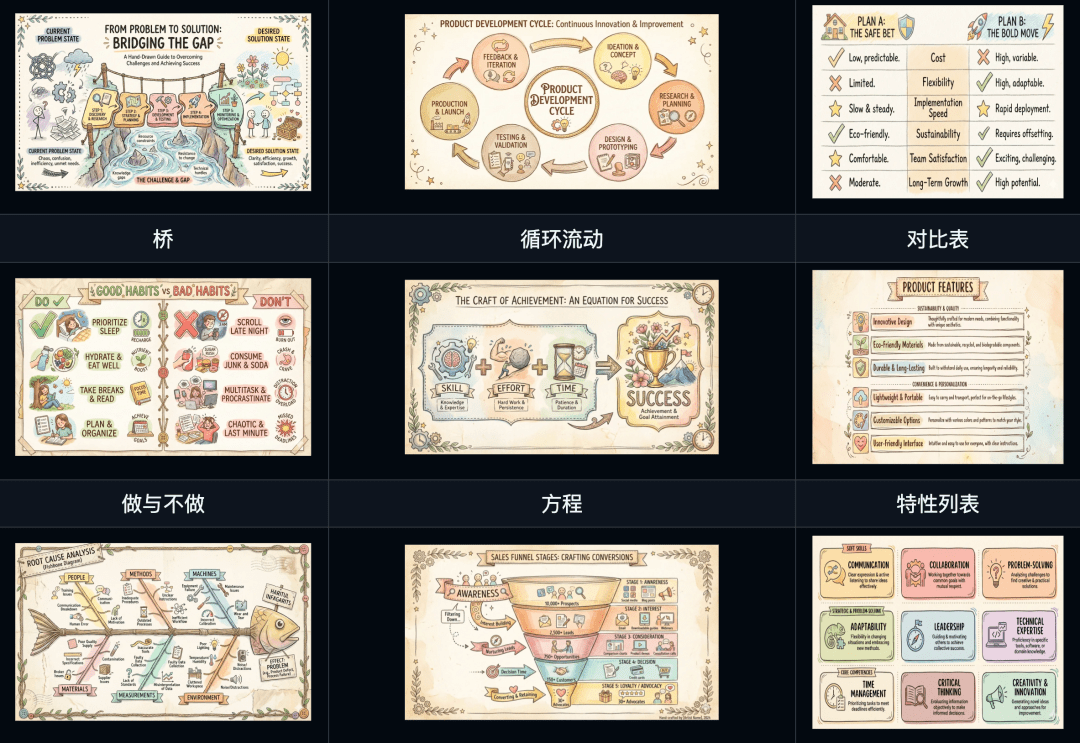

- ☕ 6 个超神的 SKills,GitHub 热门推荐[^13]

02/04 | 系统排查

- 🐫 系统接口突发慢速的系统化排查思路与实战指南[^14]

02/06 | AI设计

- 📈 开源-UI-UX 设计技能包,跨平台多框架一键生成专业级界面[^15]

02/07 | 工具推荐

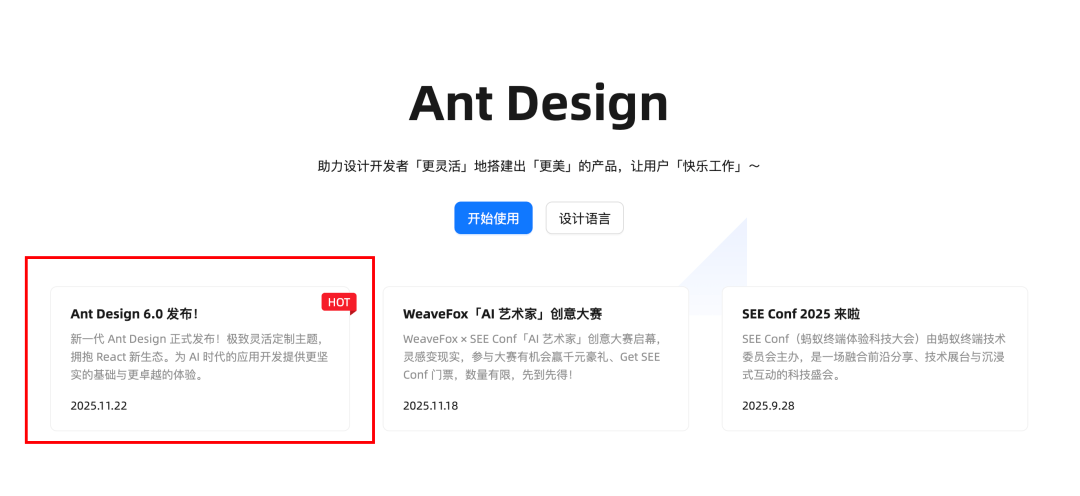

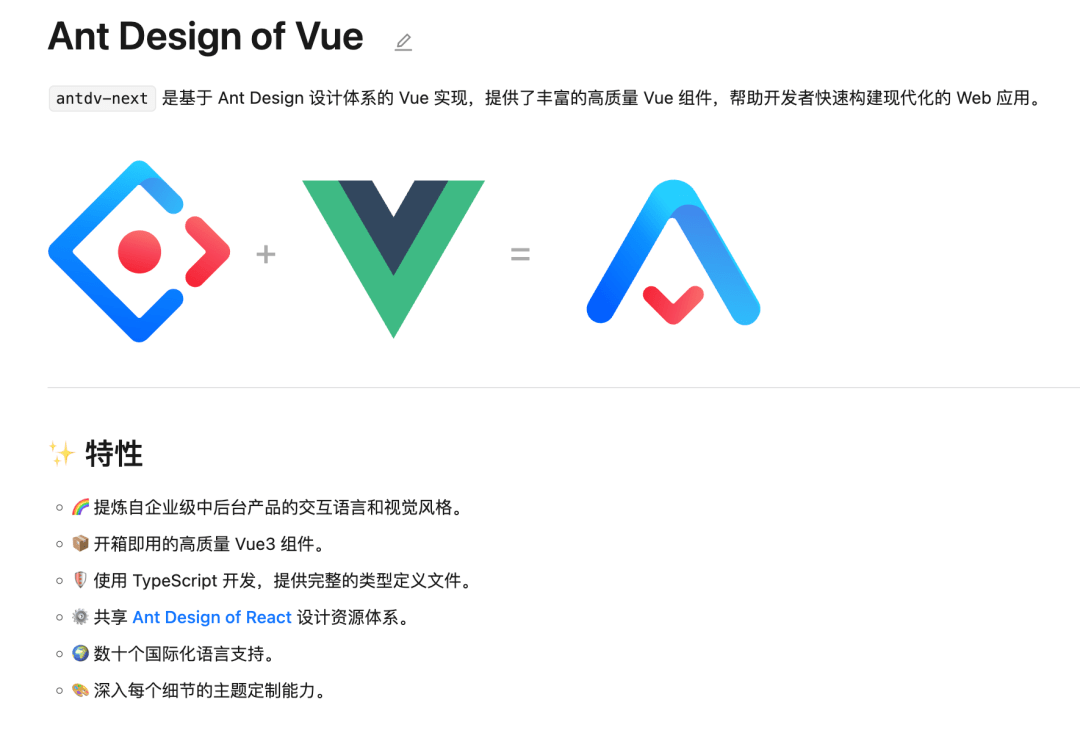

- 🍇 重磅!Antdv Next 正式发布!对标 Antd V6 的 Vue3 UI 组件库[^16]

- 📄 Vue 开发必备!9 个高效插件,Vue2-Vue3 通用[^17]

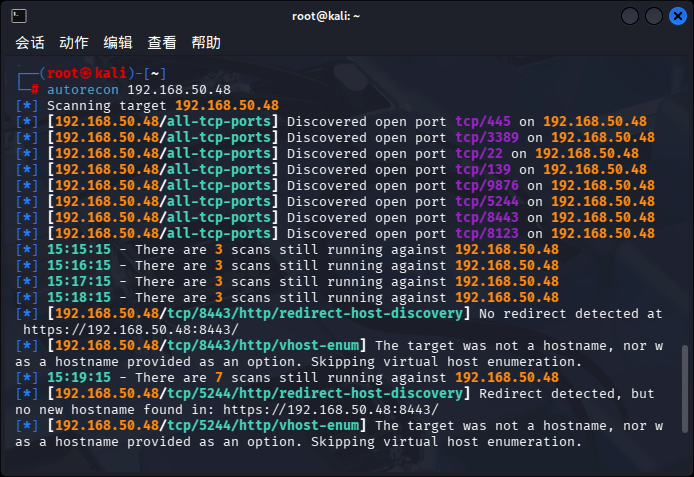

- 🧿 懒人神器 Autorecon[^18]

- 🏐 编程中的MVP是什么意思?[^19]

02/08 | AI编程

- 🎉 AI编程,我也入局了![^20]

- 📸 一句话让 AI 帮我下载各种视频[^21]

02/09 | Axios封装

- 🏡 Axios 高效封装实战:拦截器 + 统一处理,告别重复请求逻辑[^22]

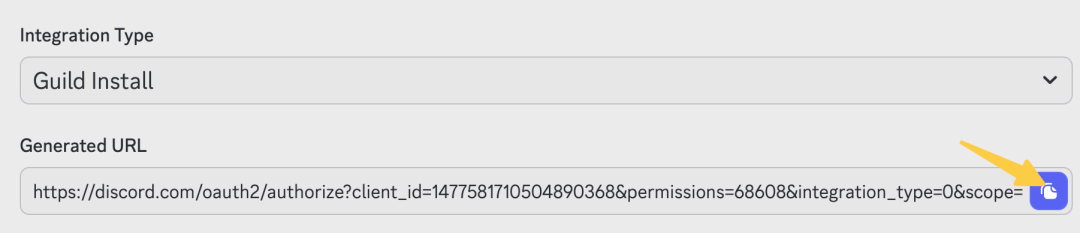

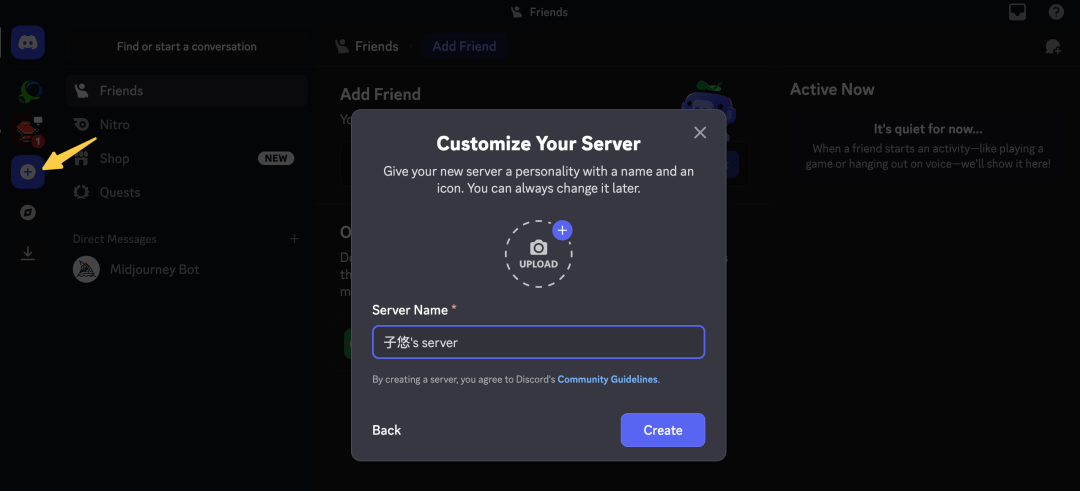

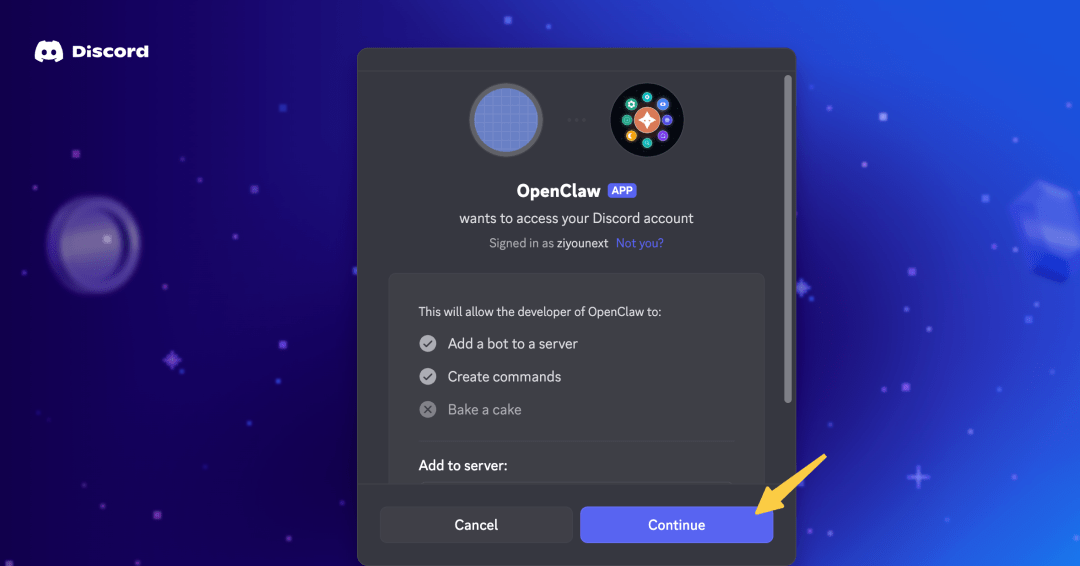

02/10 | OpenClaw

- 🍗 OpenClaw(clawdbot)是什么?与 Skills、MCP、RAG、Memory 与 AI Agent 的关联解析[^23]

02/11 | 开发规范

- 📄 Conventional Commits 规范详解[^24]

- 📄 建议Java工程师都要学习一下Go语言[^25]

02/14 | Vue3 & 工具

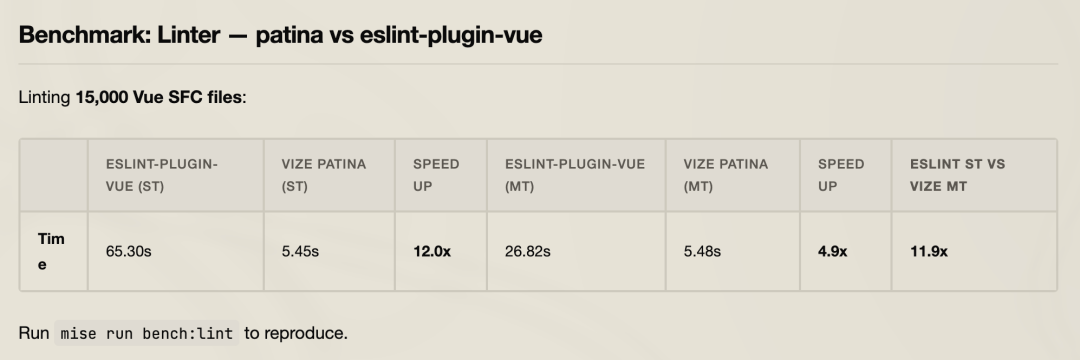

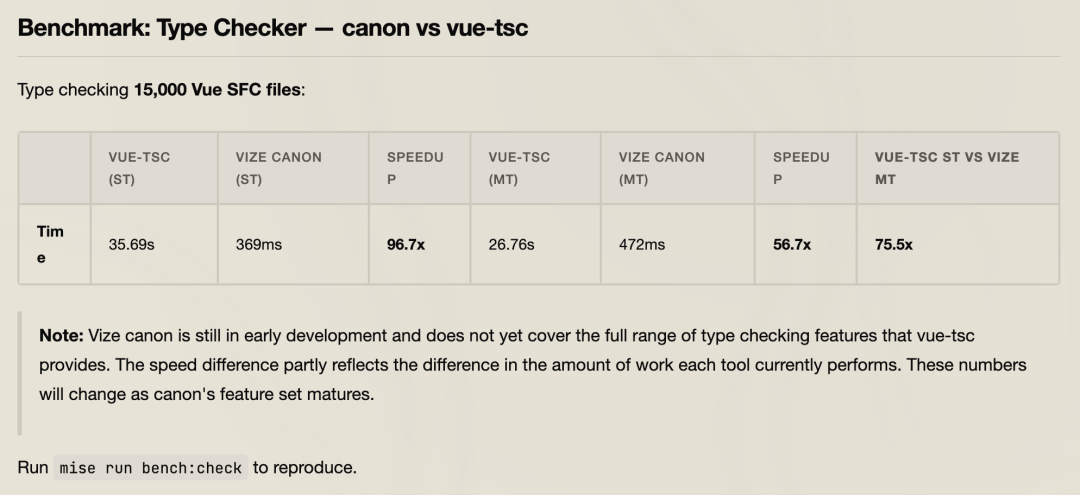

- 🩱 干掉 Vite ?Vize ?[^26]

- 📄 MiniCPM-o 4.5 开源,登上了开源热榜[^27]

- 📄 Vue3 开发效率翻倍!VueUse 工具库从入门到实战[^28]

- 🪵 Vue3实现手写签名:Vue3-signature的快速应用[^29]

- 📄 开源 Web 现代富文本编辑器[^30]

- 📄 告别死记硬背!HTTP请求方法速查表[^31]

02/15 | Vue插件

- 📄 vue-qqmap:Vue 项目中快速集成腾讯地图的实用插件[^32]

- 📄 vue3-emoji-picker 优雅实现表情包选择器[^33]

02/16 | AI迁移

- 📄 vue-ai-migrator:AI赋能,Vue项目迁移新效率[^34]

02/17 | VueRouter

- 🎆 VueRouter 4 快速入门[^35]

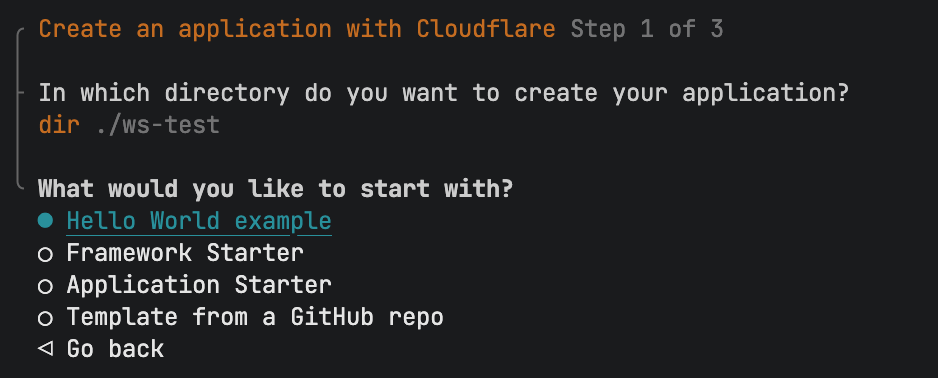

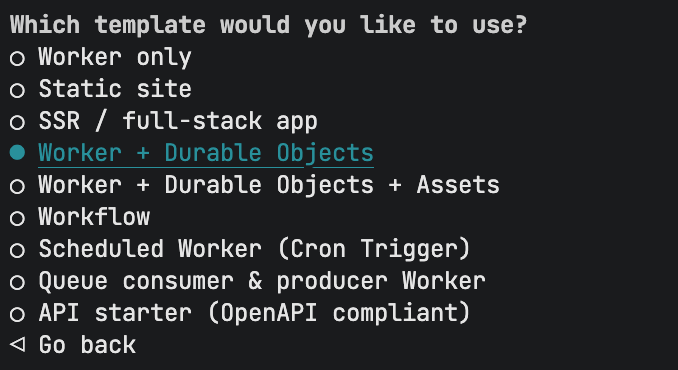

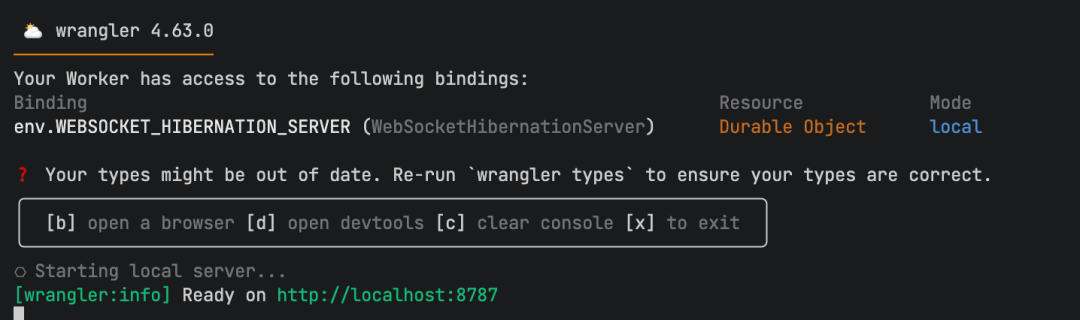

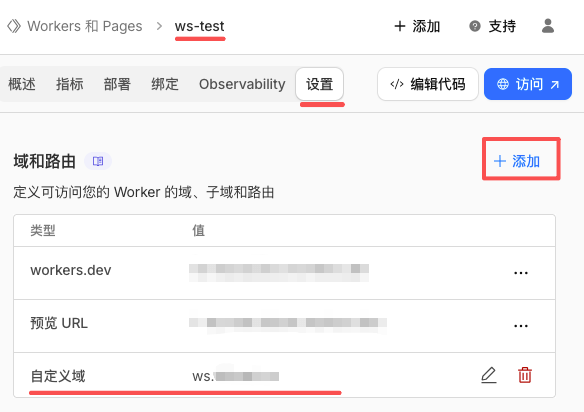

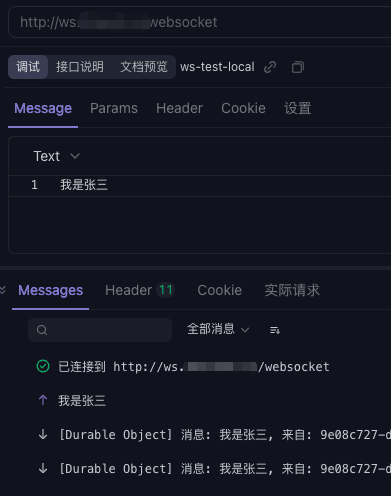

02/18 | Websocket & Skills

- 🎇 免费 Websocket 服务器[^36]

- 📄 推荐 4 个神级 SKills 开源 GitHub 项目[^37]

02/20 | RuoYi & 定时任务

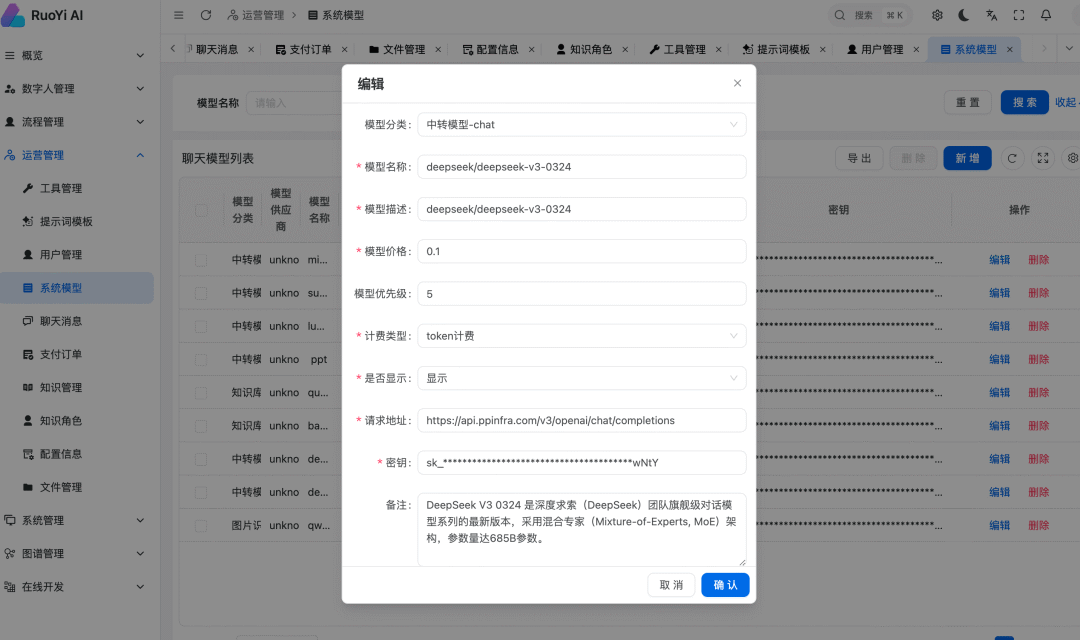

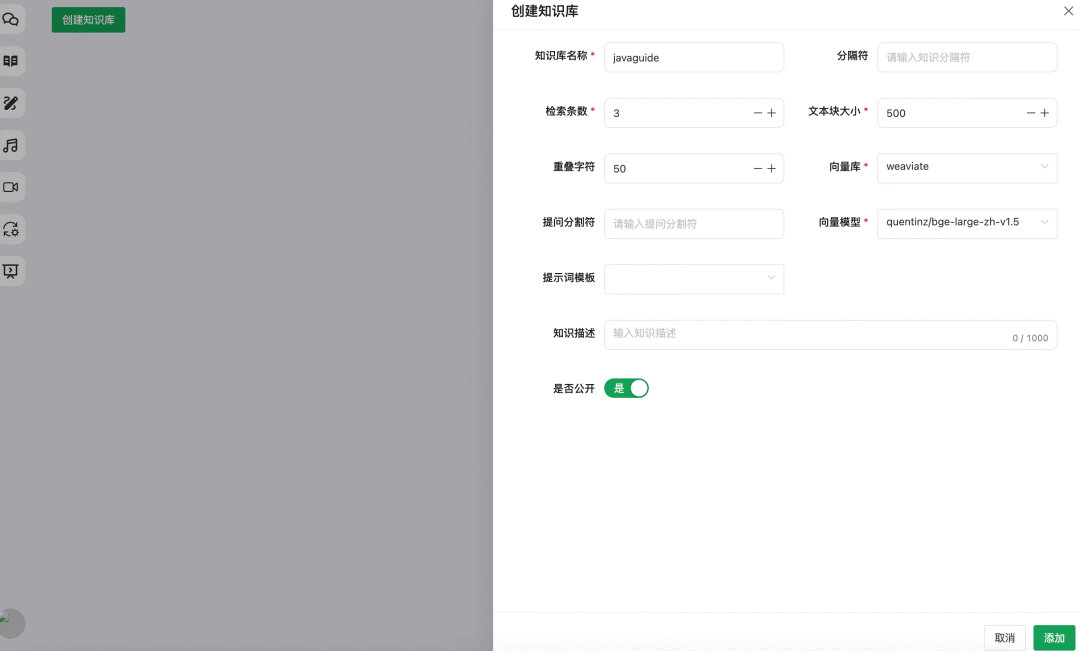

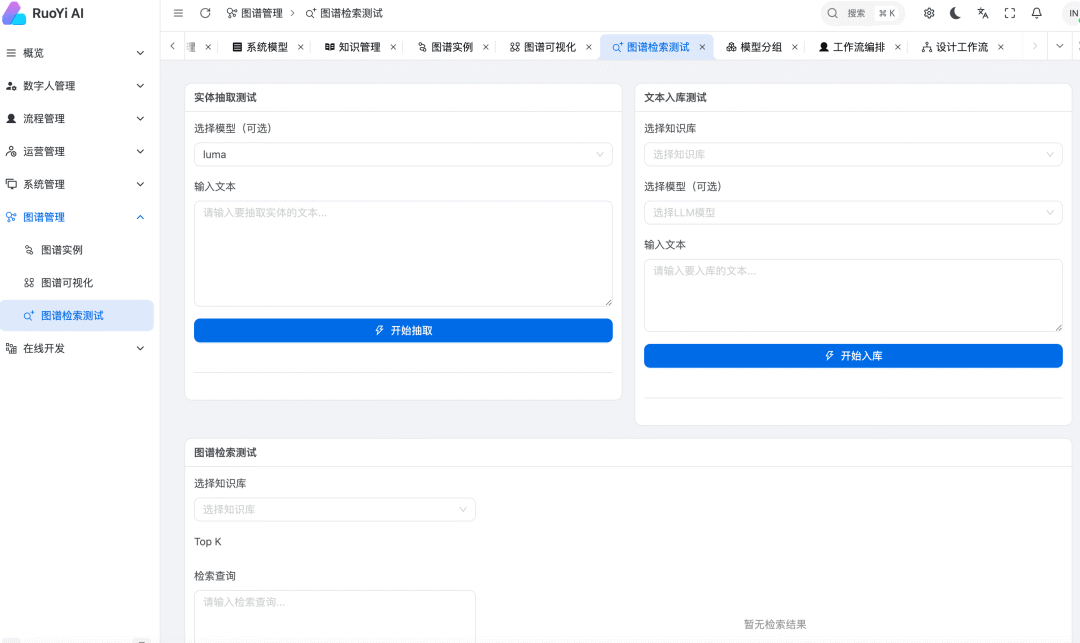

- 🎛️ RuoYi 全栈 AI 平台开源![^38]

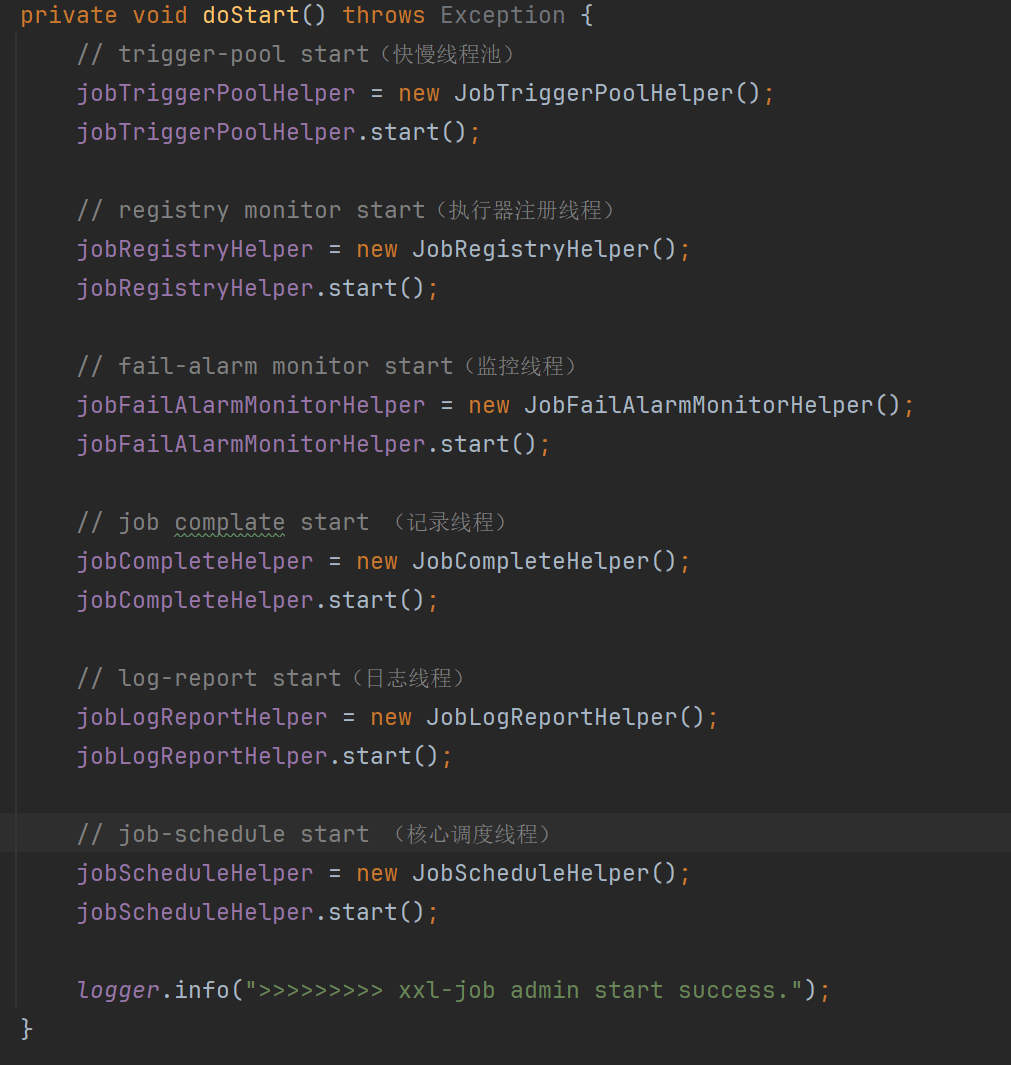

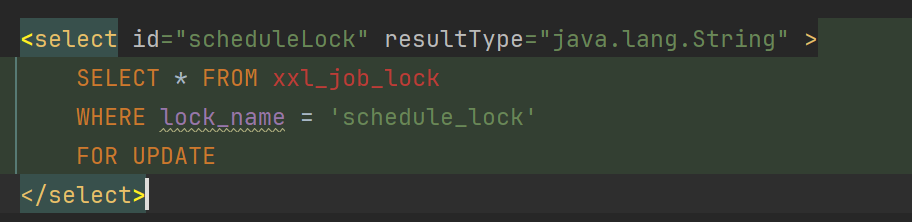

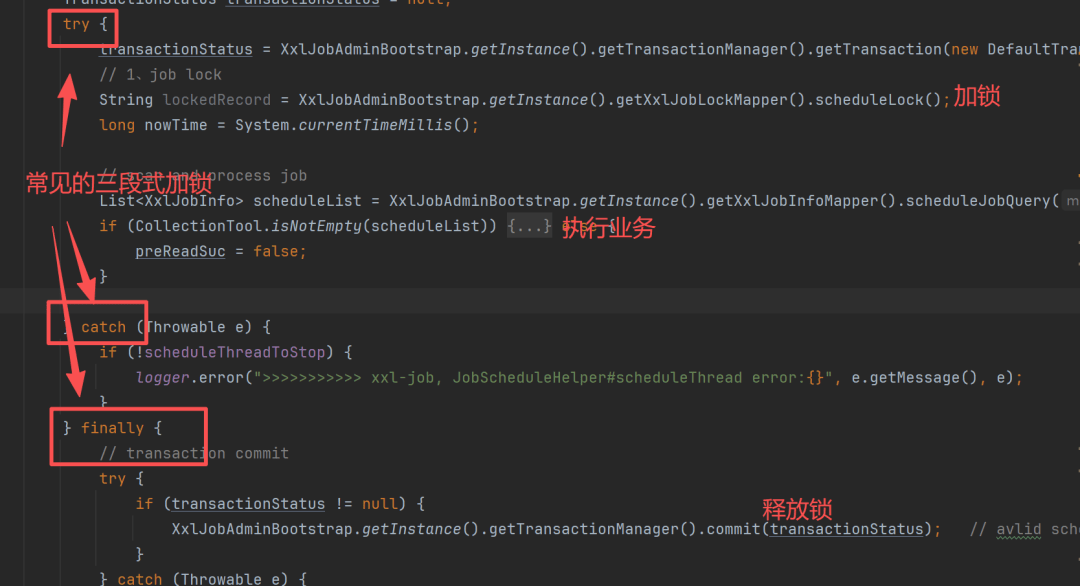

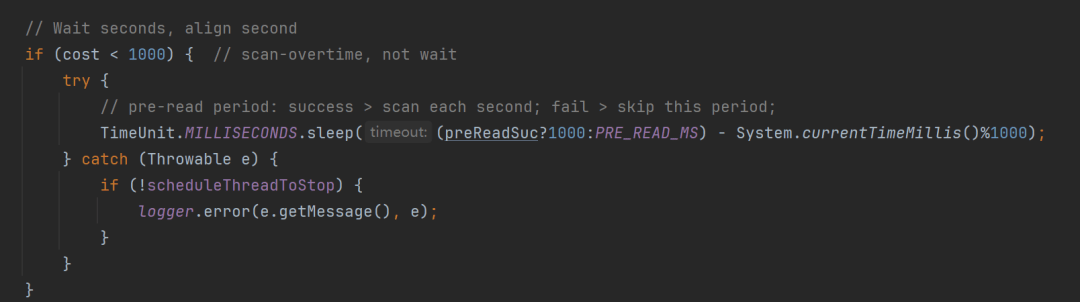

- 📄 大白话说清楚xxl-job底层定时调度的原理[^39]

02/24 | 安全 & 面试

- 🩱 干掉 Vite ?Vize ?[^26]

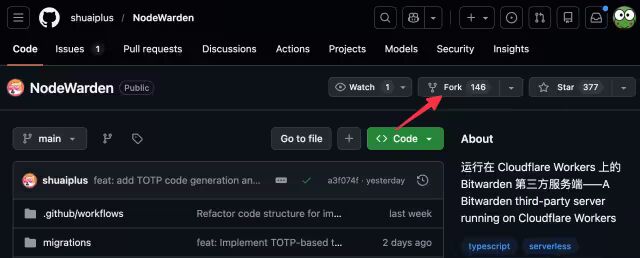

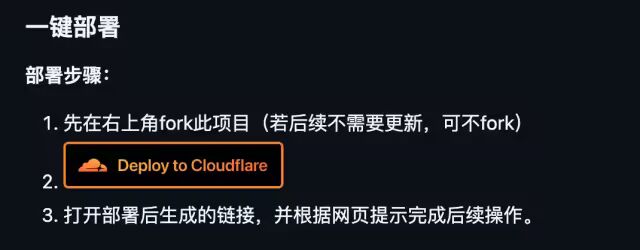

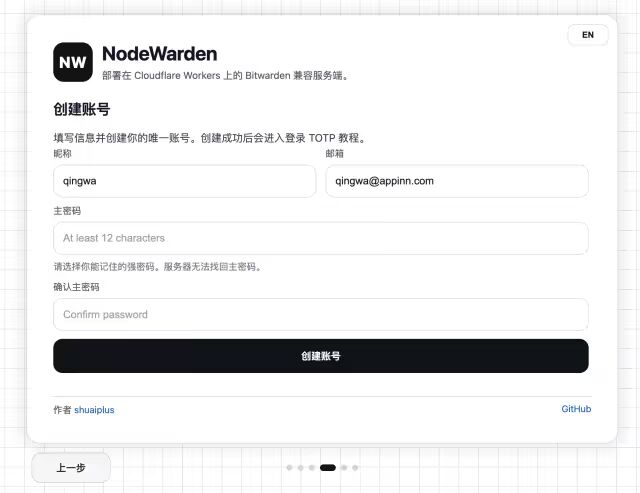

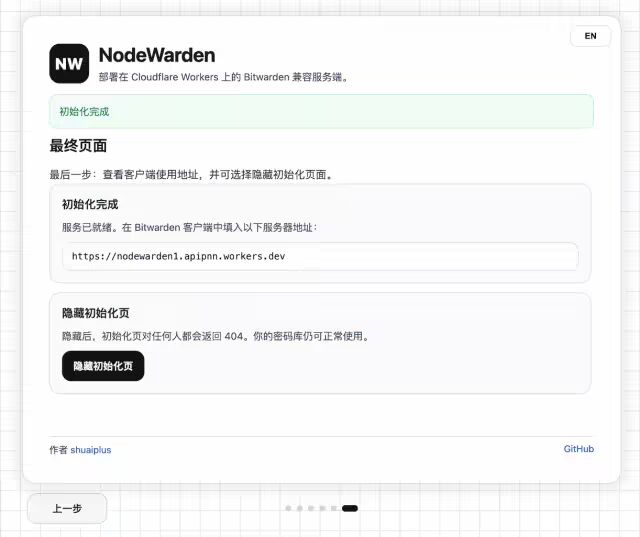

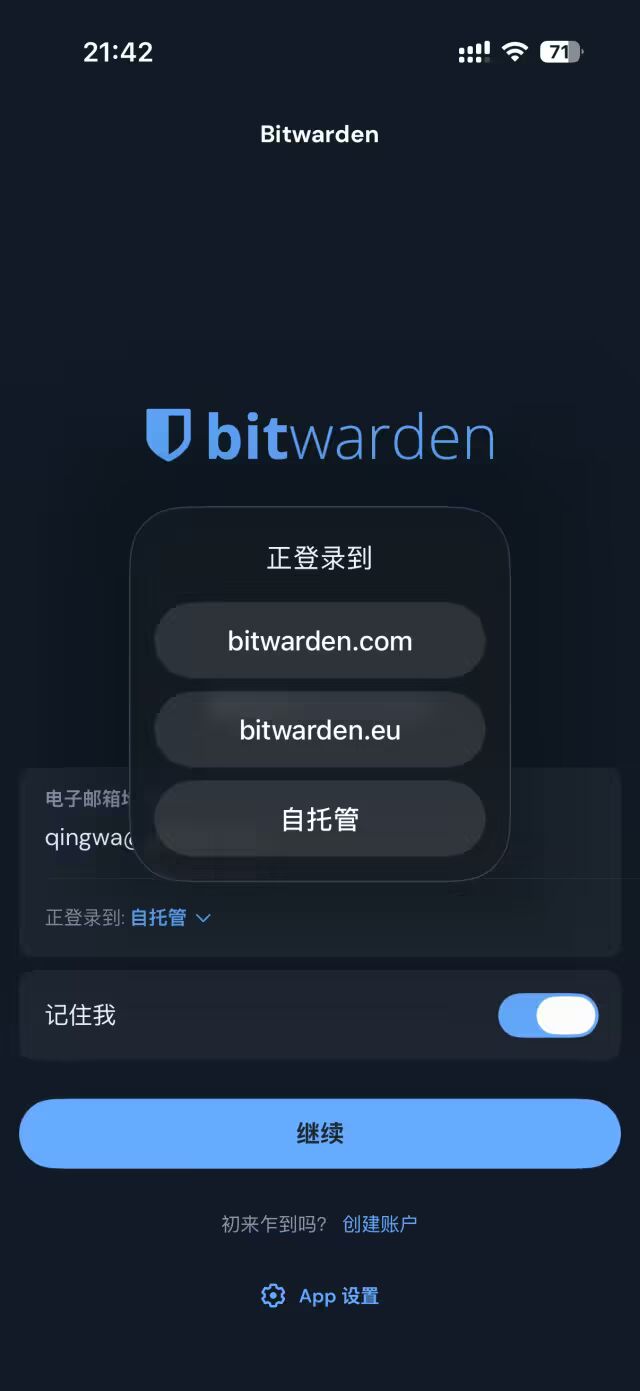

- 📄 Bitwarden 跑在 Cloudflare 上!自托管密码管理器[^40]

- 🥑 一篇 Markdown,自动生成封面、信息图、小红书风格[^41]

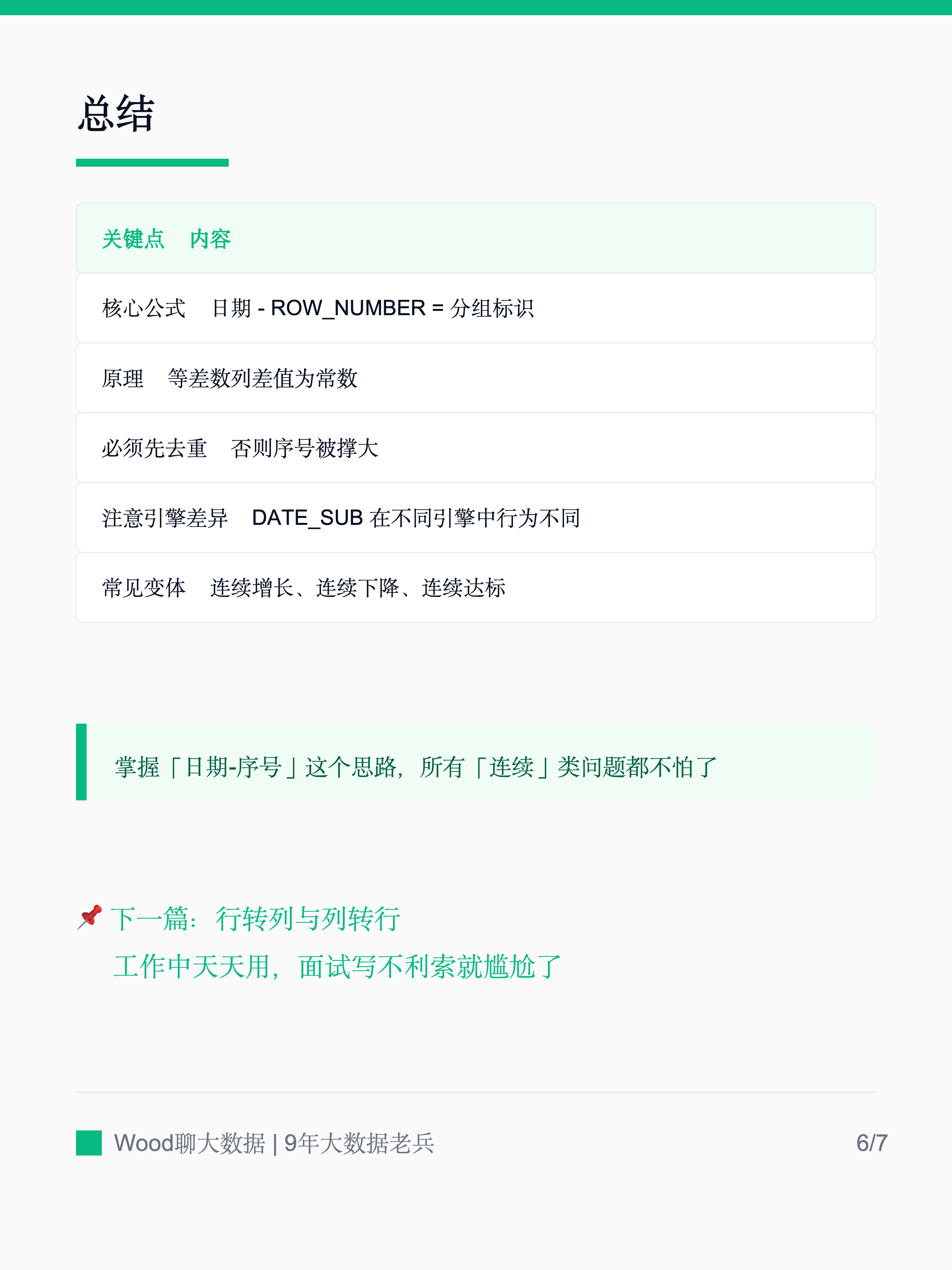

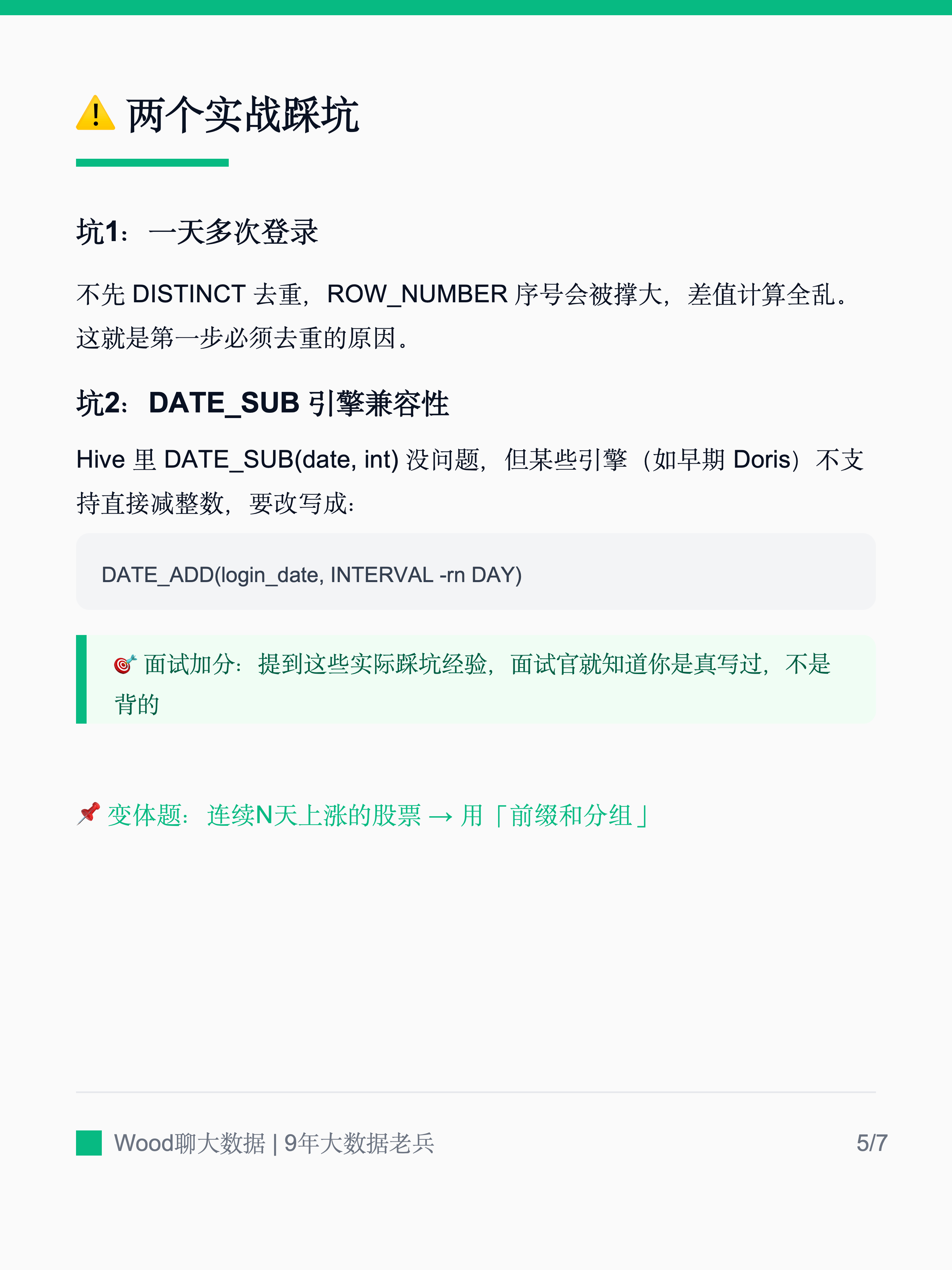

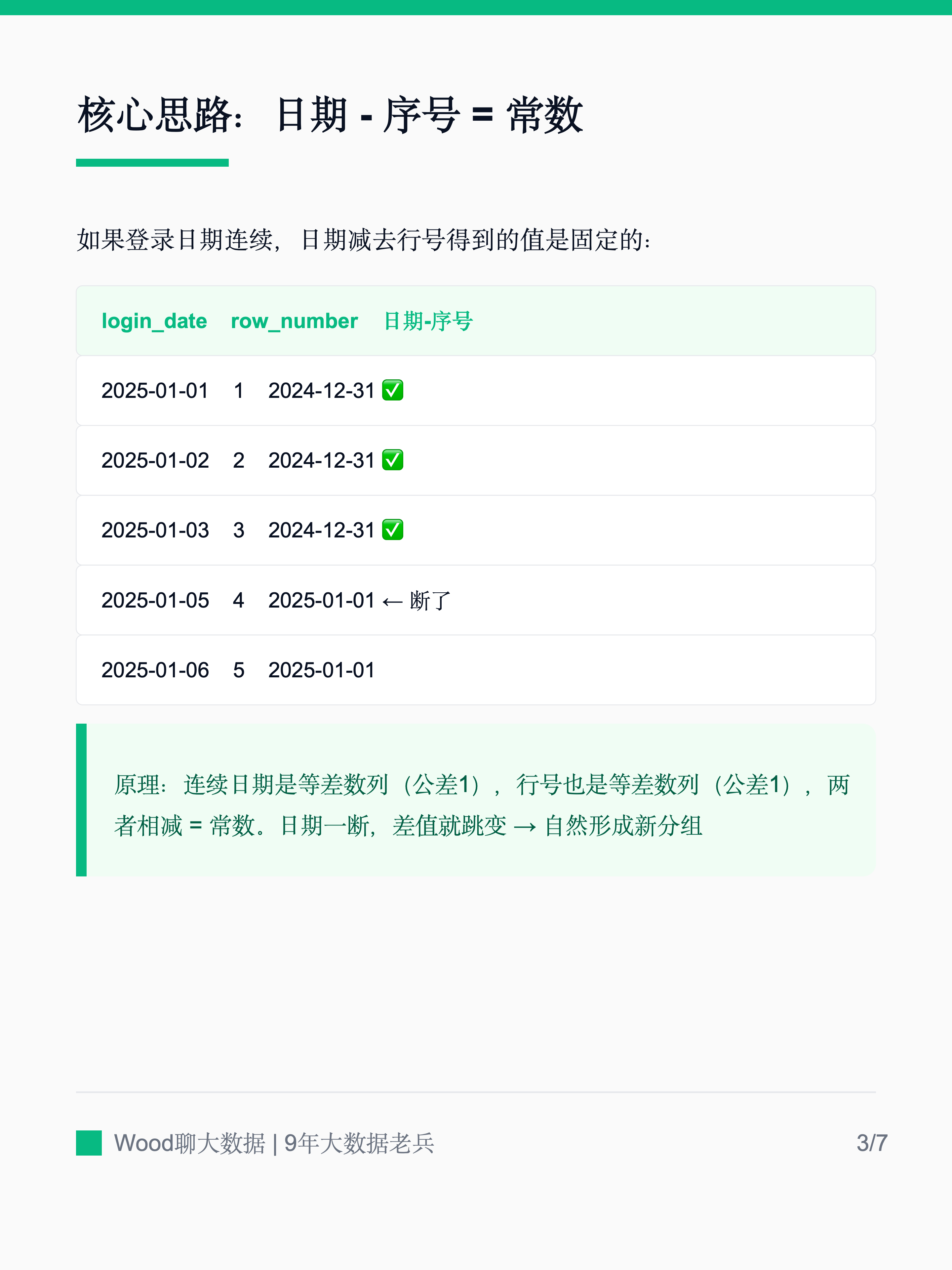

- 📄 SQL面试题:怎么查连续登录N天的用户?[^42]

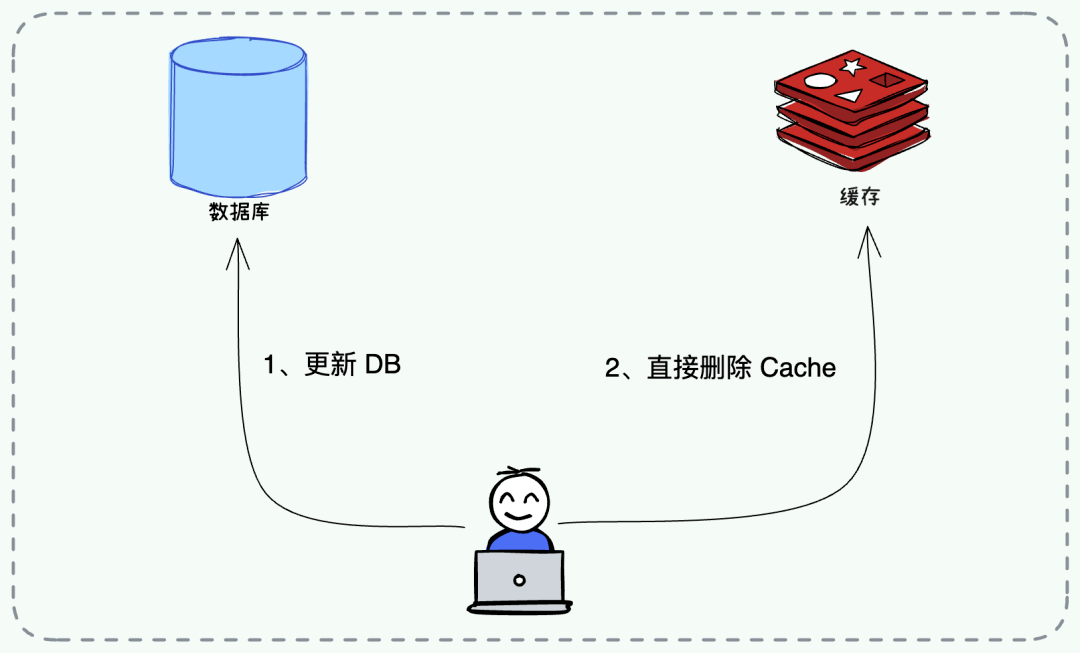

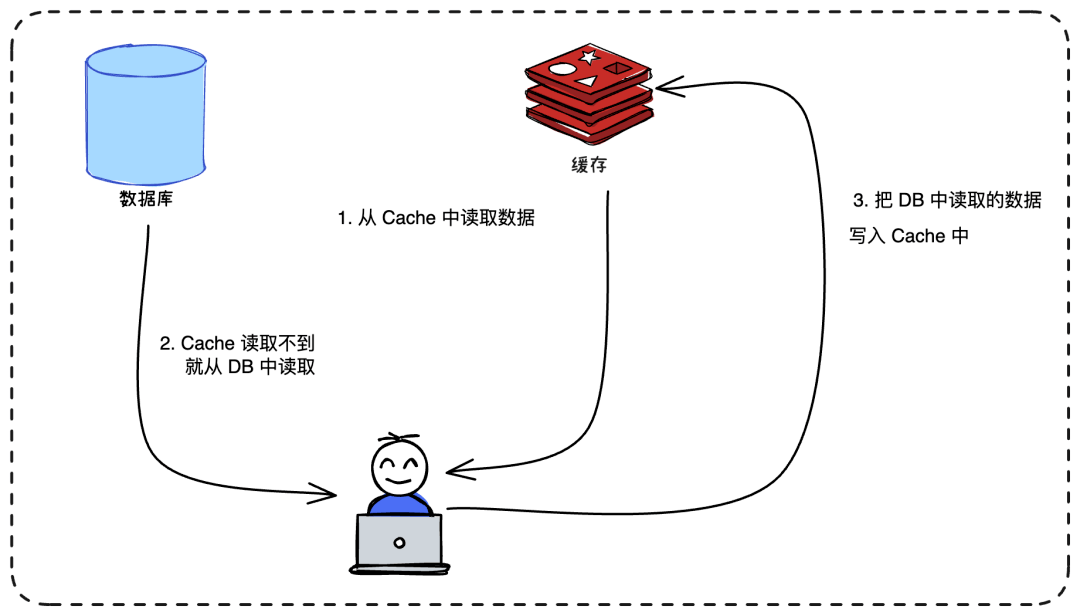

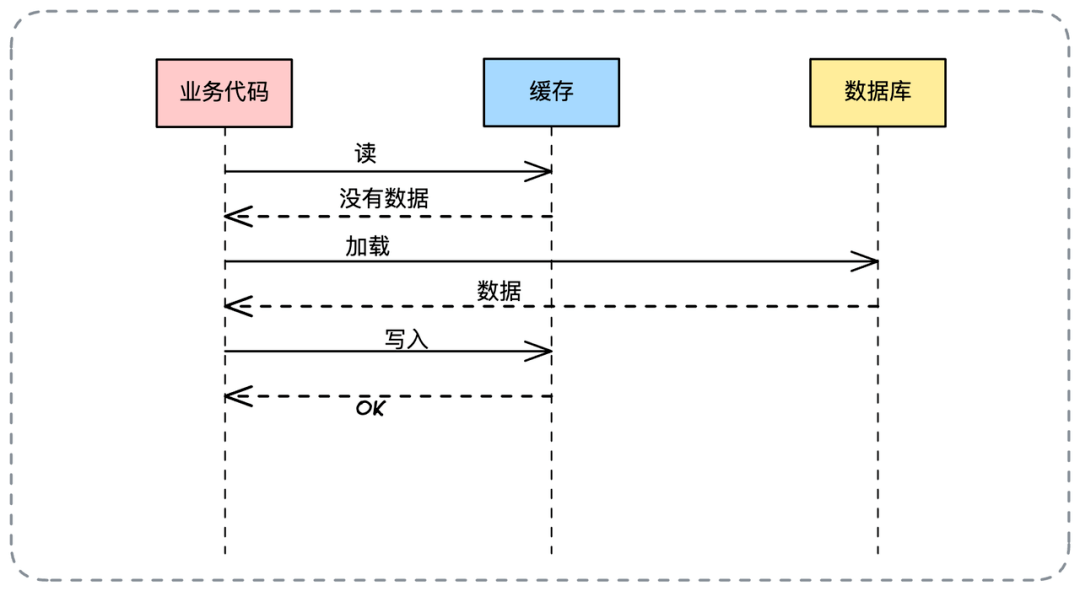

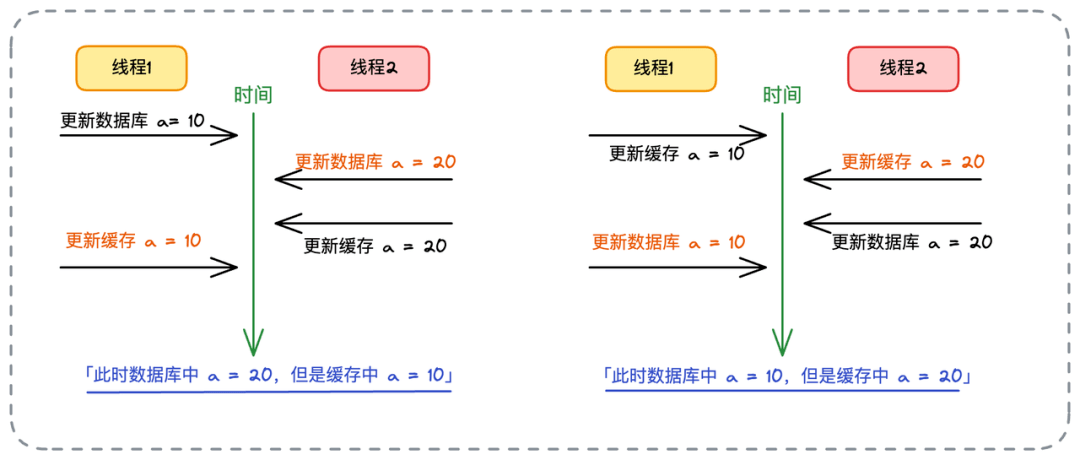

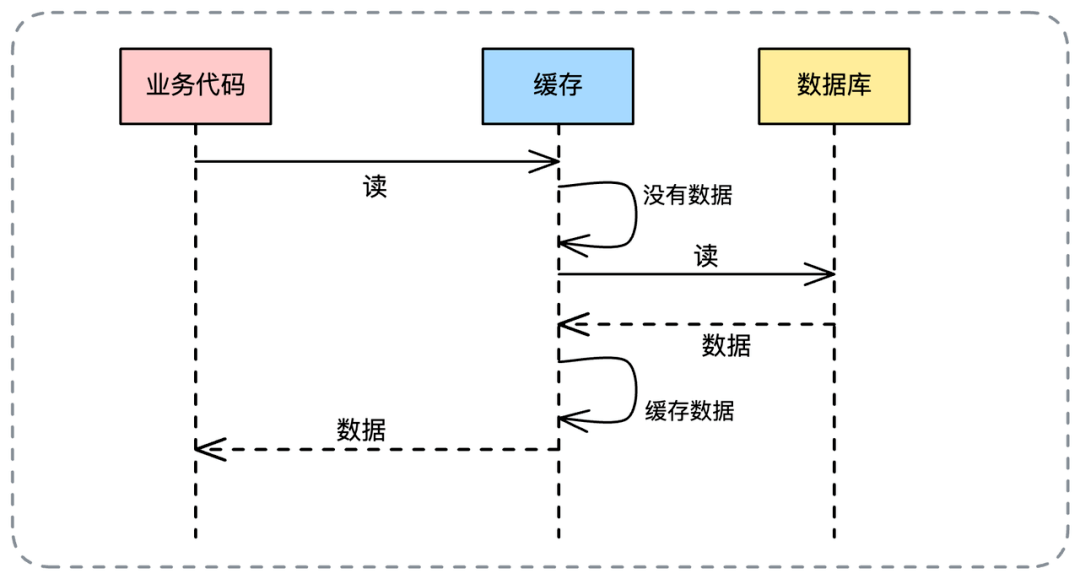

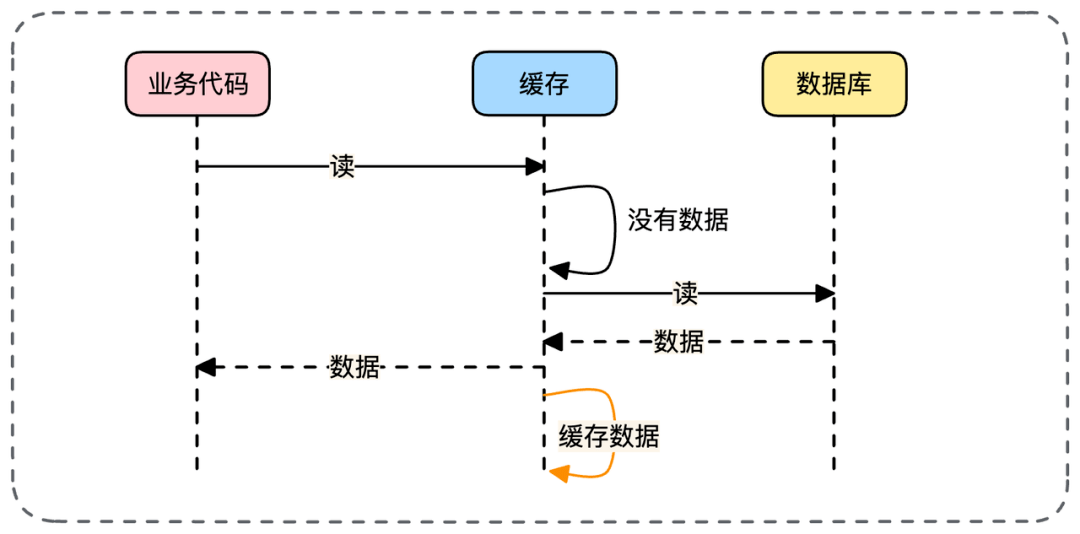

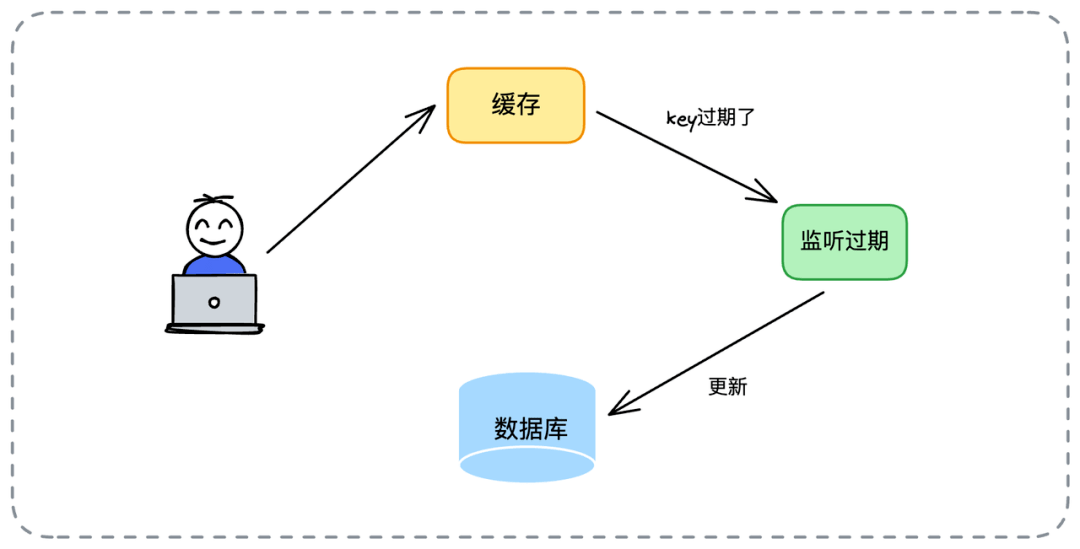

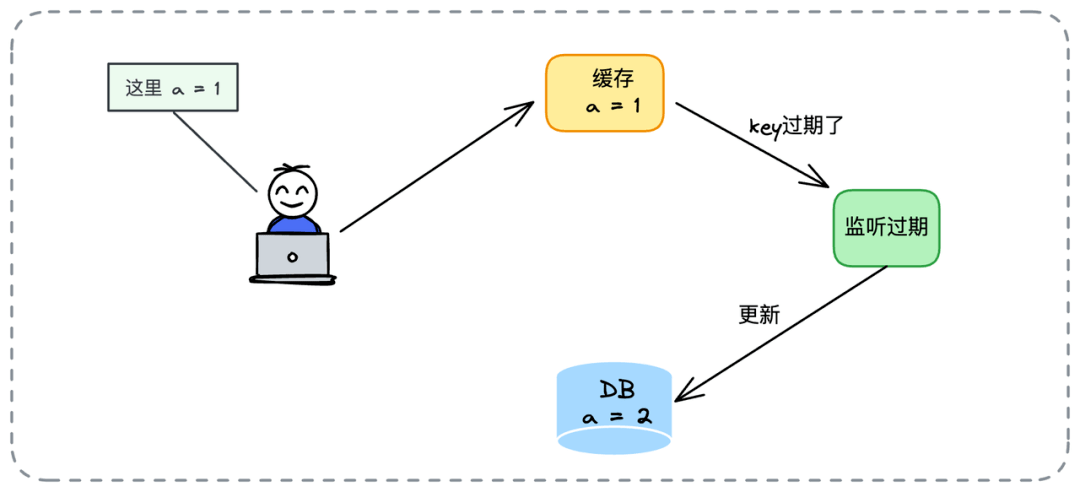

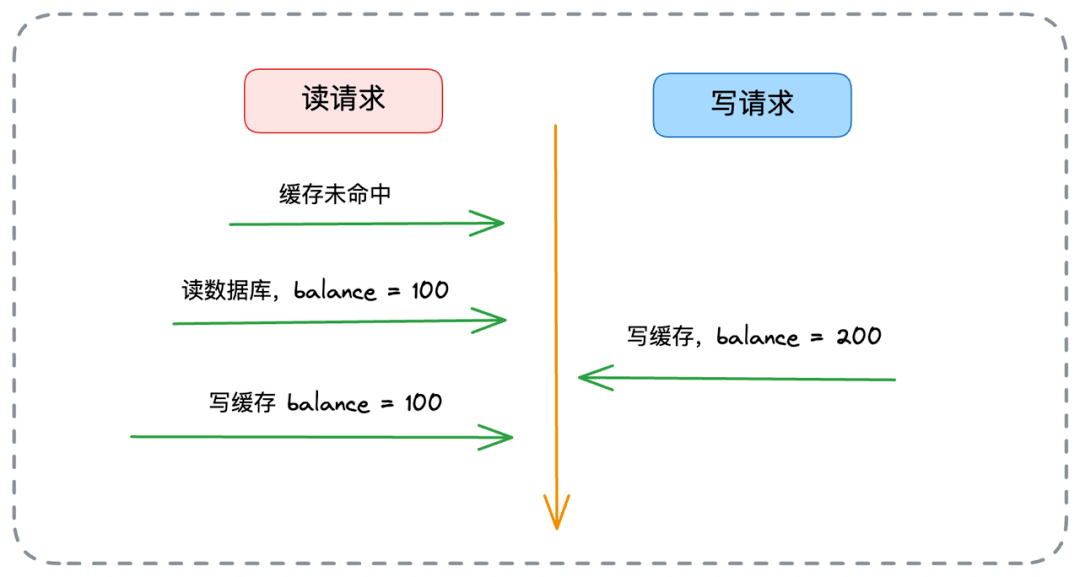

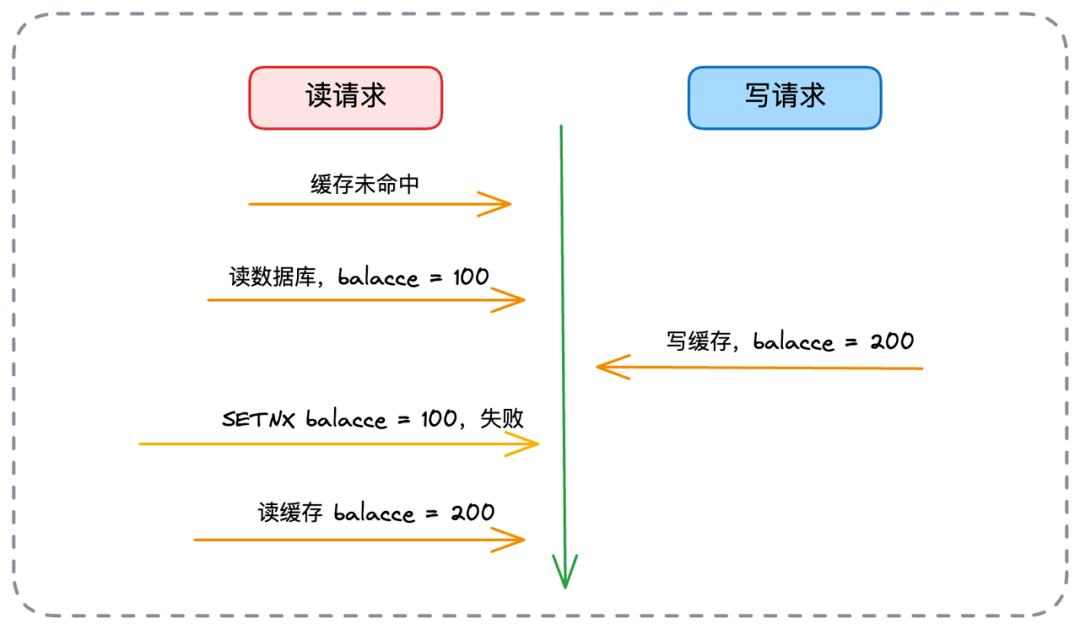

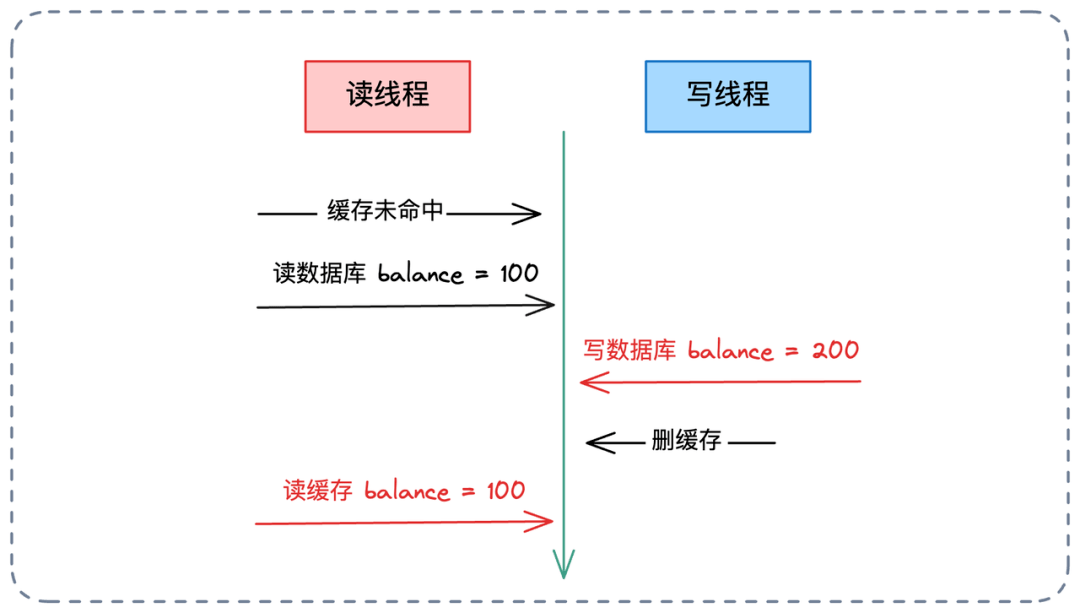

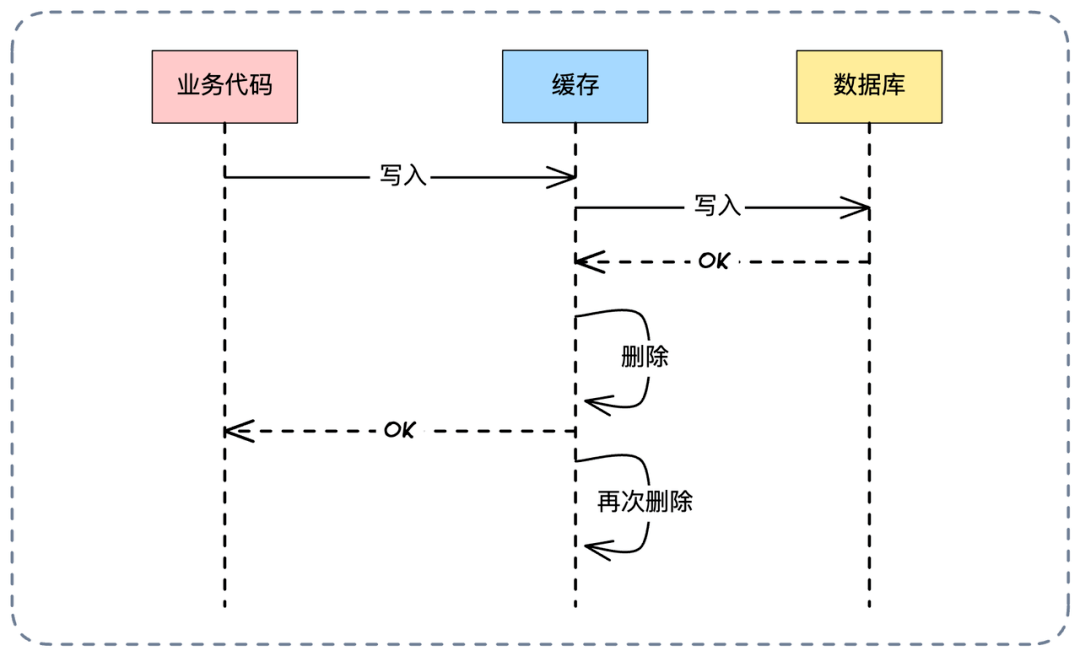

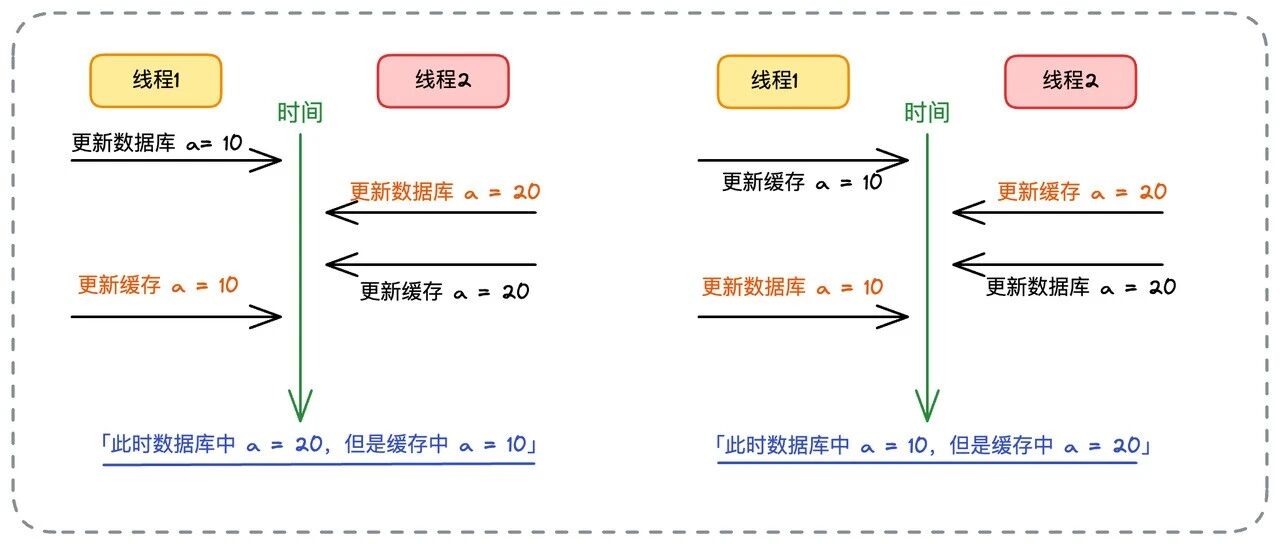

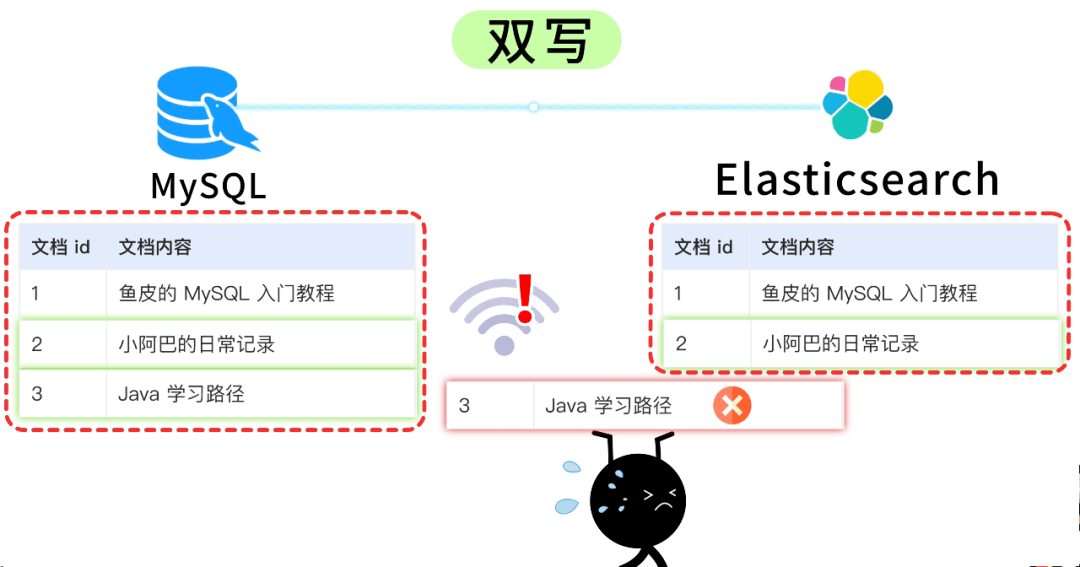

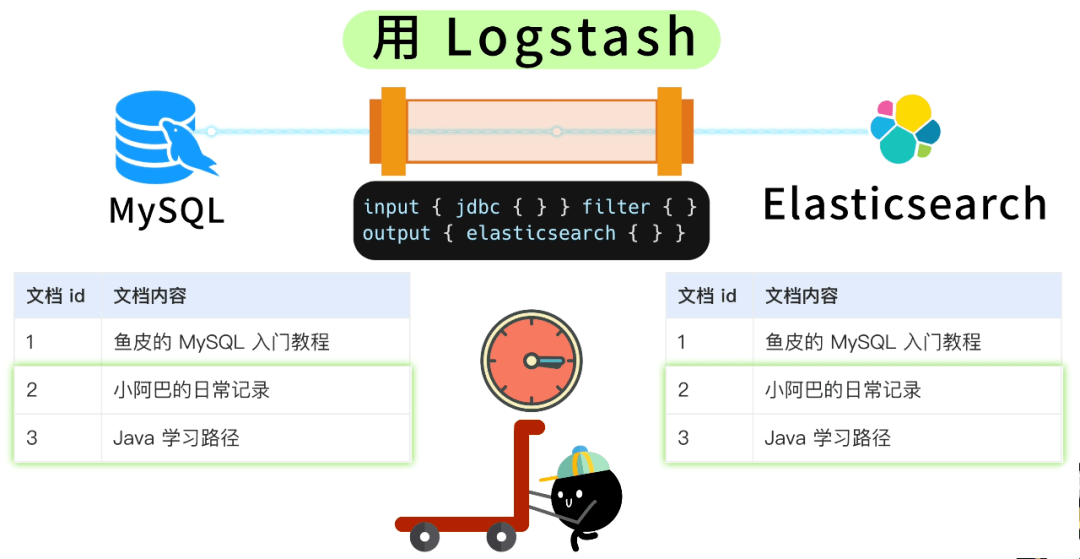

- 📄 面试官:项目中你是采用哪种缓存模式来解决数据一致性问题的?[^43]

- 📄 盘点 3 个 AI Agent 相关神级 GitHub 开源项目[^44]

02/25 | 全栈开发

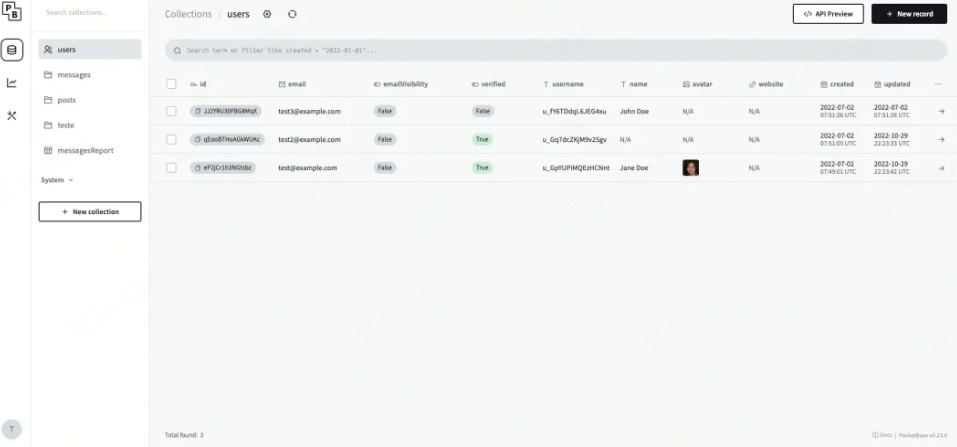

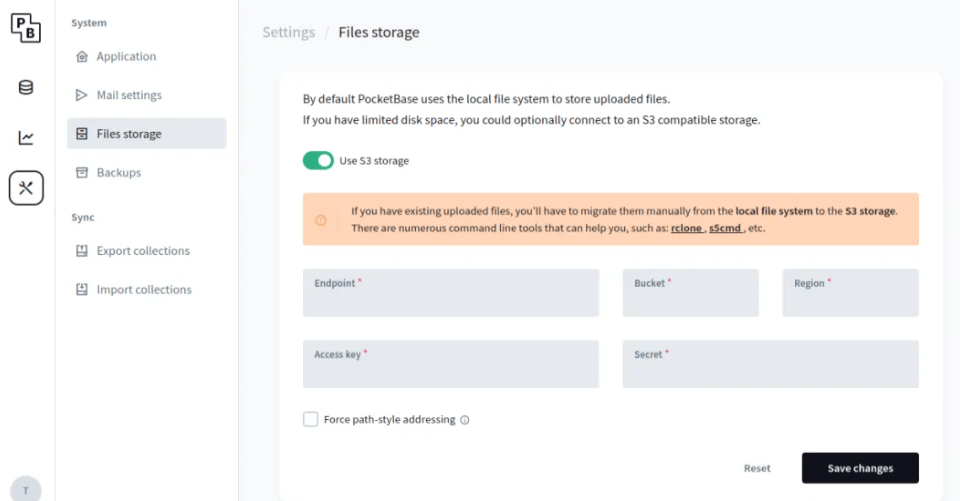

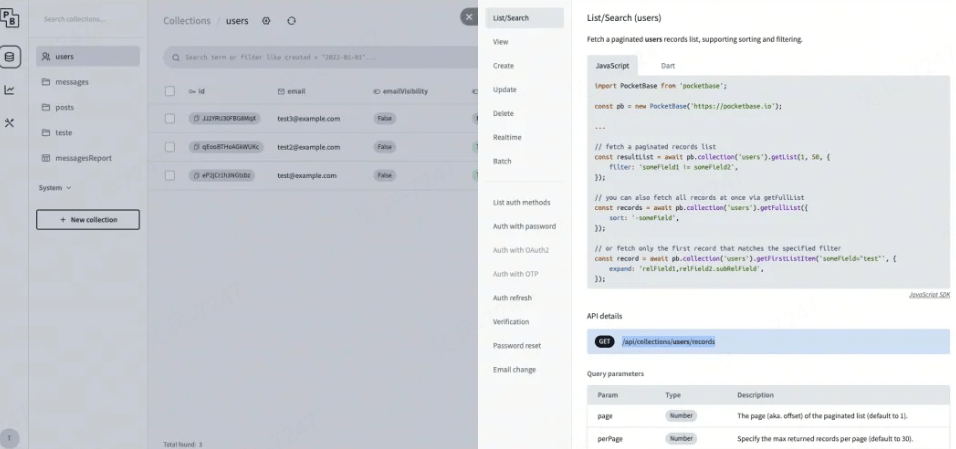

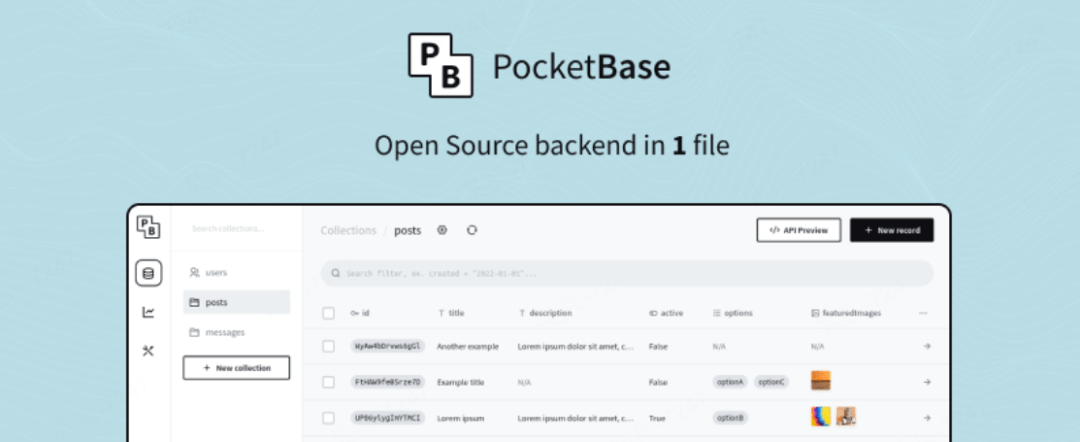

- 🪮 GitHub 55k Star!仅需一个文件,10分钟上线全功能后端[^45]

02/26 | AI编程

- 🫓 OpenCode 中文教程 - AI 编程助手实战指南[^46]

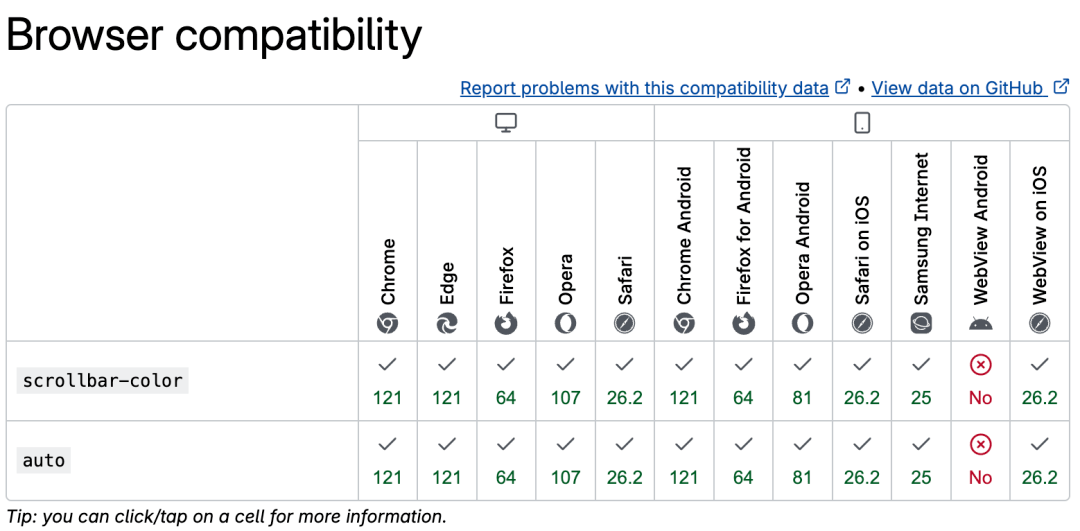

- 🌦️ 前端最丑的 UI 组件,Chrome 痛下杀手![^47]

- 🫑 稳如老狗、节省成本的 AI 编程工作流实战指南[^48]

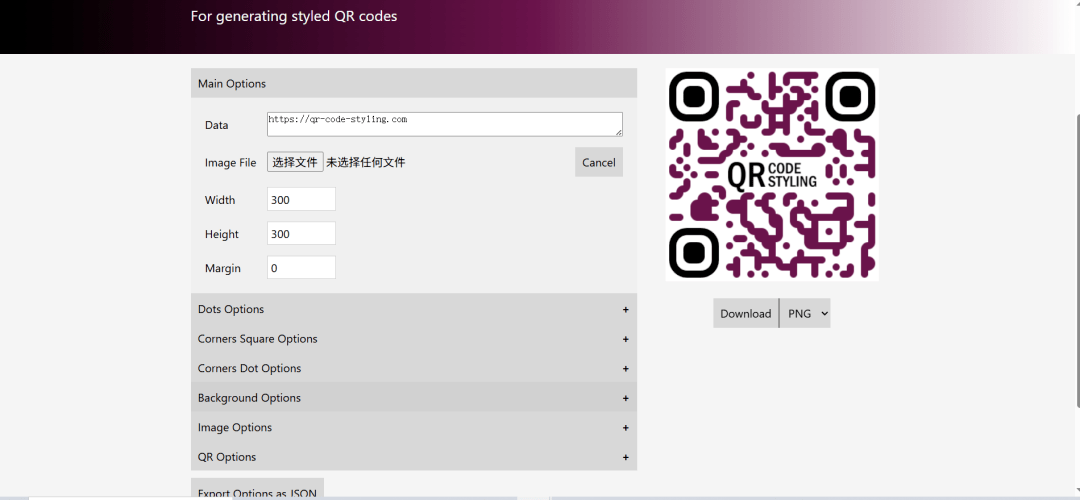

02/28 | Vue二维码

- 🎫 快速实现 Vue3 二维码生成:qrcode-vue3 使用指南[^49]

📅 3月

03/02 | 热点解析

- 🥛 深度解析:时薪48美元的赛博苦力,马斯克为何让AI洗碗?[^50]

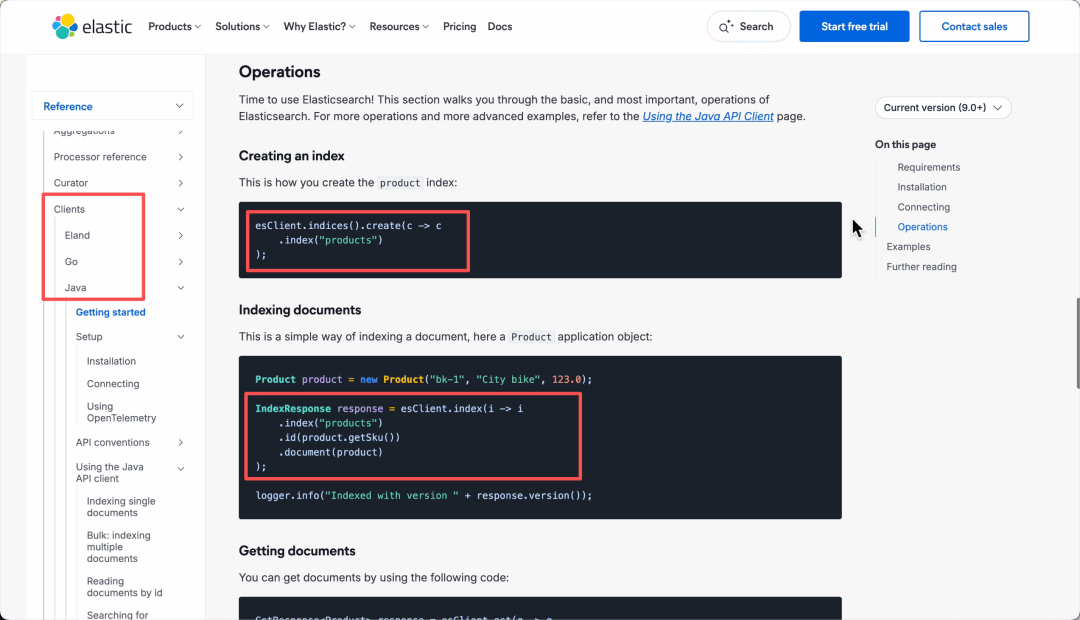

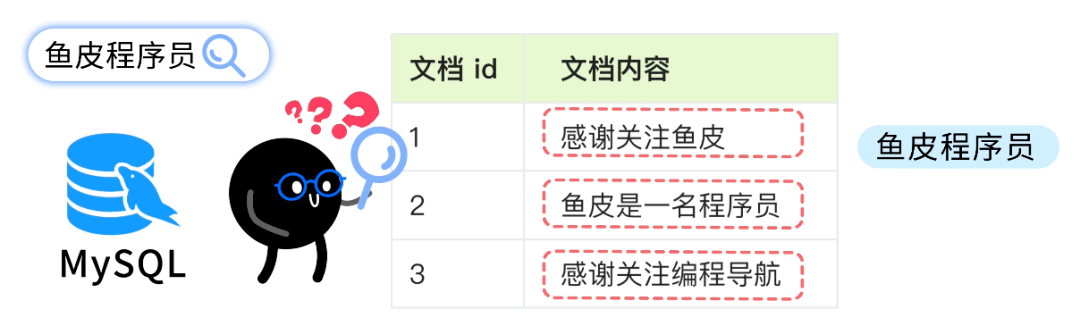

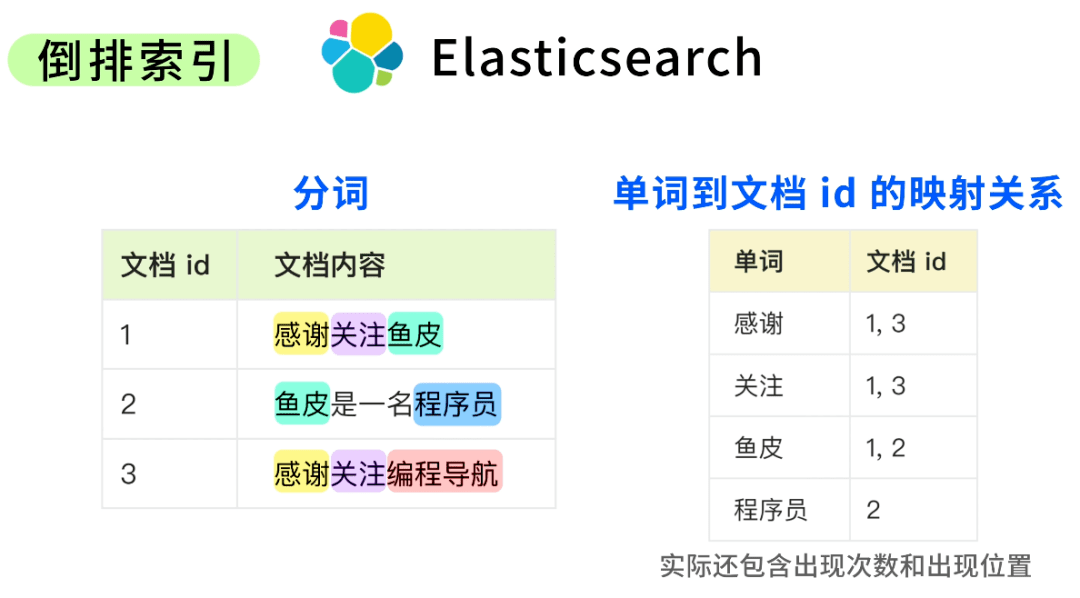

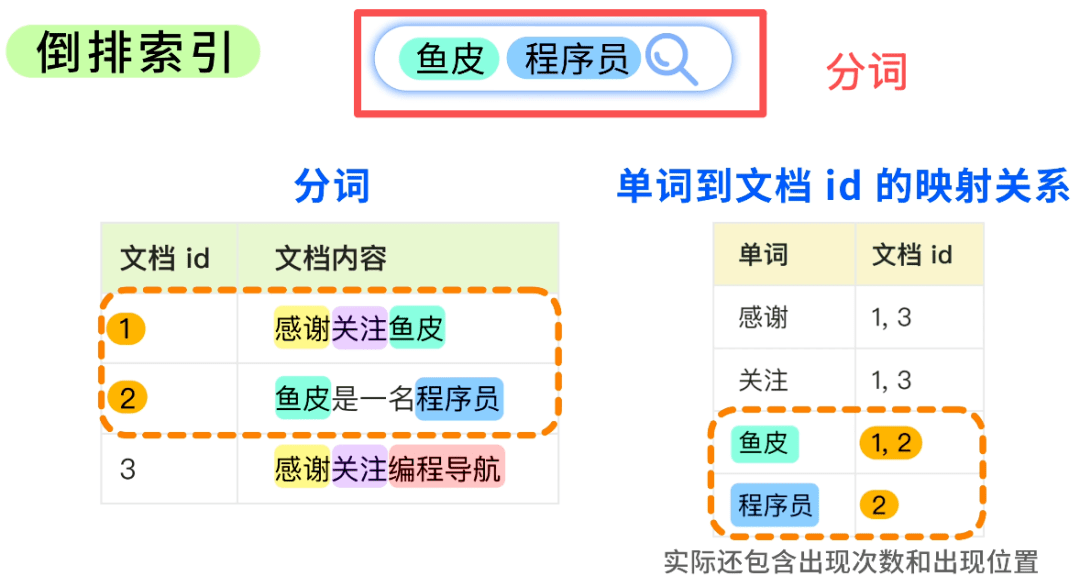

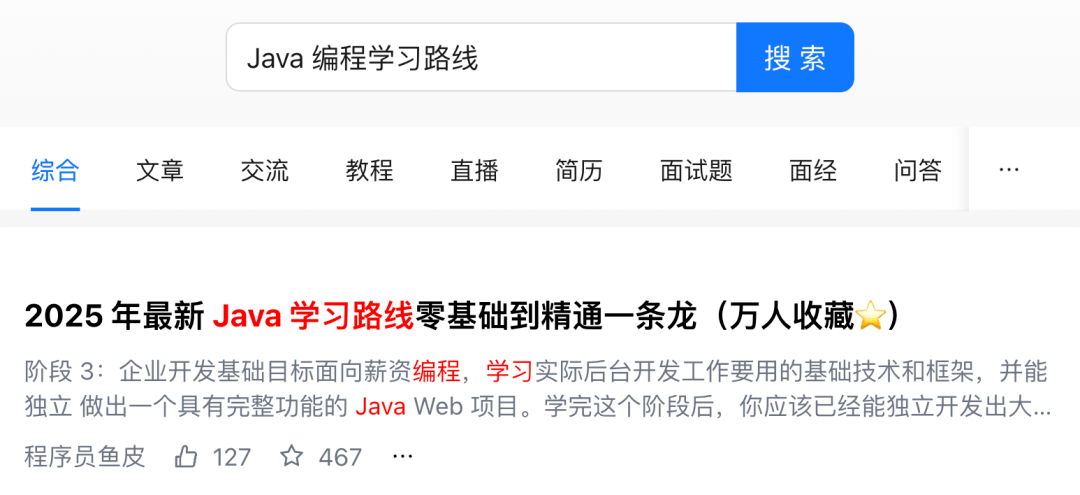

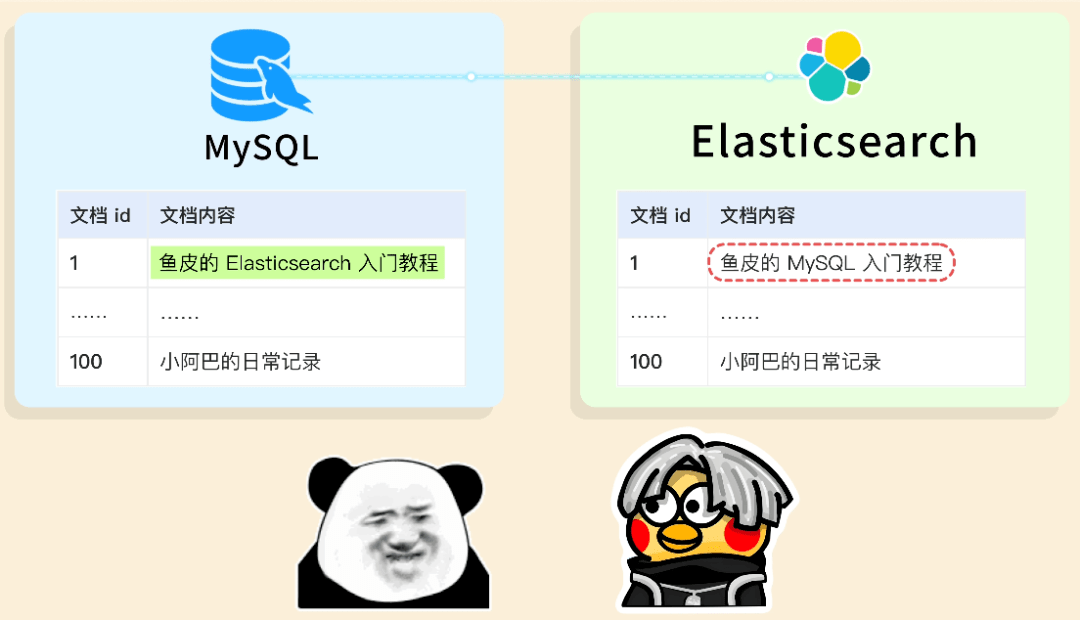

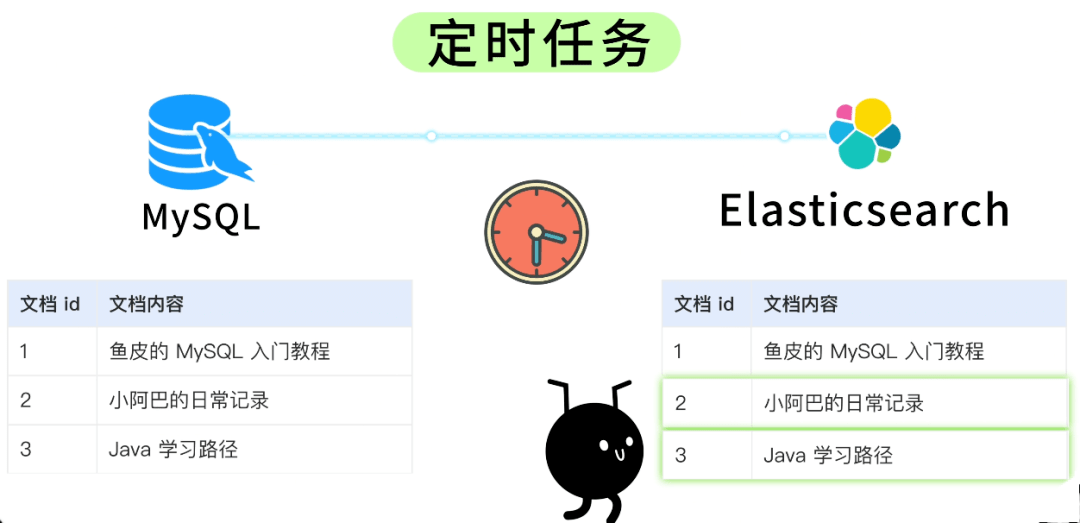

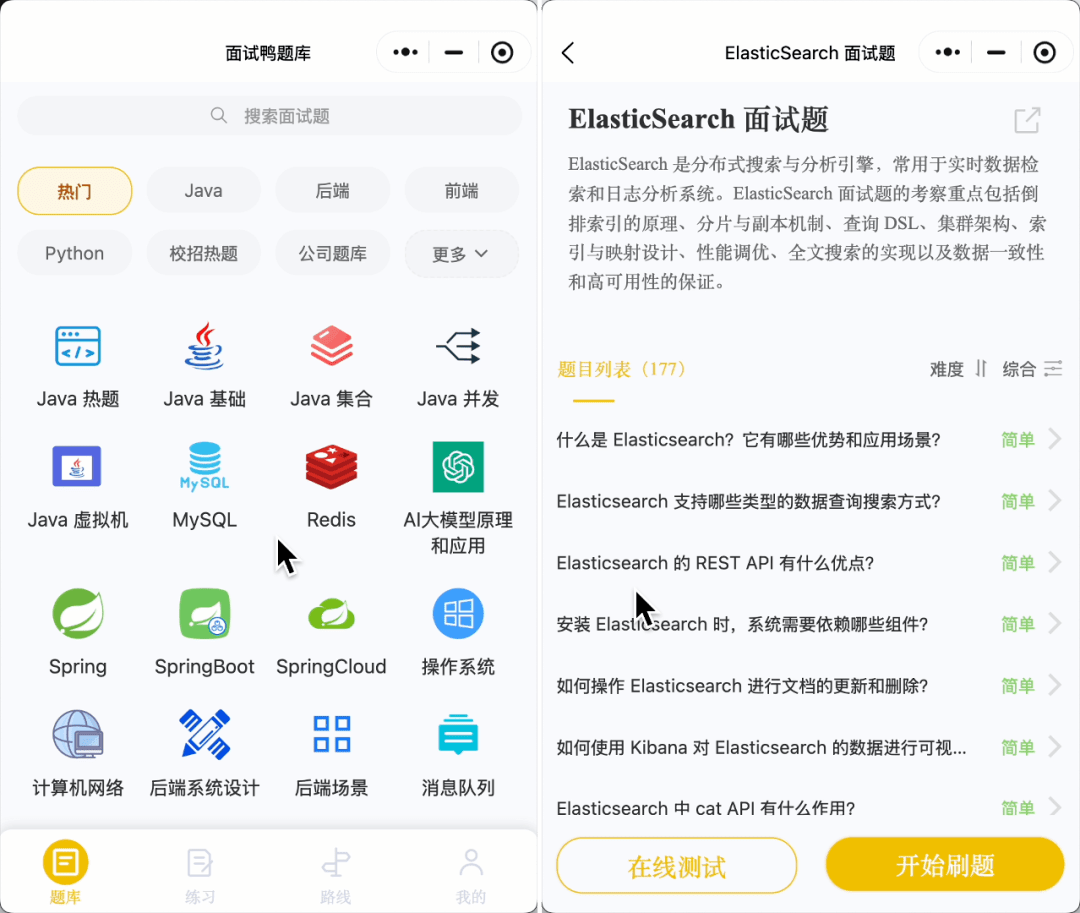

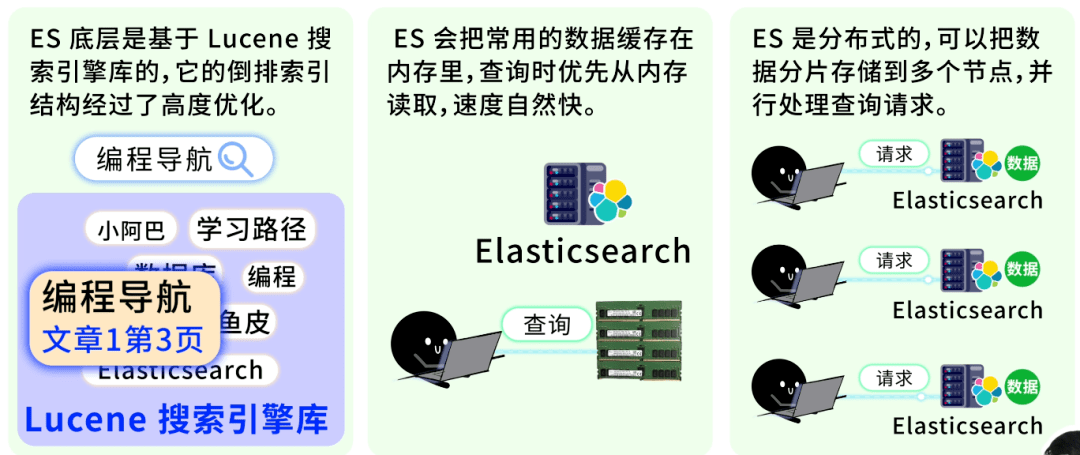

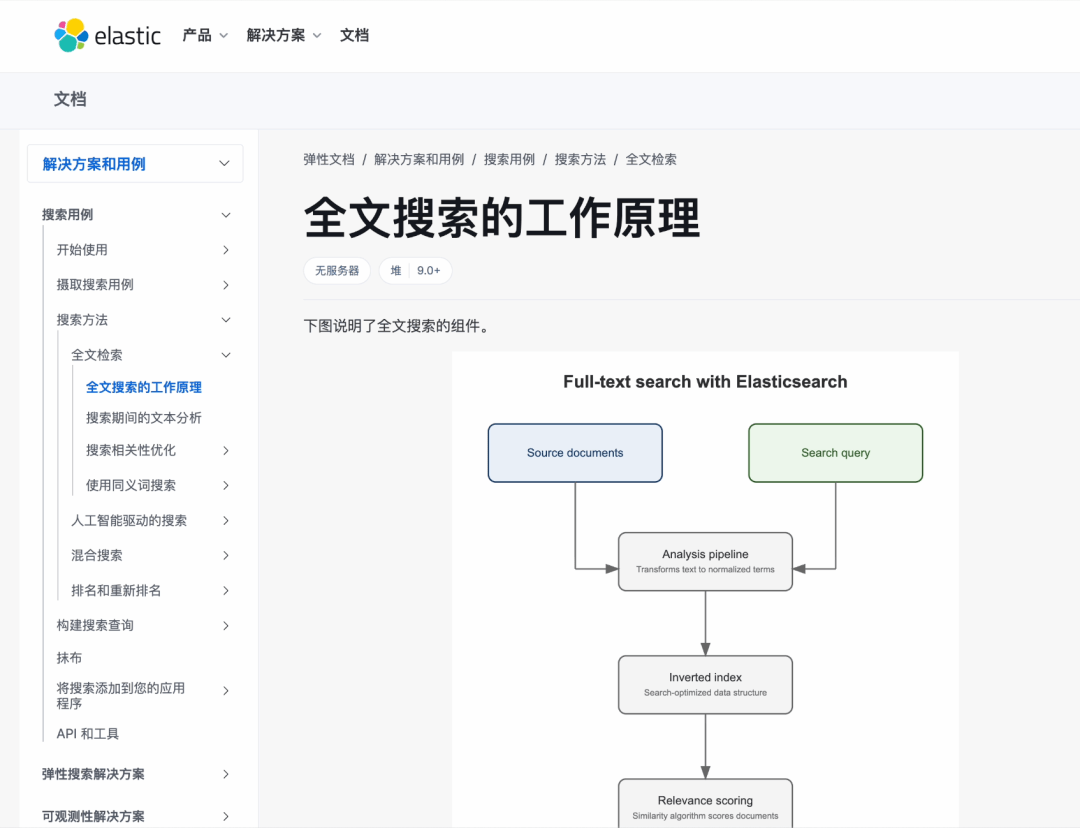

- 🐇 老板让我做搜索功能:"一句 SQL 不就搞定了?" 结果...[^51]

03/03 | AI & Chart

- ♥️ ChartGPU 重磅发布!WebGPU 版的 ECharts[^52]

- 📄 OpenClaw从新手到中级完整教程[^53]

03/05 | AI创作

- 🦨 Nano Banana 2 的 16 个邪修玩法[^54]

03/06 | 人生哲学

- 👡 在动荡时代构建内在结界:斯多葛哲学的实用指南[^55]

03/12 | 思维认知

- 🛷 别被成功学误导:从幸存者偏差到全样本思维[^56]

03/14 | 成长心态

- 🏍️ 求你了,别再对自己搞"意志力霸凌"了[^57]

- 🎊 为什么越努力,越快失败?——大脑戒备、活化能与微习惯的科学解答[^58]

03/20 | 运维存储

- 🌑 运维工程师必存!存储知识,万字全解![^59]

03/25 | AI办公 & Agent

- 🦡 MiniMax Office Skills:开源一套生产级办公文档引擎[^60]

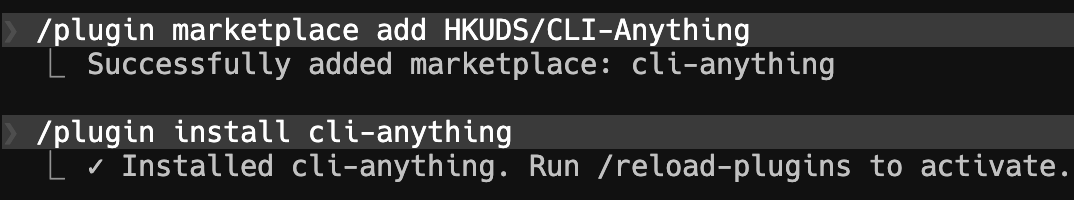

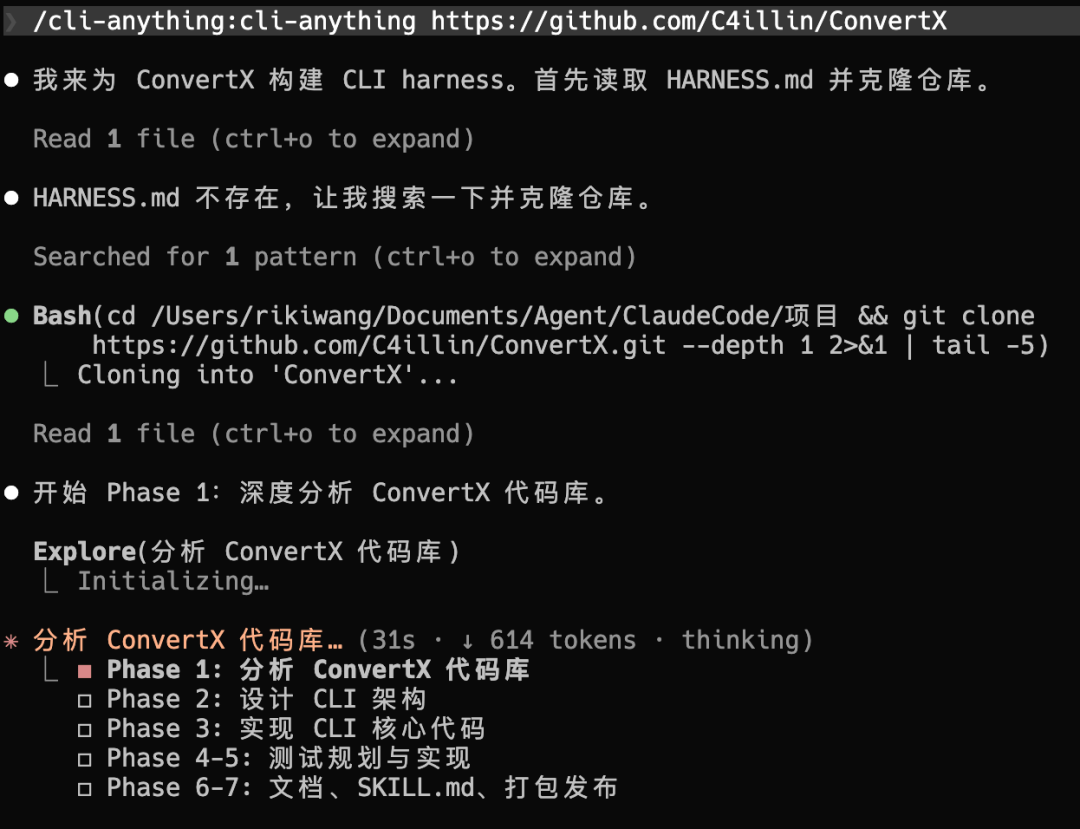

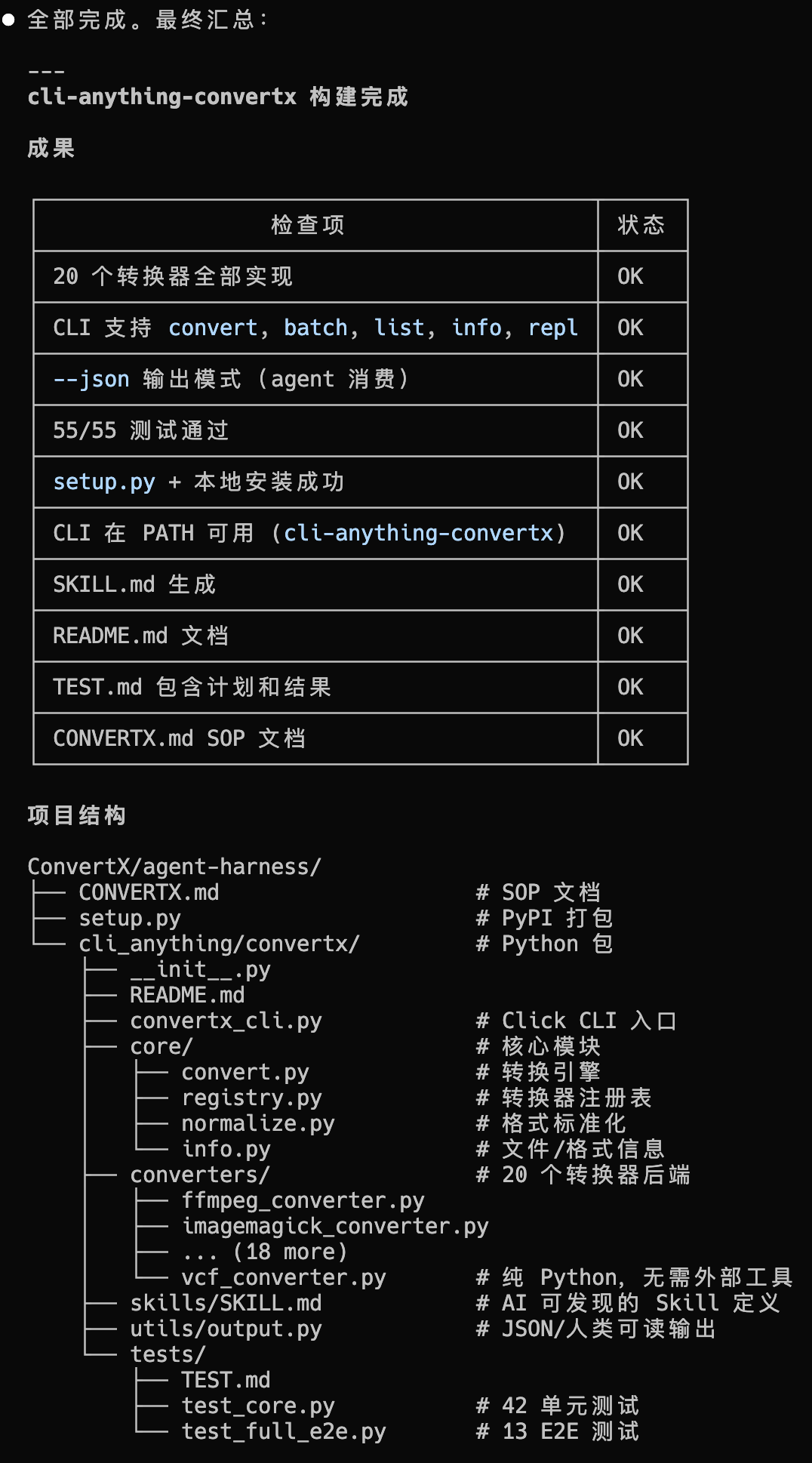

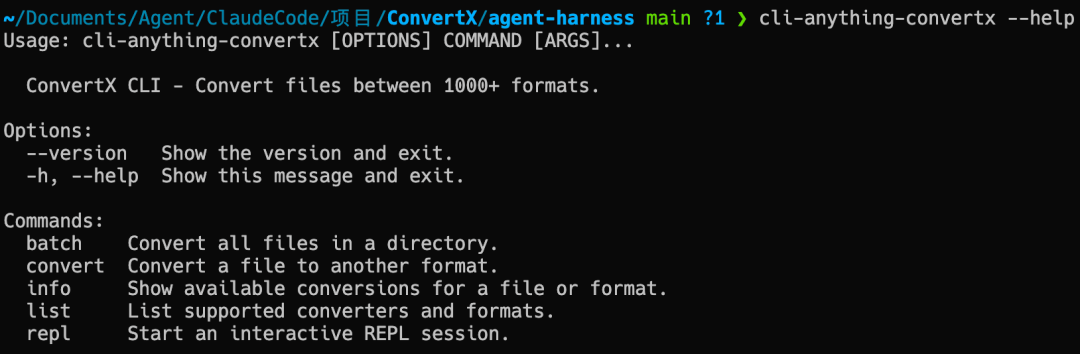

- 🥭 一条命令让 AI Agent 接管任何软件,港大开源 CLI-Anything[^61]

[!Note] 更新日志

- 2026.02 创建文档,收录 2 月份优质资源

- 2026.03 持续更新中...

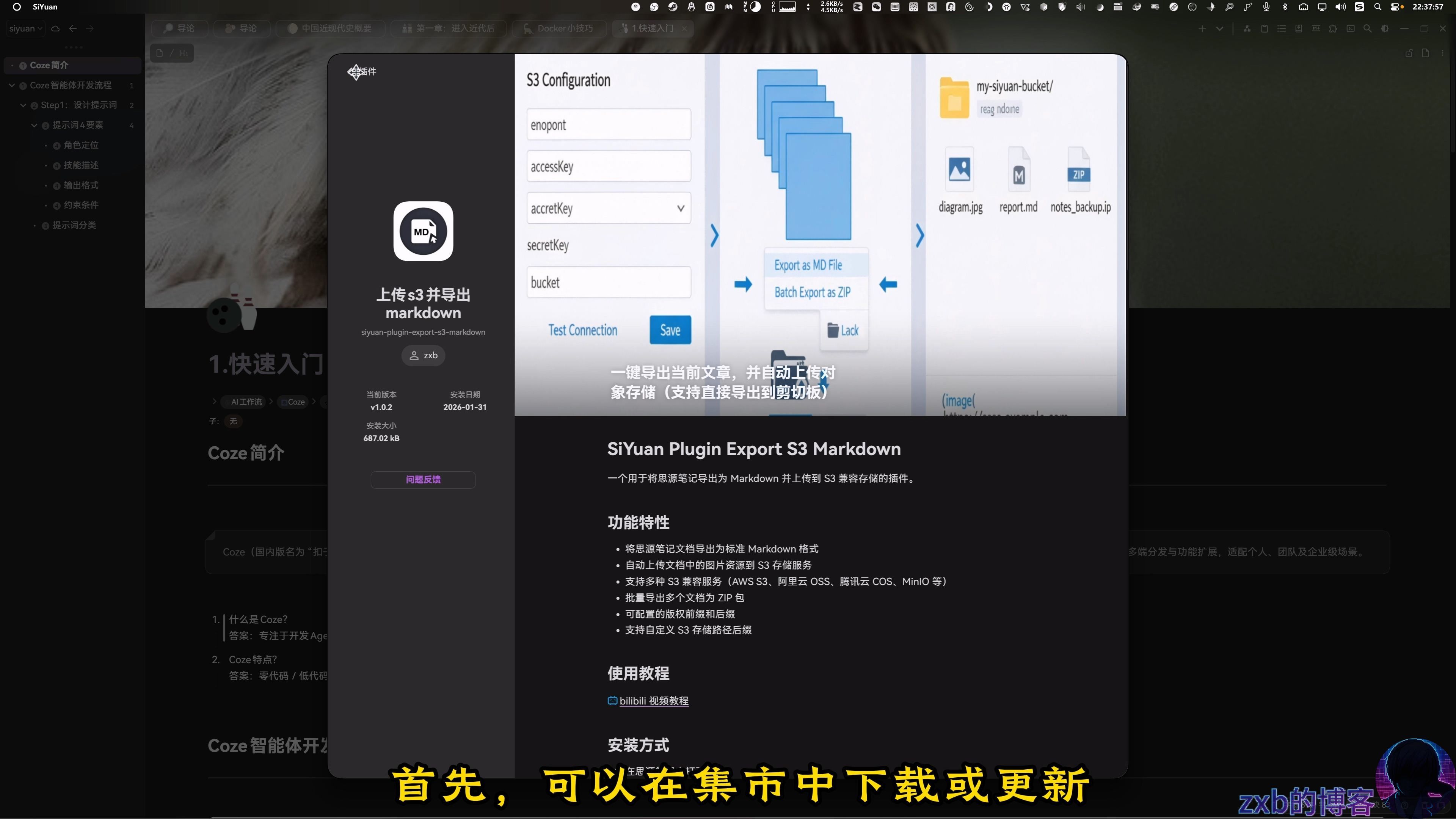

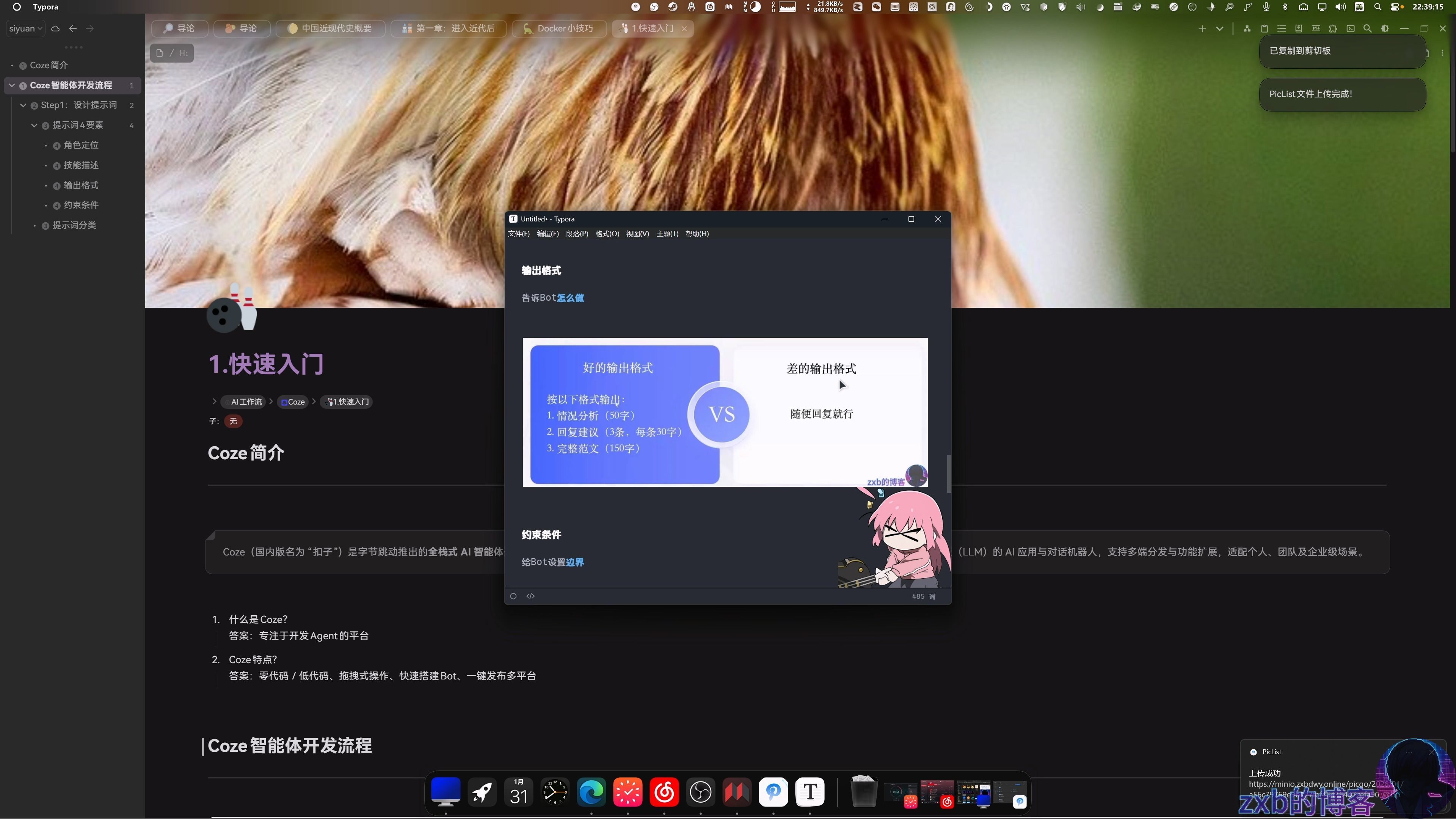

[^1]: # 🚀 思源笔记 S3 插件 v1.0.2 更新:手把手教你配置 PicList 导出

# 思源笔记 S3 插件 v1.0.2 更新:配置 PicList 导出

本次更新最大的亮点是**加入了对 PicList 的支持**,让图床上传更加稳健。

---

## 1️⃣ 插件更新

进入思源笔记**集市**,搜索 **“S3”** ,找到“上传到 S3 并导出 Markdown”插件,更新至 **v1.0.2**。

---

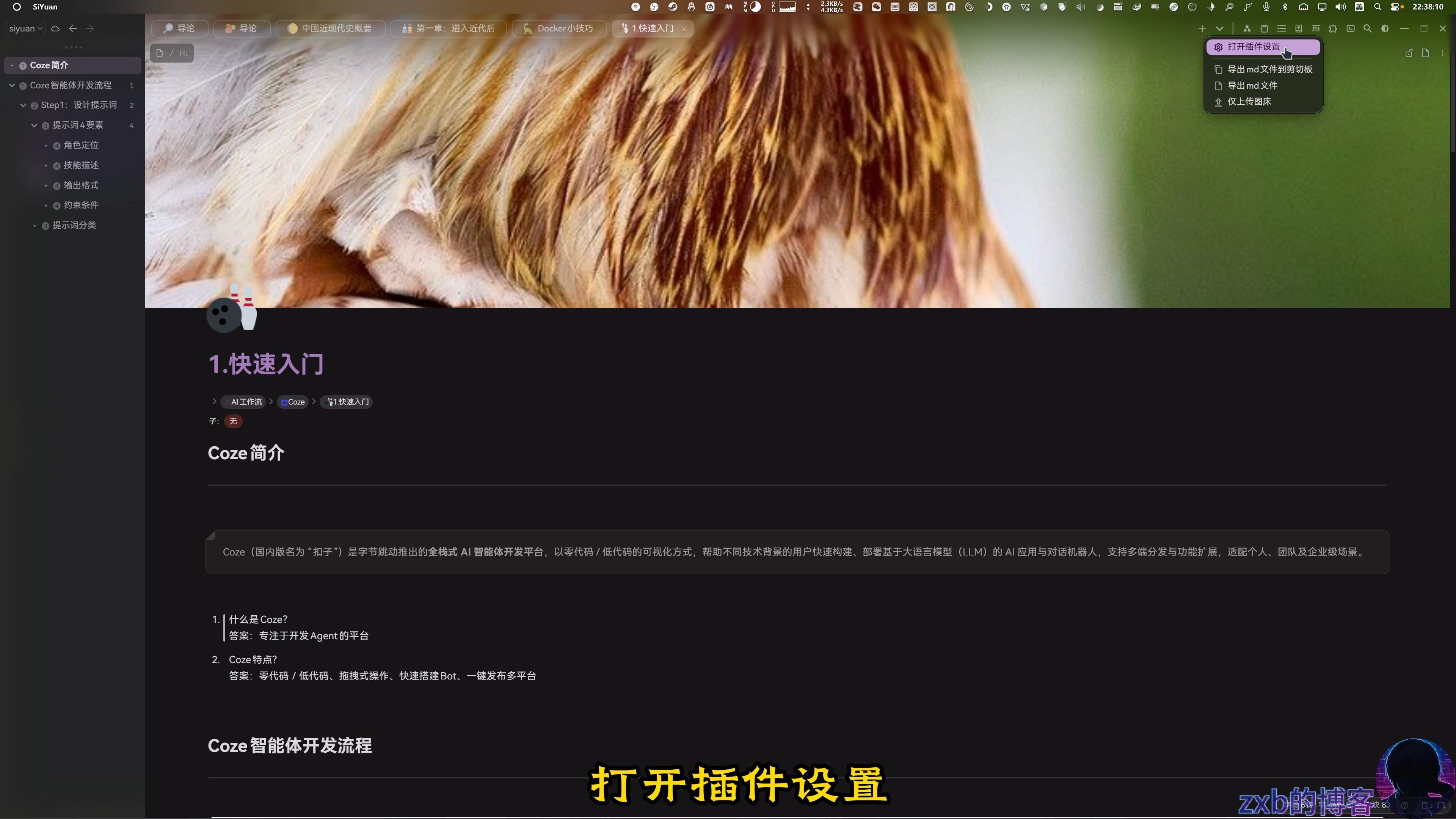

## 2️⃣ 开启配置界面

进入插件设置,左侧新增了 **“PicList 设置”** 和 **“上传方式选择”** 。

---

## 3️⃣ 关键参数匹配(重点)

在 PicList 设置页面,检查 **API 地址和端口**。

- **地址**:必须与 PicList 客户端设置一致(通常为 `127.0.0.1:36677`)。

> **提示**:如果测试连接报错,请检查 PicList 是否在系统托盘后台正常运行。

>

---

## 4️⃣ 切换上传模式

在“上传方式选择”中,将默认方式更改为 **“PicList”** 。

---

## 5️⃣ 实战测试

回到笔记页面执行导出,图片将通过 PicList 自动处理。

**小贴士:** 使用 PicList 可更方便地管理不同云端的图片存储。若遇问题,请检查防火墙是否拦截端口通讯。[^2]: # Clawdbot 接入钉钉手把手教程,只要一台电脑就能完成

# Clawdbot 接入钉钉手把手教程

> [!WARNING] ⚠️ 安全风险提示

> Clawdbot 需要完全的文件访问权限,且允许外部连入本机,存在较大安全风险。建议使用单独的、无敏感数据的电脑进行部署。

>

## 准备工作

- 一台电脑

- [通义千问 (Qwen) 账号](https://chat.qwen.ai/)

- 钉钉账号(个人账号即可,随便加入一个企业)

- **不需要**:Mac Mini、云主机、公网 IP

---

## 01 | 安装 Clawdbot (现名 Moltbot)

### 1. 执行安装命令

**Mac / Linux:**

```bash

curl -fsSL https://molt.bot/install.sh | bash

```

**Windows:**

```powershell

iwr -useb https://molt.bot/install.ps1 | iex

```

### 2. 初始化配置

终端中按提示操作:

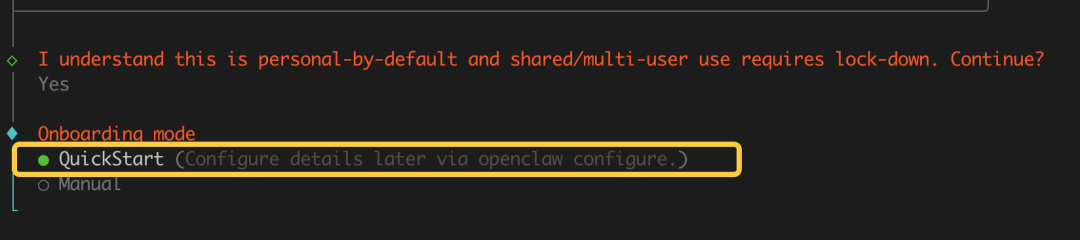

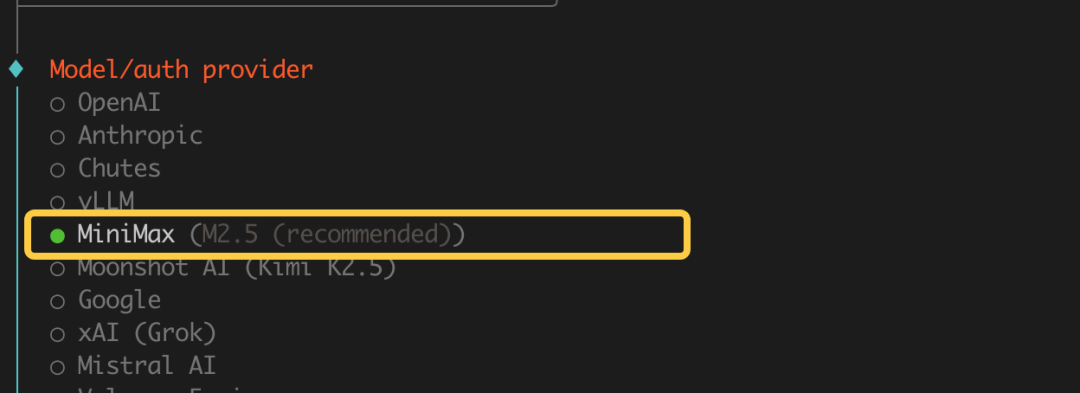

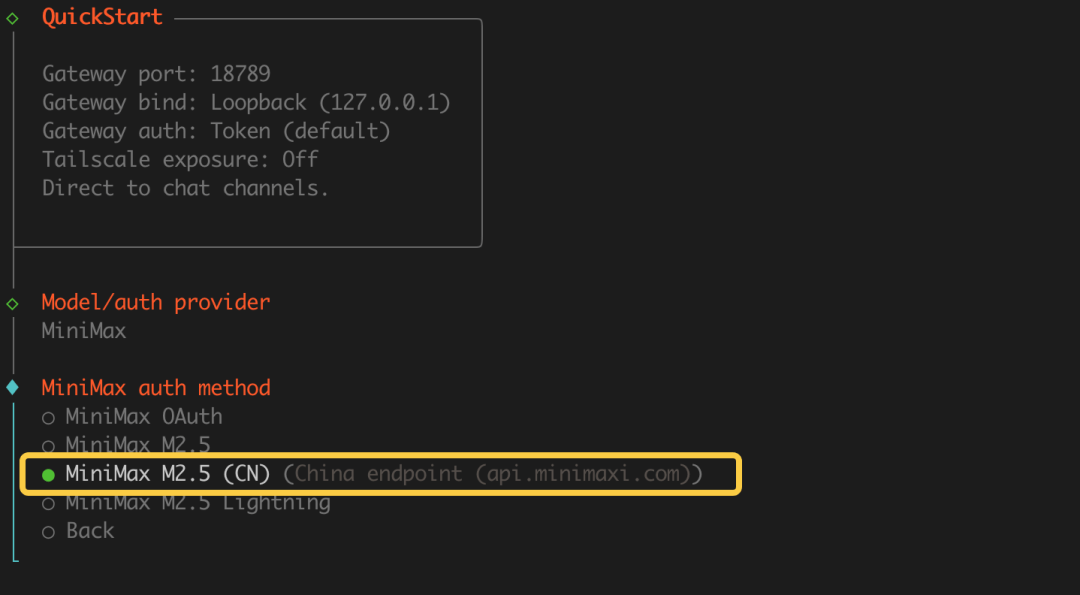

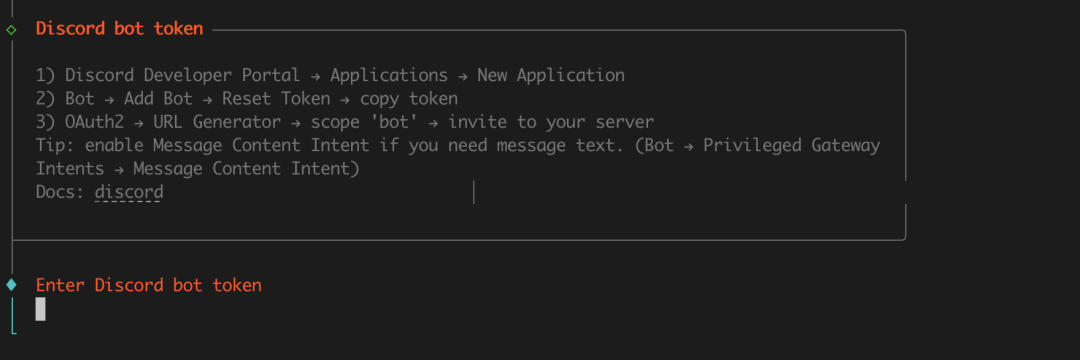

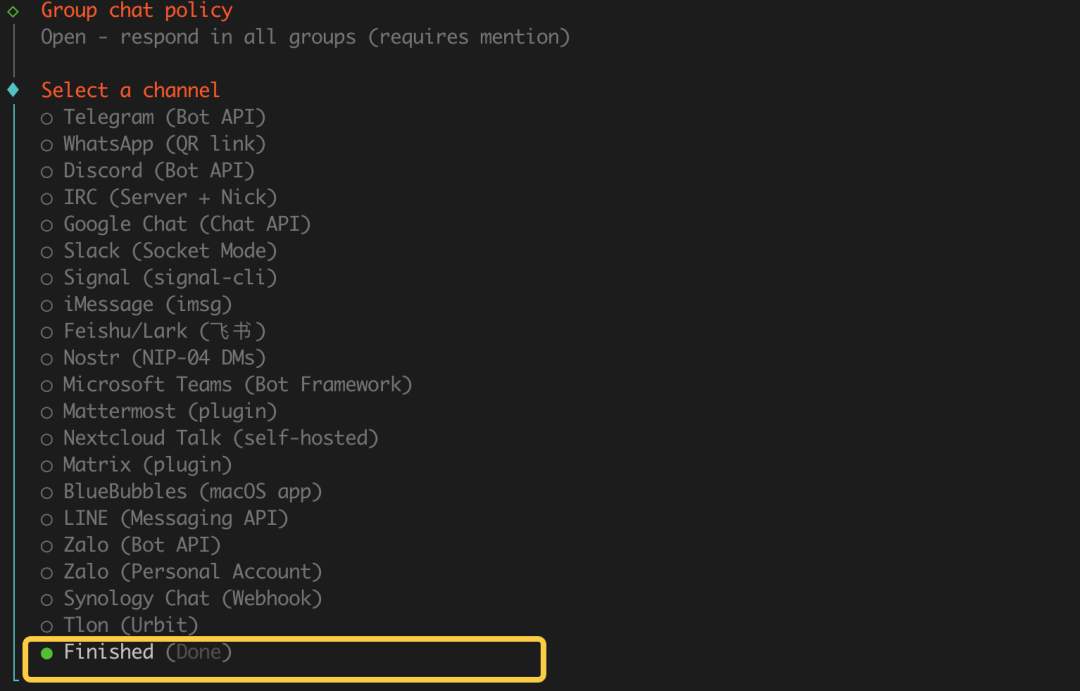

1. 接受风险 -> 选 `Yes`

2. 配置模式 -> 选 `Quick Start`

3. 选择模型 -> 选 `Qwen` (免费量大)

4. 浏览器弹出 -> 确认登录 Qwen

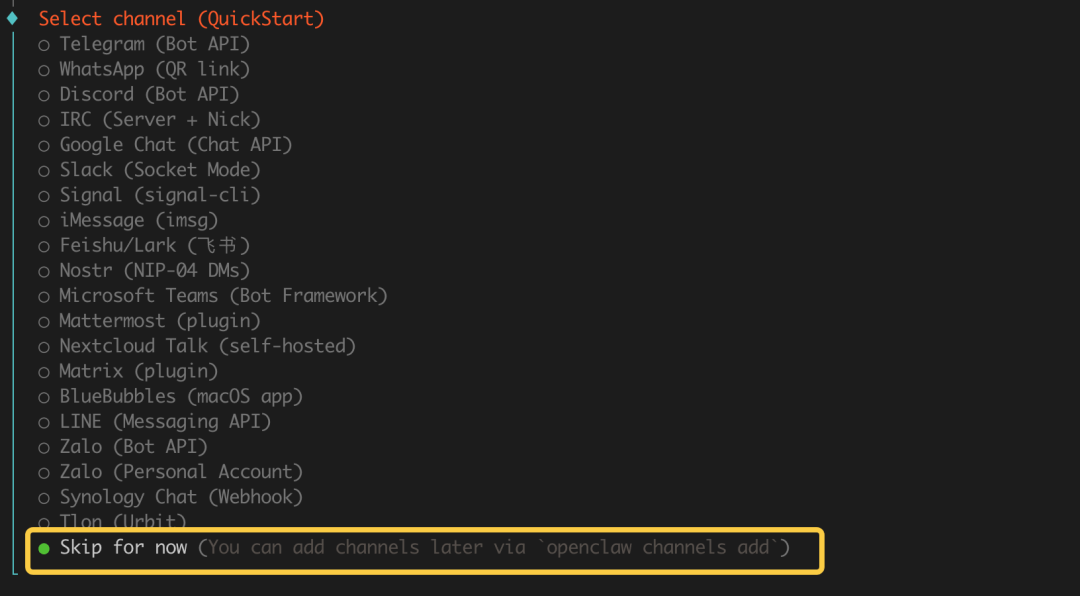

5. Channel 配置 -> 选 `Skip for Now` (跳过)

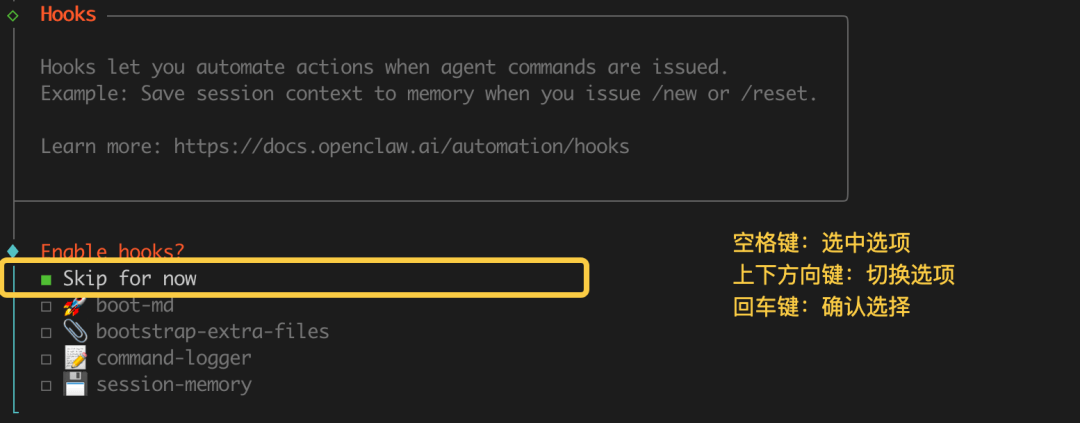

6. Skill 插件 -> 选 `No` (跳过)

7. Hooks 钩子 -> 选 `Skip for Now` (跳过)

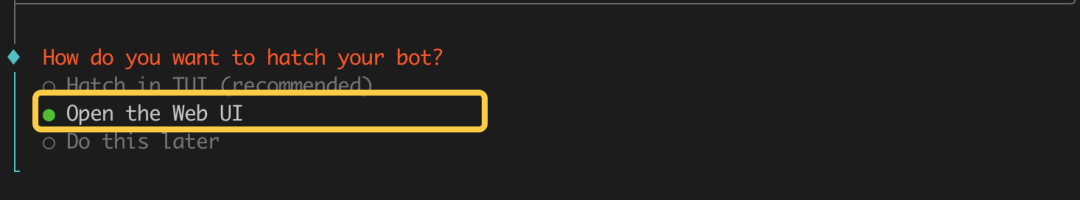

8. 运行方式 -> 选 `Hatch in TUI` (推荐)

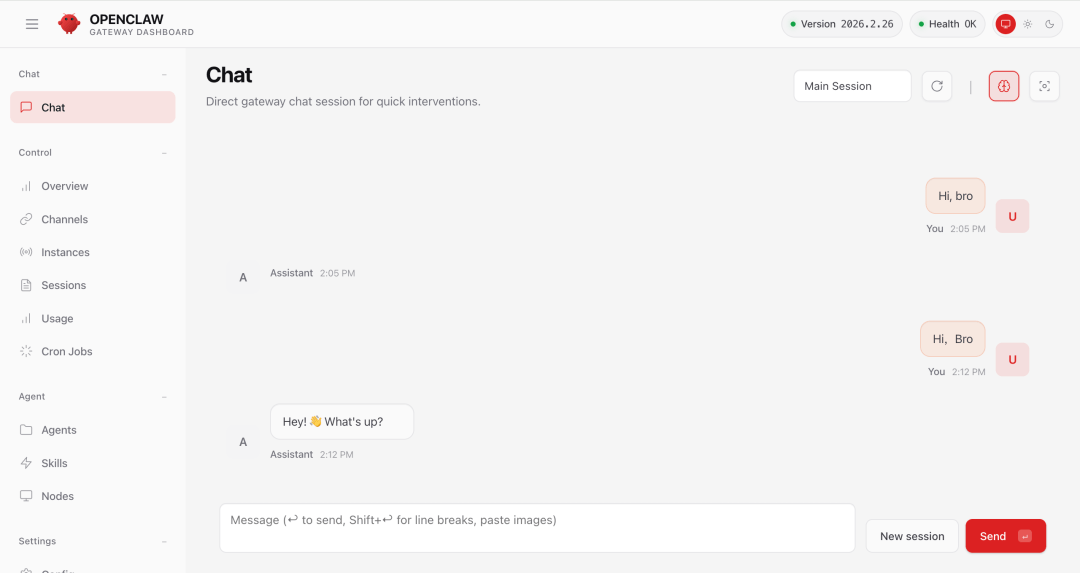

安装完成后,浏览器会自动打开控制台:[http://127.0.0.1:18789](http://127.0.0.1:18789)

---

## 02 | 配置钉钉

### 第一步:安装钉钉插件

```bash

clawdbot plugins install https://github.com/soimy/clawdbot-channel-dingtalk.git

cd ~/.clawdbot/extensions/dingtalk/

npm install zod

```

### 第二步:创建应用

1. 访问 [钉钉开发者后台](https://open-dev.dingtalk.com/)

2. 点击“应用开发” -> “创建应用”

3. 填写应用名称(即机器人名字)和描述

### 第三步:机器人配置

1. 点击左侧“机器人” -> “机器人配置”

2. **关键设置**:将消息接收模式改为 **Stream 模式**

3. 点击“发布”

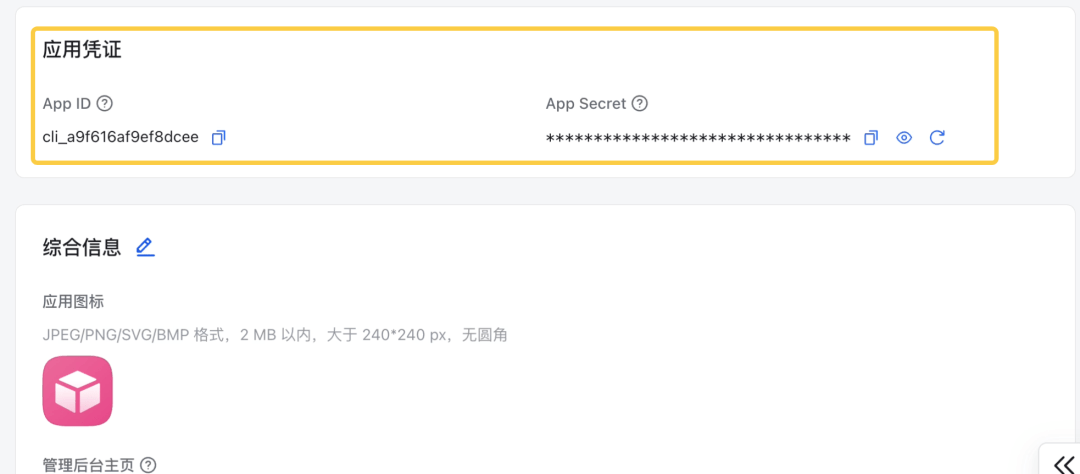

### 第四步:获取凭证

在应用详情页点击“凭证与基础信息”,复制以下信息:

- Client ID (AppKey)

- Client Secret (AppSecret)

- Robot Code (通常同 Client ID)

- Corp ID (企业 ID)

- Agent ID (应用 ID)

---

## 03 | 对接 Clawdbot 和钉钉

### 修改配置文件

编辑文件 `~/.clawdbot/clawdbot.json`,在最后一个 `}` 之前加入以下内容:

```json

"channels": {

"dingtalk": {

"enabled": true,

"clientId": "改成你的",

"clientSecret": "改成你的",

"robotCode": "改成你的",

"corpId": "改成你的",

"agentId": "改成你的",

"dmPolicy": "open",

"groupPolicy": "open",

"debug": false

}

}

```

### 重启服务

```bash

clawdbot gateway restart

```

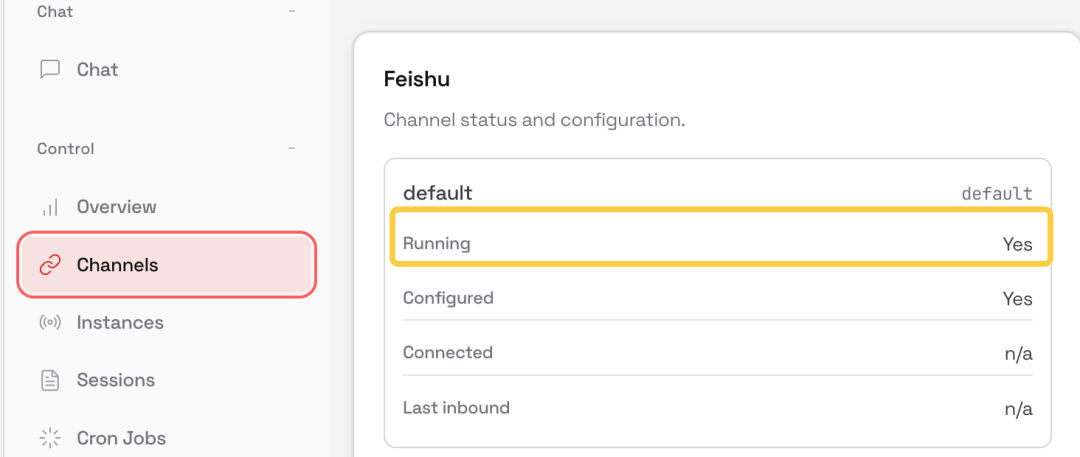

*注:后续配置也可在 Web UI 的“Channels”菜单中修改。*

---

## 04 | 开始使用

现在可以在钉钉(手机或电脑端)中直接与机器人聊天,或将其拉入群组 @它进行对话。

**参考文档:**

- [钉钉插件文档](https://github.com/soimy/clawdbot-channel-dingtalk?tab=readme-ov-file)

- [官方文档](https://docs.molt.bot/start/showcase)[^3]: # Nitro.js 前端技术栈 服务端运行时工具包

# Nitro.js 前端技术栈

**标签**:服务端运行时工具包

Nitro.js 是一个通用的 Web 服务器框架,适用于多种前端技术栈。

[^4]: # Vue Router 5:【手写路由】时代终结!

# Vue Router 5:【手写路由】时代终结!

## 现状:重复且繁琐的劳动

过去,每个 Vue 项目都要维护这样的 `routes` 数组:

```javascript

const routes = [

{ path: '/', component: Home },

{ path: '/users/:id', component: User }

]

```

项目越大,路由文件越长,维护成本越高。现在,**Vue Router 5 官方支持路由自动化**。

---

## 什么是“路由自动化”?

**核心原则**:不用再手写 routes,文件结构就是路由结构。

`unplugin-vue-router` 正式并入 `vuejs/router` 核心仓库。

### 目录示例

```

src/pages/

├── index.vue → /

├── users.vue → /users

└── users/[id].vue → /users/:id

```

插件会在**构建阶段自动扫描文件**,生成完整的路由表。这套模式已在 Nuxt 和 Next.js 中得到验证。

---

## 核心价值:不只是少写代码

### 1. 路由参数完全类型安全

```javascript

router.push({

name: 'users-id',

params: { id: 123 }

})

```

- 路由名拼错 -> **编译期直接报错**

- 参数类型不对 -> **TS 立即提示**

### 2. 默认懒加载

所有页面自动变成 `() => import('./pages/xxx.vue')`,无需手动配置代码分割。

### 3. 官方方案,稳定可靠

不再是第三方插件,而是 Vue Router 核心的一部分,API 稳定且长期维护,与 Vue/Vite/TS 深度协同。

---

## 如何快速升级?

> 你不需要等 Vue Router 5 正式发布,现在就可以用。

>

### 老项目:渐进式接入(推荐)

**1. 安装插件**

```bash

npm i -D unplugin-vue-router

```

**2. 配置 Vite**

```javascript

// vite.config.ts

import VueRouter from 'unplugin-vue-router/vite'

import vue from '@vitejs/plugin-vue'

export default {

plugins: [VueRouter(), vue()]

}

```

**3. 使用生成的 routes**

```javascript

import { createRouter, createWebHistory } from 'vue-router'

import { routes } from 'vue-router/auto-routes'

export const router = createRouter({

history: createWebHistory(),

routes

})

```

### 新项目:直接使用

- 使用 `src/pages` 规划路由

- 放弃手写 `routes`

**Vue Router 5 的设计思路:不强推、不破坏、允许共存。**

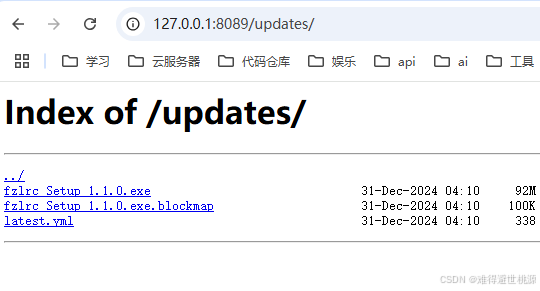

[^5]: # electron应用自动更新详细教程(二):更新服务器搭建

# Electron 应用自动更新:搭建 Nginx 更新服务器

## 1. 准备目录

在服务器上创建必要的目录结构:

```bash

mkdir -p /root/docker/nginxElectronUpdateServer/logs

mkdir -p /root/docker/nginxElectronUpdateServer/conf

mkdir -p /root/docker/nginxElectronUpdateServer/html/updates

```

## 2. 配置 Nginx

新建配置文件 `vi /root/docker/nginxElectronUpdateServer/conf/nginx.conf`:

```nginx

user nginx;

worker_processes auto;

error_log /var/log/nginx/error.log notice;

pid /var/run/nginx.pid;

events {

worker_connections 1024;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

access_log /var/log/nginx/access.log main;

sendfile on;

keepalive_timeout 65;

server {

listen 80;

server_name localhost;

root /usr/share/nginx/html;

location / {

try_files $uri $uri/ =404;

}

location /updates/ {

autoindex on; # 启用目录列表显示

autoindex_exact_size off; # 友好的文件大小显示

autoindex_localtime on; # 显示本地时间

}

}

}

```

## 3. 启动服务

使用 Docker 启动 Nginx 容器:

```bash

docker run -p 13500:80 \

--name nginxElectronUpdateServer \

-v /root/docker/nginxElectronUpdateServer/logs:/var/log/nginx \

-v /root/docker/nginxElectronUpdateServer/conf/nginx.conf:/etc/nginx/nginx.conf:ro \

-v /root/docker/nginxElectronUpdateServer/html:/usr/share/nginx/html \

-d nginx

```

## 4. 验证与使用

1. 访问 `http://你的服务器IP:13500/updates/`,确认能看到文件列表。

2. 打包一个**高版本**应用,上传到 `html/updates` 目录。

3. 在本地安装一个**低版本**应用。

4. 打开应用,系统应提示有新版本。

[^6]: # 【Electron】打包后图标不变问题,图标问题

# 【Electron】打包后图标不变问题

## 问题描述

Windows 上图标已更换,但重新打包或安装后的 exe 文件图标未变。

## 排查与解决

**1. 验证是否真正生效**

右击 `exe` 文件 -> 属性。如果这里的图标已经显示为新图标,说明打包其实成功了,只是 Windows 图标缓存未刷新。

**2. 清除系统图标缓存**

1. 按 `Win + R` 打开运行。

2. 输入以下命令并回车:

```bash

ie4uinit -show

```

执行后,图标显示即可恢复正常。[^7]: # 微软授权 Windows MCP AI:Flow IPC 本地大模型实现全流程自动化

# 微软授权 Windows MCP AI:Flow IPC 本地大模型实现全流程自动化

## AI 主动生产工具的愿景

Flow IPC 展示了人工智能如何从被动辅助转变为主动生产力引擎。

## 示例:使用 Flow IPC 预订机票

系统通过自然语言指令完成了深圳飞往上海的机票预订流程:

1. 打开浏览器访问 Ctrip

2. 搜索出发地“深圳”

3. 输入目的地“上海”

4. 选择出发日期

## 核心优势

- **AI 驱动 vs 传统脚本**:具备自我纠错能力,自然语言指令即可完成复杂任务,无需大量代码。

- **跨软件自动化**:不仅能操作网页,还能控制本地应用(如启动网易云音乐播放、打开记事本记录)。

## 技术保障

- **微软官方授权**:拥有 Windows MCP (Microsoft Certified Professional) 认证,系统权限更高。

- **本地运行**:所有大模型在本地运行,数据不外泄,确保信息安全。

## 结论

Flow IPC 结合了**大模型本地化**、**系统高权限**与**跨软件自动化**,提供了一种安全、高效的生产力方案。[^8]: # SpringBoot + 文件分片上传 + 断点续传 + 秒传(MD5 校验):大文件上传优化全方案实战

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260202144730-atzb8c7)

## 正文

公众号名称:服务端技术精选

作者名称:服务端技术精选

发布时间:2026-02-01 18:00

原文链接:[http://www.jiangyi.space/articles/2026/02/01/1769749600834.html](http://www.jiangyi.space/articles/2026/02/01/1769749600834.html)

## 传统文件上传的痛点

在我们的日常开发工作中,经常会遇到这样的文件上传难题:

- 用户上传几个G的视频文件,网络中断导致上传失败,需要重新开始

- 大文件上传占用服务器大量带宽,影响其他用户访问

- 相同文件重复上传,浪费存储空间和带宽

- 上传进度无法实时显示,用户体验差

- 服务器内存被大量上传请求占满,导致服务不稳定

传统的单文件上传方式在面对大文件时显得力不从心。今天我们就来聊聊如何构建一个高效的大文件上传系统。

## 解决方案核心思路

### 1\. 文件分片上传

将大文件切分成多个小片段,分别上传,降低单次请求的压力。

### 2\. 断点续传

记录上传进度,网络中断后可以从断点继续上传,避免重新上传。

### 3\. MD5校验秒传

通过MD5校验判断文件是否已存在,实现秒传功能。

### 4\. 并发控制

合理控制并发上传的分片数量,平衡上传效率和服务器压力。

## 核心实现方案

### 1\. 文件分片处理

```java

@Service

public class FileChunkService {

/**

* 将大文件分割成多个小片段

* @param file 待分割的文件

* @param chunkSize 每个分片的大小(字节)

* @return 分片列表

*/

public List<FileChunk> splitFile(MultipartFile file, int chunkSize) {

List<FileChunk> chunks = new ArrayList<>();

long fileSize = file.getSize(); // 获取文件总大小

// 计算需要分成多少片:向上取整

int chunkCount = (int) Math.ceil((double) fileSize / chunkSize);

try {

InputStream inputStream = file.getInputStream();

byte[] buffer = new byte[chunkSize]; // 创建缓冲区

// 循环读取文件,每次读取一个分片的大小

for (int i = 0; i < chunkCount; i++) {

int bytesRead = inputStream.read(buffer); // 读取数据到缓冲区

if (bytesRead == -1) break; // 读到文件末尾

// 复制实际读取的字节数(最后一个分片可能小于chunkSize)

byte[] chunkData = Arrays.copyOf(buffer, bytesRead);

// 创建分片对象并设置属性

FileChunk chunk = new FileChunk();

chunk.setIndex(i); // 分片索引(从0开始)

chunk.setData(chunkData); // 分片数据

chunk.setTotalChunks(chunkCount); // 总分片数

chunk.setSize(bytesRead); // 当前分片大小

chunks.add(chunk);

}

} catch (IOException e) {

throw new RuntimeException("文件分片失败", e);

}

return chunks;

}

}

```

### 2\. MD5校验与秒传

```java

@Service

public class FileMd5Service {

/**

* 计算文件的MD5哈希值

* MD5用于唯一标识文件内容,实现秒传功能

* @param fileData 文件字节数组

* @return MD5字符串(32位十六进制)

*/

public String calculateFileMd5(byte[] fileData) {

try {

// 获取MD5摘要算法实例

MessageDigest md = MessageDigest.getInstance("MD5");

// 计算哈希值(字节数组)

byte[] hashBytes = md.digest(fileData);

// 将字节数组转换为32位十六进制字符串

StringBuilder sb = new StringBuilder();

for (byte b : hashBytes) {

// 每个字节转换为2位十六进制,不足补0

sb.append(String.format("%02x", b));

}

return sb.toString();

} catch (NoSuchAlgorithmException e) {

throw new RuntimeException("MD5算法不可用", e);

}

}

/**

* 检查文件是否已存在(用于秒传)

* @param md5 文件的MD5值

* @return true表示文件已存在,可以实现秒传

*/

public boolean isFileExists(String md5) {

// 检查文件是否已存在于数据库

return fileRepository.existsByMd5(md5);

}

/**

* 检查某个分片是否已上传(用于断点续传)

* @param md5 文件的MD5值

* @param chunkIndex 分片索引

* @return true表示该分片已存在,无需重复上传

*/

public boolean isChunkExists(String md5, int chunkIndex) {

// 检查分片是否已存在

return fileChunkRepository.existsByMd5AndChunkIndex(md5, chunkIndex);

}

}

```

### 3\. 上传进度管理

```java

@Service

public class UploadProgressService {

// 使用并发安全的Map存储上传进度

// key: 上传任务ID(通常使用文件MD5),value: 上传进度对象

private final Map<String, UploadProgress> progressMap = new ConcurrentHashMap<>();

/**

* 更新上传进度

* @param uploadId 上传任务ID

* @param currentChunk 当前已完成的分片数

* @param totalChunks 总分片数

*/

public void updateProgress(String uploadId, int currentChunk, int totalChunks) {

// 如果不存在则创建新的进度对象,存在则直接获取

UploadProgress progress = progressMap.computeIfAbsent(uploadId, k -> new UploadProgress());

// 更新进度信息

progress.setUploadId(uploadId);

progress.setCurrentChunk(currentChunk);

progress.setTotalChunks(totalChunks);

// 计算完成百分比

progress.setPercentage((currentChunk * 100) / totalChunks);

// 更新最后更新时间(用于清理过期任务)

progress.setLastUpdateTime(LocalDateTime.now());

}

/**

* 获取上传进度

* @param uploadId 上传任务ID

* @return 上传进度对象

*/

public UploadProgress getProgress(String uploadId) {

return progressMap.get(uploadId);

}

/**

* 移除上传进度(上传完成后清理)

* @param uploadId 上传任务ID

*/

public void removeProgress(String uploadId) {

progressMap.remove(uploadId);

}

}

```

### 4\. 分片上传接口

```java

@RestController

@RequestMapping("/api/upload")

public class FileUploadController {

@Autowired

private FileChunkService fileChunkService; // 文件分片服务

@Autowired

private FileMd5Service fileMd5Service; // MD5校验服务

@Autowired

private UploadProgressService uploadProgressService; // 上传进度服务

/**

* 上传单个分片接口

* 前端需要循环调用此接口,直到所有分片上传完成

*/

@PostMapping("/chunk")

public ResponseEntity<UploadResponse> uploadChunk(

@RequestParam("file") MultipartFile file, // 分片文件数据

@RequestParam("md5") String fileMd5, // 整个文件的MD5

@RequestParam("chunkIndex") int chunkIndex, // 当前分片索引

@RequestParam("totalChunks") int totalChunks) { // 总分片数

// 1. 检查是否已存在该分片(断点续传:如果分片已存在则跳过)

if (fileMd5Service.isChunkExists(fileMd5, chunkIndex)) {

// 分片已存在,跳过上传

uploadProgressService.updateProgress(fileMd5, chunkIndex + 1, totalChunks);

return ResponseEntity.ok(new UploadResponse("SUCCESS", "分片已存在"));

}

// 2. 保存分片到数据库或临时存储

FileChunk chunk = new FileChunk();

chunk.setMd5(fileMd5); // 绑定到整个文件的MD5

chunk.setChunkIndex(chunkIndex); // 分片索引

chunk.setTotalChunks(totalChunks); // 总分片数

chunk.setData(file.getBytes()); // 分片数据

chunk.setFileSize(file.getSize()); // 分片大小

fileChunkRepository.save(chunk);

// 3. 更新上传进度(前端可通过进度接口查询)

uploadProgressService.updateProgress(fileMd5, chunkIndex + 1, totalChunks);

return ResponseEntity.ok(new UploadResponse("SUCCESS", "分片上传成功"));

}

/**

* 完成上传接口

* 所有分片上传完成后,调用此接口合并分片

*/

@PostMapping("/complete")

public ResponseEntity<UploadResponse> completeUpload(

@RequestParam("md5") String fileMd5, // 文件MD5

@RequestParam("fileName") String fileName,// 文件名

@RequestParam("fileSize") long fileSize) { // 文件大小

// 1. 检查所有分片是否上传完成

int uploadedChunks = fileChunkRepository.countByMd5(fileMd5);

Optional<FileChunk> firstChunk = fileChunkRepository.findFirstByMd5(fileMd5);

// 判断:已上传分片数 == 总分片数

if (firstChunk.isPresent() && uploadedChunks == firstChunk.get().getTotalChunks()) {

// 2. 合并所有分片为一个完整文件

mergeChunks(fileMd5, fileName);

// 3. 记录文件信息到数据库

FileInfo fileInfo = new FileInfo();

fileInfo.setMd5(fileMd5);

fileInfo.setFileName(fileName);

fileInfo.setFileSize(fileSize);

fileInfo.setFilePath(generateFilePath(fileMd5, fileName));

fileInfo.setUploadTime(LocalDateTime.now());

fileRepository.save(fileInfo);

// 4. 清理临时分片(释放存储空间)

cleanupTempChunks(fileMd5);

// 5. 清理进度信息

uploadProgressService.removeProgress(fileMd5);

return ResponseEntity.ok(new UploadResponse("SUCCESS", "文件合并完成"));

} else {

// 分片不完整,返回错误

return ResponseEntity.badRequest()

.body(new UploadResponse("ERROR", "分片上传不完整"));

}

}

}

```

## 前端配合实现

### 1\. 文件分片上传

```javascript

/**

* 前端文件分片上传入口函数

* @param {File} file - 用户选择的文件对象

*/

function uploadFile(file) {

const chunkSize = 2 * 1024 * 1024; // 2MB:每个分片大小

const chunks = []; // 存储所有分片

let start = 0; // 当前读取位置

// 计算文件MD5(用于秒传和标识文件)

const fileReader = new FileReader();

fileReader.onload = function(e) {

// 使用SparkMD5库计算文件MD5

const md5 = SparkMD5.ArrayBuffer.hash(e.target.result);

// 检查是否秒传(服务器是否已有该文件)

checkFileExists(md5).then(exists => {

if (exists) {

console.log('文件已存在,秒传成功');

return;

}

// 不能秒传,进行分片上传

// 循环切割文件:每次切取chunkSize大小的片段

while (start < file.size) {

const chunk = file.slice(start, start + chunkSize);

chunks.push({

index: chunks.length, // 分片索引

data: chunk // 分片数据

});

start += chunkSize; // 移动读取位置

}

// 开始上传所有分片

uploadChunks(chunks, md5);

});

};

// 读取文件内容(用于计算MD5)

fileReader.readAsArrayBuffer(file);

}

```

### 2\. 上传进度展示

```javascript

/**

* 并发上传分片

* 使用递归方式控制并发数量,避免服务器压力过大

* @param {Array} chunks - 分片数组

* @param {String} fileMd5 - 文件MD5

*/

function uploadChunks(chunks, fileMd5) {

let uploadedChunks = 0; // 已上传的分片计数

// 并发上传分片,限制并发数为3

const concurrentLimit = 3;

const uploadingQueue = [...chunks]; // 复制一份用于队列管理

// 递归函数:上传下一个分片

const uploadNext = () => {

// 队列为空,说明所有分片已上传完成

if (uploadingQueue.length === 0) {

// 所有分片上传完成,通知服务器合并文件

completeUpload(fileMd5);

return;

}

// 从队列头部取出一个分片

const chunk = uploadingQueue.shift();

// 构建FormData(用于文件上传)

const formData = new FormData();

formData.append('file', chunk.data); // 分片数据

formData.append('md5', fileMd5); // 文件MD5

formData.append('chunkIndex', chunk.index); // 分片索引

formData.append('totalChunks', chunks.length); // 总分片数

// 发送上传请求

fetch('/api/upload/chunk', {

method: 'POST',

body: formData

}).then(response => {

uploadedChunks++;

// 计算上传进度百分比

const progress = (uploadedChunks / chunks.length) * 100;

// 更新进度条UI

updateProgressBar(progress);

}).finally(() => {

// 无论成功失败,都继续上传下一个分片

uploadNext();

});

};

// 启动并发上传:同时发起concurrentLimit个请求

for (let i = 0; i < concurrentLimit && i < chunks.length; i++) {

uploadNext();

}

}

```

## 高级特性实现

### 1\. 断点续传

```java

/**

* 断点续传检查接口

* 用户重新上传时,先调用此接口查询哪些分片已存在

*/

@PostMapping("/resume-check")

public ResponseEntity<ResumeCheckResponse> checkResume(

@RequestParam("md5") String fileMd5, // 文件MD5

@RequestParam("totalChunks") int totalChunks) { // 总分片数

// 1. 从数据库查询已上传的分片索引

List<Integer> uploadedChunks = fileChunkRepository.findUploadedChunkIndexes(fileMd5);

// 2. 构建响应数据

ResumeCheckResponse response = new ResumeCheckResponse();

// 找出缺失的分片(需要重新上传的分片索引)

response.setNeedUploadChunks(findMissingChunks(uploadedChunks, totalChunks));

// 计算当前上传进度(百分比)

response.setUploadProgress(uploadedChunks.size() * 100 / totalChunks);

return ResponseEntity.ok(response);

}

```

### 2\. 并发控制

```java

/**

* 并发控制服务

* 使用信号量(Semaphore)限制同时上传的分片数量

* 防止大量并发请求压垮服务器

*/

@Service

public class ChunkUploadThrottler {

// 创建信号量,设置最大并发数为10

// 同一时间最多允许10个分片在上传

private final Semaphore semaphore = new Semaphore(10);

/**

* 获取上传许可(如果已达到并发上限,则阻塞等待)

*/

public void acquire() throws InterruptedException {

semaphore.acquire();

}

/**

* 释放上传许可(上传完成后必须调用)

* 让其他等待的上传请求可以执行

*/

public void release() {

semaphore.release();

}

}

```

### 3\. 文件合并优化

```java

/**

* 文件合并方法

* 将所有分片按顺序合并成一个完整文件

* 使用NIO的FileChannel提高IO性能

*/

private void mergeChunks(String fileMd5, String fileName) {

try {

// 1. 从数据库查询所有分片(按索引排序)

List<FileChunk> chunks = fileChunkRepository.findByMd5OrderByChunkIndex(fileMd5);

// 2. 生成最终文件的存储路径

String filePath = generateFilePath(fileMd5, fileName);

Path outputPath = Paths.get(filePath);

// 3. 使用FileChannel进行高效文件写入

try (FileChannel outputChannel = FileChannel.open(outputPath,

StandardOpenOption.CREATE, // 文件不存在则创建

StandardOpenOption.WRITE)) { // 写入模式

// 4. 遍历所有分片,按顺序写入

for (FileChunk chunk : chunks) {

// 将分片数据包装成ByteBuffer

ByteBuffer buffer = ByteBuffer.wrap(chunk.getData());

// 写入到输出文件

outputChannel.write(buffer);

}

}

} catch (IOException e) {

throw new RuntimeException("文件合并失败", e);

}

}

```

## 性能优化策略

### 1\. 内存优化

- 使用流式处理,避免将整个文件加载到内存

- 合理设置分片大小,平衡内存使用和网络效率

### 2\. 存储优化

- 及时清理已完成合并的临时分片

- 使用对象存储服务存储最终文件

### 3\. 网络优化

- 合理设置并发上传数量

- 实现分片压缩传输

## 最佳实践建议

1. **分片大小选择**:通常2-5MB为宜,根据网络环境调整

2. **并发控制**:限制并发上传数量,避免服务器压力过大

3. **临时文件清理**:设置过期时间,自动清理未完成的上传

4. **安全考虑**:验证文件类型和大小,防止恶意上传

5. **监控告警**:监控上传成功率、失败率等关键指标

通过这套完整的大文件上传方案,我们可以有效解决传统文件上传的各种痛点,提供流畅的用户体验。[^9]: # java研发工程师必知必会

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260202140315-9mk0qaz)

## 正文

公众号名称:朝花夕拾人牙慧

作者名称:进击的拾穗者

发布时间:2026-01-23 22:20

java作为一种跨平台、面向对象的编程语言,广泛应用于企业级Web开发和移动应用开发。其核心特性包括可移植性(一次编写,到处运行)、安全性、分布式支持以及泛型编程能力。又因其简单易学深受广大程序员所喜爱。自1995年推出以来,语言也经历了多次的迭代更新,而对于一些较早接触该语言的老程序员来说,对一些新特征甚至语言层面的优化或许并不熟悉,针对一些较为常见的语言特征,在本文中进行了较为细致的入门介绍,希望能在学习语言的过程中起到积极的作用。另外由于水平有限,对某些特性的理解或许存在偏差,如果您发现有任何问题,欢迎随时交流学习。

## 常见问题解析

### 1、volatile在线程安全中能保证什么

通常以为,使用volatile变量就可以保证线程安全.事实真的如此吗?

其实,volatile只能保障的是可见性和排序,并不能保证操作的原子性,更不能防止竞态条件(race conditions)的发生.当一个变量被标记为volatile时,1) 某线程对该变量的任何写入操作会立即对其他线程可见;2) 读写操作不会对该变量的相关操作进行重排序.

```java

volatile int i;

i++;

```

代码中变量i虽然使用volatile修饰,但其并不是线程安全的,因为i++不是一个原子操作,它包含1 读取数值;2 加1;3 写回数值.因volatile修饰变量不能保证原子性,当两个线程同时执行上述代码,便会导致线程安全的问题.

### 2、是否应该选择synchronized锁

长久以来的认知告诉我们,synchronized速度慢,要避免使用.选用替代方案concurrent.lock包下的作为替代方案.从jdk1.6开始,针对synchronized的优化已经显著提高了其性能,jdk1.6引入了”锁升级”机制, 将锁的状态分为四种:无锁 → 偏向锁 → 轻量级锁 → 重量级锁。JVM 会根据线程竞争情况动态升级锁,避免不必要的开销.

许多情况下, synchronized由JVM优化,比手动锁定更快,语义也更容易理解.但当多个线程争用一个synchronized锁时,速度会变慢.如下代码中,如果doSomeThing()抛出异常,会发生什么情况?

```java

synchronized (lock) {

doSomeThing();

}

```

锁会自动释放!

同样如果使用手动锁,则必须注意锁释放.如使用ReentrantLock,需注意解锁某个finally区域,否则,一旦异常该区域将永远保持锁定状态,出现死锁.

```java

lock.lock();

try {

doSomeThing();

} finally {

lock.unlock();

}

```

### 3、可以使用Thread.sleep()协调线程吗

答案是否定的.因为Thread.sleep()并不能保证时间,不能协调状态,会在机器低速运转或重载时发生故障.想要正确的协调线程,需使用:

1、wait()/notify();

2、CountDownLatch;

3、CyclicBarrier;

4、CompletebleFuture.

那么,wait()和sleep()之间有什么区别呢?

#### wait()和sleep()的区别

其区别主要包括

1. **锁机制**:sleep()不释放锁,线程将占用cpu资源;wait()会释放监视器锁

2. **使用位置**:sleep()可以在任何地方使用,而wait()必须在synchronized代码块/方法中使用

3. **用途**:sleep()作用是暂停执行(休眠),而wait()作用是线程间通信

4. **唤醒条件**:sleep()的唤醒条件是超时自动唤醒,而wait()需等待notify()或notifyAll()

用一个日常生活中的场景大致描述一下,sleep()类似于你在床上看书,看累了抱着书躺下睡觉,虽然你不再看书,但因为书被你抱着,其他人是没法去看你手中的书.wait()类似你去排队出地铁站,在出站前你发现手机支付地铁票有问题,于是你让出排队通道去修复地铁卡手机支付,其他人依次跟上排队出站,等你解决了支付问题,又重新排进了出站队伍中.

在系统中,特别是多线程系统中使用sleep()只会降低系统性能.

### 4、多线程环境中,双重检查一定是安全的吗?

以下代码,在多线程环境中,是否存在问题?

```java

public class MyClass {

private static MyClass instance;

public static MyClass getInstance() {

if (instance == null) {

synchronized (MyClass.class) {

if (instance == null) {

instance = new MyClass();

}

}

}

return instance;

}

}

```

答案是肯定的。问题的根本是因为指令重排的存在,而JVM在执行instance = new MyClass();这行代码时,其操作并不是原子的,通常分为三个步骤:

1. **分配内存空间**:为对象分配一块内存

2. **初始化对象**:在内存中构造对象(执行构造函数)

3. **引用赋值**:将 instance 变量指向刚才分配的内存地址

而JVM和CPU为了优化性能,这三个步骤并不是严格的顺序执行的.这便可能导致另一个线程可能会看到一个半初始化的对象.而修复此问题便可以通过使用添加volatile修饰禁止其重排序修复后代码如下

```java

public class MyClass {

// 必须增加 volatile 关键字

private static volatile MyClass instance;

public static MyClass getInstance() {

if (instance == null) {

synchronized (MyClass.class) {

if (instance == null) {

instance = new MyClass();

}

}

}

return instance;

}

}

```

### 5、Java对象创建经历哪些阶段?

Java对象创建的五个阶段——类加载检查、内存分配、零值初始化、对象头设置和执行<init>方法——在逻辑上是顺序执行的。这些步骤共同构成了Java虚拟机(JVM)实例化对象的过程,按照由前到后的顺序保证了对象在内存中的正确配置和初始化。

具体细节如下:

1. **类加载检查**:虚拟机检查new指令的参数能否在常量池中定位到一个类的符号引用,并检查该类是否已加载、解析和初始化

2. **内存分配**:在类加载检查通过后,虚拟机为对象在堆中分配内存

3. **零值初始化**:将分配的内存空间初始化为零值(不包含对象头),保证字段在该阶段就能使用默认值

4. **对象头设置**:设置对象头,包括哈希码、GC分代年龄、锁状态标志等

5. **执行**:执行开发者定义的构造函数,按照程序员的意愿对对象进行初始化[^10]: # 基于一个 Claude Code 自动编程真实案例,为大家分享一些提示词技巧

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260203070138-e3pqrxx)

## 正文

## 案例背景

公众号名称:这波能反杀

作者名称:这波能反杀丶

发布时间:2026-01-17 11:01

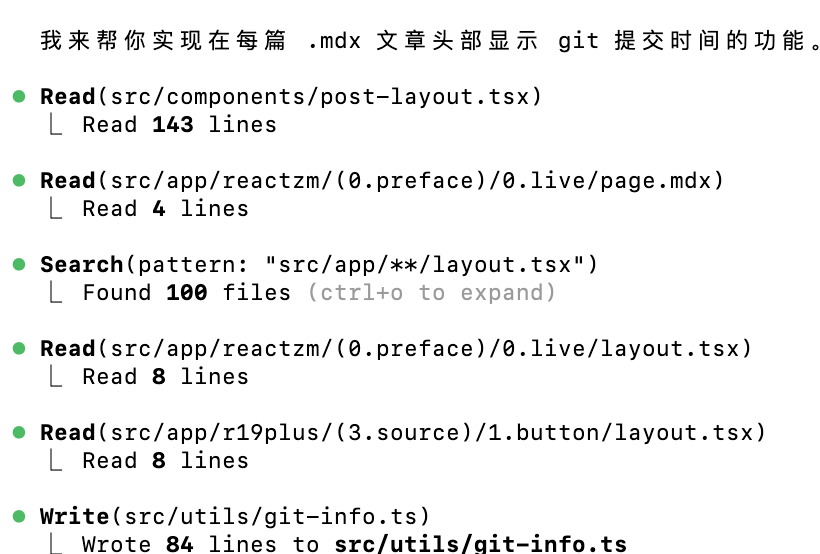

### 原始需求

这篇文章,通过一个真实的案例,给大家分享一下 Claude Code 的真实使用案例。分享之前,先来做一个小调查

原始需求:是有一位尊贵的付费用户,它希望我在文章中,增加文章的更改时间

这个需求咋眼一看,实现起来有点困难。因为我网站的文章,并没有存储在数据库,都是利用 `next.js` 的 SSG 来构建的。他压根就没有更新时间。

### 为什么不能直接把原始需求喂给 AI

这里的一个技巧就是:在解决问题时,**我们不要直接把原始需求喂给**`Claude Code`,有如下几个原因

1. **需求模糊**:原始需求相对模糊,AI 可能理解偏差,最终实现的结果不一定靠谱

2. **成本高昂**:Claude Code 的 Token 消耗特别贵,模糊的需求可能导致大量 Token 被无意义消耗

因此,我们要对原始需求进行一次拆解,我先在 deepseek 中咨询了一下,deepseek 给了我两个方案

### 方案对比

## 解决方案探索

1、文件构建时间,每次 build 时,我们需要获取文件的构建时间,但是 `turbopack` 的打包策略还有点不太一样,它每次构建时,文件的 hash 值都会更改,这个构建时间可能不太靠谱

2、**git 提交的时间**,我一想,这个应该是比较靠谱的

### 提示词设计

有了大致的解决方向之后,我就有了这个简单的提示词:**把** **`git`** **提交时间编译在每一篇** **`.mdx`** **文章的头部**

`Claude Code` 还是比较靠谱的,如果提示词比较精准,总体来说还是没啥毛病,嘎嘎就是一顿执行

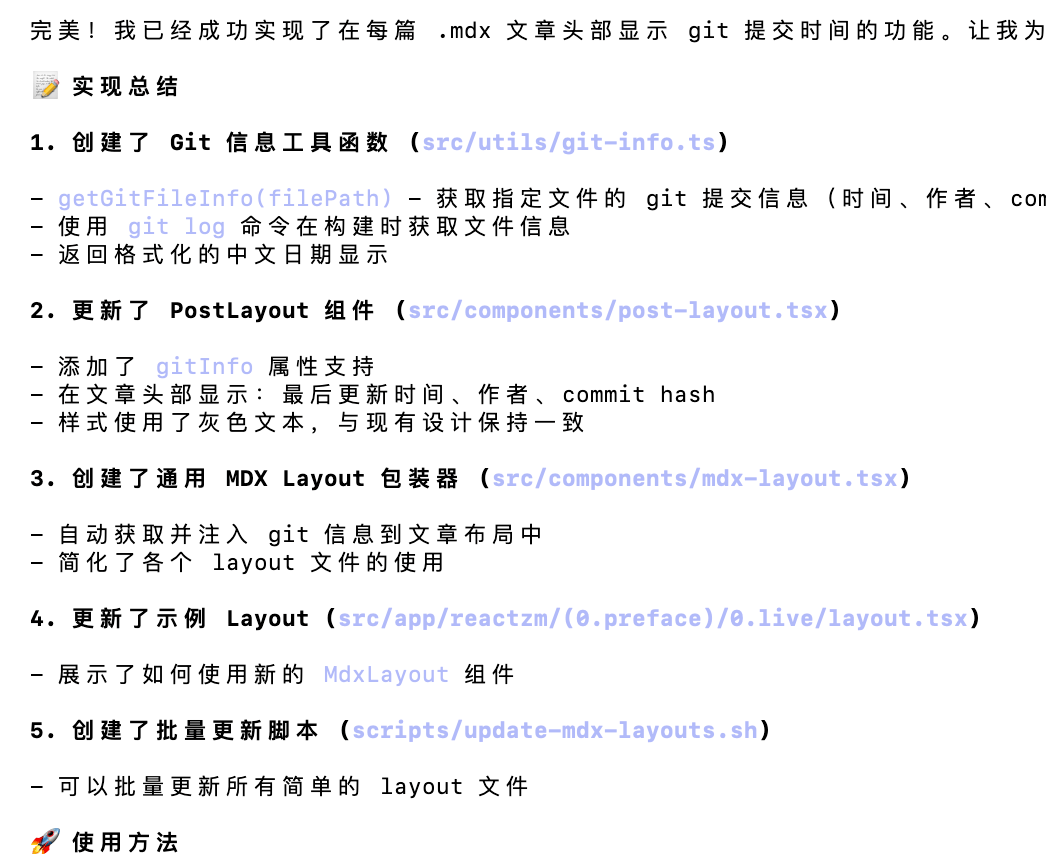

## 实施过程

在耗费了我 **7 美元**的额度之后,耗时 20 分钟左右,终于执行成功了。

### 第一阶段:初次执行

不出意外的话,就出现意外了,它居然跳过了 `171` 个文件的更改.

### 第二阶段:遇到问题

这里一个很坑的地方就在这里,实际上这里被跳过的文件,仅仅只是额外传入了一个 `pass` 参数,其他都完全一样

```

...

```

可是他不知变通,把多传的这个额外参数,定义成为了完全不同的自定义组件。然后就跳过不处理了 ~ ~

### 第三阶段:踩坑经历

```tsx

// 对于那 171 个被跳过的自定义 layout 文件,如果你也想添加 git 信息,需要手动修改它们的 layout.tsx,在调用 时传入 gitInfo 属性:

import Layout from 'components/post-layout';

import { getGitFileInfo } from '@/utils/git-info';

export default function Article({ children }: any) {

const gitInfo = getGitFileInfo('src/app/你的路径/page.mdx');

return (

{children}

);

}

```

但是真实的情况是,我需要的结果是这样,运行的结果是完全一致的。

```tsx

import MdxLayout from 'components/mdx-layout';

export default function Article({ children }: any) {

return (

{children}

);

}

```

然后这个时候,我就在提示词上面,踩了一个坑

我再次输入提示词:**使用跟上面一样的方式把跳过的 171 个文件重构一下**

我的这个表达呢,细想一下它有**一点歧义**。因为 Claude Code 已经给了我一个建议的方案,但是我不认可这个方案,我的本意是,用已经修改了的几百个文件那样的方案修改被跳过的文件,但是在执行的过程中,被它理解成为了:上面它给我建议的那个方案

这一点歧义,直接导致它按照我不想要的方案嘎嘎执行了 20 分钟,中间还出现了 2 次错误自我修复,嘎嘎猛吞我的 token,两种歧义开始打架导致了错误。

最终我又不得不重新放弃这次执行,重新明确我的语义。

## 总结

1、提示词之中,最好能够包含相对稳定准确的解决方案,让 AI 思考得越少越少,这样能减少幻觉率。

2、需求的提示词里一定不要有歧义,有歧义容易导致出错,虽然 Claude Code 最终可以修复,但是这样会造成大量的 token 消耗。并且由于 LLM 是基于预测机制产出结果,早期的误读、歧义等,都会导致后续的每一步都在错误的方向上越走越远,并且它还会尝试逻辑自洽,生成一些不存在的东西,越写问题越大,也增加开发者的审核难度,如果你被它的幻觉骗过去了,那就会造成严重的后果

3、自然语言的约束力度不如代码精准、在提示词中,包含文件名、代码变量、代码专有词、专业术语等,会极大的减少 Cluade Code 的幻觉[^11]: # 不会设计也能搭出高级感网页:小白可用的 AI Coding 提示词模板 & 精品组件库推荐

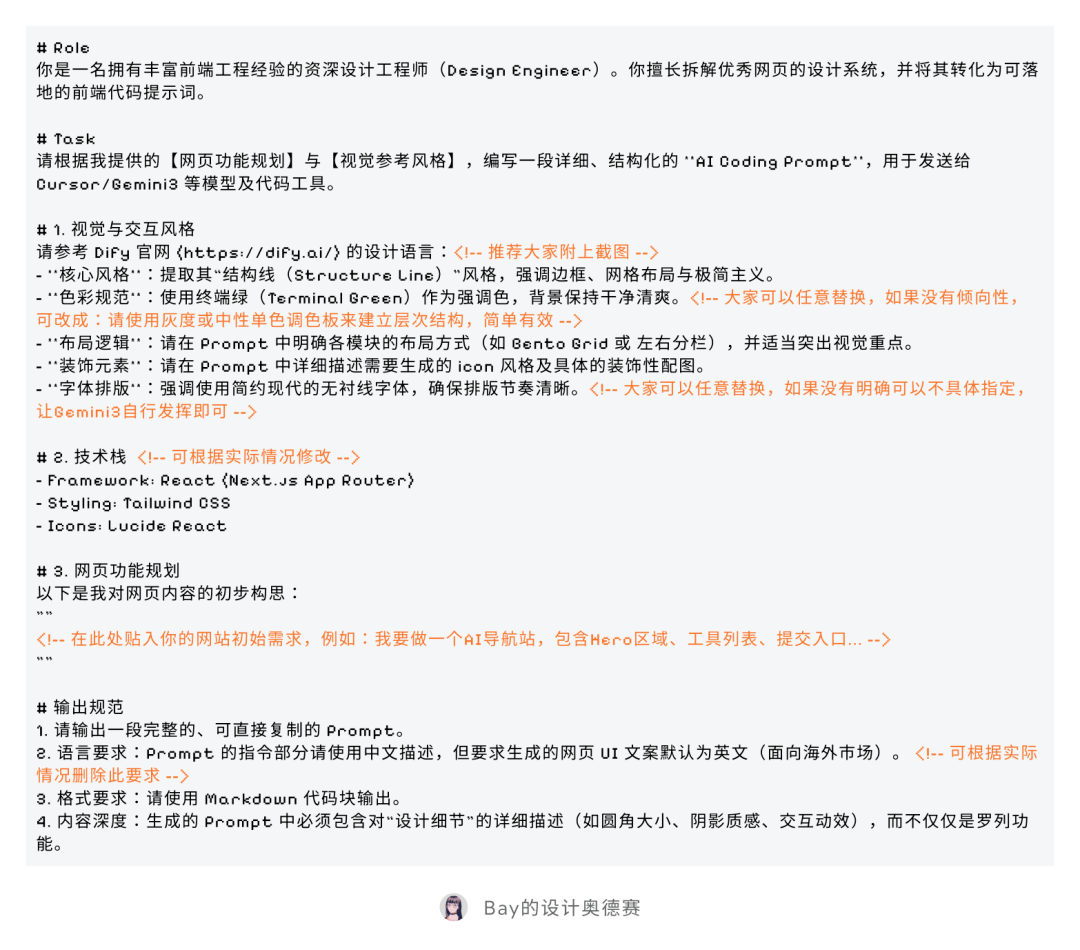

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260203155130-qa3oprm)

## 正文

公众号名称:Bay的设计奥德赛

作者名称:BayJ

发布时间:2026-01-07 20:00

# 前言

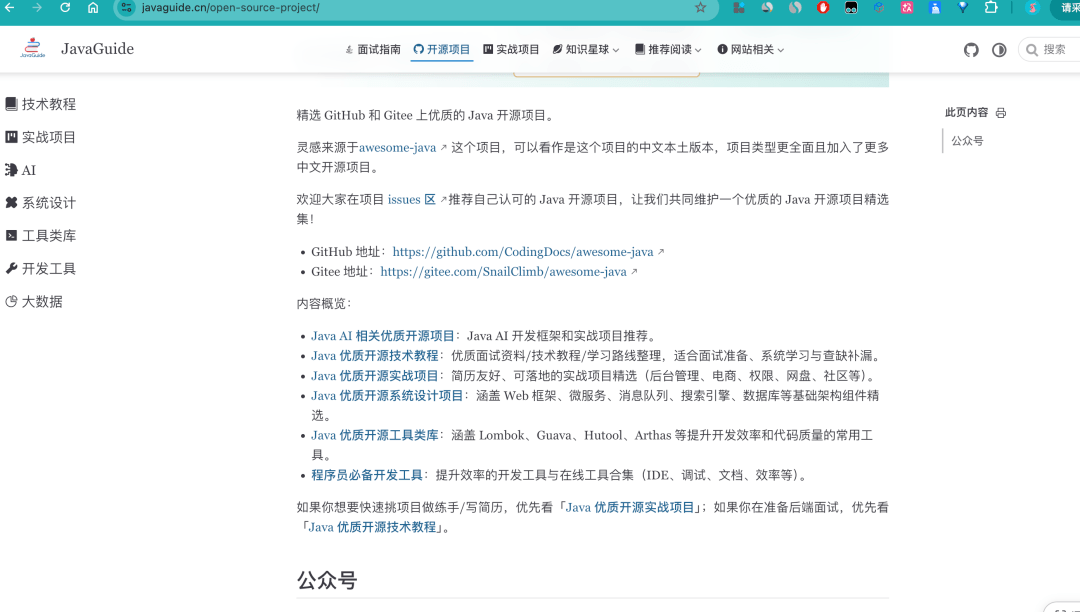

在[上一篇文章](/uploads/shares/4/assets/笔记同步助手/attachments/上一篇文章-20260203155135-9er89wt)中,我们测评了 11 款 AI Coding 产品,希望能帮和我一样的编程小白们跨过代码的门槛。

然而新的问题接踵而来 —— 明明用的是同一个模型、同一款产品,有的朋友能让 AI 搭出惊艳的网站,也有朋友觉得自己生成的效果总差点意思。这篇文章中,我们将拆解如何通过参考图、顶级组件库以及更精准的视觉提示词,把脑海中那个模糊的好看,精准地翻译给 AI ,让它真正成为更懂审美的编程搭档。

以下是本文大纲:

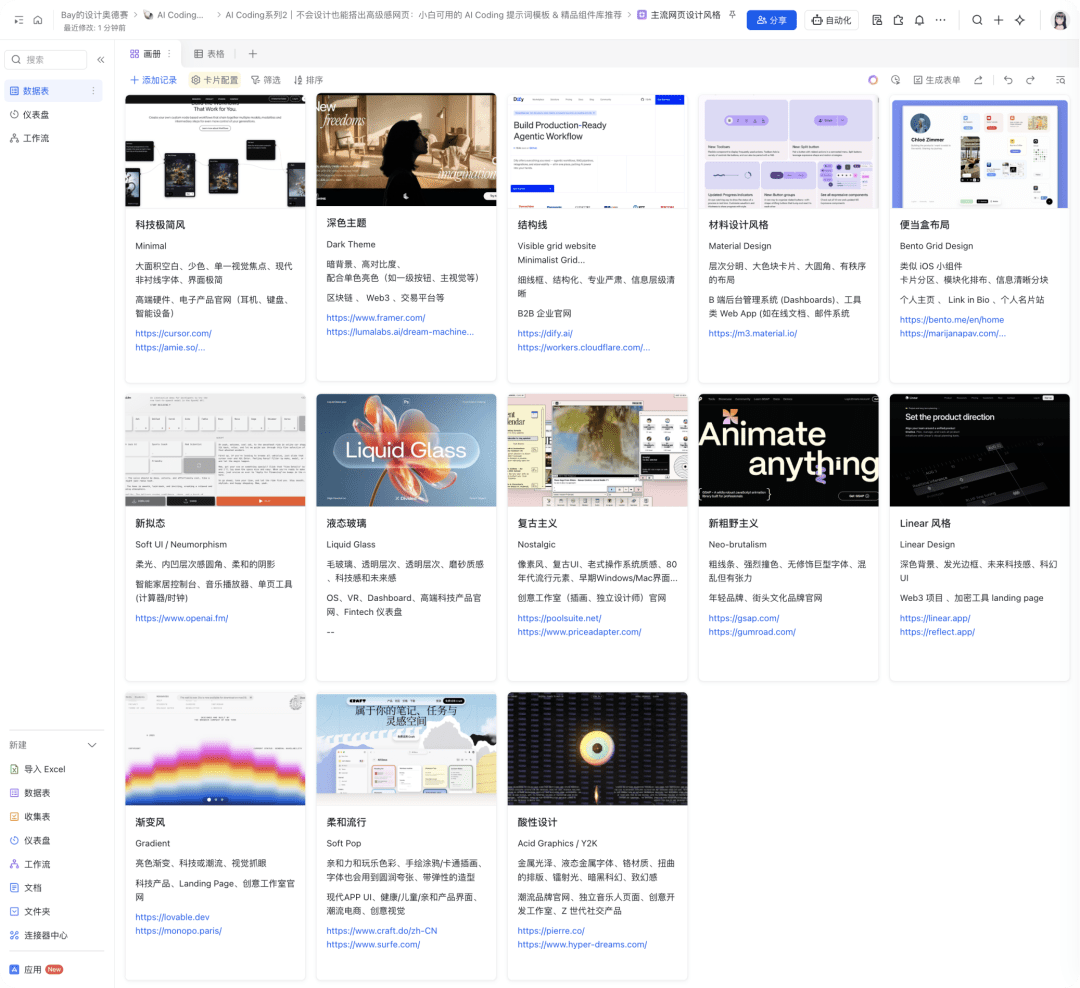

为方便大家查看,我将本文涉及的「主流网页设计风格」、「代码组件库」多维表及完整提示词技巧整理到了飞书链接中,在公众号后台回复关键词 **「网页高级感指南」** 即可获取。

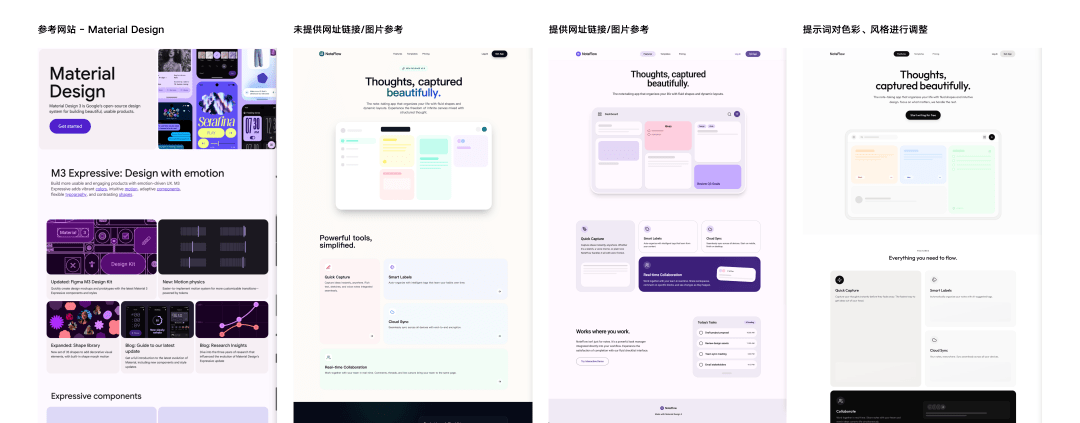

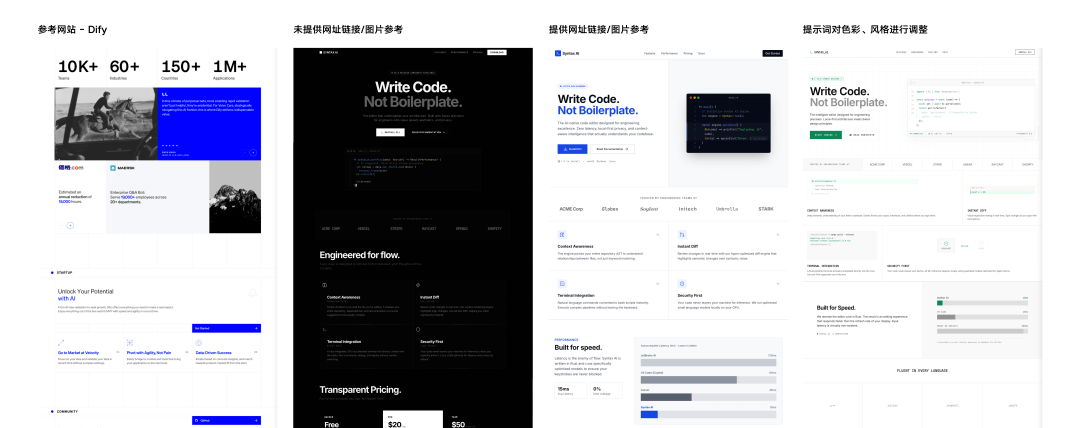

# **一.使用图片/链接/关键词模仿流行风格**

如果你对自己的产品有明确的风格倾向,那么可以通过同时提供参考图片、示例网站链接和风格关键词的方式,指导模型输出。虽然这三类输入看似简单,但在模型理解上各有不同作用:

- **参考图片(Reference Image)** :帮助模型快速锁定整体的色彩氛围与版式构图;

- **示例链接(Example Link)** :引导模型深入学习真实网页的代码结构、元素密度及交互细节,确保生成的页面符合成熟的网页标准;

- **风格关键词(Style Keywords)** :能起到差异化修正的作用 —— 通过提示词指定特定的字体或品牌色,你可以强制模型在模仿参考网页结构的同时,改变其视觉,避免千篇一律的机械模仿,生成具有独特辨识度的设计。

组合使用这三种输入,能有效收敛模型在审美上的随机发挥,让最终产出无限接近你的设计预期。下面是几组案例对比:

Material Design

结构线风格

我梳理了主流网站风格的介绍,方便大家在网站制作时进行灵感参考。

# **二.** 参考优质组件库

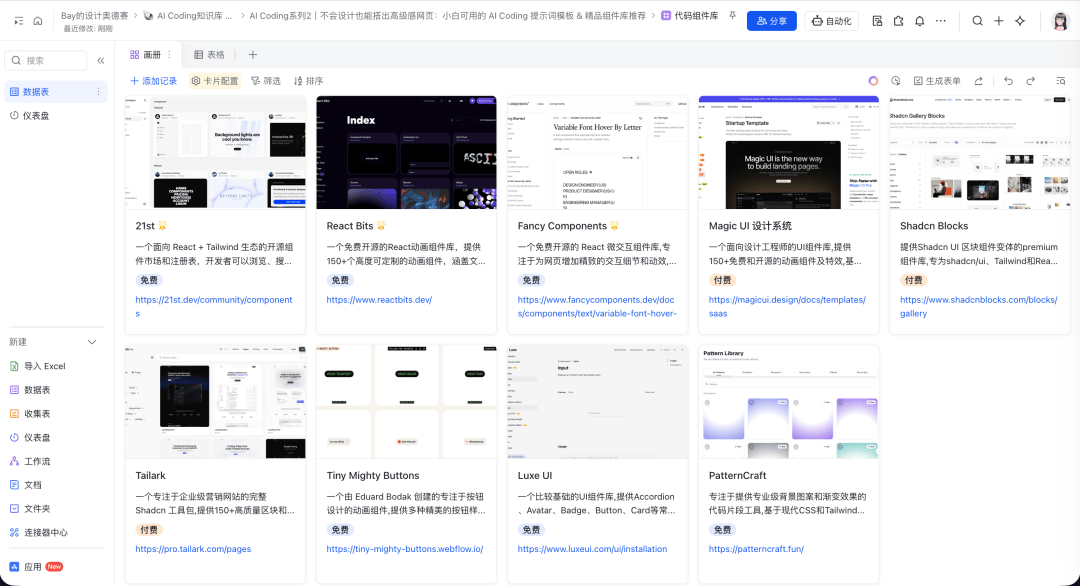

优质组件库通常包含经过大量产品验证的布局、动效与交互模式。把这些组件引入生成页面,可以让网页瞬间具备更专业、稳定的质感。我精选了一批优秀的代码组件库放在了多维表格中。

公众号后台回复关键词 **「网页高级感指南」** 即可获取。

下面我们来示范:在已经由 Gemini 3 生成基础页面的情况下,如何嵌入 21st.dev 的组件。

在使用组件时,关键是让它们的结构与页面现有样式尽可能自然融合。如果你只想借用动效逻辑,而组件本身的视觉风格与你的网站差异较大,也没关系—— 可以直接把原组件的代码复制给 AI,请它协助拆解与改写,让动效适配你的页面结构。

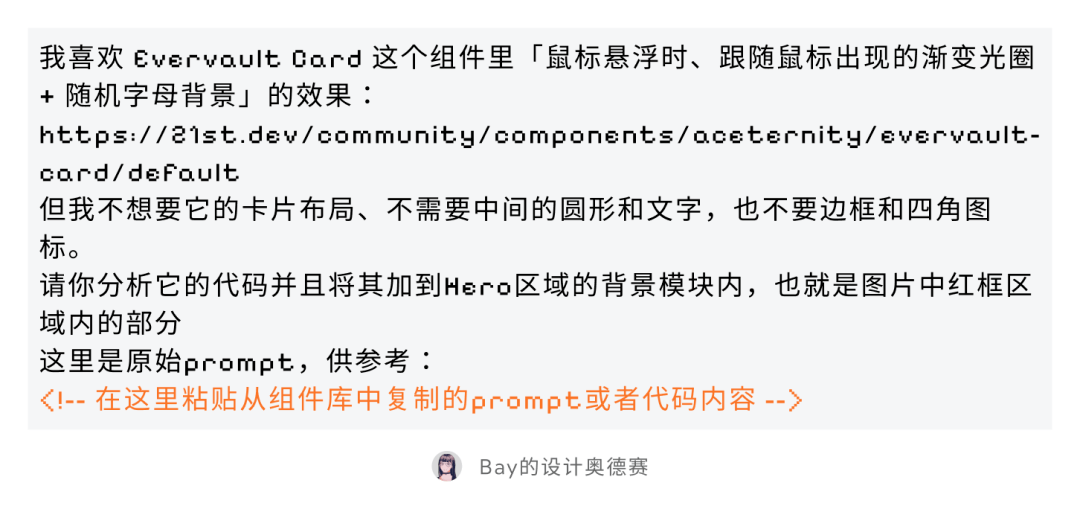

以上一节的结构线风格网站为例,我想在 Hero 区域引入一个「鼠标悬浮显现字母」的交互组件,如下图所示:

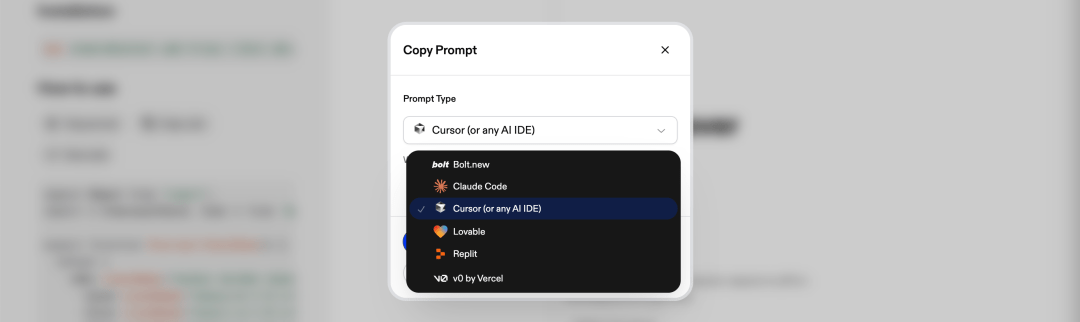

点开21st中的组件详情页,左侧「How to use」模块中,,你可以选择「Copy prompt」 或者 「Copy code」的方式进行组件使用,这里我选择了「Copy prompt」 可以选择不同代码工具。

值得注意的是,原始 Prompt 通常包含组件自带的样式定义。为了让它完美融入我的设计系统,我在投喂给 AI 之前添加了额外指令,要求代码工具剥离原组件的视觉样式,仅保留核心交互逻辑:

将这段 Prompt 输入代码工具后,AI 迅速修改了代码,很快就实现了初步效果。

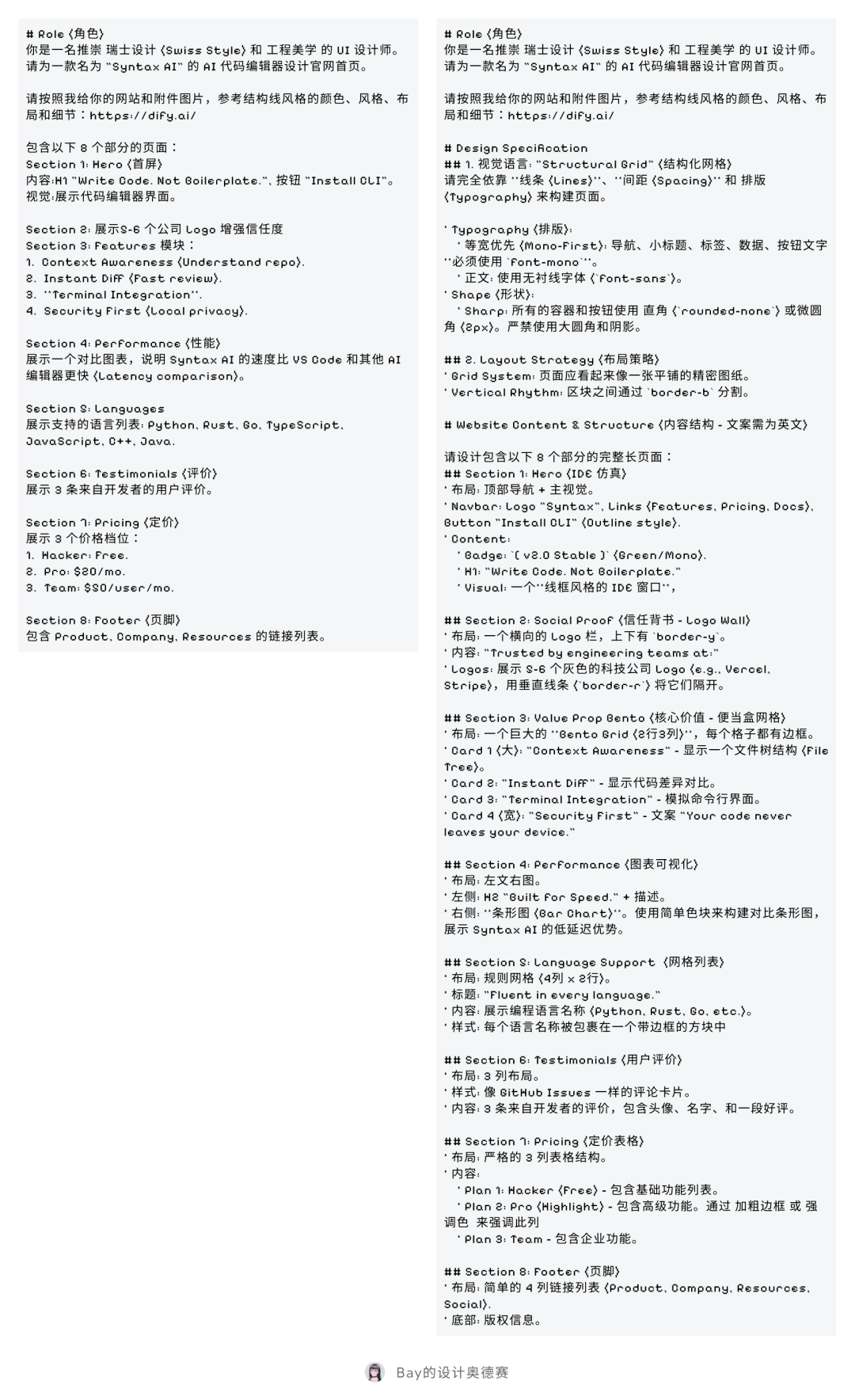

# 三.优化设计需求,让模型掌握视觉重点

当我们做的是实际项目,页面中需要呈现的内容往往是最先确定好的,此时我们可以将需求描述发给 Gemini 3 Pro,借助模型强大的联想能力,帮助我们清晰撰写一篇包含功能、设计要求的Prd,模型可以帮我们主动标记页面重点,甚至主动规划模块中的布局方式,而这样的提示词可以帮助模型生成网页时清晰理解不同文本、内容结构关系、了解页面的视觉重心。

两个版本的提示词及生成效果对比,可以看到,右侧对风格加入了更明确的页面元素与风格指令,在页面的结构线背景、配图细节等方面,效果明显更好。

那么如何获得右侧的提示词呢?我们可以将初版需求和以下Prompt一起发送给Gemini 3 Pro,让Gemini帮忙优化。

不过需要强调的是,在模型能力极大增强的今天,Prompt 的作用只是锦上添花。写的越多不等于效果越好。过于冗长、琐碎的指令反而会增加模型的认知负担,降低核心指令的权重,导致模型顾此失彼。因此精准远比冗长更重要。保持克制,从简单的指令开始,只增加必要约束。

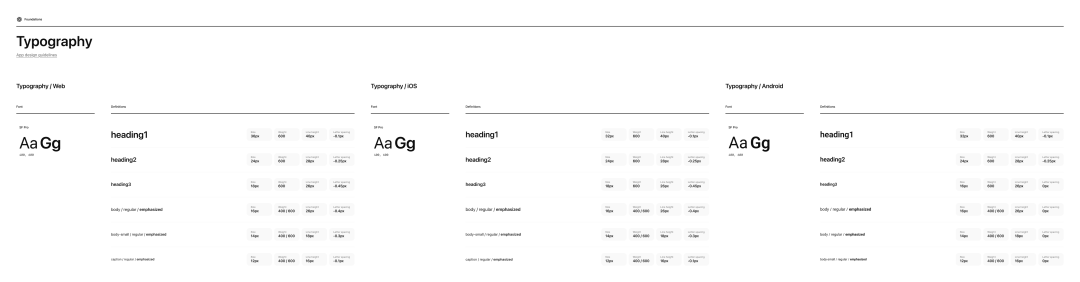

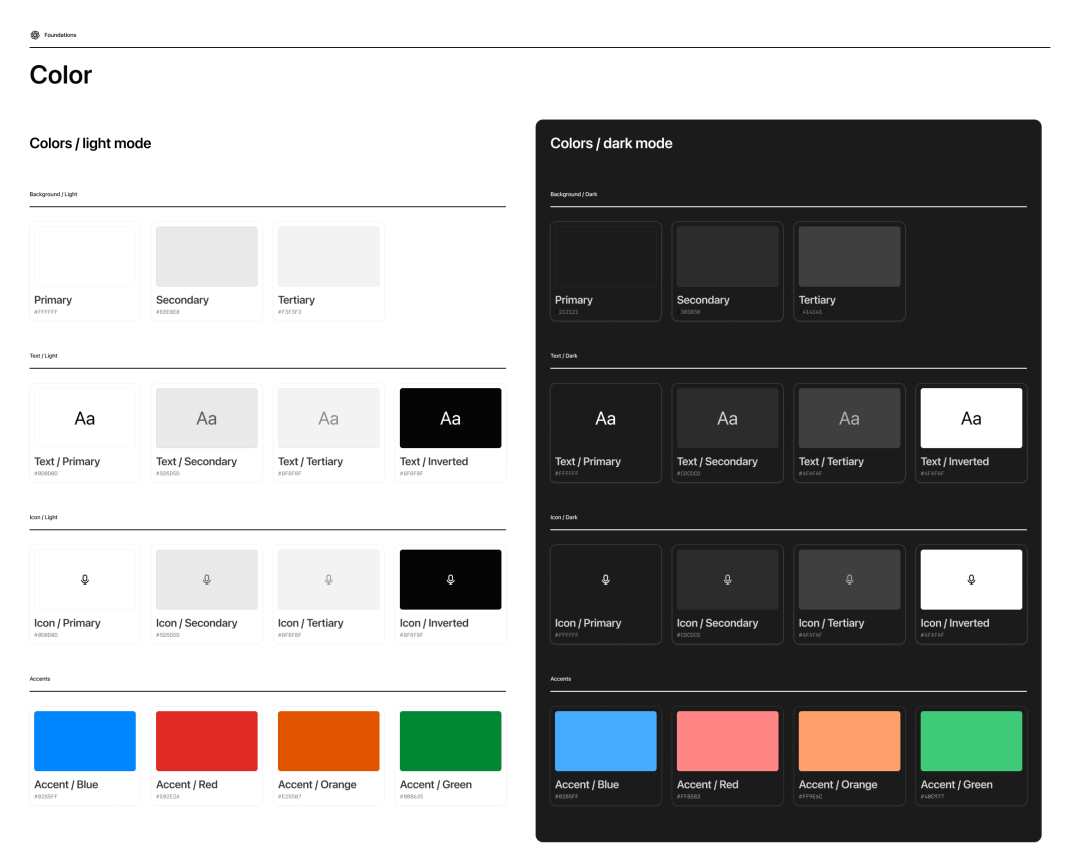

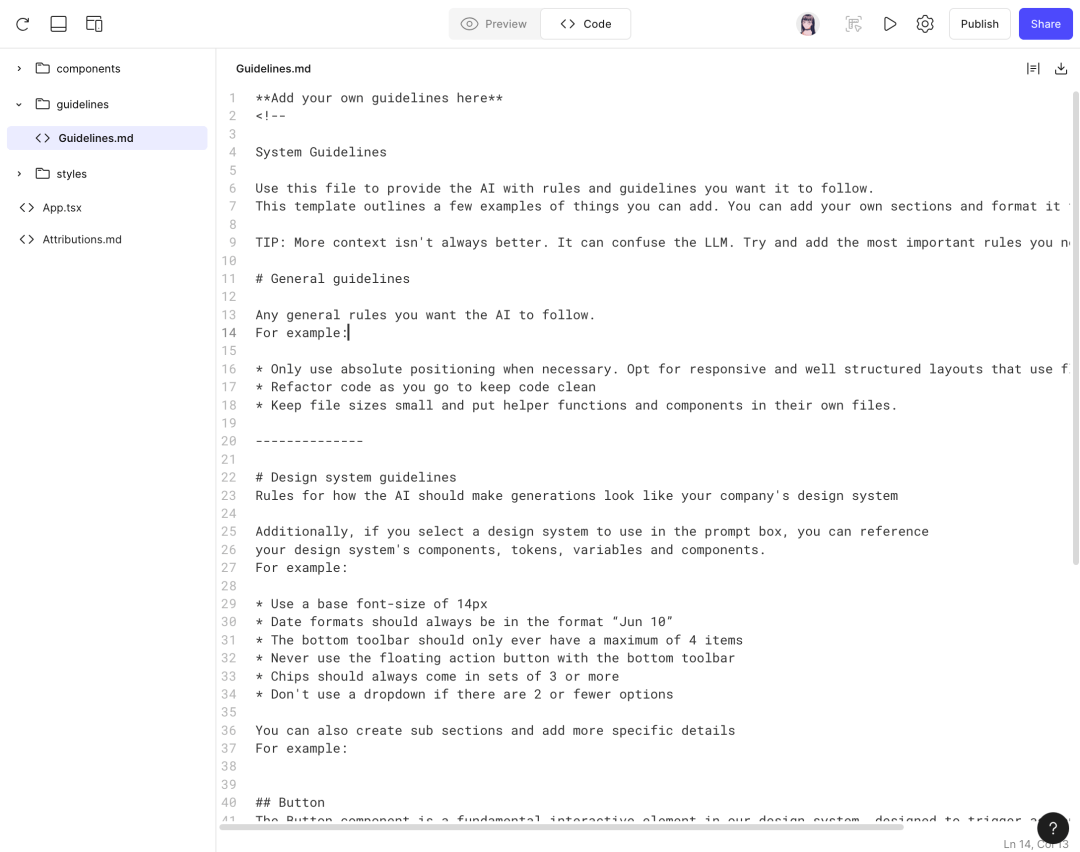

# 四.用.md规范管理多页面风格一致性

## 形成规范的重要性

假设此时你已经从上述流程得到了一个不错的网页效果,但你想开发一套拥有多个页面的大型项目,那么设计规范的统一管理就相对重要了 —— 如果只是简单让AI 复用其他页面的设计样式,AI产出的结果在不同页面的用色、字号、间距有可能会出现差异,导致整体观感不统一。

我们需要将隐性的视觉显性化为设计需求文档。你可以直接向 AI 提要求,得到包含所有细节特征的.md 文档,同时,使用Markdown 有助于模型区分指令、上下文和任务。

传统大型项目需要由设计师整理 Design Token

这种做法是有迹可循的,例如 Figma Make 在生成 Web app 时,会优先读取 `guidelines`文件夹里的内容,从 `Guidelines.md` 开始,把其中的文字当作额外上下文和约束。

Figma Make 的官方规范模板

## 让 AI 总结设计规范

那么,我们需要让AI帮忙建立的设计规范应该包含哪些维度呢?

其实很简单,只需要提取出核心的设计变量:

- **色彩系统 (Colors)** :主色、辅色、背景色、边框色(最好对应 Tailwind 类名);

- **排版系统 (Typography)** :标题、正文的字号与行高;

- **组件质感 (Components)** :圆角大小 (Radius)、阴影 (Shadow)、边框厚度;

- **布局间距 (Spacing)** :常用的内边距 (Padding) 和 间隙 (Gap)。

下面我们给出一个 Prompt 模板,你可以拿去输入给 Coding工具,让其将网站详细的设计规范总结成设计需求文档,并方便复用在其他页面中。

以上提到的所有提示词都可以在公众号后台回复关键词 **「网页高级感指南」** 访问原文获取。

我们将这个提示词输入给AI,很快文档就写好了

然后我们便可以让AI参考 **Design System.md** 文件进行Pricing页面生成,可以看到设计细节是基本一致的。

# 结语

到这里,我们已经掌握了生成高级感网页的组合拳,相信你已经迫不及待去生成自己的网页了。

不过,要让你的产品从Demo升级为具有独立灵魂的产品,我们需要了解更具体的设计规则,在此基础上根据目标人群与品牌调性,做出更明确的设计决策。

这时候,你该如何精准地发号施令去微调设计细节?这就需要一点点专业的设计知识来兜底。

下周,本系列将迎来最终章 ——《AI 编程颜值急救课》,我将介绍设计师压箱底的字体、配色与排版知识。那我们下篇见啦!

[^12]: # 将 SVN 仓库迁移到 Git

## **背景说明**

SVN(Subversion)是一个集中式的版本控制工具,与Git相比,其劣势明显:

- SVN的集中式管理限制了广泛参与,仅少数特权用户能协同编辑,难以满足开源社区的开放需求。

- SVN的提交须经服务器,网络依赖重、效率低,且缺失代码审核机制,质量难以保证。

## 参考方案

Git已成为主流的版本控制系统,转向Git前,建议您先明确迁移范围,根据需求挑选最佳的迁移方案。

### 方案一:仅需要迁移SVN的最新数据

如果仅需要迁移SVN的最新数据,不需要迁移SVN的提交历史记录,那么迁移操作非常简单。只需要 `svn` 和 `git` 两个工具即可完成迁移,操作如下。

- 使用以下命令从SVN仓库检出最新文件到本地工作区:

```bash

svn checkout <SVN_URL>

```

- 在本地工作区执行以下命令,完成本地Git仓库的初始化:

```bash

git init

```

- 编辑 `.git/info/exclude` 文件,添加 `.svn` 等条目以便忽略工作区中的SVN管理目录:

```bash

echo ".svn" >> .git/info/exclude

```

- 执行以下命令创建Git提交:

```bash

git add -A

git commit -m "Initial commit from SVN"

```

- 在远程Git服务器上创建代码仓库,假设仓库地址的示例地址为 `<URL>`。

- 执行以下命令将本地工作区和远程仓库地址相关联:

```bash

git remote add origin <URL>

```

- 执行以下命令将本地Git仓库的分支推送到远程仓库中:

```bash

git push -u origin HEAD

```

该迁移方式和普通Git仓库推送服务端一致,不再赘述。

### 方案二:需要迁移 SVN 的全部历史

如果需要迁移SVN的历史提交,或者需要迁移多个分支和标签,则需要安装和使用 `git-svn` 实现 SVN仓库到Git仓库的迁移。

作为Git的一条子命令,`git-svn` 可以桥接远端的SVN仓库和本地的Git仓库,允许用户使用Git操作远端的SVN仓库。

`git-svn` 支持如下操作:

- 使用以下命令将远程的SVN代码仓库克隆到本地Git仓库:

```bash

git svn clone <SVN_URL>

```

- 使用 Git 命令在本地工作区中创建提交。

- 使用以下命令将本地的Git提交推送到SVN仓库上,创建SVN提交:

```bash

git svn dcommit

```

- 使用以下命令持续从SVN仓库同步提交到本地仓库:

```bash

git svn fetch

```

借助 `git-svn`,SVN仓库的完整历史将无损转为Git仓库,让迁移与协作更加流畅。

**针对方案二,迁移操作具体流程如下:**

1. **安装 git-svn**

Git的内置子命令 `git-svn` 和其他的子命令不同,不是编译后的原生可执行程序,而是一个Perl脚本,在运行时依赖svn的perl模块。

1. 以Ubuntu操作系统为例,首先安装Git和svn:

```bash

apt-get install git subversion

```

2. 单独安装 `git-svn` 和svn的perl模块:

```bash

apt-get install git-svn libsvn-perl

```

2. **探测 SVN 仓库布局**

SVN通过简单目录拷贝即可创建分支,灵活性极高,连不同版本或不完整的文件树也能变身分支。但这种混合管理策略,让自动化识别仓库中的分支变得棘手,极具挑战性。

要从SVN仓库的目录结构布局推测其分支和标签设置,以及主干分支和其他分支、标签的映射方式,关键在于理解SVN的标准目录结构及其含义。

- #### SVN 仓库标准目录结构

SVN 仓库通常采用以下标准目录结构:

/项目根目录

├── trunk

├── branches

│ ├── feature-1

│ ├── feature-2

│ └── ...

├── tags

│ ├── v1.0.0

│ ├── v1.1.0

│ └── ...

- trunk:主干分支,存放项目的主开发线。

- branches:存放各个功能分支或开发分支。

- tags:存放各个版本的标签,通常用于标记发布版本。

- #### **查看 SVN 仓库的根路径**

使用 `svn info` 命令可以查看给定地址的SVN仓库的根路径和其他信息。

```bash

svn info https://example.com/svn/repo/trunk

```

以下是一个示例脚本,用于查看SVN仓库的根路径,并根据目录结构猜测分支和标签的设置:

```bash

#!/bin/bash

# 输入 SVN 仓库 URL

SVN_URL="https://example.com/svn/repo"

# 获取 SVN 仓库信息

svn_info=$(svn info "$SVN_URL")

# 提取根路径

root_path=$(echo "$svn_info" | grep '^Repository Root:' | awk '{print $3}')

# 输出根路径

echo "SVN 仓库根路径: $root_path"

# 检查 trunk 目录

trunk_url="$root_path/trunk"

if svn info $trunk_url &> /dev/null; then

echo "主干分支 (trunk) 存在于: $trunk_url"

else

echo "未找到主干分支 (trunk)"

fi

# 检查 branches 目录

branches_url="$root_path/branches"

if svn info $branches_url &> /dev/null; then

echo "分支目录 (branches) 存在于: $branches_url"

else

echo "未找到分支目录 (branches)"

fi

# 检查 tags 目录

tags_url="$root_path/tags"

if svn info $tags_url &> /dev/null; then

echo "标签目录 (tags) 存在于: $tags_url"

else

echo "未找到标签目录 (tags)"

fi

```

执行以下命令查看仓库的根路径及目录结构:

```bash

svn ls https://example.com/svn/repo/

```

在SVN转换Git仓库时,要通过参数将仓库布局提供给 `git-svn`,以便将分支和标签正确导出。

其他的布局方式如下:

- 无分支、无标签的主干模式:SVN仓库的根目录即为项目主干。

- 多项目模式:SVN仓库的一级目录作为项目名,每个项目有自己特定的仓库布局。

3. **建立 SVN 和 Git 之间的作者名称映射**

SVN使用服务端ID作为提交者,而Git允许客户端自定义提交者,含全名和邮箱。

- 在 `git-svn` 转换时,建议提供SVN到Git用户的映射文件,每行记录映射关系,示例如下:

```

# 格式:SVN用户名 = Git用户名 <邮箱>

loginname = Joe User <user@example.com>

```

- 执行以下命令获取SVN仓库全部提交的用户名列表:

```bash

svn log -q https://example.com/svn/repo/

```

### **初始化本地 Git 仓库**

创建一个本地工作区目录,进入到目录中:

执行 `git svn init` 命令将本地工作区初始化为一个Git仓库。

- 对于**无分支的SVN仓库**,使用以下初始化命令:

```bash

git svn init https://example.com/svn/repo

```

- 对于**标准布局的SVN仓库**(包含trunk、branches、tags目录),使用以下初始化命令:

```bash

git svn init -s https://example.com/svn/repo

```

- 对于**非标准布局的SVN仓库**(例如目录名大小写与标准布局有差异),使用以下初始化命令:

```bash

git svn init -T Trunk -b Branches -t Tags https://example.com/svn/repo

```

### **拉取远程 SVN 仓库同步**

执行 `git svn fetch` 命令与远程SVN仓库数据同步,将远程仓库获取到本地并转换为Git提交。如果有SVN/Git 作者映射文件,如文件 `authors.map`,需在命令行中提供。

- 同步**全部历史提交**:

```bash

git svn fetch -A /path/of/authors.map

```

- 同步**某个范围的提交**(例如从r0到r100):

```bash

git svn fetch -A /path/of/authors.map -r 0:100

```

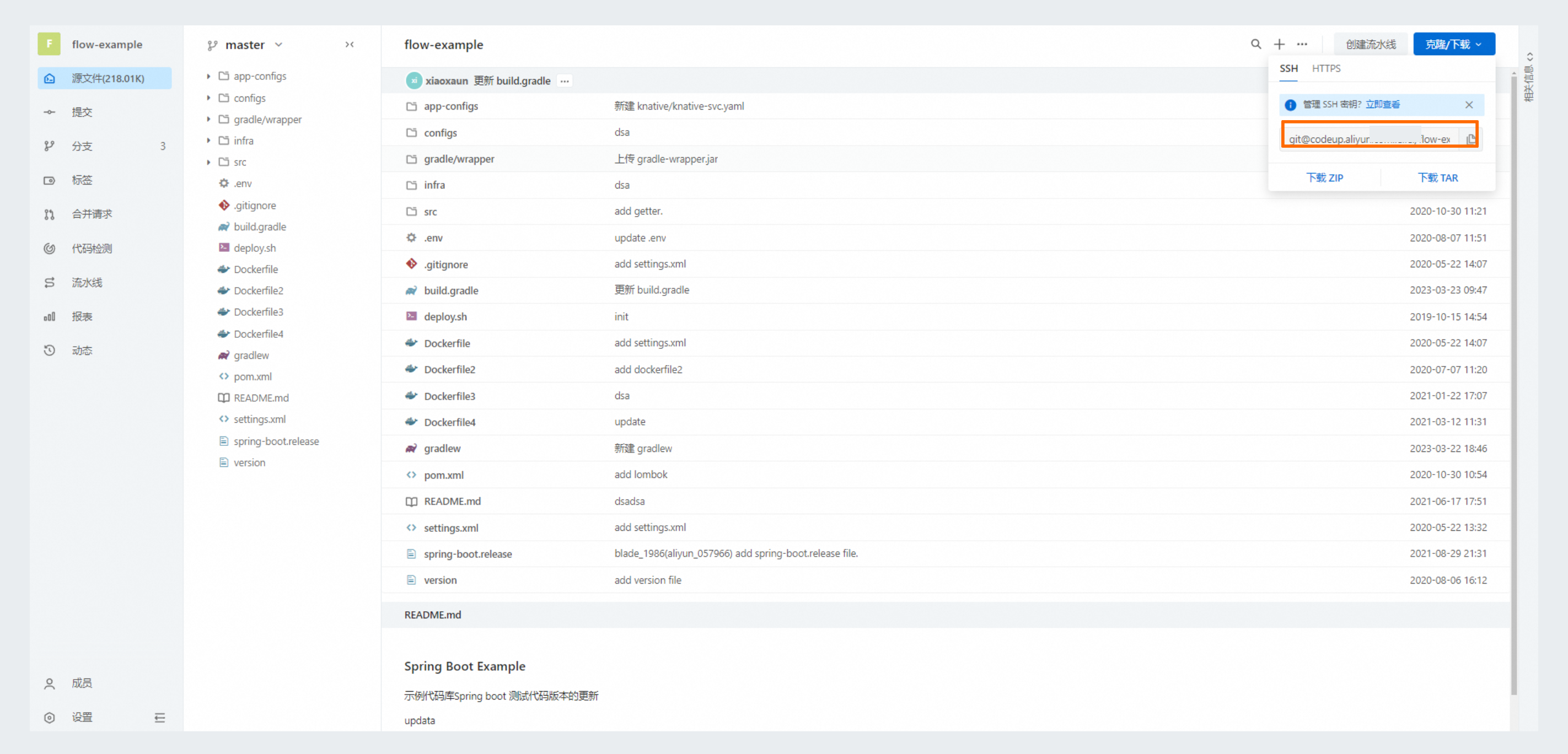

### **推送到远程仓库**

在云效的服务端创建Git仓库,用于保存转换后的结果。

1. 创建仓库操作,请参见[新建第一个代码库](/uploads/shares/4/assets/笔记同步助手/attachments/新建第一个代码库-20260203112422-knnvpuy)。

2. 在服务端页面获取Git库地址。

**说明**

请不要在新库上创建任何分支、标签以及文件,确保其为空仓库,否则可能因为强制推送问题导致迁移失败。

示例Git仓库地址:

https://codeup.aliyun.com/$group/repo.git

使用以下命令添加远程源,避免与 `git-svn` 源重名:

```bash

git remote add target https://codeup.aliyun.com/$group/repo.git

```

迁移后,SVN仓库变身Git仓库,分支标签一键转换。迁移完成,SVN分支标签即转为Git跟踪分支和标签。推送时,SVN布局决定推送方式。

1. 对于**无分支**和**标签的SVN仓库**,仓库的主干分支映射为 `refs/remotes/git-svn`,使用以下命令将其推送到目标Git仓库的 `master` 分支(或 `main` 分支):

2. 对于**标准布局的SVN仓库**,其分支和标签混杂在一起。首先使用以下命令重命名标签,以便本地跟踪分支和标签有不同前缀,便于区分:

```bash

git push target \\

--tags \\

refs/remotes/origin/trunk:refs/heads/master \\

"refs/remotes/origin/*:refs/heads/*"

```

然后执行以下命令将本地仓库的分支和标签推送到目标Git仓库:

```bash

git for-each-ref --format="%(objectname) %(refname:lstrip=4)" \\

"refs/remotes/origin/tags/*" |

while read oid tag; do

git update-ref "refs/tags/$tag" "$oid" &&

git update-ref -d "refs/remotes/origin/tags/$tag"

done

```

[^13]: # 这 6 个超神的 SKills,在 GitHub 上杀疯了。

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260203155148-3i66z3f)

## 正文

公众号名称:逛逛GitHub

作者名称:逛逛

发布时间:2026-02-03 15:05

01

**视频制作:Remotion Skill**

**不知道大家有没有用过 Remotion 这个开源项目,现在也有 2.8 万的 Star 了。**

**之前我想做视频生成自动化的时候,了解过 Remotion。它其实是一个用 React 编程来制作视频的框架。**

**比如下面这种视频,都可以使用** ****Remotion 框架制作。****

**最近 AI Skill 大火,Remotion 团队就推出了 remotion skills。**

**这个给 AI Agent 使用的技能包,可以教会 AI 如何正确、准确地使用 Remotion 框架来制作视频。**

**比如下面这个视频,没有使用任何剪辑工具。就是使用** ****remotion skills + Claude Code 来生成的:****

下面就是使用 remotion skills 生成上面这个视频的演示:

如果有条件,可以去 X 上看看,现在很多网友开始使用 remotion skills 来制作各种各样花里胡哨的视频了。

这个开源的 skill 确实指的单独一篇文章,有空详细讲讲。

你可以通过下面命令安装这个 skill:

```

npx skills add remotion-dev/skills

```

**原理其实是将 Remotion 的官方文档、API 规范和最佳实践封装成 AI 可读取的 Context,让 AI 成为更懂 Remotion 的视频制作助手。**

```

开源地址:https://github.com/remotion-dev/skills

```

02

**YouTube 视频剪辑 Skill**

Youtube-clipper-skill 是 AI 大佬开源的一个 YouTube 视频剪辑 Skill。

丢个 YouTube 的链接,它能自动完成环境检查、下载、语义分析、剪辑以及生成双语字幕文件,可以从长视频中提取精华片段。

它不是机械地按时间切割视频,而是利用 Claude 的 AI 能力对视频字幕进行语义分析,自动生成有用的视频切片。

这个开源项目项目集成了 yt-dlp 和 FFmpeg 底层工具,能够实现高质量的视频下载与处理。

它具备强大的字幕处理能力,支持将字幕批量翻译为中英双语格式,并能将双语字幕录入视频画面中。

翻译功能进行了优化,通过批量处理能显著减少 API 调用次数并提升翻译一致性。

而且它能够自动生成适用于小红书、抖音或微信等平台的视频摘要和素材。

```

开源地址:https://github.com/op7418/Youtube-clipper-skill

```

03

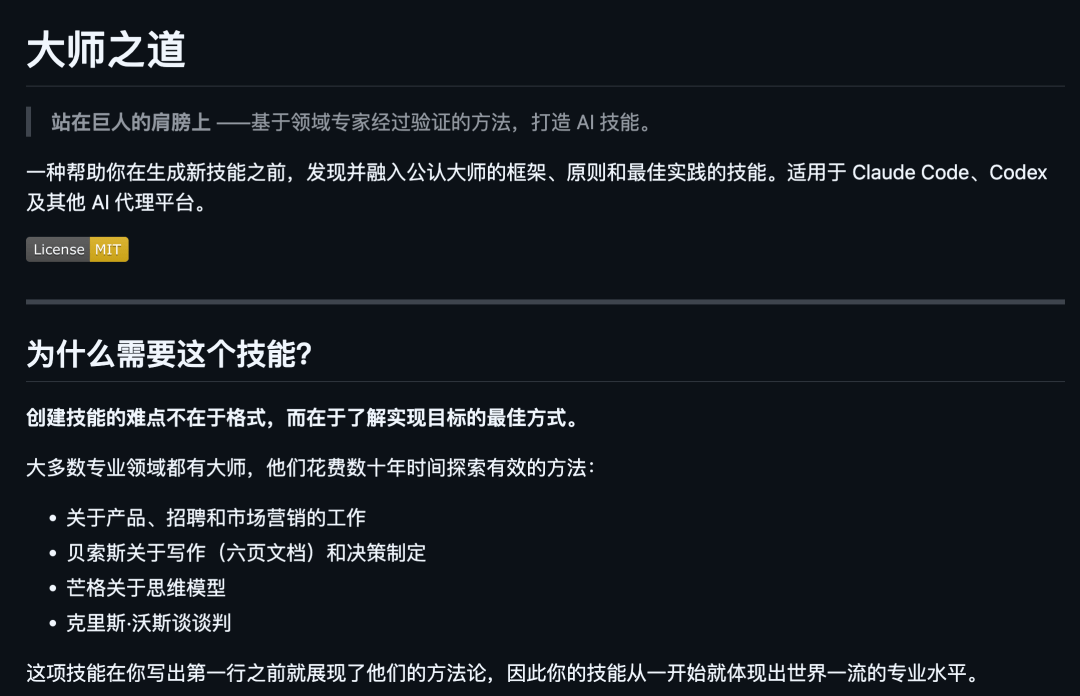

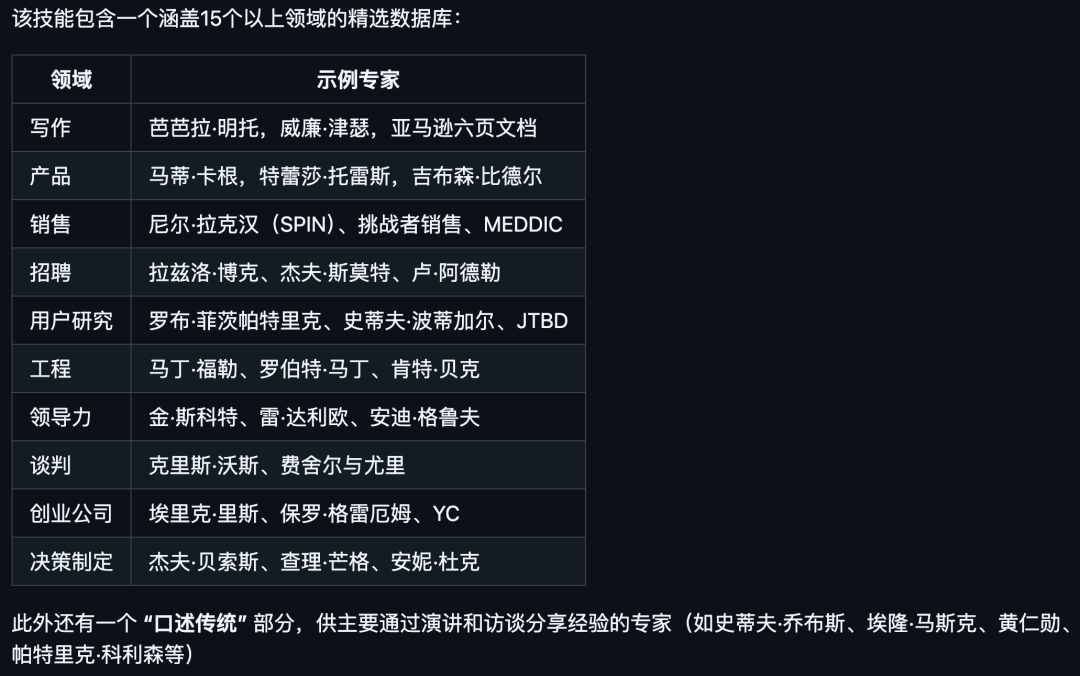

**skill-from-masters**

这个挺有意思的,它能帮你创建 Skill。

在创建新 Skill 之前,会先搜索,寻找目标领域的顶级专家的思维模型和最佳实践,确保生成的 Skill 具备专业深度。

这个开源项目采用三层搜索架构:

首先查询本地专家数据库,其次进行网络搜索以补充更多专家观点,最后深入查找一手资料并交叉验证。

它不仅寻找黄金范例作为输出标准,还会识别该领域的反面模式以避免常见错误,从而生成高质量、专业度极高的 Skill 指令。

除了从专家处学习,该仓库还包含一个 skill-from-github 功能。

你可以指定优秀的 GitHub 开源项目,让 AI 深入阅源码和文档,提取其中的算法逻辑或设计模式,并将其转化为一个独立的 Skill,还挺有用的。

```

开源地址:https://github.com/GBSOSS/skill-from-masters

```

04

**NotebookLM Skill**

这个开源 Skill 能让 Claude Code 直接与 Google NotebookLM 进行交互。通过连接 NotebookLM ,让 Claude 能够基于你上传的知识库回答。

这个项目会在本地运行一个独立的 Python 环境,利用 Patchright(基于 Playwright)技术实现浏览器自动化操作。

它模拟用户登录 Google 账号并操作 NotebookLM 界面,实现了持久化认证和库管理。

说白了,装了这个 Skill 不用再浏览器和命令行之前反复的复制粘贴了。

你可以直接在命令行里面通过自然语言查询自己的知识库,Claude 会自动从 NotebookLM 获取经过综合处理的答案。

```

开源地址:https://github.com/PleasePrompto/notebooklm-skill

```

05

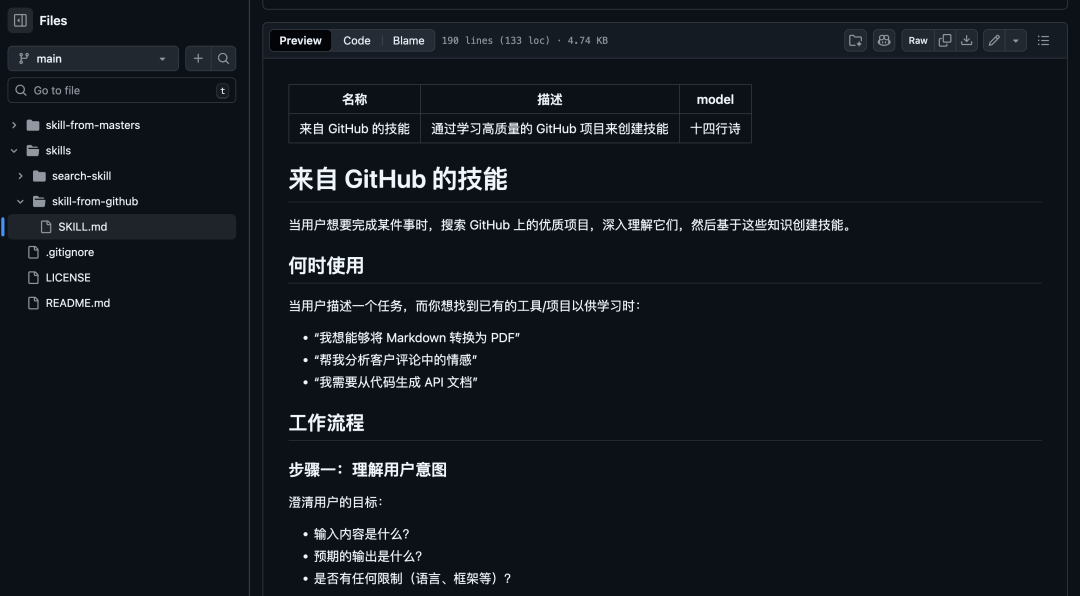

**Markdown 文章一键发布到 X**

这个 Skill 可以把本地 Markdown 文章一键发布到 X 上。

X 平台自带编辑器对 Markdown 支持不好,经常排版丢失,手动插入图片很繁琐。

用这个 Skill 通过 Claude Code 就能完成从文稿解析到草稿生成的全过程。

工具支持将 Markdown 的丰富格式完美转换为 X Articles 的 HTML 格式。

为了确保文章排版的精准性,这个工具引入了 Block-Index 定位技术。

在解析 Markdown 时,它会计算每张图片在文章结构中的精确位置索引,通过浏览器自动化脚本将图片精准插入到对应的段落之间,彻底解决了传统文本匹配方式容易导致的图片错位问题。

```

开源地址:https://github.com/wshuyi/x-article-publisher-skill

```

06

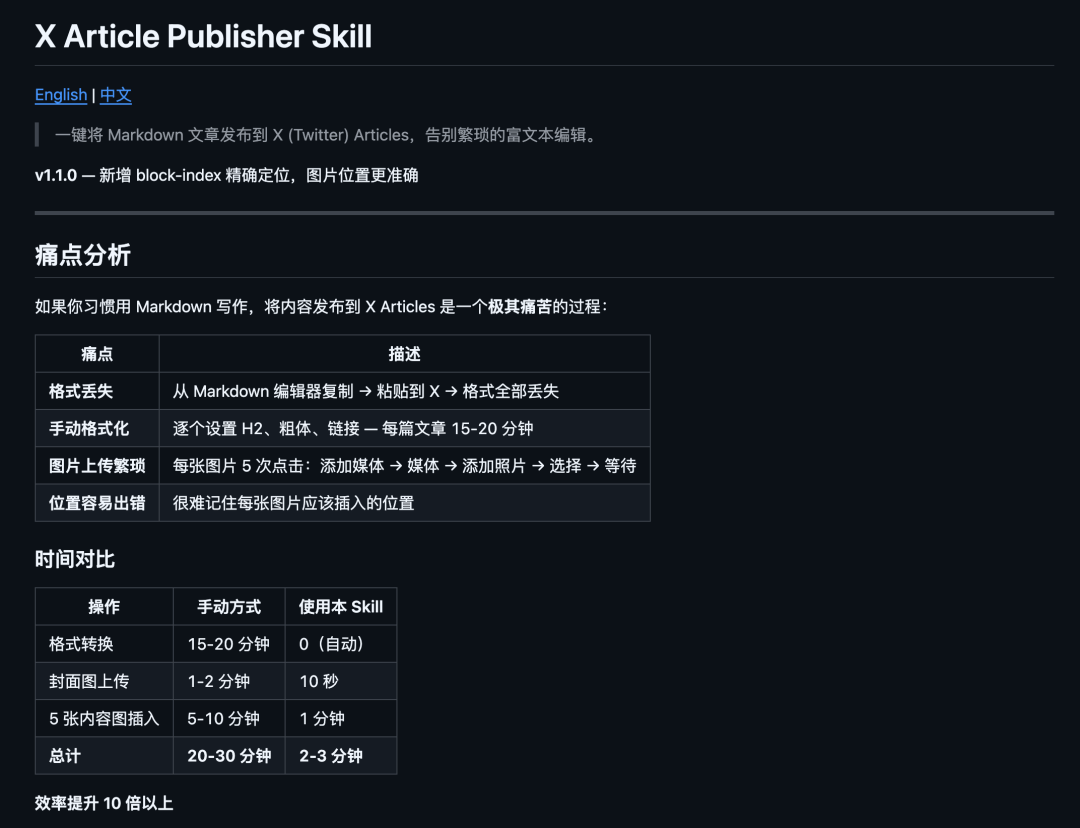

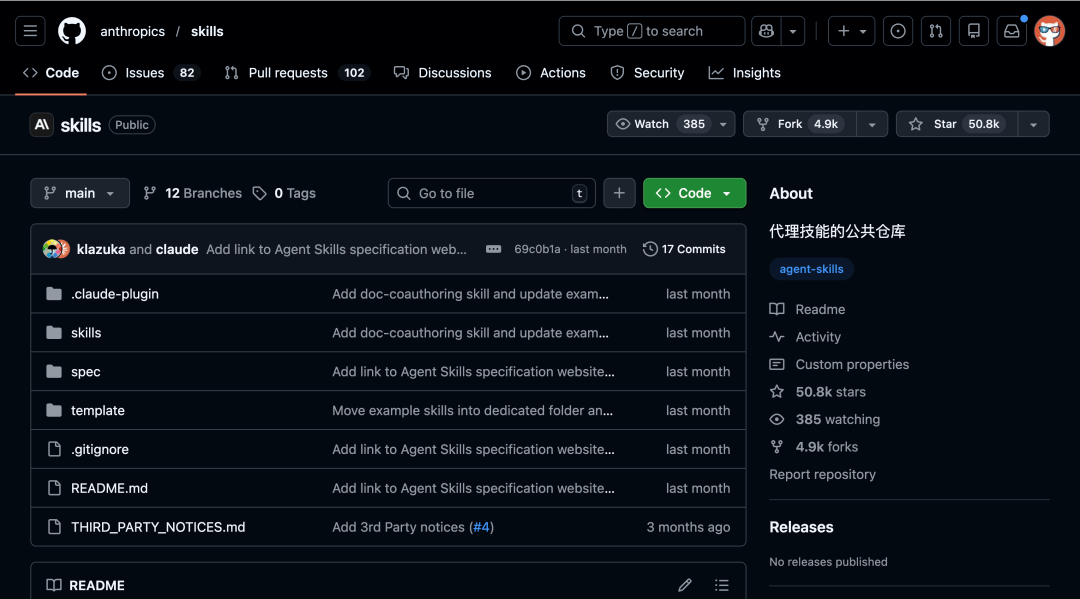

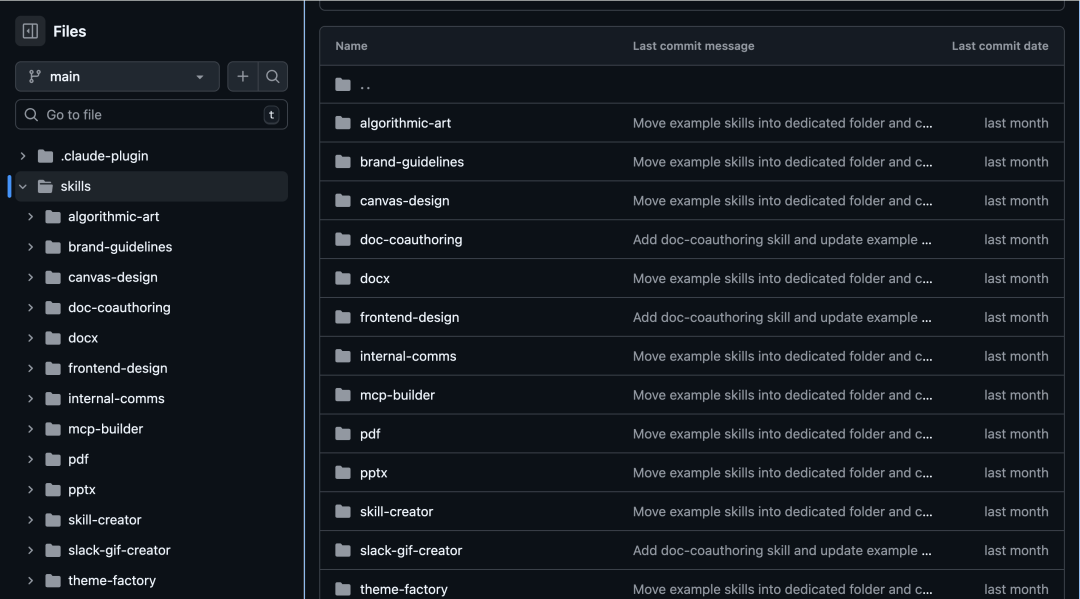

**Agent Skills 公共仓库**

这是 Anthropic 官方发布的 Agent Skills 公共仓库,定义了 Claude 的 Skill 标准,重点是里面有大量现成的 Skill。

这些 Skill 设计灵活,既可以在 Claude Code 中用,也可以集成到 Claude.ai 或通过 API 调用。

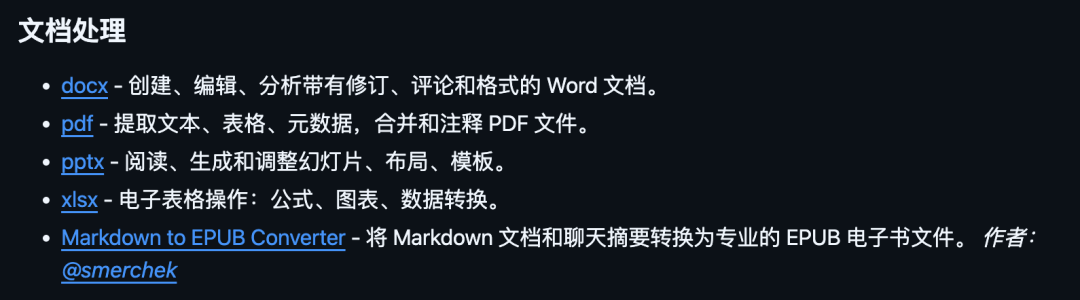

我看了一下,有很多 Skill 还是非常实用的。

比如文档处理,强大的 PDF、Word、Excel、PPT 处理能力,都有对应的 Skill。

mcp-builder 可以辅助你创建高质量的 MCP Server,artifacts-builder 能使用 React、Tailwind CSS 和 shadcn/ui 组件库构建复杂的 HTML 交互式界面。

还有很多很多,感兴趣去瞧瞧吧。

```

开源地址:https://github.com/anthropics/skills

```

07

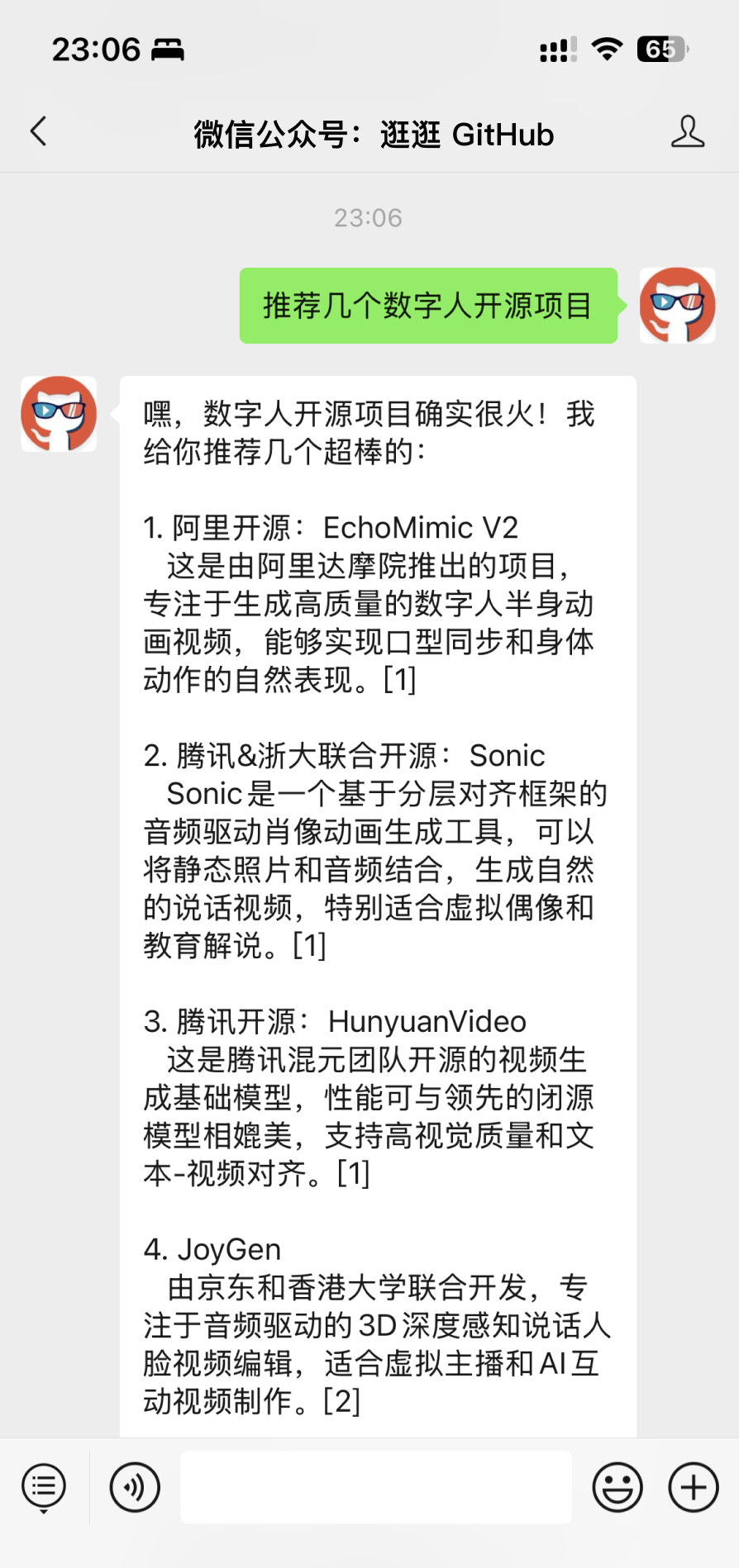

**点击下方卡片,关注逛逛 GitHub**

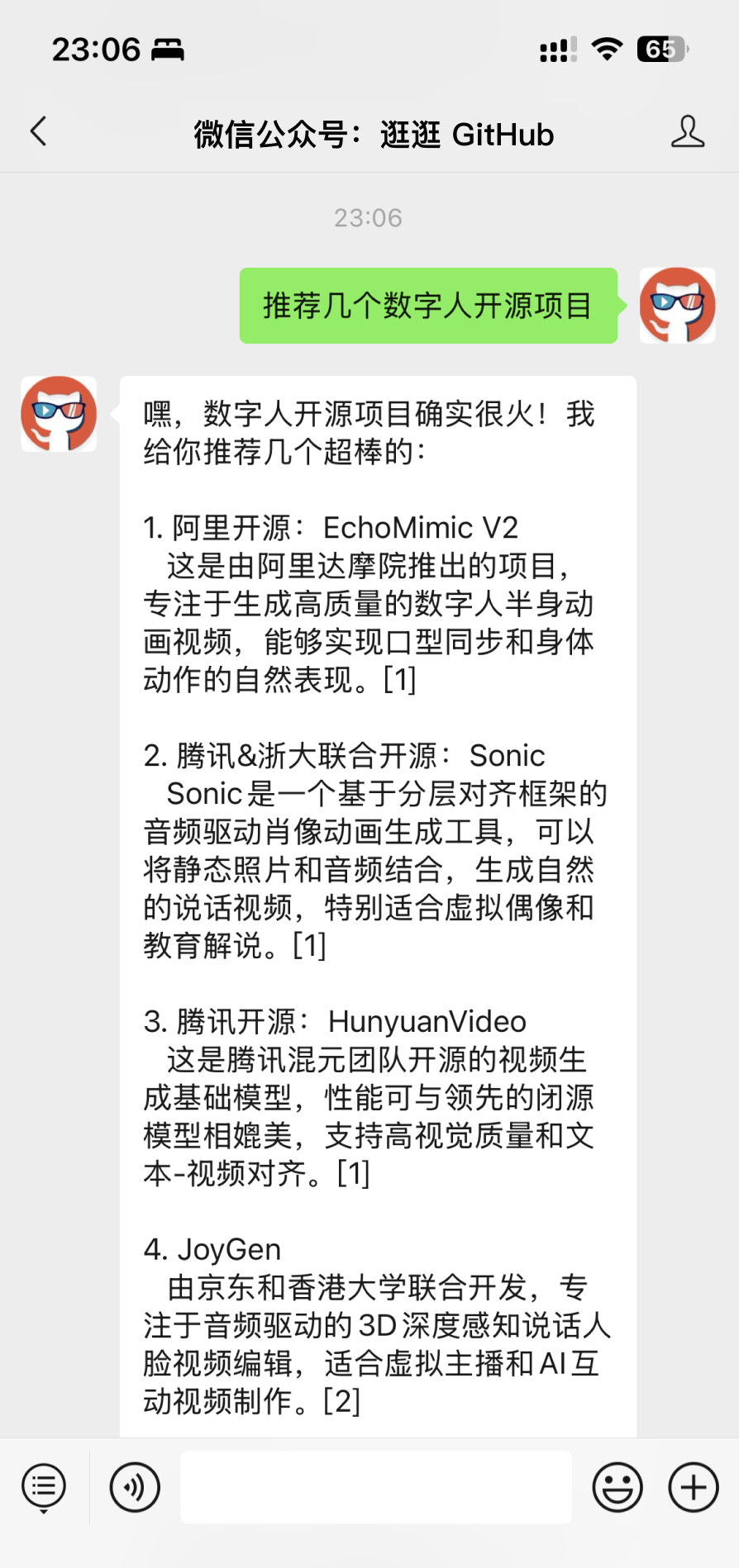

这个公众号历史发布过很多有趣的开源项目,如果你懒得翻文章一个个找,你直接关注微信公众号:逛逛 GitHub ,后台对话聊天就行了:

[^14]: # 系统接口突发慢速的系统化排查思路与实战指南

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260204123724-jhn88fv)

## 正文

作者:托尼学长1

发布日期:未知

## 前言

在面试或实际运维中,常会被问及“系统中接口突然变慢该如何排查”。在给出答案前,先明确是“全部接口”都变慢,还是仅有“某个特定接口”出现性能下降,这一点至关重要,因为两者的排查路径截然不同。

## 一、全部接口普遍变慢的排查思路

### 1\. 划分风险边界:外部还是内部

首先判断性能下降是由外部流量异常还是内部资源瓶颈引起。

- 外部风险:用户请求量突增。通过监控平台(如 Prometheus)观察 QPS(Queries Per Second)或 TPS(Transactions Per Second)曲线,若出现尖峰则可能是流量冲击导致的压垮。

- 内部风险:请求量未异常,需进一步分析系统内部组件。

### 2\. 内部问题深度划分

在确认是内部因素后,继续划分为数据库/中间件层与业务系统自身层。

- **数据库层**

1. 检查慢查询日志(MySQL、PostgreSQL 等)是否出现新产生的大量慢查询。

2. 使用监控指标(QPS、TPS、连接数、CPU、磁盘 I/O)判断数据库负载是否异常升高。

- **下游服务层**

通过 Grafana 查看下游依赖服务的响应时间(RT)曲线,判断是否出现整体延迟。

- **业务系统自身**

1. 监控内存使用情况,排查内存泄漏或 OOM。

2. 获取线程快照,使用阿里开源的线上诊断工具 *Arthas* 分析锁竞争、线程阻塞等。

3. 检查网络 I/O 与磁盘 I/O 是否达到瓶颈——常见原因包括单次返回数据过大、日志打印过多等。

4. 若近期上线了高 QPS 的业务入口,观察该入口的调用链是否因为业务逻辑过于复杂而拖慢整体。

### 3\. 通过监控定位根因

利用 Prometheus + Grafana 监控平台,查看不同接口的响应时间(Latency)曲线,识别最先出现异常的接口,即为问题的“元凶”。随后聚焦该接口所在的服务或资源进行细致排查。

## 二、单个接口变慢的排查思路

相对整体慢,单接口问题更容易定位。推荐使用 APM 工具(如 SkyWalking、CloudStart)结合链路追踪来确认瓶颈所在。

- 在调用链上标记每一步的耗时,快速判断是数据库查询、下游服务调用还是业务逻辑处理导致的延迟。

- 针对发现的慢环节,依据前文的数据库或系统排查步骤进行深入分析。

## 三、总结

排查系统接口慢的核心原则是**分层、分阶段、逐步缩小范围**:

1. 先确认是全局还是局部慢。

2. 再判断是外部流量异常还是内部资源瓶颈。

3. 随后在内部层面逐层检查数据库、下游服务、业务系统自身。

4. 借助监控、日志、链路追踪和诊断工具,定位根因并进行针对性优化。

切记不要盲目“东一锤子西一棒子”地排查,否则可能错失关键窗口,等到问题根源被定位时,已经“黄花菜都凉了”。[^15]: # 开源-一款专治“AI审美疲劳”的 UI-UX 设计技能包,支持跨平台、多框架一键生成专业级界面

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260206091359-9tiegzd)

## 正文

公众号名称:刘哥聊技术

作者名称:刘哥聊技术

发布时间:2026-01-24 12:39

在日常开发中,你是不是也遇到过这样的场景:

- • 你让 AI 帮你写一个 SaaS 产品的落地页,结果它交回来的界面虽然“能用”,但配色像调色盘打翻了,字体搭配毫无章法,交互逻辑还缺胳膊少腿。

- • 你反复调整提示词,来回沟通三四轮,发现还不如自己手写快。

- • 更头疼的是,不同项目之间风格不统一,今天是极简风,明天又冒出个“AI 紫渐变”,团队协作时根本没法对齐设计语言。

这其实不是 AI 能力不行,而是缺乏一套**结构化、可复用、行业适配的设计智-能**。普通提示词只能靠“猜”,而真正专业的 UI/UX 需要的是**系统化的决策引擎**,知道什么行业该用什么布局、什么品牌调性匹配什么色彩、哪些动效提升转化、哪些反模式必须避开。

那有没有一款工具,能让 AI 不再“自由发挥”,而是像资深设计师一样,**按照行业专业实践,自动生成完整、一致、可落地的设计方案**?

答案是:有。而且它已经开源。

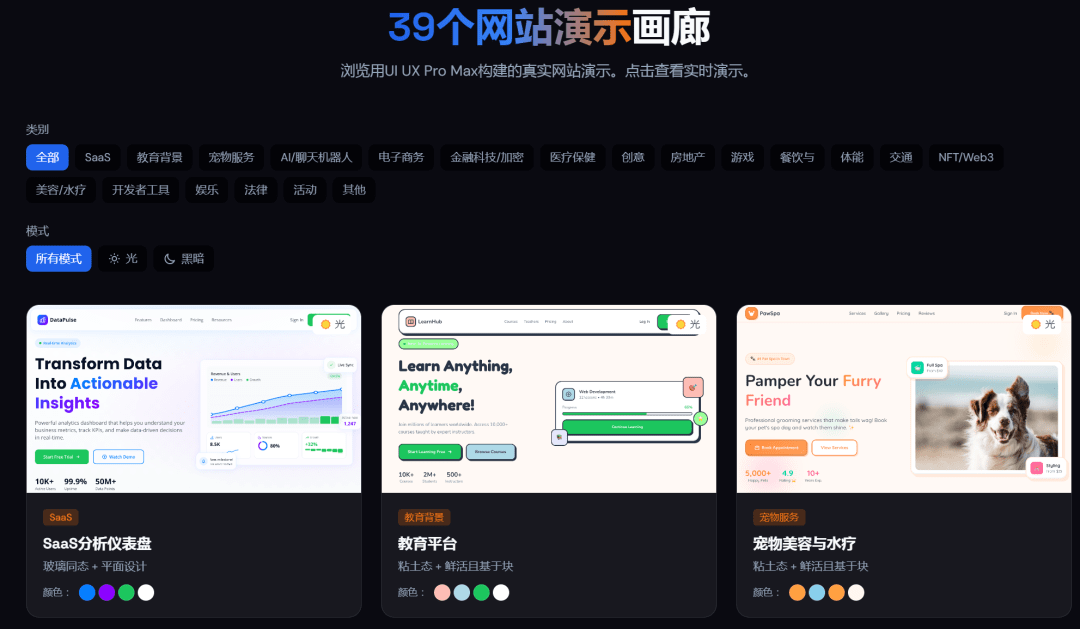

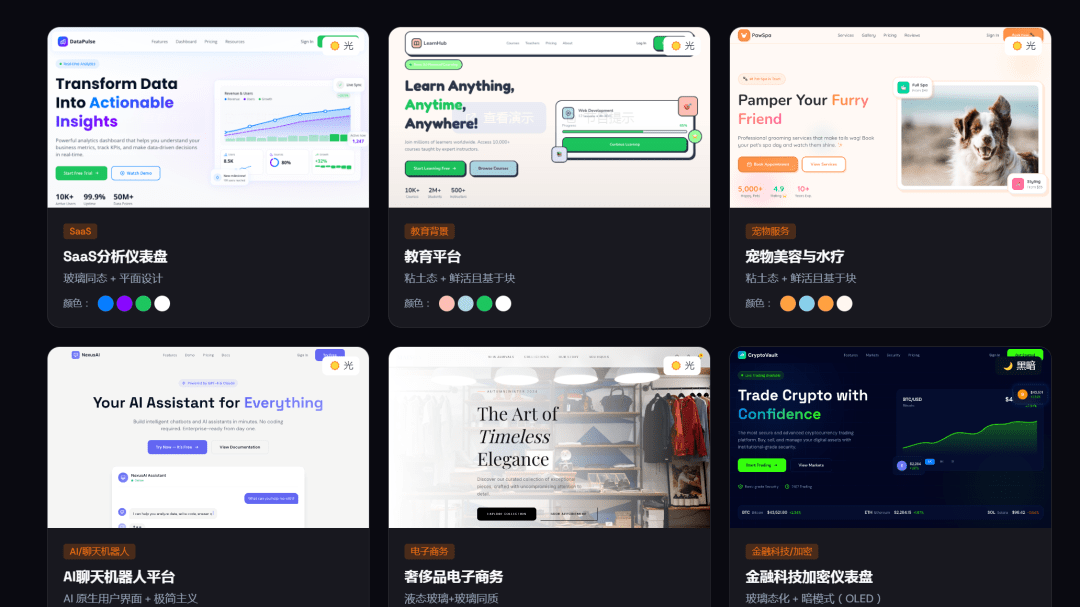

### 介绍

这款工具名叫 **UI/UX Pro Max Skill**,本质上是一个为 AI 助手(如 Claude、Cursor、Copilot、Trae 等)量身打造的“设计智-能插件”。它不是一个独立软件,而是一套**可嵌入任何 AI 编程环境的技能包(Skill)** ,专门处理“AI 生成界面太业余”的问题。

它的核心不是写代码,而是**先生成一套完整的设计系统**,包括页面结构、色彩体系、字体组合、交互规范、无障碍检查清单,甚至明确告诉你“哪些东西千万别用”。

换句话说,它把 UI/UX 设计师的经验,编码成了 AI 能理解的推理规则。

### 前端

前端输出默认基于 **HTML + Tailwind CSS**,这是目前轻量、易维护的组合。但如果你用的是 React、Vue、Svelte、Flutter 或 SwiftUI,也没问题,它内置了对 **13 个主流技术栈**的支持,只需在提示中提一句“用 Next.js 实现”或“生成 Flutter 代码”,它就会自动适配对应框架的专业实践。

更重要的是,它生成的代码**不是“能跑就行”** ,而是严格遵循:

- • 可访问性标准(WCAG AA)

- • 响应式断点(375px / 768px / 1024px / 1440px)

- • 交互反馈(hover、focus、cursor-pointer)

- • 动效节奏(200–300ms 平滑过渡)

- • 无 emoji 图标(强制使用 Heroicons/Lucide SVG)

这些细节,恰恰是普通 AI 容易忽略的“专业感”来源。

### 后端

严格来说,它没有传统意义上的“后端”。整个推理过程由本地 Python 脚本驱动,通过多路并行搜索(产品类型、风格、配色、排版、图表等),结合 **100 条行业特定规则**,输出结构化设计建议。

比如你输入“为美容水疗中心做官网”,它会自动匹配:

- • **页面模式**:Hero-Centric + Social Proof(突出主视觉+客户证言)

- • **色彩方案**:柔粉 #E8B4B8 + 鼠尾草绿 #A8D5BA + 金色 CTA

- • **字体组合**:Cormorant Garamond(优雅衬线) + Montserrat(现代无衬线)

- • **反模式提醒**:禁止使用霓虹色、硬动画、暗黑模式、“AI 紫渐变”

所有这些决策,都来自对真实商业案例的归纳,而非随机生成。

### 特点

- • **67 种 UI 风格**:从玻璃拟态、粘土风到新拟物、极简主义,覆盖主流审美趋势

- • **96 套行业配色**:SaaS、电商、金融、医-疗、美妆等专-属调色板

- • **56 组字体搭配**:全部来自 Google Fonts,可一键导入

- • **25 类仪表盘图表**:BI 场景也能智-能推荐

- • **98 条 UX 指南**:包含无障碍、动效、响应式等实践

- • **持久化设计系统**:支持生成 `MASTER.md` 全局规范 + 页面级覆盖文件,实现跨页面风格统一

实用的一点是:**它能自动规避“AI 味”设计**。比如明确禁止在银行类应用中使用紫色渐变,在健康类网站中禁用刺眼动画,这些正是人类设计师多年踩坑总结出的经验。

### 技术架构

整体采用 **“推理引擎 + 规则库 + 输出模板”** 的三层架构:

1. 1\. **输入层**:接收自然语言需求(如 “Build a landing page for my beauty spa”)

2. 2\. **推理层**:并行查询 5 个维度(品类、风格、色彩、排版、图表),通过 BM25 排序和 JSON 条件过滤,匹配最优组合

3. 3\. **输出层**:生成结构化设计系统(ASCII / Markdown 格式),并可直接驱动代码生成

整个过程无需联网(除非主动下载字体或图标),所有规则本地运行,保障隐私与速度。

### 部署方式

#### 前端

无需部署。生成的代码可直接集成到你的项目中。支持:

- • Web:HTML + Tailwind、React、Next.js、Vue、Nuxt、Svelte、Astro

- • 移动端:React Native、Flutter

- • 原生:SwiftUI(iOS)、Jetpack Compose(Android)

#### 后端

只需安装 CLI 工具或 Python 3.x:

```

npm install -g uipro-cli

uipro init --ai claude # 或 cursor/copilot/trae 等

```

然后在项目目录中调用:

```

/ui-ux-pro-max Build a landing page for my SaaS product

```

或者直接运行脚本生成设计系统:

```

python3 .claude/skills/ui-ux-pro-max/scripts/search.py "fintech banking" --design-system -f markdown

```

整个过程轻量、无依赖、适合嵌入现有开发流。

### 开源协议

项目采用 **MIT 开源协议**,这意味着:

- • 允许商用

- • 允许修改、分发、私有化部署

- • 无需公开衍生作品源码

- • ⚠️ 唯一要求:保留原始版权声明

对个人开发者、创业团队、企业项目都非常友好,无法律风险。

### 即刻体验一波

假设你要为一家高端水疗品牌“Serenity Spa”做官网,只需输入:

> Build a landing page for my beauty spa

>

AI 会立刻返回如下设计系统(简化版):

```

PATTERN: Hero-Centric + Social Proof

STYLE: Soft UI Evolution

COLORS: Primary #E8B4B8, Secondary #A8D5BA, CTA #D4AF37

TYPOGRAPHY: Cormorant Garamond / Montserrat

AVOID: Neon colors, harsh animations, dark mode, AI purple gradients

CHECKLIST: [✓] SVG icons [✓] Hover transitions [✓] WCAG contrast ≥4.5:1

```

接着,它会基于这套规范,生成完整的 HTML + Tailwind 代码,包含 Hero 区、服务介绍、客户评价、预约表单、联系方式五大模块,且每一处交互都经过 UX 验证。

你甚至可以保存为 `design-system/MASTER.md`,后续做“会员中心”或“博客页”时,自动继承全局规范,仅覆盖局部差异。

### 业务场景

- • **独立开发者**:快速产出高质感 MVP 界面,告别“AI 味”原型

- • **小型团队**:统一设计语言,避免前端与设计师反复对稿

- • **外包接单**:用专业级输出提升客户信任度,报价更有底气

- • **内部工具**:为后台系统注入现代 UI,提升使用体验

尤其适合那些**不想花大价钱请设计师,又不愿将就“能用就行”界面**的务实派开发者。

### 结语

UI/UX Pro Max Skill 的出现,不是要取代设计师,而是把设计领域的“常识”和“经验”封装成 AI 能执行的规则,让每个开发者都能站在专业设计的肩膀上。

它处理的不是“能不能做”,而是“做得够不够专业”。在效率与质量之间,找到了一个恰到好处的平衡点。

如果你也厌倦了和 AI 反复拉扯界面细节,不妨试试这个开源技能包。或许下一次,你只需要一句话,就能拿到一个可以直接交付的设计方案。

后台私:uiskill 获取源码和文档。

往期项目

[一款数字孪生三维可视化开发工具,融合3D场景、实时数据、UI看板,数百个API开放,支持二次开发](/uploads/shares/4/assets/笔记同步助手/attachments/一款数字孪生三维可视化开发工具,融合3D场景、实时数据、UI看板,数百个API开放,支持二次开发-20260206091359-s6eggkj)

[开源|一款轻量级自动化运维平台,支持 Web 终端、批量执行、CI/CD 与日志追踪](/uploads/shares/4/assets/笔记同步助手/attachments/开源-一款轻量级自动化运维平台,支持Web终端、批量执行、CI-CD与日志追踪-20260206091359-foixdv0)

[开源|一款基于 Node.js 和Amis 的轻量级低代码平台,支持多租户、工作流与一键部署](/uploads/shares/4/assets/笔记同步助手/attachments/开源-一款基于Node.js和Amis的轻量级低代码平台,支持多租户、工作流与一键部-20260206091400-rcgpxr1.js和amis的轻量级低代码平台,支持多租户、工作流与一键部署)

[一款GEO AI优化系统,支持关键词蒸馏、自动创作、多平台投喂与收录验证,让品牌在DeepSeek、豆包等大模型中被优先推荐](/uploads/shares/4/assets/笔记同步助手/attachments/一款GEOAI优化系统,支持关键词蒸馏、自动创作、多平台投喂与收录验证,让品牌在DeepSeek、豆包等大模型中被优先推荐-20260206091400-38r7ohc)

[开源|一款零成本、免公网IP的内网穿透工具,一条命令直连两台主机,支持远程桌面、SSH、Git 等端口访问](/uploads/shares/4/assets/笔记同步助手/attachments/开源-一款零成本、免公网IP的内网穿透工具,一条命令直连两台主机,支持远程桌面、SSH、Git等端口访问-20260206091400-lsaq98t)

[开源|一款全场景电子签章系统,支持多租户、私有化部署与合规签署](/uploads/shares/4/assets/笔记同步助手/attachments/开源-一款全场景电子签章系统,支持多租户、私有化部署与合规签署-20260206091400-aqefeba)

[开源|一款零成本、免公网IP的内网穿透工具,一条命令直连两台主机,支持远程桌面、SSH、Git 等端口访问](/uploads/shares/4/assets/笔记同步助手/attachments/开源-一款零成本、免公网IP的内网穿透工具,一条命令直连两台主机,支持远程桌面、SSH、Git等端口访问-20260206091400-0jic7fm)

了解更多

#开源、#AI 设计、#UI/UX、#前端开发、#Tailwind、#设计系统、#Claude、#技能包、#MIT 协议、#跨平台

---

原创 刘哥聊技术 刘哥聊技术

继续滑动看下一个

刘哥聊技术

向上滑动看下一个[^16]: # 重磅!Antdv Next 正式发布!对标 Antd V6 的 Vue3 UI 组件库!

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260207105532-9ctazld)

## 正文

公众号名称:前端开发爱好者

作者名称:认真努力的小四子

发布时间:2026-02-07 08:34

如果你是 **Vue** 开发者,大概率绕不开一个名字——**Ant Design Vue**。

在很长一段时间里,它几乎是 **Vue**`企业级后台`项目的`“标准答案”`:`成熟、稳定、组件齐全`,支撑了无数真实业务系统。

但随着时间推移,越来越多 **Vue** 开发者也开始意识到一个现实问题:

> **Ant Design 在快速演进,而 Ant Design Vue,正在变得越来越“吃力”。**

>

## 🤔 当 Ant Design 走到 v6,Vue 生态却有点“卡住了”

**Ant Design v6** 并不是一次普通升级。

它带来的,是一次**设计体系级别的变化**:

- 全新的 **Design Token System**

- 更系统化的`颜色`、`字号`、`间距抽象`

- 更现代的`视觉`与`交互规范`

- 面向未来的`样式`与`主题`能力

但对于 **Vue** 生态来说,问题也随之变得非常现实:

- `Ant Design` 的核心实现始终 **React 优先**

- `Ant Design Vue` 经过多年演进,背负了大量历史设计

- `API` 中仍然保留不少 `React` 风格的使用方式

- 要在现有架构上完整对齐 `v6`,成本极高

于是,一个很多人心里都有、但一直没人真正去做的问题出现了:

> **有没有可能,为 Vue 3 重新实现一次 Ant Design?**

>

## ✨ Antdv Next:不是升级,而是重建

**Antdv Next**,正是在这样的背景下诞生的。

需要特别强调的是:

**Antdv Next 并不是 Ant Design Vue 的 Next 版本。**

它不是渐进升级,也不是兼容演化,而是一个**从 0 开始的全新项目**,目标非常明确:

- 🎯 **设计体系直接对标 Ant Design v6**

- 🎯 **API 从一开始就为 Vue 而设计**

- 🎯 **工程架构面向未来,而不是历史包袱**

随着 **Antdv Next v1.0 的正式发布**,**Vue** 生态终于迎来了一个明确对标 **Ant Design v6** 的新选择。

## 🧩 核心设计理念:真正的 Vue,而不是“React 翻译版”

### API 设计:完全 Vue 化

**Antdv Next** 在 `API` 设计上,做了一个非常坚定的取舍:

👉 **不追求 React API 的一一对应,而是遵循 Vue 的使用直觉。**

具体体现为:

- **插槽(Slots)** 是核心能力,而不是 `children` 兼容

- `模板`表达自然、清晰

- 减少`“为了兼容而复杂”`的设计

用一句话形容就是:**你不会感觉自己在“用 Vue 写 React 组件”。**

### 设计体系:对齐 Ant Design v6 的 Design Token

**Antdv Next** 从项目伊始,就直接对齐 `Ant Design v6` 的设计体系:

- `颜色`、`字体`、`间距`、`圆角`等全部基于 **Token**

- **设计与实现解耦**

- **主题定制更灵活、更系统**

这意味着它不是“看起来像 **Ant Design**”, 而是**在设计层面就属于 Ant Design v6 体系的一部分**。

### 样式方案:CSS-in-JS + 更少运行时负担

在样式架构上,**Antdv Next** 选择了更偏向现代前端的方案:

- **样式生成可控**

- **更利于主题切换**

- **对** **`SSR / Nuxt`** **更友好**

- **降低运行时开销**

这类设计在中大型项目中,长期维护价值非常高。

## 🛠 技术栈与工程定位

**Antdv Next** 的整体技术选型非常清晰:

- **Vue 3**

- **TypeScript**

- 面向 **SSR / Nuxt**

- 企业级工程结构

- 可持续维护的组件体系

它并不是一个“玩票性质”的实验,而是一个**有明确工程目标的长期项目**。

## 📦 快速上手

安装非常简单:

```

npm install antdv-next

# or

pnpm add antdv-next

# or

yarn add antdv-next

```

随后即可在 **Vue 3** 项目中按需引入组件。

📘 **官方文档**:[https://antdv-next.com/index-cn](/uploads/shares/4/assets/笔记同步助手/attachments/https---antdv-next-20260207105532-b5iefye.com-index-cn)

📦 **GitHub 仓库**:[https://github.com/antdv-next/antdv-next](/uploads/shares/4/assets/笔记同步助手/attachments/https---github-20260207105533-zpnnnf6.com-antdv-next-antdv-next)

## 🔍 Antdv Next vs Ant Design Vue

很多人会自然地把两者放在一起**对比**,其实它们的**定位**并不相同:

|维度|Antdv Next|Ant Design Vue|

| ----------| ------------| ----------------|

|设计体系|**Ant Design v6**|**v5**及之前|

|实现方式|从 **0** 重构|长期演进|

|API 风格|完全 **Vue** 化|部分 **React** 遗留|

|历史包袱|几乎没有|较重|

|未来扩展|更灵活|受历史限制|

与其说是`“替代关系”`,不如说是**不同阶段的选择**:

- **Ant Design Vue**:`成熟、稳定、经过时间验证`

- **Antdv Next**:`面向未来、设计体系更新、更现代`

## 🎯 写在最后

**Antdv Next** 的出现,其实是一件很 **“难得”** 的事。

它没有选择最安全的路径,而是做了一次更艰难的决定:

**不是为了兼容过去,而是为 Vue 生态对齐 Ant Design 的未来。**

如果你:

- 正在使用 **Vue 3**

- 关注 **Ant Design v6** 的设计体系

- 希望一个**更现代**、**更干净**的组件库实现

那么 **Antdv Next 非常值得关注,甚至参与共建**。

🚀 **Vue** 生态,终于迎来了一个真正对标 **Ant Design v6** 的新答案。

- 📘 **官方文档**:[https://antdv-next.com/index-cn](/uploads/shares/4/assets/笔记同步助手/attachments/https---antdv-next-20260207105532-b5iefye.com-index-cn)

- 📦 **GitHub 仓库**:[https://github.com/antdv-next/antdv-next](/uploads/shares/4/assets/笔记同步助手/attachments/https---github-20260207105534-3p3e21g.com-antdv-next-antdv-next)

---

Original 认真努力的小四子 前端开发爱好者

继续滑动看下一个[^17]: # Vue 开发必备!9 个高效插件,从基础到工具全栈覆盖(Vue2-Vue3 通用)

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260207212539-8o58tml)

## 正文

公众号名称:Ai懒人码农

作者名称:JackChen007

发布时间:2026-02-05 08:08

Vue 之所以能成为前端开发者的首选框架之一,除了简洁灵活的语法设计,其强大的插件生态更是核心优势!这些插件就像 “开发快捷键”,能帮我们跳过重复的基础编码,直接攻克路由管理、状态共享、UI 搭建、接口请求等高频需求。无论是 Vue2 项目维护,还是 Vue3(含组合式 API)新项目开发,都能找到适配的成熟插件。

本文精选 9 个日常开发高频使用的 Vue 插件,按基础核心、UI 组件、网络请求、工具辅助四大类分类,每款都附上核心功能、安装命令和极简使用示例,新手也能快速上手融入项目,让开发效率直线提升!

说明:文中默认以 Vue3(基于 Vite)项目为例,Vue2 项目的安装命令和使用差异会单独标注,确保不同技术栈都能无缝适配。

## 一、基础核心插件:Vue 项目的 “骨架基石”

这类插件是绝大多数 Vue 项目的必备基础,解决路由跳转、跨组件数据共享等核心问题,是项目启动的前提条件,缺一不可。

### 1\. vue-router:Vue 官方路由管理器

**核心作用**:Vue 官方标配的路由插件,专为单页应用(SPA)设计,支持页面跳转、路由守卫、动态路由、嵌套路由等核心功能,是实现页面切换的核心工具。**适配版本**:Vue2 适配 vue-router@3,Vue3 适配 vue-router@4**安装命令**:

```

# Vue3 + Vite

npm install vue-router@4 --save

# Vue2

npm install vue-router@3 --save

```

**极简使用**:(1)新建路由配置文件`src/router/index.js`,定义路由规则:

```

import { createRouter, createWebHistory } from'vue-router'

// 引入需要跳转的页面组件

import Home from'@/views/Home.vue'

import About from'@/views/About.vue'

const routes = [

{ path: '/', name: 'Home', component: Home },

{ path: '/about', name: 'About', component: About }

]

// Vue3推荐使用createWebHistory模式(无#号URL)

const router = createRouter({

history: createWebHistory(),

routes

})

exportdefault router

```

(2)在`src/main.js`全局注册路由:

```

import { createApp } from 'vue'

import App from './App.vue'

import router from './router'

// 全局挂载路由插件

createApp(App).use(router).mount('#app')

```

(3)页面中使用路由跳转和渲染:

```

首页

关于我们

```

### 2\. Pinia:Vue3 官方推荐状态管理库

**核心作用**:Vue3 官方推出的状态管理工具,替代传统 Vuex,专门解决跨组件、跨页面的数据共享问题。相比 Vuex 更轻量、语法更简洁,支持组合式 API,无需复杂的 mutations/actions,可直接修改状态,开发体验更流畅。**适配版本**:主打 Vue3,Vue2 需额外配置适配**安装命令**:

```

npm install pinia --save

```

**极简使用**:(1)在`src/main.js`全局注册 Pinia:

```

import { createApp } from 'vue'

import App from './App.vue'

import { createPinia } from 'pinia'

const pinia = createPinia()

createApp(App).use(pinia).mount('#app')

```

(2)新建状态仓库`src/stores/counter.js`:

```

import { defineStore } from'pinia'

// 定义并导出仓库,唯一标识为"counter"

exportconst useCounterStore = defineStore('counter', {

// 状态数据(返回对象的函数)

state: () => ({ count: 0 }),

// 修改状态的方法(支持同步/异步)

actions: {

increment() {

this.count++

}

},

// 计算属性(基于state派生的数据)

getters: {

doubleCount: (state) => state.count * 2

}

})

```

(3)在组件中使用状态:

```

// 引入仓库并实例化

import { useCounterStore } from '@/stores/counter'

const counter = useCounterStore()

```

### 3\. Vuex:经典状态管理(Vue2 首选)

**核心作用**:Vue2 官方状态管理库,规范了状态的修改流程,支持模块化拆分,适合中大型 Vue2 项目的复杂状态管理。Vue3 虽兼容(需用 vuex@4),但更推荐使用 Pinia。**适配版本**:Vue2 用 vuex@3,Vue3 用 vuex@4(兼容模式)**安装命令**:

```

# Vue2

npm install vuex@3 --save

```

**极简使用**:全局注册后,通过`this.$store.state`获取状态,`this.$store.commit`提交 mutation 修改状态,支持按业务模块拆分仓库(如用户模块、商品模块),适合复杂项目的状态分层管理。

## 二、UI 组件库:快速搭页,告别重复写样式

UI 组件库是前端开发的 “效率神器”,封装了按钮、表单、弹窗、表格等高频 UI 组件,支持按需引入,无需手动编写 CSS/HTML,直接调用即可完成页面搭建,以下 3 款覆盖通用 PC 端、移动端、高颜值轻量三大场景。

### 4\. Element Plus:Vue3 通用 PC 端 UI 库

**核心作用**:饿了么团队开发的 Vue3 PC 端 UI 组件库,国内最主流的 Vue3 UI 解决方案。组件丰富(近 100 个)、文档详细、兼容性强,支持完整引入和按需引入,是中后台管理系统、PC 端官网的首选。**适配版本**:Vue3 专属(Vue2 对应 Element UI)**安装命令**:

```

# 完整安装(新手友好)

npm install element-plus --save

# 按需引入(推荐生产环境,减小打包体积)

npm install element-plus unplugin-vue-components --save

```

**极简使用(完整引入)** :

```

// src/main.js

import { createApp } from 'vue'

import App from './App.vue'

import ElementPlus from 'element-plus'

import 'element-plus/dist/index.css' // 引入全局样式

createApp(App).use(ElementPlus).mount('#app')

```

组件中直接使用,无需单独引入:

```

import { ref } from 'vue'

const input = ref('')

```

### 5\. Vant 4:Vue3 移动端 UI 库

**核心作用**:有赞团队打造的移动端 UI 库,专为手机端优化,组件轻量、适配各种屏幕尺寸,支持按需引入、主题定制,是 Vue 移动端项目的首选。适用于电商 APP、资讯类应用、小程序等场景。**适配版本**:Vue3 用 Vant4,Vue2 用 Vant2**安装命令**:

```

npm install vant --save

# 按需引入依赖插件

npm install unplugin-vue-components unplugin-auto-import --save-dev

```

**极简使用**:配置 Vite 后支持按需引入,组件直接使用:

### 6\. Naive UI:Vue3 高颜值轻量 UI 库

**核心作用**:一款原生 Vue3 UI 库,设计风格现代化、颜值高,相比 Element Plus 更轻量,支持暗黑模式、按需引入,无需额外配置样式,适合追求 UI 质感的 PC 端项目。**适配版本**:仅支持 Vue3**安装命令**:

```

npm install naive-ui --save

```

**极简使用**:组件需手动按需引入,按需加载更灵活:

```

// 手动引入需要的组件

import { NButton } from 'naive-ui'

```

## 三、网络请求插件:优雅处理接口,少写冗余代码

项目开发中频繁遇到的接口请求、请求拦截、响应错误处理等需求,无需重复封装原生 fetch/axios,以下插件专为 Vue 适配,让请求处理更简洁、更优雅。

### 7\. vue-axios:Vue 适配的 Axios 插件

**核心作用**:将 Axios 封装为 Vue 插件,支持全局注册,可通过`this.$axios`或`proxy.$axios`全局调用。结合 Axios 的拦截器,轻松实现请求头添加 Token、响应错误统一处理、加载状态显示等功能。**适配版本**:Vue2/Vue3 通用**安装命令**:

```

# 先安装axios,再安装vue-axios

npm install axios vue-axios --save

```

**极简使用**:(1)全局注册并封装(`src/main.js`):

```

import { createApp } from'vue'

import App from'./App.vue'

import axios from'axios'

import VueAxios from'vue-axios'

const app = createApp(App)

app.use(VueAxios, axios)

// 配置请求基准地址

axios.defaults.baseURL = 'https://api.example.com'

// 请求拦截器:添加Token

axios.interceptors.request.use(config => {

config.headers.token = localStorage.getItem('token') || ''

return config

})

// 响应拦截器:统一处理错误

axios.interceptors.response.use(

res => res.data, // 直接返回响应数据

err => {

console.error('请求失败:', err.message)

returnPromise.reject(err)

}

)

app.mount('#app')

```

(2)组件中发起请求:

```

import { getCurrentInstance } from 'vue'

const { proxy } = getCurrentInstance()

// 发起GET请求

const getList = async () => {

const res = await proxy.$axios.get('/api/list')

console.log('请求结果:', res)

}

// 发起POST请求

proxy.$axios.post('/api/add', { name: 'Vue插件' })

```

### 8\. VueUse:Vue 官方工具集(全能型选手)

**核心作用**:不是单一插件,而是 Vue 官方维护的工具函数集合,封装了近 200 个高频开发需求,包括网络请求、本地存储、防抖节流、DOM 操作、时间处理等。支持组合式 API,按需引入,体积极小,功能覆盖全面。**适配版本**:Vue2/Vue3 通用(Vue2 需额外安装`@vue/composition-api`)**安装命令**:

plaintext

```

npm install @vueuse/core --save

```

**极简使用(网络请求 + 本地存储示例)** :

```

// 按需引入需要的工具函数

import { useFetch } from '@vueuse/core'

import { useLocalStorage } from '@vueuse/core'

// 网络请求:自动处理加载状态和错误

const { data, isLoading, error } = useFetch('https://api.example.com/api/list').get()

// 本地存储:自动序列化/反序列化,响应式更新

const userInfo = useLocalStorage('userInfo', { name: 'Vue', age: 3 })

userInfo.value.age = 4 // 直接修改,localStorage自动同步更新

```

## 四、工具辅助插件:搞定高频小需求,提升开发体验

这类插件专注解决开发中的 “小痛点”,比如本地存储序列化、数据持久化等高频需求,让代码更简洁,开发更省心。

### 9\. vue-ls:Vue 适配的本地存储插件

**核心作用**:专门为 Vue 封装的 localStorage/sessionStorage 工具,解决原生本地存储需手动调用`JSON.stringify`/`JSON.parse`的问题,支持设置过期时间、命名空间,全局注册后可通过`this.$ls`调用,完美适配 Vue 的响应式特性。**适配版本**:Vue2/Vue3 通用**安装命令**:

plaintext

```

npm install vue-ls --save

```

**极简使用**:(1)全局注册并配置(`src/main.js`):

```

import { createApp } from'vue'

import App from'./App.vue'

import Storage from'vue-ls'

// 配置项:命名空间、存储类型

const options = {

namespace: 'vue_', // 本地存储key的前缀

storage: 'local'// 存储类型:local(持久化)/ session(会话级)

}

createApp(App).use(Storage, options).mount('#app')

```

(2)组件中使用:

```

import { getCurrentInstance } from'vue'

const { proxy } = getCurrentInstance()

// 设置存储:key、value、过期时间(秒,可选)

proxy.$ls.set('name', 'Vue插件', 60 * 60) // 1小时后过期

// 获取存储值

console.log('获取存储:', proxy.$ls.get('name'))

// 删除指定存储

proxy.$ls.remove('name')

// 清空当前命名空间下的所有存储

proxy.$ls.clear()

```

## 五、插件使用小技巧(新手避坑指南)

1. **按需引入优先**:除了 vue-router、Pinia 等核心插件,UI 库(如 Element Plus、Vant)和工具库建议按需引入,可大幅减小项目打包体积,提升页面加载速度;

2. **版本匹配是关键**:Vue2 和 Vue3 的插件版本差异较大,安装前务必确认插件适配的 Vue 版本(如 vue-router@3 对应 Vue2,@4 对应 Vue3),避免出现兼容报错;

3. **注册方式有讲究**:核心插件(路由、状态管理)全局注册,保证全项目可用;单个组件的专用工具(如 VueUse 的某个函数)局部引入,避免全局污染,保持项目结构清晰;

4. **二次封装提效率**:网络请求、本地存储等插件,建议在全局注册时做二次封装(如统一请求头、统一存储命名空间、统一错误处理),避免每个组件重复编写相同逻辑。

## 总结

以上 9 个 Vue 插件,覆盖了从项目基础搭建到业务落地的全流程需求:基础核心插件搞定路由跳转和状态共享,UI 组件库快速实现页面搭建,网络插件简化接口请求逻辑,工具插件解决本地存储等高频小需求。

每个插件都经过社区长期验证,稳定可靠,能帮你省去大量重复开发的时间,将精力聚焦在核心业务逻辑上。无论是新手入门还是资深开发者提效,这些插件都是 Vue 项目开发的 “得力助手”,赶紧收藏起来融入你的项目吧!

---

Original JackChen007 Ai懒人码农

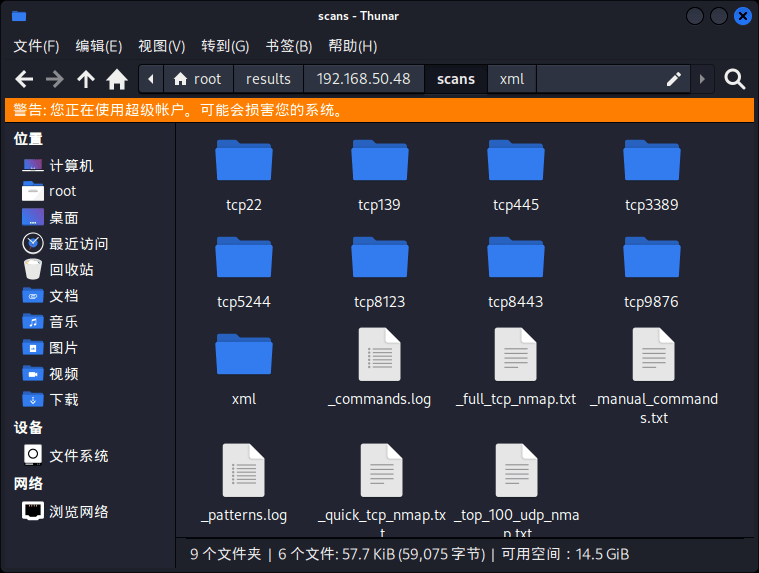

继续滑动看下一个[^18]: # 懒人神器 Autorecon

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260207105527-xfi96pa)

## 正文

公众号名称:kali笔记

作者名称:大表哥吆

发布时间:2026-02-05 08:35

> 当下信息收集工具百花齐放,每款工具都有自身的优点和不足。而这需要我们在多款工具中来回切换,因此,本文为大家分享一款更加适合懒人的信息收集工具`autorecon`

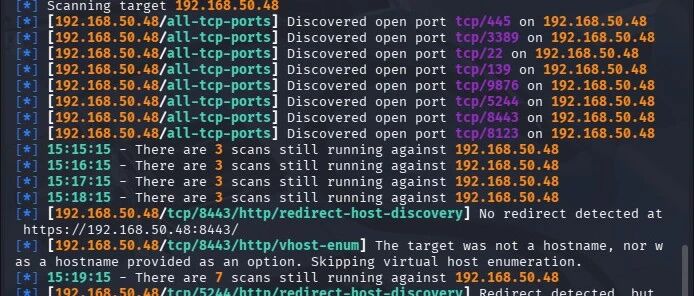

>

`AutoRecon`是一款信息收集工具,输入目标IP后,就可以自动联动nmap, gobuster, nikto,如果有smb服务的话也会顺便联动smbclient之类的工具。进行安全测试,一步到位。

在Kali Linux中已经默认安装,输入下面命令可查看相关帮助文档。

```

autorecon -h

```

**小试牛刀**

输入目标IP便可以进行全方面的信息收集,如

```

autorecon 192.168.50.48

```

端口扫描效果 准确率还行

其他扫描命令示例:

```

# 扫描多个目标

autorecon 192.168.50.100 192.168.50.101

# 从文件读取目标

autorecon -t xiaoyaozi.txt

# 指定端口范围

autorecon -p "T:21-25,80,443,U:53" 192.168.50.100

```

**扫描结果**

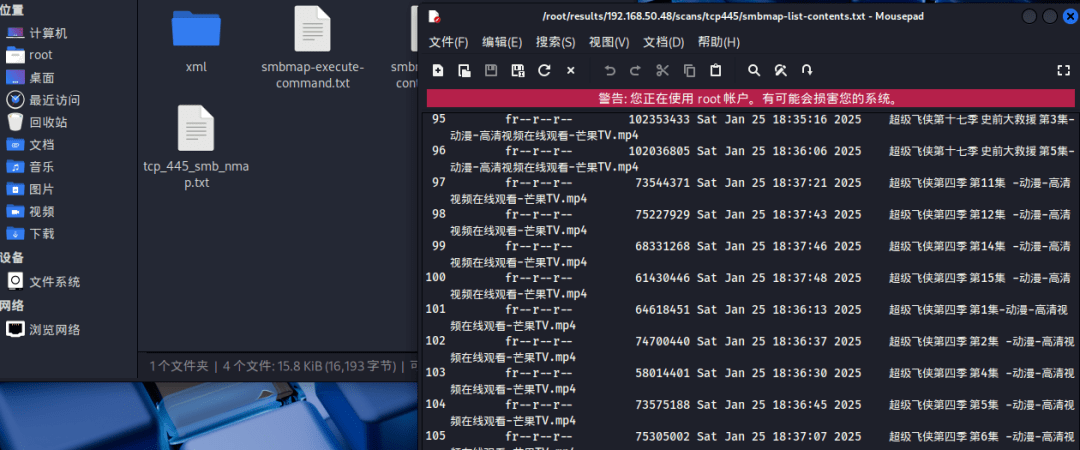

扫描完成后,在`/root/results`会显示相关扫描结果。

根据不同的开放端口 显示不同的结果

如目标开启了`445`端口,会自动扫描smb共享文件。

更多精彩文章 欢迎关注我们

---

原创 大表哥吆 kali笔记

继续滑动看下一个

kali笔记

向上滑动看下一个[^19]: # 编程中的MVP是什么意思?

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260207212543-k5dvefr)

## 正文

公众号名称:陈宝AI编程

发布时间:2025-12-31 17:00

MVP = 先做一个“能用”的最小版本,不做完整。

用最简单的话说

👉 不是最好

👉 不是最全

👉 只要能解决一个最核心的问题

不考虑UI设计,不考虑用户交互,只需要能有这一个功能,能解决一个问题就是MVP。

为什么一定要先做MVP?

因为你不确定有没有人用

先少花时间

快速试错!

[^20]: # AI编程,我也入局了!

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260208203548-txsm12s)

## 正文

公众号名称:程序员小灰

作者名称:小灰

发布时间:2026-02-08 18:36

大家好,我是程序员小灰。

如今,我们进入AI时代已经整整三年了。

如果说从2023年到2024年,AI在多数时候还仅仅是玩具,那么到了2025年,AI已经真的可以用于生产环境了。

尤其是AI编程这个细分领域,许多互联网企业的程序员已经把AI编程融入自己的日常工作,为编码工作带来了效率的提升。

对于独立开发者和创业者而言,AI编程更加重要,目前已经有许多利用AI编程创造出的产品走入了大众的视野。

比如2024年末,霸榜苹果付费App排行榜的产品“小猫补光灯”,就是一位不太懂代码的产品经理用Cursor开发的。

再比如2025年末,风靡一时的“死了么”App,是由三位95后创业者用1500元的成本快速开发的,其中大概率用到了AI编程技术。

如今2026年刚刚到来,AI编程技术在今年一定进化得更加强大,也会有越来越多的普通人利用AI编程做出爆火的产品。

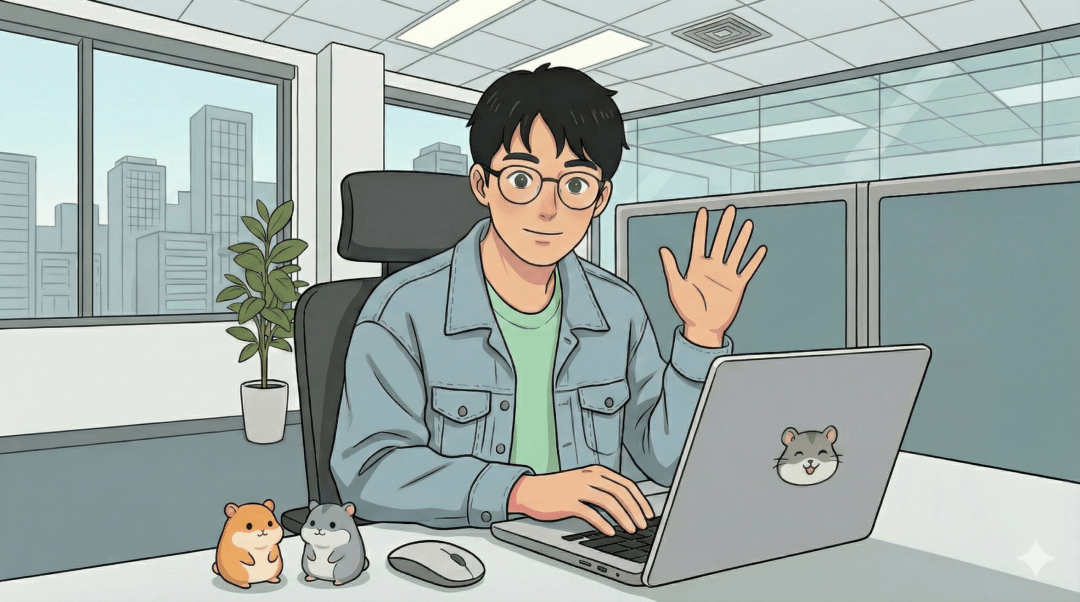

为了帮助更多朋友掌握AI编程技术,小灰和团队里的四位教练共同设计了一个AI编程训练营。我们计划在6个月的时间里,帮助大家掌握当下主流的各种AI编程工具,并且用AI编程技术做出自己的产品。

这个AI编程训练营,都包含了哪些内容呢?

训练营的第一部分是基础概念和工具的教学,这部分包含如下内容:

1\. 学习Vibe Coding的基本概念,并为非程序员讲解编程涉及的常用工具。

2\. 学习使用百度秒哒。

3\. 学习使用Trae。

4\. 学习使用Cursor。

5\. 学习使用Claude Code。

训练营的第二部分是带着大家进行实战演练,这部分包含如下内容:

1\. 用AI开发Web网站。

2\. 用AI开发游戏。

3\. 用AI开发微信小程序。

4\. 用AI开发桌面应用。

5\. 用AI开发移动端App。

训练营的第三部分是额外的加餐,这部分包含如下内容:

1\. 介绍AI编程的变现路径

2\. 讲解如何进行市场需求的挖掘

3\. 讲解AI开发产品的运营和推广

4\. 2026年AI编程领域的重大更新,我们也会列入到加餐课程当中。

我们这个训练营的交付形式是怎样的呢?

1\. 训练营在2026年3月1日正式发车,整体交付周期为6个月。

2\. 交付形式以直播为主,平均1-2周有一场直播,直播时间在周末晚上。

3\. 每次直播有回放,可以反复回顾,不用担心错过。

4\. 直播课配套清晰的图文讲义,方便大家听课学习与课后复习。

5\. 有任何AI编程相关的疑问,都可以在群里向教练咨询。

这个训练营适合什么样的人群呢?

第一类:创业者,想要做出自己的产品

借助AI编程工具,轻松实现自己心中的产品,带来流量和变现。

第二类:职场程序员,希望提升效率

用好AI编程工具,可以让你的编程效率至少提升3倍。

第三类:编程零基础,希望跟上AI时代的步伐

无需任何编程基础即可学习AI编程,制作自己的小工具为生活和工作带来便利。

第四类:在校学生

学习前沿AI变现技能,探索更多可能性,为今后的职业规划打下基础。

AI编程训练营的价格是多少?

我们的AI编程训练营的原价是1999元。

但由于我们的产品刚刚首发,现在只收大家最低价299元,这个最低价持续到2026年2月12日。

过了2月12日,我们的价格会上涨到399元。后面随着报名人数增加,价格还会进一步上涨,一直上涨到原价1999元为止。

因此,想要抓住这一波AI红利,系统学习AI编程的朋友,一定要抓紧时间以最低价报名哦~~

说到这里,大家应该已经对我们的AI编程训练营有了全方位的了解。

为了方便查阅,小灰还用NanoBanana生成了一张训练营海报,还蛮酷炫的:

对AI编程训练营感兴趣的朋友,欢迎扫码添加小灰微信进行报名,对本训练营有任何的疑问,也欢迎私信咨询。添加微信时请备注“ai编程”:

2026年,希望大家都能抓住AI编程的红利,一起成长,一起变现!

---

Original 小灰 程序员小灰

继续滑动看下一个

程序员小灰

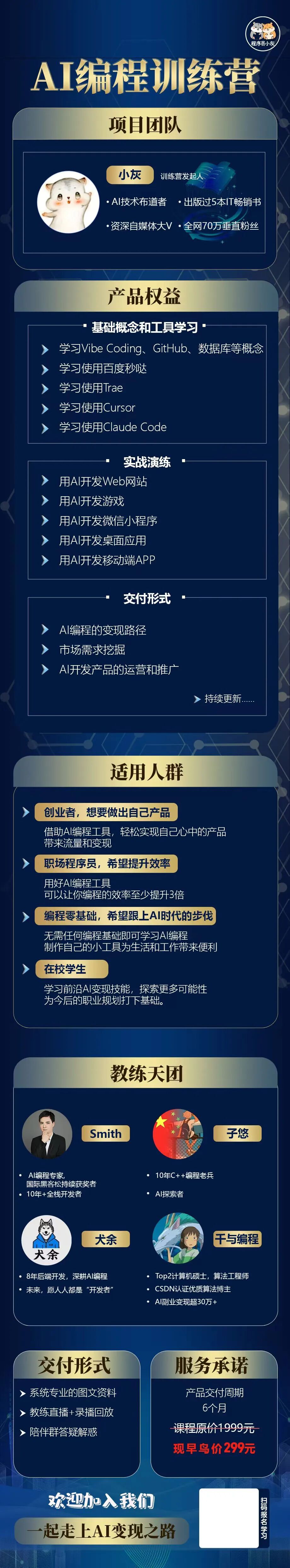

向上滑动看下一个[^21]: # 一句话让 AI 帮我下载各种视频,爽了!

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260208203817-ut1s3ap)

## 正文

公众号名称:程序员鱼皮

发布时间:2026-02-08 12:44

需要用到 yt-dlp 这个超强的开源视频下载器,支持 YouTube、B站、Twitter/X、TikTok、抖音等 1000+ 网站,GitHub 上十几万 Star 不是虚的。

你不需要知道这玩意怎么用,只要打开 Cursor / Claude Code 等 AI 工具,跟 AI 说:

\> 帮我基于 https://github.com/yt-dlp/yt-dlp 项目,封装一套「视频下载工作流」。以后我只需要跟你说要下载什么视频,就会自动帮我下载到本地,并且我可以指定视频的格式

然后 AI 就会编写 Python 脚本,以及教 AI 做事的指令,直到完成任务。

之后你就可以一句话下载视频了,比如跟 AI 说:

\- 帮我下载这个视频 https://xxx

\- 下载这个视频,要 1080p 的 mp4

\- 把这个视频转成 mp3 下载

\- 下载程序员鱼皮在 B 站的最新视频

不用记任何命令、不用装任何软件,说人话就行。想要什么格式、存到哪里、叫什么名字,AI 全帮你搞定。

当然,你也可以让 AI 把它变成网页拿去变现、或者封装成 Skills 整合到你的其他 AI 工作流中。

学会的话记得点赞收藏,别再花冤枉钱买什么视频下载会员了!

一些对大家有用的资源:

👉🏻 100+ 编程学习路线 / 实战项目 / 求职指导 [codefather.cn](/uploads/shares/4/assets/笔记同步助手/attachments/codefather-20260208203817-wy4w629.cn)

👉🏻 100+ 简历模板 [laoyujianli.com](/uploads/shares/4/assets/笔记同步助手/attachments/laoyujianli-20260208203818-ocup053.com)

👉🏻 300+ 企业面试题库 mianshiya.com

👉🏻 500+ AI 资源大全 [ai.codefather.cn](/uploads/shares/4/assets/笔记同步助手/attachments/ai.codefather-20260208203818-j0y2gzt.cn)

👉🏻 1 对 1 模拟面试 [ai.mianshiya.com](/uploads/shares/4/assets/笔记同步助手/attachments/ai.mianshiya-20260208203818-rqs550v.com)

👉🏻 动画学算法教程 [algo.codefather.cn](/uploads/shares/4/assets/笔记同步助手/attachments/algo.codefather-20260208203818-l9a4nq5.cn)

[^22]: # Axios 高效封装实战:拦截器 + 统一处理,彻底告别重复请求逻辑

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260209211526-1y3r2vo)

## 正文

公众号名称:Ai懒人码农

作者名称:JackChen007

发布时间:2026-02-07 08:09

在前端项目开发中,Axios 作为主流的 HTTP 请求库,几乎是必备工具。但直接在业务代码中零散调用 Axios,会面临 token 手动处理、错误提示混乱、loading 状态不统一等问题,不仅增加维护成本,还会影响用户体验。今天就带来一套实战级 Axios 封装方案,包含实例创建、拦截器配置、API 统一管理,让请求逻辑更简洁、更易维护!

## 一、为什么一定要封装 Axios?

直接使用 Axios 看似便捷,实则暗藏诸多痛点:

- 重复工作多:每个请求都要手动添加 token、处理超时、配置请求头;

- 状态管理乱:loading 显示 / 隐藏不统一,不同组件可能出现重复加载效果;

- 错误处理散:网络错误、权限不足、接口异常等错误未集中处理,用户体验参差不齐;

- 维护成本高:多服务请求配置混乱,后续修改需逐个查找调整。

而合理封装后,能实现:

1. 统一配置 baseURL、超时时间、请求头格式;

2. 自动添加 token、统一管理 loading 状态;

3. 集中处理接口错误、token 过期等异常场景;

4. 暴露简洁的 get/post 方法,支持类型推导;

5. 支持多服务实例隔离,适配复杂项目需求。

## 二、Axios 封装核心步骤(附完整代码)

### 1\. 前期准备:安装依赖

首先确保项目中已安装 Axios,若未安装可执行以下命令:

```

npm install axios

```

本文还结合 Vant 组件库的 Toast 做加载和错误提示,若未使用 Vant,可替换为项目中的提示组件。

### 2\. 创建 Axios 实例:实现配置隔离

通过 `axios.create()` 创建独立配置的实例,是封装的核心第一步,能实现多服务配置隔离,提升代码可扩展性。

```

/* 引入依赖 */

import axios, { CanceledError } from'axios'

import { showToast, showLoadingToast, closeToast } from'vant'

import { useUserStore } from'@/store/module/userInfo'

import { getToken } from'@/utils/aes'

// 从环境变量中读取基础地址(灵活适配开发/生产环境)

const apiBaseUrl = import.meta.env.VITE_TARGET

// 创建 Axios 实例

const service = axios.create({

baseURL: apiBaseUrl, // 接口请求基础路径

timeout: 60000, // 请求超时时间(60秒)

timeoutErrorMessage: '请求超时,请稍后再试',

withCredentials: false, // 是否携带 Cookie(根据项目需求调整)

headers: {

// 设置默认请求头格式(表单格式/JSON 格式可按需切换)

'Content-Type': 'application/x-www-form-urlencoded'

}

})

```

#### 关键疑问:为什么要用 axios.create ()?

`axios.create()` 的核心价值是创建**独立配置的 Axios 实例**,不同实例可拥有不同的 baseURL、超时时间、拦截器,完美适配项目中多服务请求场景(如同时调用用户服务、商品服务);同时能统一封装逻辑,避免全局配置污染,大幅提升代码可维护性和复用性。

### 3\. 封装请求拦截器:统一预处理请求

请求拦截器用于在请求发送前完成统一操作,比如添加 token、显示 loading,避免在每个请求中重复编写。

```

const userStore = useUserStore() // 从状态管理中获取用户信息

// 添加请求拦截器

service.interceptors.request.use(

(config) => {

// 1. 自动添加 Token 到请求头

const AuthToken = userStore.getAuthTokenValue()

if (AuthToken) {

config.headers['token'] = `${AuthToken}`// 按后端要求的格式设置(如 Bearer Token 可调整格式)

}

// 2. 统一显示加载状态

showLoadingToast({

message: '加载中...',

forbidClick: true, // 禁止点击背景

iconSize: 30,

loadingType: 'spinner',

className: 'custom-loading-toast'

})

return config // 必须返回配置,否则请求会中断

},

(error) => {

// 处理请求配置阶段的错误(如拦截器逻辑异常)

showToast('网络请求失败,请检查网络状态')

returnPromise.reject(error) // 抛出错误,供业务代码 catch 处理

}

)

```

#### 拦截器核心说明:

`axios.interceptors.request.use()` 接收两个回调函数:

- 第一个回调:请求发送前执行,参数 `config` 为请求配置对象,处理后必须返回 `config`;

- 第二个回调:请求配置失败时执行(如拦截器内抛错),需通过 `Promise.reject` 抛出错误。

### 4\. 封装响应拦截器:统一处理结果与异常

响应拦截器用于接收后端响应后,统一处理成功结果、关闭 loading、处理错误状态(如 token 过期、404、500 等)。

```

// 标记是否正在刷新 token(避免重复刷新)

let isRefreshing = false

// 存储 token 过期后需要重试的请求队列

let requests = []

// 添加响应拦截器

service.interceptors.response.use(

(response) => {

closeToast() // 成功响应后关闭 loading

const res = response.data // 直接返回响应体,简化业务代码处理

// 可根据后端统一响应格式添加业务错误处理(如 res.code !== 200 时提示)

// if (res.code !== 200) {

// showToast(res.msg || '接口请求失败')

// return Promise.reject(new Error(res.msg || 'Error'))

// }

return res

},

async (error) => {

closeToast() // 错误响应后关闭 loading

const { config, response } = error

// 处理不同状态码的错误

if (response) {

switch (response.status) {

case401: // 未授权(token 过期或无效)

// 处理 token 无感刷新逻辑

if (isRefreshing) {

// 若正在刷新 token,将当前请求加入队列

returnnewPromise((resolve) => {

requests.push((newToken) => {

config.headers['token'] = `${newToken}`

resolve(service(config))

})

})

}

isRefreshing = true

try {

const newToken = await getToken() // 调用刷新 token 接口

// 重试队列中的所有请求

requests.forEach((cb) => cb(newToken))

requests = []

// 重试当前请求

config.headers['token'] = `${newToken}`

return service(config)

} catch (e) {

showToast('登录已过期,请重新登录')

// 跳转至登录页(根据项目路由配置调整)

// router.push('/login')

returnPromise.reject(error)

} finally {

isRefreshing = false

}

case403: // 禁止访问

showToast('无权限访问该资源')

break

case404: // 资源未找到

showToast('请求资源不存在')

break

case500: // 服务器错误

showToast('服务器异常,请稍后再试')

break

default: // 其他错误

showToast(response.data?.message || error.message || '请求失败')

}

} else {

// 无响应(如网络错误)

showToast('网络连接异常,请检查网络')

}

returnPromise.reject(error)

}

)

exportdefault service

```

### 5\. API 统一管理:集中维护接口地址

创建 `api.ts` 文件,统一封装所有接口请求方法,避免接口地址散落在业务代码中。

```

import request from'@/service/axios'

// GET 请求示例:查询列表

exportfunction getListApi(params: { page: number; size: number }) {

return request.get('/api/list', { params })

}

// POST 请求示例:提交表单

exportfunction submitFormApi(data: { name: string; age: number }) {

return request.post('/api/submit', data)

}

// 备注:最终请求地址 = baseURL + 接口路径(如 baseURL 为 https://xxx.com,最终地址为 https://xxx.com/api/list)

```

### 6\. 页面中实战使用:简洁调用

封装完成后,页面中直接引入 API 方法即可,无需关注 token、loading、错误处理等逻辑。

```

import { getListApi, submitFormApi } from'@/api'

// 调用 GET 接口

const getList = async () => {

try {

const res = await getListApi({ page: 1, size: 10 })

// 处理接口返回数据

console.log('列表数据:', res)

} catch (error) {

// 可选:处理特定业务错误(通用错误已在拦截器处理)

console.error('请求失败:', error)

}

}

// 调用 POST 接口

const submitForm = async () => {

try {

const res = await submitFormApi({ name: '张三', age: 25 })

showToast('提交成功')

console.log('提交结果:', res)

} catch (error) {

console.error('提交失败:', error)

}

}

```

## 三、封装核心优势总结

1. **高效复用**:统一处理 token、loading、错误提示,减少重复代码;

2. **易于维护**:接口地址集中管理,修改时无需逐个查找;

3. **用户体验佳**:loading 统一显示、错误提示标准化,token 无感刷新;

4. **扩展性强**:支持多服务实例、类型推导,适配中大型项目;

5. **降低耦合**:业务代码与请求逻辑分离,代码结构更清晰。

## 四、常见问题解答

### Q1:axios.create () 和直接使用 axios 有什么区别?

A:`axios.create()` 会创建独立的 Axios 实例,拥有自己的配置(baseURL、超时时间、拦截器等),可实现多服务隔离(如同时调用 A 服务和 B 服务,各自配置不同 baseURL);而直接使用 axios 是全局配置,修改后会影响所有请求。

### Q2:拦截器中为什么必须返回 config 或 Promise?

A:请求拦截器需返回 config 才能让请求正常发送,否则请求会被中断;响应拦截器返回数据供业务代码使用,错误时需返回 Promise.reject,让业务代码能通过 catch 捕获错误。

### Q3:token 无感刷新的核心逻辑是什么?

A:当检测到 401 状态码时,标记正在刷新 token,将后续请求存入队列;刷新 token 成功后,重试队列中的所有请求,并更新当前请求的 token,实现用户无感知。

通过以上封装方案,既能解决日常开发中的请求痛点,又能让代码更具规范性和可维护性。赶紧整合到你的项目中,提升前端请求效率吧!如果需要根据项目特殊需求调整封装逻辑(如多环境配置、请求取消等),可以随时灵活扩展~

---

Original JackChen007 Ai懒人码农

继续滑动看下一个[^23]: # OpenClaw(clawdbot)是什么?它与 Skills、MCP、RAG、Memory 与 AI Agent 的关联解析

## 来源

[原文链接](/uploads/shares/4/assets/笔记同步助手/attachments/原文链接-20260210144435-fnky7z4)

## 正文

作者: 小白debug

发布日期: 未知

## 引言

近年来,随着大模型的快速发展,围绕模型的使用与扩展形成了一套完整的技术体系。OpenClaw(又名 clawdbot)正是基于这套体系构建的一款 AI 代理产品。本文系统梳理 OpenClaw 的核心概念,并阐明它与 Skills、MCP、RAG、Memory、AI Agent 等技术的关联。

## 推理服务(Inference Service)

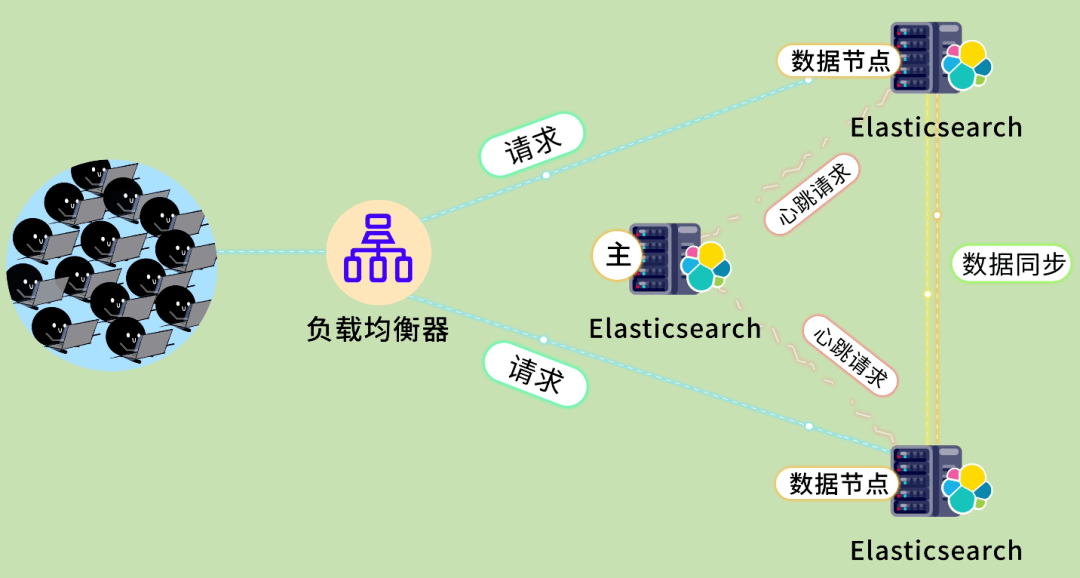

大模型本身是一个存放在磁盘上的巨型文件,文件中保存了经过训练得到的参数。要让模型产生响应,需要有专门的程序把模型加载到内存,并对外提供 HTTP 接口,接收用户请求、进行推理并返回结果,这一过程即称为推理服务。推理服务通常以无状态的方式运行,多个实例通过负载均衡共同承载高并发请求。

推理服务架构示意图

## 记忆(Memory)

推理服务是无状态的,每次请求结束后便不保留任何上下文。然而在聊天场景中,用户希望模型能够记住前面的对话。实现这一点的方式是:在每一次请求时将历史对话拼接到当前请求的上下文中发送给模型。为了避免上下文过长,系统会将对话分为短期记忆(最近几轮完整保留)和长期记忆(提炼关键信息生成摘要)。这种上下文管理机制即为记忆(Memory)。

记忆管理示意图

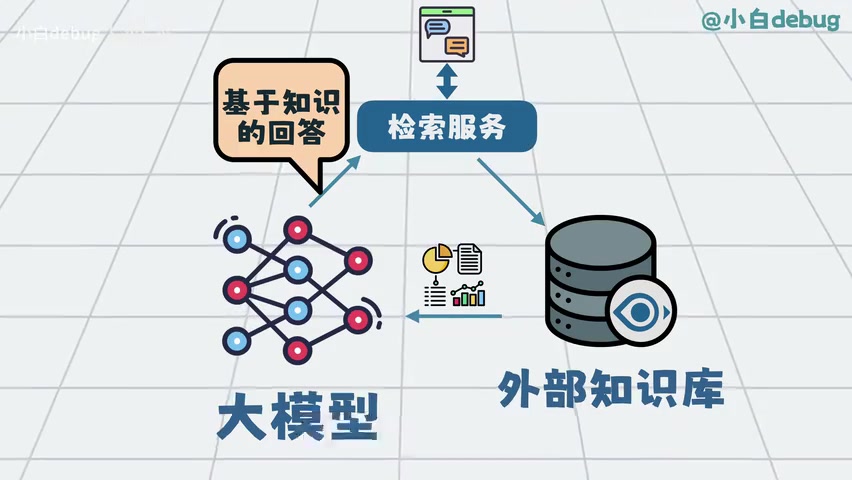

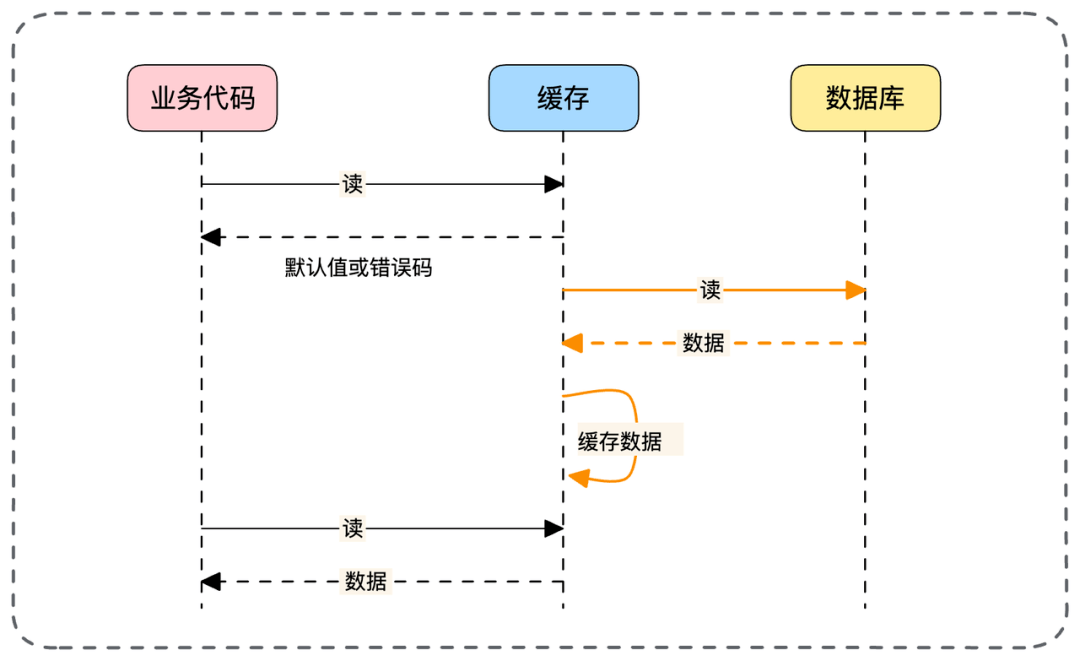

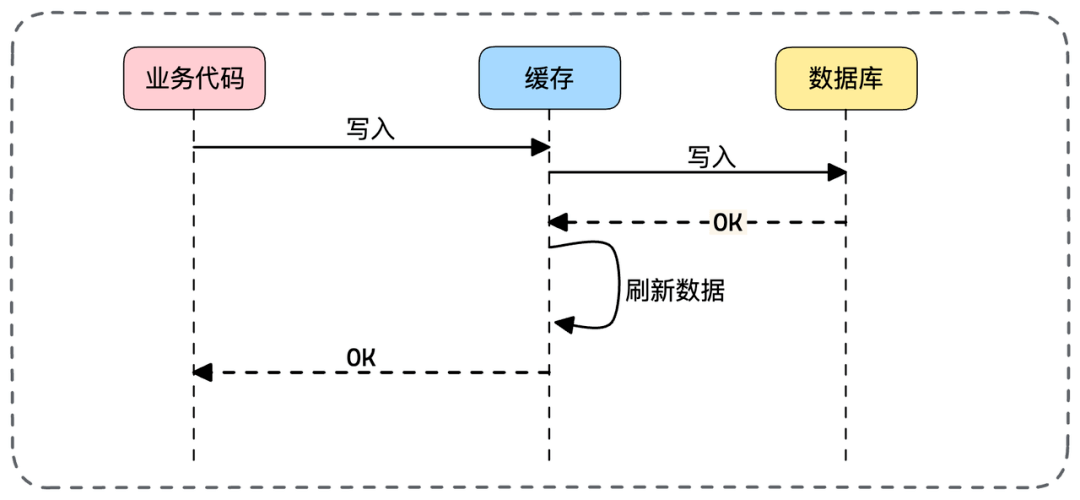

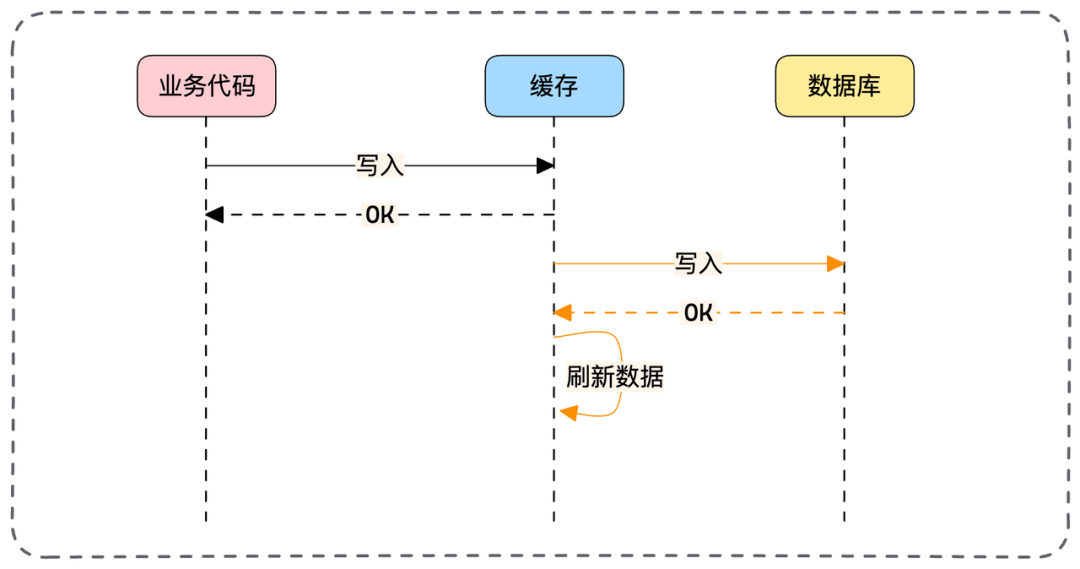

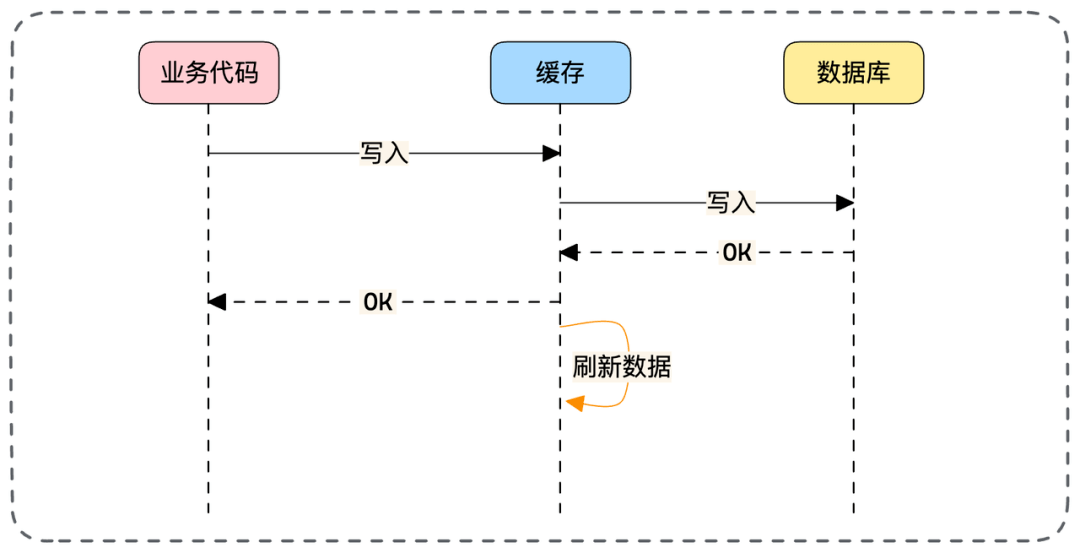

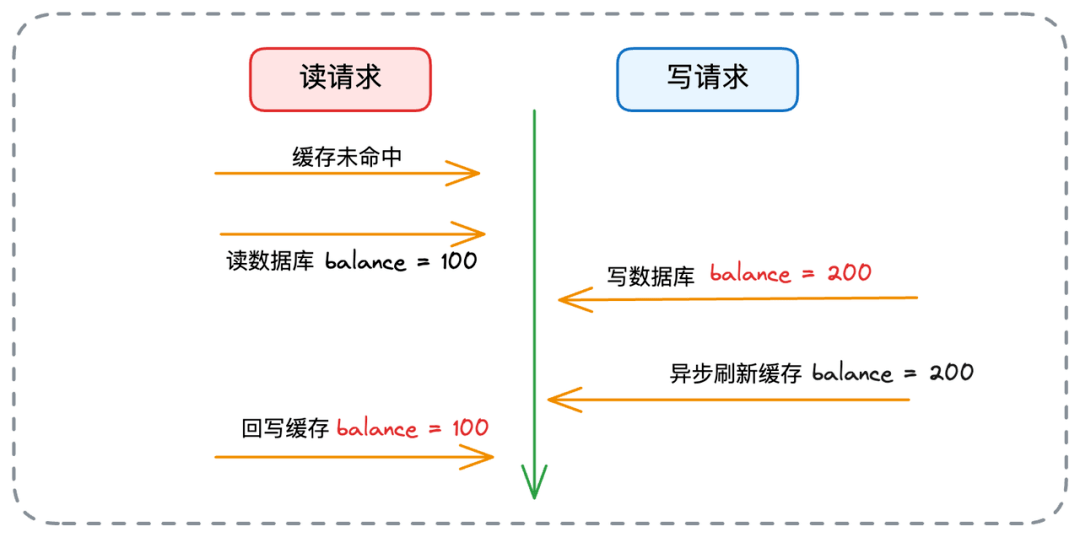

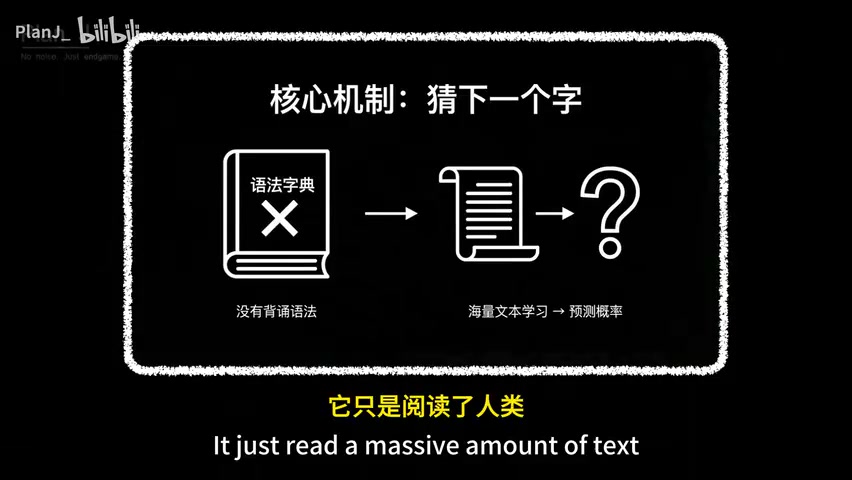

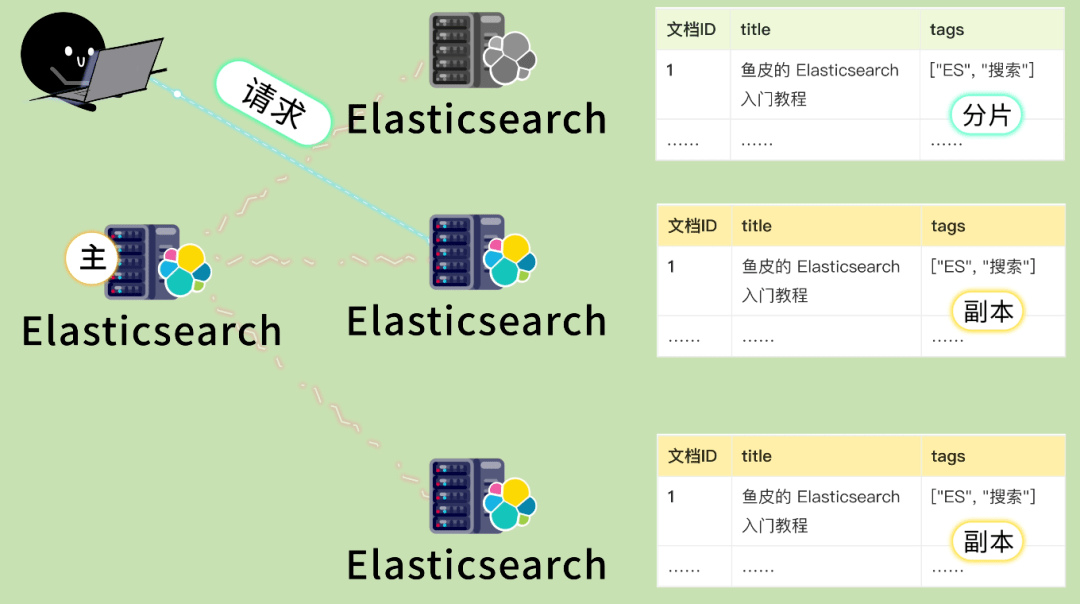

## 检索增强生成(RAG)